原论文地址:Network in Network

作者认为传统的CNN的非线性不够,抽象级别低。所以作者希望找到一种非线性表示能力更强的函数逼近器。

实际上CNN中的卷积操作(也可看做两个向量的内积)是一种广义线性模型。如果所要提取的特征是线性的或者低度非线性的,这种卷积操作得到的特征是比较符合预期的,但是如果所要提取的特征是高度非线性的,用CNN中的Filter方法想要获取到符合我们预期的特征就比较困难了,这个时候传统CNN会尝试使用超完备的滤波器来提取各种潜在的特征,即初始化大量的滤波器提取尽可能多的特征,将我们期望的特征也覆盖到,这样导致的一个结果就是:网络结果复杂,参数空间巨大。 不同人有不同看法,懵逼了-_-(的确卷积是线性变换,但是后面不是有非线性变换吗?) 其实也就是表明,CNN虽然能够表示非线性,但是它对线性特征的提取更友好!

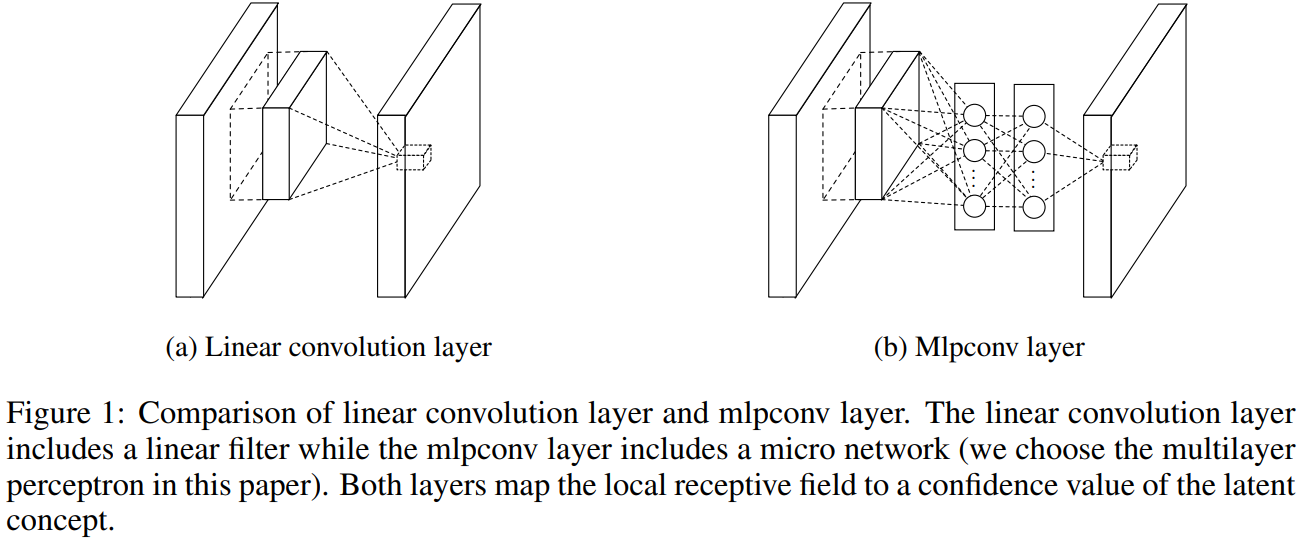

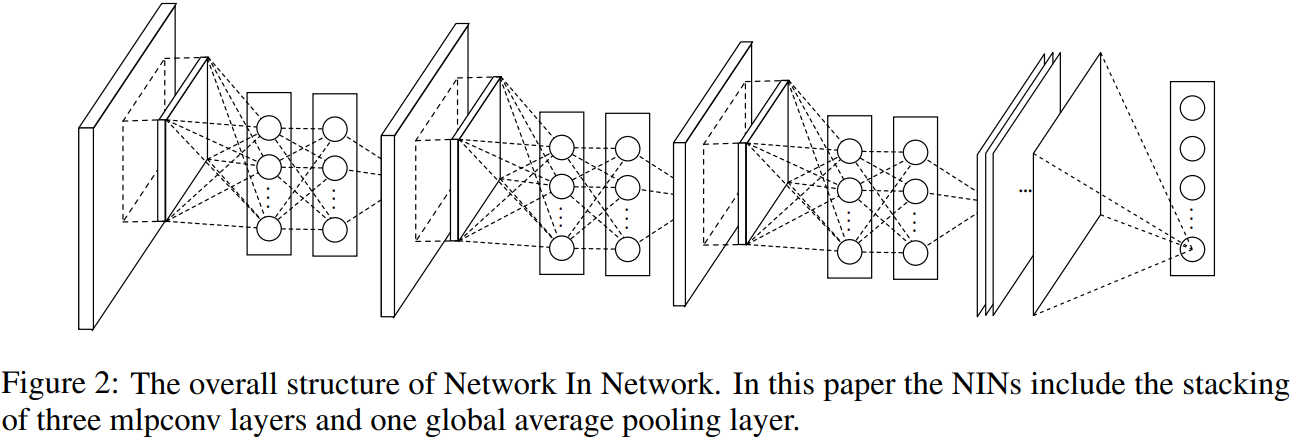

NIN中使用非线性表达能力更强的“micro network”代替原来的卷积操作,而“micro network”结构是一个多层感知机。多层感知机可以看做是在卷积操作中再包含一个多层微型网络,所以其被称为mlpconv,下图对比了传统CNN和mlpconv。

传统卷积公式:

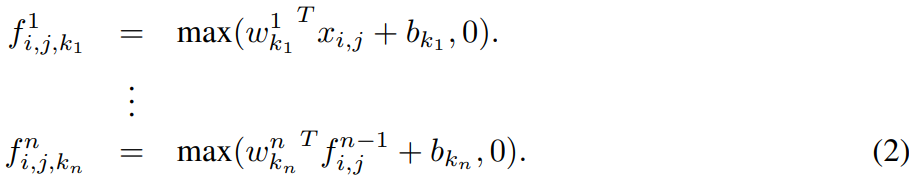

mlpconv卷积公式:

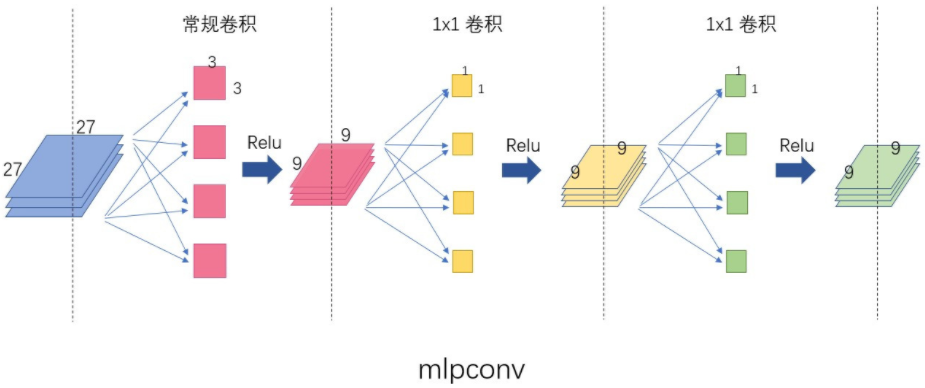

mlpconv实际上就等价于一个conv后面接多个卷积,实现跨通道池化。

吐槽一下,这个公式写的啥啊,(1)(2)事实上看不出啥区别,加了偏置项?不是吧…而且下标也不解释-_-! 然后的话,MLP事实上就是主要由全连接组成的网络(之前数据的线性组合产生后面的数据),但是此处利用

来替代MLP的话,其实就相当于减掉了很多分支,并且不同分支之间还存在参数共享的情况(就像对MLP的一种压缩,减少了更多的参数)

除此之外,作者采用GAvP替代传统CNN网络最后的全连接层,这使得网络更不易过拟合(fc容易过拟合)。而GAvP可以被看做是一种正则化手段!

事实上CNN网络需要用到很多过滤器去提取很多特征,高层特征由低层特征组合而成。但是,值得思考的问题是,每个过滤器提取的特征是否有意义呢?答案是:我们提取的大量特征可能都是无用特征!所以作者就希望构建一个更强大的特征提取器,在更少参数(包括滤波器数量更少)的情况下,产生更好的效果。

**