Insight & target problem

开放域的生成可以随便生成,但是摘要等任务是不能随心所欲的

财大气粗的研究请了人工标注,并分析相关的问题

Solution

对XSum数据集动手

用一些Baseline作为研究对象

- PGN(RNN)

- TCONVS2S (CNN)

- TRANS2S(Transformer Not Pretrained)

- BERTS2S (Transformer Pretrained)

Highlight

- 定义了不一致分为内部和外部不一致外部的不一致可以是Factual but not faithful

- Pretrain model可以很大的较少错误

- PGN因为copy减少了外部不一致,BERTS2S看起来外部不一致多,但很多都是Factual的

- 不一致原因推测

- 内部不一致:模型Encoder对原文的表示不大行

- 外部不一致:模型Decoder不会用原文,搞得和开放域一样乱讲

评估方法分析

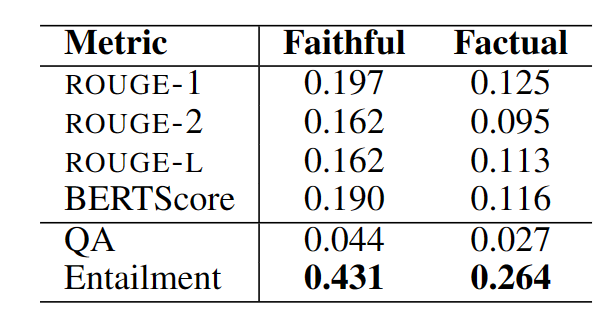

- 显然这种ROUGE,BERTSCORE都不大行

- Entailment不错,但是因为原文抽取的一句都能对齐,显然还要结合ROUGE之类的保证Informative

Others

总结一下:

- 事实一致性难搞

- NLU的pretrain能解决问题,但不能完全解决

- BERTSCORE,ROUGE这种不大行,要用带语义推断的来