百度:

| 模型 | 输入 | 输出 |

|---|---|---|

| ernie-speed | 0 积分 | 0 积分 |

| ernie-lite | 0 积分 | 0 积分 |

| 模型 | 输入 | 输出 |

|---|---|---|

| deepseek-chat | 0.7 积分 | 1.4 积分 |

| deepseek-coder | 0.7 积分 | 1.4 积分 |

AI语言模型

AI 语言模型类别。汇总表

| 模型家族 | 模型 | 输入长度 | 输出长度 | 总长度 | 输入单价 | 输出单价 |

|---|---|---|---|---|---|---|

| OpenAI | gpt-35-turbo | 16k | 4k | 20k | 5 | 10 |

| gpt-4-128k | 128k | 4k | 132k | 50 | 150 | |

| gpt-4o | 128k | 4k | 132k | 25 | 75 | |

| ChatGLM | glm-3-turbo | - | - | 128k | 0.7 | 0.7 |

| glm-4 | - | - | 128k | 70 | 70 | |

| glm-4-0520 | - | - | 128k | 70 | 70 | |

| glm-4-air | - | - | 128k | 0.7 | 0.7 | |

| glm-4-airx | - | - | 128k | 7 | 7 | |

| glm-4-flash | - | - | 128k | 0.07 | 0.07 | |

| MiniMax | abab5.5-chat | - | - | 16k | 10 | 10 |

| abab6-chat | - | - | 32k | 70 | 70 | |

| abab6.5s-chat | - | - | 245k | 70 | 70 | |

| 百度文心 | ernie-speed | 126k | 4k | 130k | 0 | 0 |

| ernie-lite | 6k | 2k | 26k | 0 | 0 | |

| ernie-3.5 | 5k | 2k | 22k | 9 | 9 | |

| ernie-4.0 | 5k | 2k | 22k | 85 | 85 | |

| 通义千问 | qwen1.5-7b-chat | - | - | 32k | 1 | 1 |

| qwen1.5-14b-chat | - | - | 32k | 1.5 | 1.5 | |

| qwen1.5-32b-chat | - | - | 32k | 4 | 4 | |

| qwen1.5-72b-chat | - | - | 32k | 4.5 | 4.5 | |

| qwen1.5-110b-chat | - | - | 32k | 9 | 9 | |

| qwen2-72b-instruct | - | - | 32k | 4.5 | 4.5 | |

| 百川 | Baichuan2-53B | - | - | 2k | 15 | 15 |

| Baichuan2-Turbo | - | - | 32k | 6 | 6 | |

| Baichuan2-Turbo-192k | - | - | 192k | 12 | 12 | |

| Baichuan3-Turbo | - | - | 32k | 8.5 | 8.5 | |

| Baichuan3-Turbo-128k | - | - | 128k | 17 | 17 | |

| Baichuan4 | - | - | 32k | 70 | 70 | |

| Claude | claude-3-opus | 200k | 4k | 204k | 75 | 375 |

| claude-3-sonnet | 200k | 4k | 204k | 15 | 75 | |

| claude-3-haiku | 200k | 4k | 204k | 1.25 | 6.25 | |

| claude-2 | 200k | 4k | 204k | 40 | 120 | |

| claude-instant-1 | 100k | 4k | 104k | 8.15 | 27.55 | |

| Gemini | gemini-1.0-pro | 30k | 2k | 32k | 2.5 | 7.5 |

| gemini-1.5-pro | 1000k | 8k | 1008k | 0.5 | 0.5 | |

| gemini-1.5-flash(输入长度<=128k) | 128k | 8k | 136k | 1.75 | 5.25 | |

| gemini-1.5-flash(输入长度>128k) | 1000k | 8k | 1008k | 3.5 | 10.5 | |

| Moonshot | moonshot-v1-8k | - | - | 8k | 8 | 8 |

| moonshot-v1-32k | - | - | 32k | 16 | 16 | |

| moonshot-v1-128k | - | - | 128k | 40 | 40 | |

| Yi | yi-large | - | - | 16k | 14 | 14 |

| yi-large-turbo | - | - | 16k | 8.5 | 8.5 | |

| yi-medium | - | - | 16k | 1.8 | 1.8 | |

| yi-medium-200k | - | - | 200k | 8.5 | 8.5 | |

| yi-spark | - | - | 16k | 0.7 | 0.7 | |

| Stepfun | step-1-32k | - | - | 32k | 16 | 16 |

| step-1-200k | - | - | 200k | 100 | 100 | |

| DeepSeek | deepseek-chat | - | - | 128k | 0.7 | 1.4 |

| deepseek-coder | - | - | 128k | 0.7 | 1.4 |

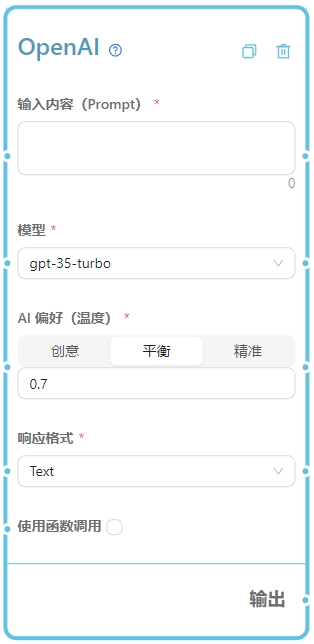

OpenAI

参数详解

1. 输入内容 ( Prompt )

支持列表输入 指示 AI 语言模型生成内容的提示词。2. 模型

- gpt-35-turbo - 16k 输入长度 - 4k 输出长度

- gpt-4-128k - 128k 输入长度 - 4k 输出长度

- gpt-4o - 128k 输入长度 - 4k 输出长度

3. AI 偏好 ( 温度 )

数值为 0~1 之间的小数,数值越大则生成的内容越随机。 当您需要非常精确、准确、可控的内容时,建议将该数值设置为 0。4. 响应格式

- text - 默认为普通文本格式

- JSON - 强制生成并返回有效的 JSON 对象 - 注意:选择此模式时还必须同时在提示词中强调需要返回 JSON,否则模型会报错。

5. 使用函数调用

可选项,当勾选后,可以配置函数调用(Function Call)的参数。函数调用的概念

最新版本的 gpt-35-turbo 和 gpt-4 经过微调,可使用函数并且能够确定何时以及如何调用函数。 如果请求中包含一个或多个函数,则模型将根据提示的上下文确定是否应调用任何函数。 当模型确定应调用函数时,它将使用包含函数参数的 JSON 对象进行响应。 这为这些模型提供了一种本机方法来构建 API 调用和构造数据输出,所有这些操作都基于你指定的函数。 请务必注意,虽然模型可以生成这些调用,但执行它们取决于你,确保你保持控制。 —-《如何将函数调用与 Azure OpenAI 服务配合使用(预览版)》 简而言之,你可以提前定义好一个或多个函数,并将其和提示词一起给到 AI 语言模型,当模型判断需要调用函数时,会将函数的参数以定义好的格式返回给你,你可以根据这些参数来自行执行函数。 举例来说,假设我们已经写好了一个函数叫<font style="color:rgb(102, 102, 102);background-color:rgb(245, 245, 245);">search_hotels</font>,可以输入地点、最高价格、要求等参数然后返回一个酒店列表。

现在我们的提示词是:以不到300元的费用在珠海找到海滨酒店,需要包含免费早餐。

把提示词和我们的函数信息(下面会介绍如何配置)一起给到 AI 语言模型,模型经过判断需要调用函数,会返回一个 JSON 对象,类似如下结果:

可以看到最关键作用在于使用函数输出后我们可以得到非常规范格式的数据,不再需要担心AI给出的内容格式不统一导致后续无法实现自动化处理。 因此我们建议您在需要用到格式化输出以便后续工作流节点处理时,可以考虑使用函数调用模式。

json{"name": "search_hotels","arguments": {"features": "海滨,免费早餐","location": "珠海","max_price": 300}}

6. 函数

当勾选<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">使用函数调用</font>后,可以添加希望 AI 模型自动判断使用的函数。函数的数量可以超过 1 个。但是一般情况下,我们建议您一个节点只使用一个函数,这样能够获得比较确定的输出。

6.1 函数名称

函数的名称,例如<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">search_hotels</font>。函数名必须是1到64个由小写字母、大写字母、数字、下划线或破折号组成的字符,不能使用其它字符。

用正则表示为:<font style="color:rgb(102, 102, 102);background-color:rgb(245, 245, 245);">^[a-zA-Z0-9_-]{1,64}$</font>

##### 6.2 函数描述

介绍这个函数的作用,注意这里介绍得越清晰详细,AI 就越清楚该如何使用这个函数,那么返回的输出也就越准确。

6.3 函数参数

通过点击<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">添加参数</font>可以添加多个函数参数。AI 在返回时会按照你设定好的参数格式、信息返回。

- 参数名称

- 参数的名称,例如

<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">location</font>。 - 参数描述

- 参数的描述,例如

<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">酒店的点(如北京、上海)</font>。 - 参数类型 - string - number - integer - object - array - boolean - null

7. 函数调用方式

默认情况下,调用方式为<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">auto</font>,即由 AI 自动判断是否需要调用函数。如果选择<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">none</font>则表示不使用函数调用。也可以指定选择某个函数名称,表示只调用该函数。

我们的建议是,既然已经明确要使用函数调用,那么就直接指定函数名称,这样能够获得比较确定的输出。

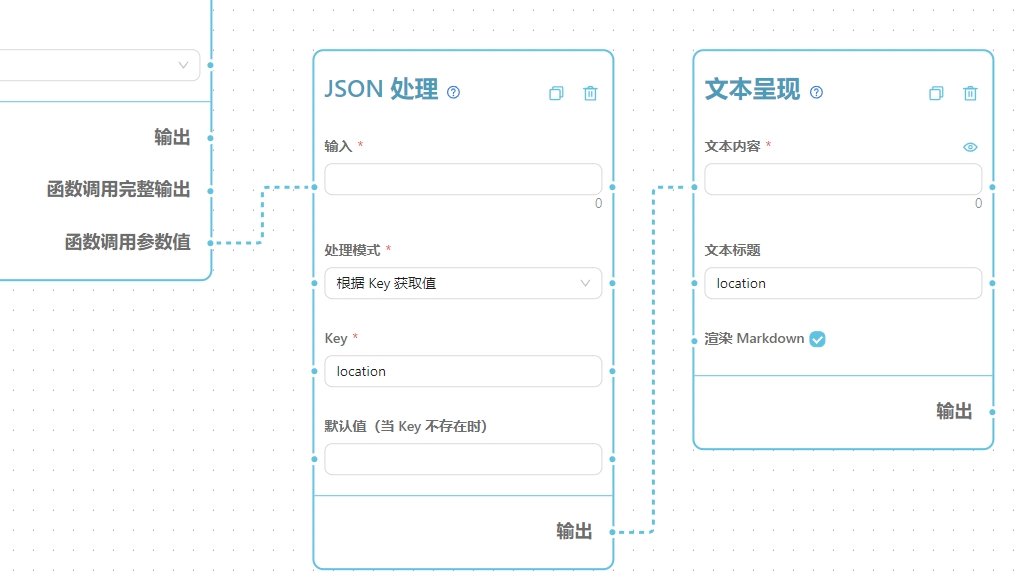

输出类型

<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">字符串</font> | <font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">列表</font>

函数调用完整输出

包含了函数名以及函数参数的完整输出,例如:

json{"name": "search_hotels","arguments": {"features": "海滨,免费早餐","location": "珠海","max_price": 300}}

函数调用参数值

为了方便后续使用,我们也直接提供了完整输出中的参数值,例如:因此可以在后续直接连接 JSON 处理节点,例如:

json{"features": "海滨,免费早餐","location": "珠海","max_price": 300}

积分消耗

单位:每 1000 Tokens| 模型 | 输入 | 输出 |

|---|---|---|

| gpt-35-turbo | 5 积分 | 10 积分 |

| gpt-4-128k | 50 积分 | 150 积分 |

| gpt-4o | 25 积分 | 75 积分 |

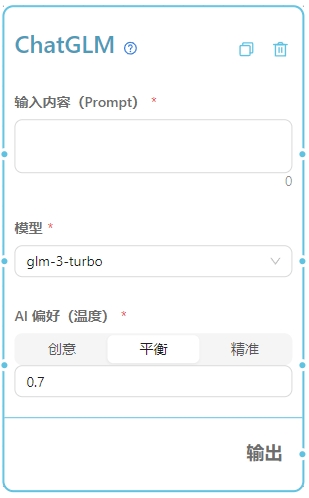

ChatGLM

参数详解

1. 输入内容 ( Prompt )

支持列表输入 指示 AI 语言模型生成内容的提示词。2. 模型

- glm-3-turbo - 上下文长度:128k - 适用于对知识量、推理能力、创造力要求较高的场景,比如广告文案、小说写作、知识类写作、代码生成等。

- glm-4 - 上下文长度:128k - 发布于20240116的最智能版本模型,目前已被 GLM-4-0520 版本超越。

- glm-4-0520 - 上下文长度:128k - 智谱当前的最先进最智能的模型,指令遵从能力大幅提升18.6%,发布于20240605。

- glm-4-air - 上下文长度:128k - 性价比最高的版本,综合性能接近GLM-4,速度快,价格实惠。

- glm-4-airx - 上下文长度:128k - GLM-4-Air 的高性能版本,效果不变,推理速度达到其2.6倍。

- glm-4-flash - 上下文长度:128k - 适用简单任务,速度最快,价格最实惠的版本。

3. AI 偏好 ( 温度 )

数值为 0~1 之间的小数 ( 不能等于 0 ) ,数值越大则生成的内容越随机。 当您需要非常精确、准确、可控的内容时,建议将该数值设置小一些。输出类型

<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">字符串</font> | <font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">列表</font>

积分消耗

单位:每 1000 Tokens| 模型 | 输入 + 输出 |

|---|---|

| glm-3-turbo | 0.7 积分 |

| glm-4 | 70 积分 |

| glm-4-0520 | 70 积分 |

| glm-4-air | 0.7 积分 |

| glm-4-airx | 7 积分 |

| glm-4-flash | 0.07 积分 |

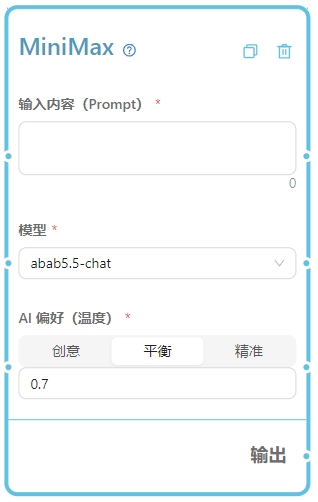

MiniMax

参数详解

1. 输入内容 ( Prompt )

支持列表输入 指示 AI 语言模型生成内容的提示词。2. 模型

- abab5.5-chat - 16k 上下文长度

- abab6-chat - 32k 上下文长度

- abab6.5s-chat - 245k 上下文长度

3. AI 偏好 ( 温度 )

数值为 0~1 之间的小数 ( 不能等于 0 ) ,数值越大则生成的内容越随机。 当您需要非常精确、准确、可控的内容时,建议将该数值设置小一些。输出类型

<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">字符串</font> | <font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">列表</font>

积分消耗

单位:每 1000 Tokens| 模型 | 输入 + 输出 | 优惠期 |

|---|---|---|

| abab5.5-chat | 10 积分 | 1 积分 |

| abab6-chat | 70 积分 | 1 积分 |

| abab6.5s-chat | 70 积分 | 1 积分 |

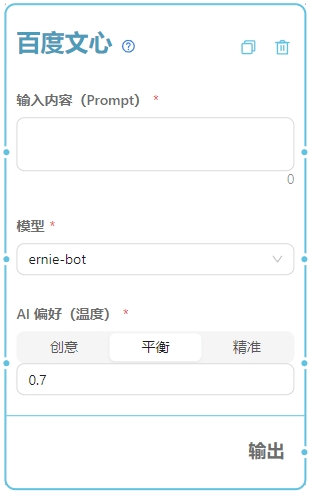

百度文心

参数详解

1. 输入内容 ( Prompt )

支持列表输入 指示 AI 语言模型生成内容的提示词。2. 模型

- ernie-speed - 输入 不超过 516096 个字符,且不能超过 126976 tokens - 输出 4k tokens

- ernie-lite - 输入 不超过 24000 个字符,且不能超过 6144 tokens - 输出 2k tokens

- ernie-3.5 - 输入 不超过 20000 个字符,且不能超过 5120 tokens - 输出 2k tokens

- ernie-4.0 - 输入 不超过 20000 个字符,且不能超过 5120 tokens - 输出 2k tokens

3. AI 偏好 ( 温度 )

数值为 0~1 之间的小数 ( 不能等于 0 ) ,数值越大则生成的内容越随机。 当您需要非常精确、准确、可控的内容时,建议将该数值设置小一些。输出类型

<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">字符串</font> | <font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">列表</font>

积分消耗

单位:每 1000 Tokens| 模型 | 输入 | 输出 |

|---|---|---|

| ernie-speed | 0 积分 | 0 积分 |

| ernie-lite | 0 积分 | 0 积分 |

| ernie-3.5 | 9 积分 | 9 积分 |

| ernie-4.0 | 85 积分 | 85 积分 |

阿里云通义千问

参数详解

1. 输入内容 ( Prompt )

支持列表输入 指示 AI 语言模型生成内容的提示词。2. 模型

- qwen1.5-7b-chat - 支持 32k tokens 上下文

- qwen1.5-14b-chat - 支持 32k tokens 上下文

- qwen1.5-32b-chat - 支持 32k tokens 上下文

- qwen1.5-72b-chat - 支持 32k tokens 上下文

- qwen1.5-110b-chat - 支持 32k tokens 上下文

- qwen2-72b-instruct - 支持 32k tokens 上下文

输出类型

<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">字符串</font> | <font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">列表</font>

积分消耗

单位:每 1000 Tokens| 模型 | 输入 + 输出 |

|---|---|

| qwen1.5-7b-chat | 1 积分 |

| qwen1.5-14b-chat | 1.5 积分 |

| qwen1.5-32b-chat | 4 积分 |

| qwen1.5-72b-chat | 4.5 积分 |

| qwen1.5-110b-chat | 9 积分 |

| qwen2-72b-instruct | 4.5 积分 |

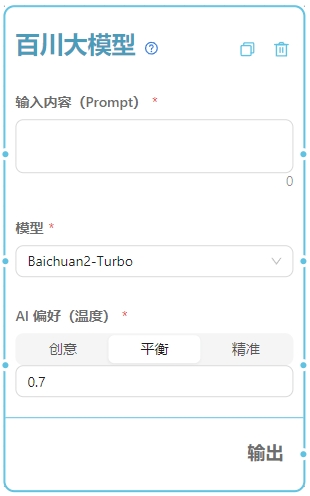

百川大模型

参数详解

1. 输入内容 ( Prompt )

支持列表输入 指示 AI 语言模型生成内容的提示词。2. 模型

- Baichuan2-53B - 可接受 2k 长度上下文

- Baichuan2-Turbo - 可接受 32k 长度上下文

- Baichuan2-Turbo-192k - 可接受 192k 长度上下文

- Baichuan3-Turbo - 可接受 32k 长度上下文

- Baichuan3-Turbo-128k - 可接受 128k 长度上下文

- Baichuan4 - 可接受 32k 长度上下文

3. AI 偏好 ( 温度 )

数值为 0~1 之间的小数,数值越大则生成的内容越随机。 当您需要非常精确、准确、可控的内容时,建议将该数值设置小一些。输出类型

<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">字符串</font> | <font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">列表</font>

积分消耗

单位:每 1000 Tokens| 模型 | 输入 + 输出 |

|---|---|

| Baichuan4 | 70 积分 |

| Baichuan3-Turbo | 8.5 积分 |

| Baichuan3-Turbo-128k | 17 积分 |

| Baichuan2-Turbo | 6 积分 |

| Baichuan2-Turbo-192k | 12 积分 |

| Baichuan2-53B | 15 积分 |

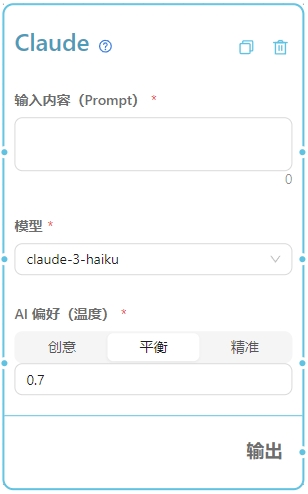

Claude

参数详解

1. 输入内容 ( Prompt )

支持列表输入 指示 AI 语言模型生成内容的提示词。2. 模型

- claude-3-opus - 新模型,质量最佳,价格最高 - 可接受 200K 输入,最大 4K 输出

- claude-3-sonnet - 新模型,速度、质量、价格最均衡 - 可接受 200K 输入,最大 4K 输出

- claude-3-haiku - 新模型,速度最快,价格最低 - 可接受 200K 输入,最大 4K 输出

- claude-2 - 旧模型,表现不如 claude-3 系列 - 可接受 200K 输入,最大 4K 输出

- claude-instant-1 - 旧模型,表现不如 claude-3 系列 - 可接受 100K 输入,最大 4K 输出

3. AI 偏好 ( 温度 )

数值为 0~1 之间的小数,数值越大则生成的内容越随机。 当您需要非常精确、准确、可控的内容时,建议将该数值设置小一些。输出类型

<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">字符串</font> | <font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">列表</font>

积分消耗

单位:每 1000 Tokens| 模型 | 输入 | 输出 |

|---|---|---|

| claude-3-opus | 75 积分 | 375 积分 |

| claude-3-sonnet | 15 积分 | 75 积分 |

| claude-3-haiku | 1.25 积分 | 6.25 积分 |

| claude-2.1 | 40 积分 | 120 积分 |

| claude-instant-1 | 8.15 积分 | 27.55 积分 |

Gemini

参数详解

1. 输入内容 ( Prompt )

支持列表输入 指示 AI 语言模型生成内容的提示词。2. 模型

- gemini-1.0-pro - 可接受 30k 输入,最大 2k 输出

- gemini-1.5-pro - 可接受 1M 输入,最大 8k 输出

- gemini-1.5-flash - 可接受 1M 输入,最大 8k 输出

3. AI 偏好 ( 温度 )

数值为 0~1 之间的小数,数值越大则生成的内容越随机。 当您需要非常精确、准确、可控的内容时,建议将该数值设置小一些。输出类型

<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">字符串</font> | <font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">列表</font>

积分消耗

测试期间按最低消耗计算,正式上线后可能会有所调整。 单位:每 1000 Tokens| 模型 | 输入 | 输出 |

|---|---|---|

| gemini-1.0-pro | 2.5 积分 | 7.5 积分 |

| gemini-1.5-pro | 0.5 积分 | 0.5 积分 |

| gemini-1.5-flash(输入长度<=128k) | 1.75 积分 | 5.25 积分 |

| gemini-1.5-flash(输入长度>128k) | 3.5 积分 | 10.5 积分 |

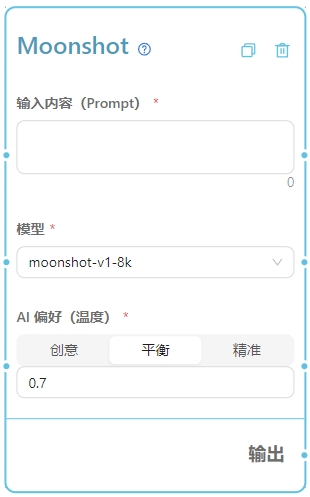

Moonshot

参数详解

1. 输入内容 ( Prompt )

支持列表输入 指示 AI 语言模型生成内容的提示词。2. 模型

- moonshot-v1-8k - 最大输入+输出总长度是 8k

- moonshot-v1-32k - 最大输入+输出总长度是 32k

- moonshot-v1-128k - 最大输入+输出总长度是 128k

3. AI 偏好 ( 温度 )

数值为 0~1 之间的小数,数值越大则生成的内容越随机。 当您需要非常精确、准确、可控的内容时,建议将该数值设置小一些。输出类型

<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">字符串</font> | <font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">列表</font>

积分消耗

单位:每 1000 Tokens| 模型 | 输入 + 输出 |

|---|---|

| moonshot-v1-8k | 8 积分 |

| moonshot-v1-32k | 16 积分 |

| moonshot-v1-128k | 40 积分 |

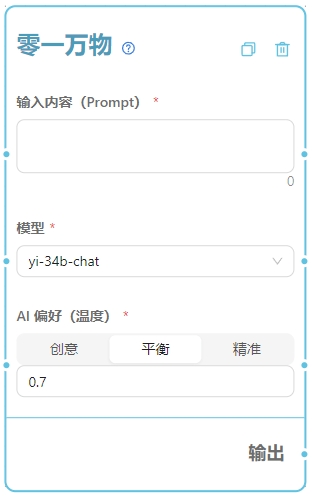

Yi

参数详解

1. 输入内容 ( Prompt )

支持列表输入 指示 AI 语言模型生成内容的提示词。2. 模型

| 模型 | 上下文长度 |

|---|---|

| yi-large | 16K |

| yi-large-turbo | 16K |

| yi-medium | 16K |

| yi-medium-200k | 200K |

| yi-spark | 16K |

| yi-34b-chat | 4K |

| yi-34b-chat-200k | 200K |

3. AI 偏好 ( 温度 )

数值为 0~1 之间的小数,数值越大则生成的内容越随机。 当您需要非常精确、准确、可控的内容时,建议将该数值设置小一些。输出类型

<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">字符串</font> | <font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">列表</font>

积分消耗

单位:每 1000 Tokens| 模型 | 输入 + 输出 | 备注 |

|---|---|---|

| yi-large | 14 积分 | |

| yi-large-turbo | 8.5 积分 | |

| yi-medium | 1.8 积分 | |

| yi-medium-200k | 8.5 积分 | |

| yi-spark | 0.7 积分 | |

| yi-34b-chat | 1.8 积分 | 已弃用 |

| yi-34b-chat-200k | 8 积分 | 已弃用 |

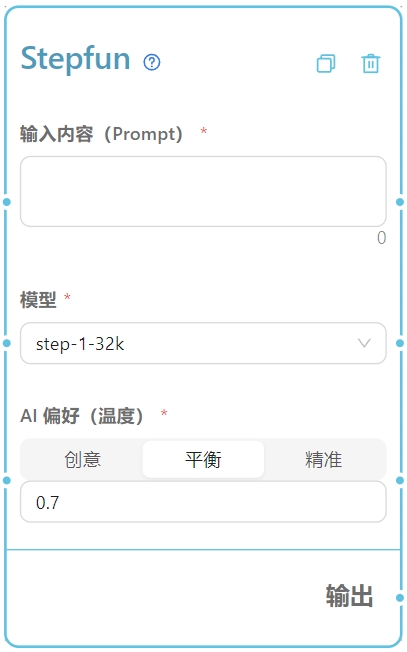

Stepfun

参数详解

1. 输入内容 ( Prompt )

支持列表输入 指示 AI 语言模型生成内容的提示词。2. 模型

- step-1-32k - 最大输入+输出总长度是 32k

- step-1-200k - 最大输入+输出总长度是 200k

3. AI 偏好 ( 温度 )

数值为 0~1 之间的小数,数值越大则生成的内容越随机。 当您需要非常精确、准确、可控的内容时,建议将该数值设置小一些。输出类型

<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">字符串</font> | <font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">列表</font>

积分消耗

单位:每 1000 Tokens| 模型 | 输入 + 输出 |

|---|---|

| step-1-32k | 16 积分 |

| step-1-200k | 100 积分 |

DeepSeek

参数详解

1. 输入内容 ( Prompt )

支持列表输入 指示 AI 语言模型生成内容的提示词。2. 模型

- deepseek-chat - 最大输入+输出总长度是 128k

- deepseek-coder - 最大输入+输出总长度是 128k

3. AI 偏好 ( 温度 )

数值为 0~1 之间的小数,数值越大则生成的内容越随机。 当您需要非常精确、准确、可控的内容时,建议将该数值设置小一些。输出类型

<font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">字符串</font> | <font style="color:rgb(31, 35, 40);background-color:rgb(245, 245, 245);">列表</font>

积分消耗

单位:每 1000 Tokens| 模型 | 输入 | 输出 |

|---|---|---|

| deepseek-chat | 0.7 积分 | 1.4 积分 |

| deepseek-coder | 0.7 积分 | 1.4 积分 |