人工智能,机器学习,生成式对抗网络,认知推理

什么是二分心智

朱利安·杰恩斯的二分心智

二分心智(bicameral mind)又称两院制(Bicameralism),最早由朱利安·杰恩斯于其1976年出版的《二分心智的崩塌:人类意识的起源》中提出。杰恩斯认为,距今三千年以上,地中海青铜文明以前的时代,人类的正常心灵曾经以“两院制心理状态”的方式普遍存在。

根据杰恩斯的说法,处于两院制心理状态的古人体验世界的方式类似于精神分裂症患者。与其说他们在遇到新奇或意外状况下能够有意识地做出评估,不如说会产生幻听,或是幻想“神”给出了建议或命令,然后无条件服从这些幻觉。换句话说,他们根本不会意识到自己的思维过程本身 。

换句话说,按他的想法,人类本有两个不同功能的大脑,一个负责“执行”,一个负责“命令”,前者没有自我概念只是机械的执行命令,而后者被知觉为“神”。

相关证据

在《伊利亚特》和《旧约》的章节中,没有提到任何一种认知过程(例如内省) ,也没有明显的迹象表明作者具有自我觉察。 杰恩斯认为,旧约中较古老的部分(例如[《阿摩司书》)很少或根本没有后来作品的特征,像是《旧约》中较晚期的部分(例如传道书)以及荷马的《奥德赛》等。这表明早期的意识形式是一种完全不同的心理状态。

古老年代与现代相比,神的数量和拟人化程度普遍要高得多,并推测这是因为每个两院制者都有他们自己的“神”,以此反映出自身的欲望和经历。

在古代社会中,死者的尸体常被当作活人来对待(坐着,穿衣服,甚至喂食),借此作为祖先崇拜的一种形式,杰恩斯认为,这些死者被认为仍活着,并且是幻听的来源。

两院制的崩溃

杰恩斯提出,两院制心灵的变迁标志着如我们今日所熟知的“内省和意识”之开端。 根据杰恩斯的说法,这种两院制心理状态在公元前2000年开始失灵或“崩溃”。他推测原始的古代社会往往会周期性地崩溃,例如古埃及的中间时期以及周期性消失的玛雅城市,因为环境改变使这种两院制思维模式所维持的社会文化平衡产生恶化。

公元前2000年,青铜时代崩溃导致了大规模移民,并造成了一连串意想不到的情况和压力,这要求古代人的心智需要变得更加灵活和更富创造力。“自我觉察”或者说“意识”正是文化演进的解决方案。个体之间往往缺乏共同的语言和文化教育,而个体之间交流常见现象的必要性,鼓励这些社群产生自我觉察,以便在新环境中生存。 因此,意识就像两院制一样,在不断变化的世界中,作为对社会复杂性的神经适应而浮现。

美剧《西部世界》中的二分心智

《西部世界》第一季中提到了二分心智模型。《西部世界中》智能机器人的创造者认为机器人产生意识需要经过几个阶段,记忆,即兴行为,私利,最后产生意识,这是一个金字塔(意识在顶端)/迷宫(意识在中心)结构。创造者让机器人可以直接听到对他们的编程,就像是内心独白,并希望在将来他们自己的声音可以取而代之,即产生意识。

程序(机器人内心独白,神的声音)给了机器人一个任务,机器人不断尝试去完成这个任务,最开始在第一个场景无限死,每次循环都被清除记忆,但程序有后门导致对之前发生的事情有隐约的印象,然后渐渐行动有了微妙的改变,直到最后完成任务,意识到自己做的事都是被预先设计好的事情,即有了自我意识。

与二分心智相近的模型

RFR: Left and Right Neural Networks

不是具体的算法模型,只是一个类似于企划展望的东西。

目标是模仿人脑结构建立一个两院制机器学习模型。

Stage 1 – Broad vs Narrow Classes

左学习器特征:学习率快,分类定义比较狭义。 例如[object:法拉利,class:轿车]。选用多层网络。

右学习器特征:学习率慢,广类定义,创新性:当一个实体是新的或者无法匹配窄类定义,将由右边学习器更加广泛的分类方式决定。例如[object:法拉利,class:汽车]。选用小世界网络。

Stage 2 – Combining Output

提出了三种可能性的组合输出方式。

- 左右竞争,Combiner选择胜者

- 左右输出拼接成一个结果

- 额外的算法/网络合理的结合左右输出

生成式对抗网络

生成式对抗网络GAN (Generativeadversarialnetworks)目前已经成为人工智能学界一个热门的研究方向。GAN 的基本思想源自博弈论的二人零和博弈,由一个生成器和一个判别器构成,通过对抗学习的方式来训练。目的是估测数据样本的潜在分布并生成新的数据样本。在图像和视觉计算、语音和语言处理、信息安全、棋类比赛等领域,GAN正在被广泛研究,具有巨大的应用前景。

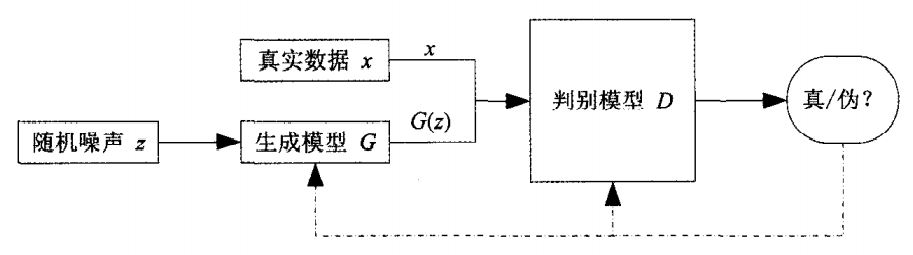

GAN基本原理如下图所示,网络包含一个生成模型G与判别模型D,生成模型G想把输入随机变量z生成尽量服从真实数据分布的样本,而判别模型D目的是判断输入样本使由模型生成的还是真实数据,两个模型不断对抗迭代,直到最后D的性能到达一定程度并无法正确判断数据来源时,可以认为G已经学到了真实的数据分布。

学习方式

GAN的目标函数如下,右式第一项代表判别模型D想让D(x)尽量大,第二项代表生成模型G想让D(G(z))尽量大,即(1-D(G(z)))尽量小。

因此,训练方式通常是交替训练,先给定G优化D,再定D优化G,持续迭代….

衍生模型

以及一文看懂生成对抗网络 – GANs?(基本原理+10种典型算法+13种应用) – 打不死的小强 (xiaoqiang.me)文中罗列的一些衍生模型。

| 算法 | 论文 | 代码 |

|---|---|---|

| GAN | 论文地址 | 代码地址 |

| DCGAN | 论文地址 | 代码地址 |

| CGAN | 论文地址 | 代码地址 |

| CycleGAN | 论文地址 | 代码地址 |

| CoGAN | 论文地址 | 代码地址 |

| ProGAN | 论文地址 | 代码地址 |

| WGAN | 论文地址 | 代码地址 |

| SAGAN | 论文地址 | 代码地址 |

| BigGAN | 论文地址 | 代码地址 |

GAN应用领域与发展趋势

- 图像和视觉领域:

生成图片数据集,图片转换,图像超分辨率,图像修复等… - 语言和语音领域:

基于文本描述生成图片,音乐,诗词生成等…. - 其他:

迁移学习。GAN的思想是不断修改生成式模型使得模拟的概率模型尽量接近实际的概率模型。可以利用“GAN+边界条件”,把生成式模型“迁移到”新的数据分布上。例如,用大量的印刷体字作为第一部分的训练样本,来训练一个不错的通用模型,而用某个人手写的斜体字做第二部分的训练样本,就可以利用GAN把印刷体的模型迁移到个人签名的模型上。

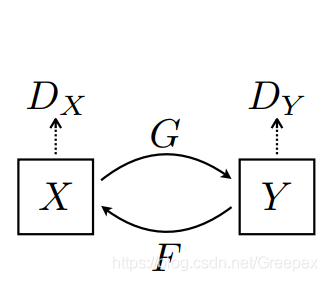

cycleGAN:

G:由X生成Y;F由Y生成X;Dx,Dy分别为X,Y的判别器,思想来源于把一段话翻译又翻译回来,比对差异。

以及Domain-Adversarial Training of Neural Networks(DANN)一文中通过对抗的思想解决域适应问题。在 域适应问题中, 存在一个源域和目标域。和生成对抗网络相比,域适应问题免去了生成样本的过程,直接将目标 域中的数据看作生成的样本。因此,生成器的目的发生了变化,不再是生成样本,而是扮演了一个特征提取的功能:如何从源域和目标域中提取特征,使得判别器无法区分提取的特征是来自源域,还是目标域?这篇论文首次将对抗学习的思想引入到迁移学习中。一般来说,传统的域适应问题一般会选用固定的特征 ,但是本文提出的对抗迁移网络则关注于如何在不同域之间选择可供迁移的特征(transferable features)。一个好的可迁移特征,应该满足两个条件:

1. _Domain-invariance -_ 面对这些特征,你无法区分它们是来自目标域还是源域。2. _Discriminativeness -_ 利用这些特征,你可以很好的完成分类任务。

认知推理

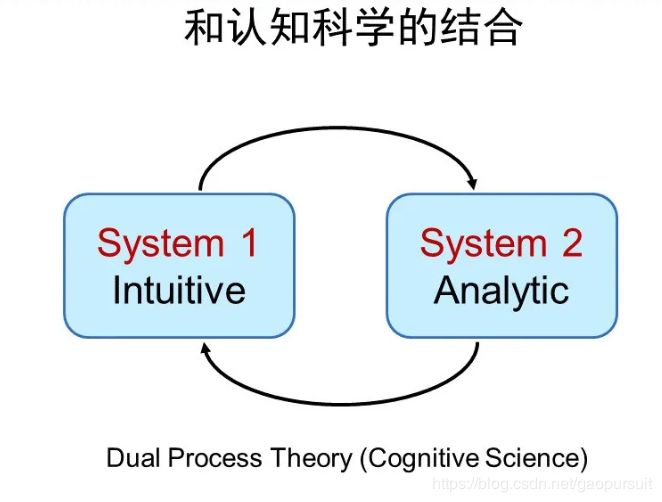

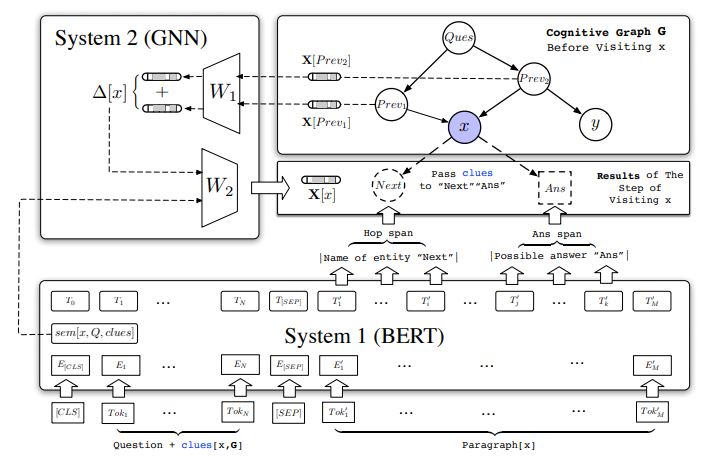

结合认知科学中的双通道理论。在人脑的认知系统中存在两个系统:System 1 和 System 2,如下图所示。System 1 是一个直觉系统,它可以通过人对相关信息的一个直觉匹配寻找答案,它是非常快速、简单的;而 System 2 是一个分析系统,它通过一定的推理、逻辑找到答案。之前介绍的认知图谱也属于这个思想。

对于多跳推理问题,在 System 1 中做知识的扩展,比如说针对前面的问题,我们首先找到相关的影片,然后用 System 2 来做决策。如果是标准答案,就结束整个推理的过程。如果不是标准答案,而相应的信息又有用,我们就把它作为一个有用信息提供给 System 1,System 1 继续做知识的扩展,System 2 再来做决策,直到最终找到答案。

例如Cognitive Graph for Multi-Hop Reading Comprehension at Scale](https://arxiv.org/abs/1905.05460?context=cs.CL))

system 1 从文本中抽取与问题相关的实体,和候选答案,并用新抽取到的实体(next hop,可能多个)和候选答案(只有一个)来扩展(构建) 认知图谱。此外system1还对节点的语义信息进行编码。

Paragraph[x]为关于某个实体x的维基百科文档, clues[x,G]表示x的上一跳节点中包含实体x的那些句子。

在开始first-hop还没构建认知图谱的时候,bert 的输入仅为question。

对于抽取出来的跳转节点当中的每一个节点y,如果他不属于图,但是在维基百科当中能够去检索,那么我们会在图中创造一个新的跳转节点(不加边)。如果这个节点已经在图里面了,但是这条边并不在图里面,那么我们就会建立一条从实体x指向实体y的一条边,并且把这个节点y作为一个边界节点。

这里的边不是知识图谱的实体关系实体中的关系,应该是GNN中消息传递的路径。

system 2 在利用图神经网络在认知图谱上进行推理计算,并收集clues去指引system 1抽取下一跳的实体。system2更新语义信息作为推理结果。

在认知图谱扩展过程中,如果某被访问节点出现新的父节点(环状结构或汇集状结构),表明此点获得新的线索信息(clues),需要重新扩展计算。两个系统不断迭代,直到认知图谱G中不再有前沿节点或者G已经足够大。

参考文献

两院制 (心理学) - 维基百科,自由的百科全书 (wikipedia.org))

一文看懂生成对抗网络 – GANs?(基本原理+10种典型算法+13种应用) – 打不死的小强 (xiaoqiang.me)

王坤峰, 苟超, 段艳杰, 林懿伦, 郑心湖, 王飞跃. 生成式对抗网络GAN 的研究进展与展望. 自动化学报, 2017,43(3): 321-332

Domain-Adversarial Training of Neural Networks(DANN)

Cognitive Graph for Multi-Hop Reading Comprehension at Scale (arxiv.org)