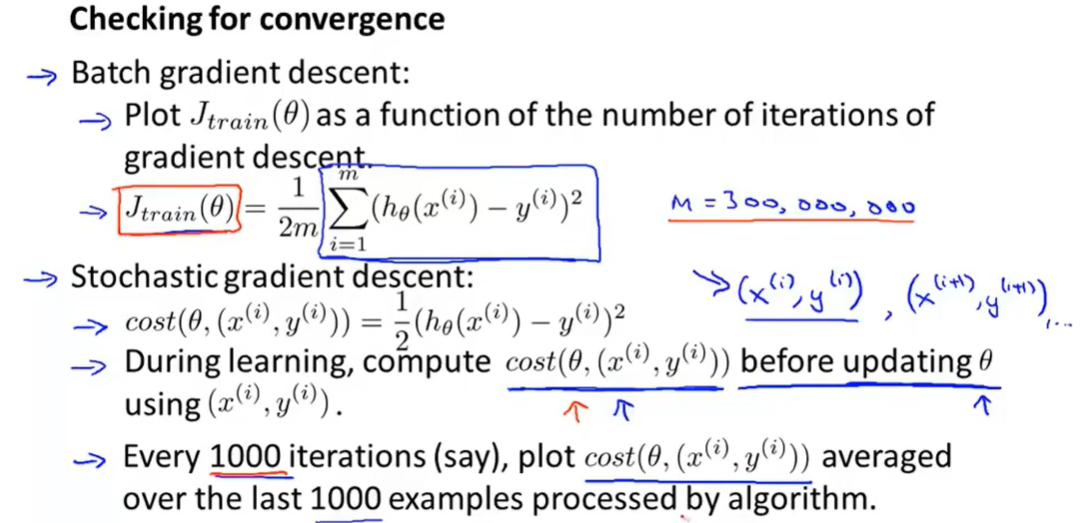

- 在批量梯度下降算法中,验证算法收敛的方法是绘制代价函数的大小随迭代过程的变化

- 这个过程,每次都要遍历整个样本集计算代价函数,带来过大运算量

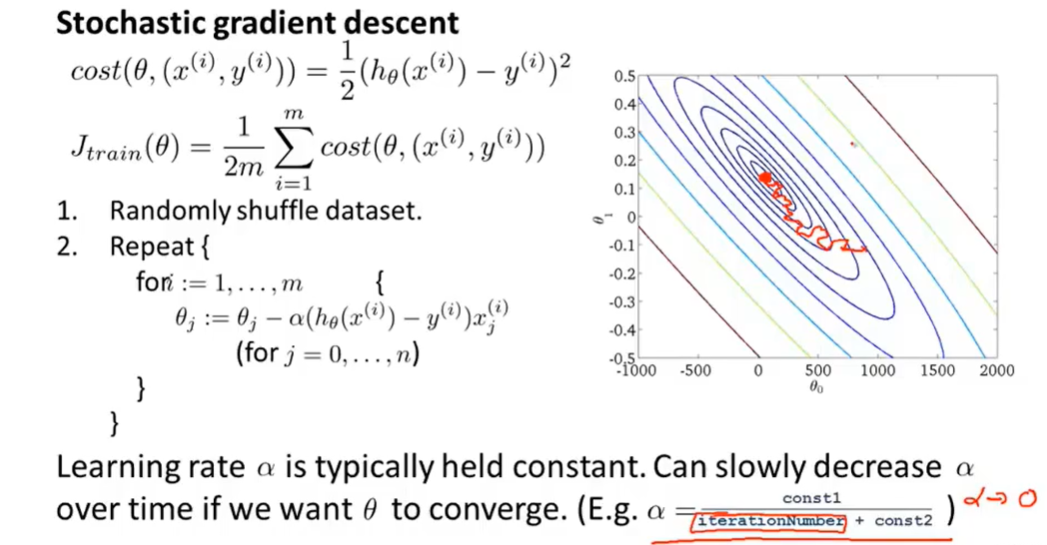

- 随机梯度下降,在使用单个样本点更新模型参数之前,计算这一个样本下的代价函数

- 每计算了1000个样本点。将这些点的代价函数求平均

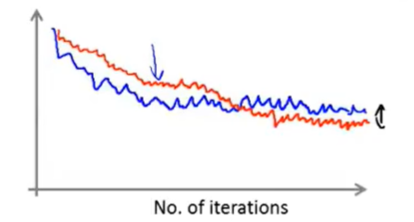

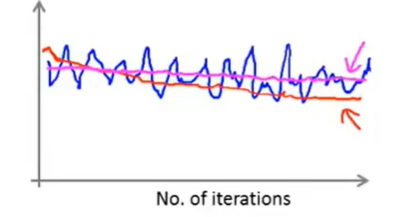

- 红线减小了学习率,下降速度更慢,但会比原来收敛到一个更好的数值

- 红线加大了检查收敛每次使用的样本点数,曲线更平滑,但接收检查反馈回存在更大延迟

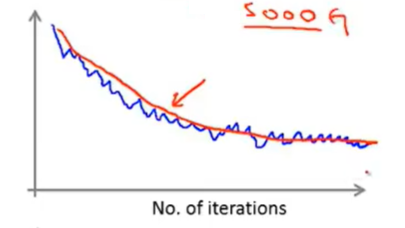

- 如果波动大,没有下降趋势,可能是噪声过大,但是加大了检查收敛每次使用的样本点数后(红线),会观察到下降趋势

- 如果即使加大了检查收敛每次使用的样本点数也没有下降趋势(粉线),就说明需要调整学习率,特征等参数

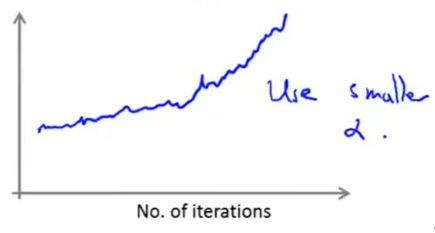

- 算法发散,需要使用更小的学习率

- 如果想要求得最终更为精确的局部最小值,而不是一个徘徊区域

- 可以选用动态学习率,随着时间,学习率逐渐减小