本文基本摘自参考文章.

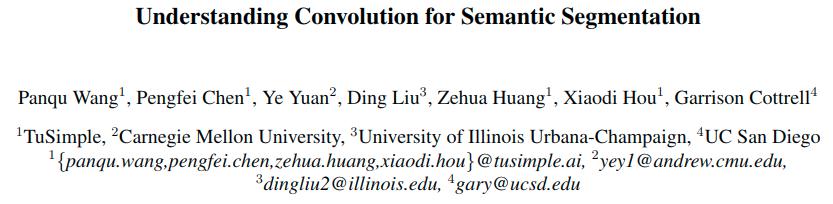

Dense Upsampling Convolution

针对这一问题,DUC将F_{out}的尺寸(h,w,c)通道转为到(h, w, d^2×L), L是分割类别数目。再reshape到label map大小(H,W,L)。reshape操作代替了解卷积上采样,可直接对接label map。

类似亚像素卷积. DUC以原始分辨率像素级解码,并且能够自然的集成到FCN框架中,使得整个编码和解码能以end2end方式训练。

Hybrid Dilated Convolution

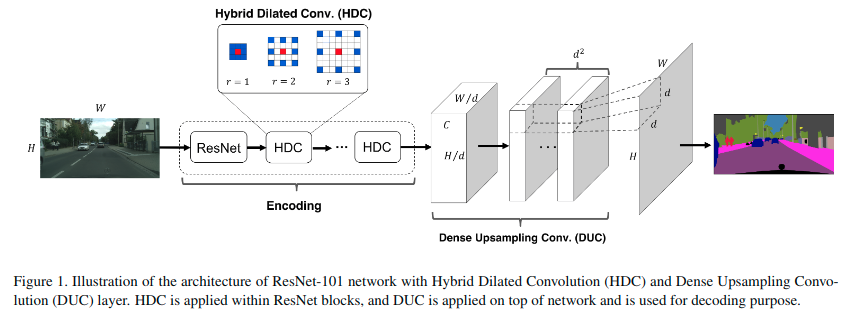

扩张卷积可增加features map的分辨率,故可替换FCN架构中的池化层。但是,扩张卷积存在一个理论上的问题,称之为”gridding”:对于扩张卷积的一个像素点p,对其有贡献的是上一层以p为中心的kd×kd的邻近区域,因为扩张卷积引入0值,在kd×kd 区域只计算k×k 个像素点,非0像素点之间间隔为r−1. 如下图a.

可以看到top feature map使用扩张卷积只能以棋盘的形式查看信息,这会丢失大量信息. 当high layer中r变的越来越大,这会使得从输入中采样的数据越来越稀疏,不利于卷积学:

- 局部的信息完全丢失.

- 信息之间太远不相关.

- r×r的区域从完全不同的“网格”集合内接收信息,这会损害本地信息的一致性。

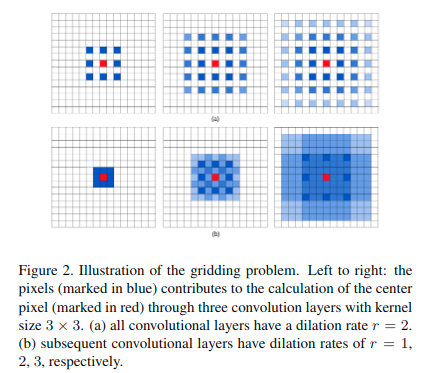

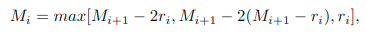

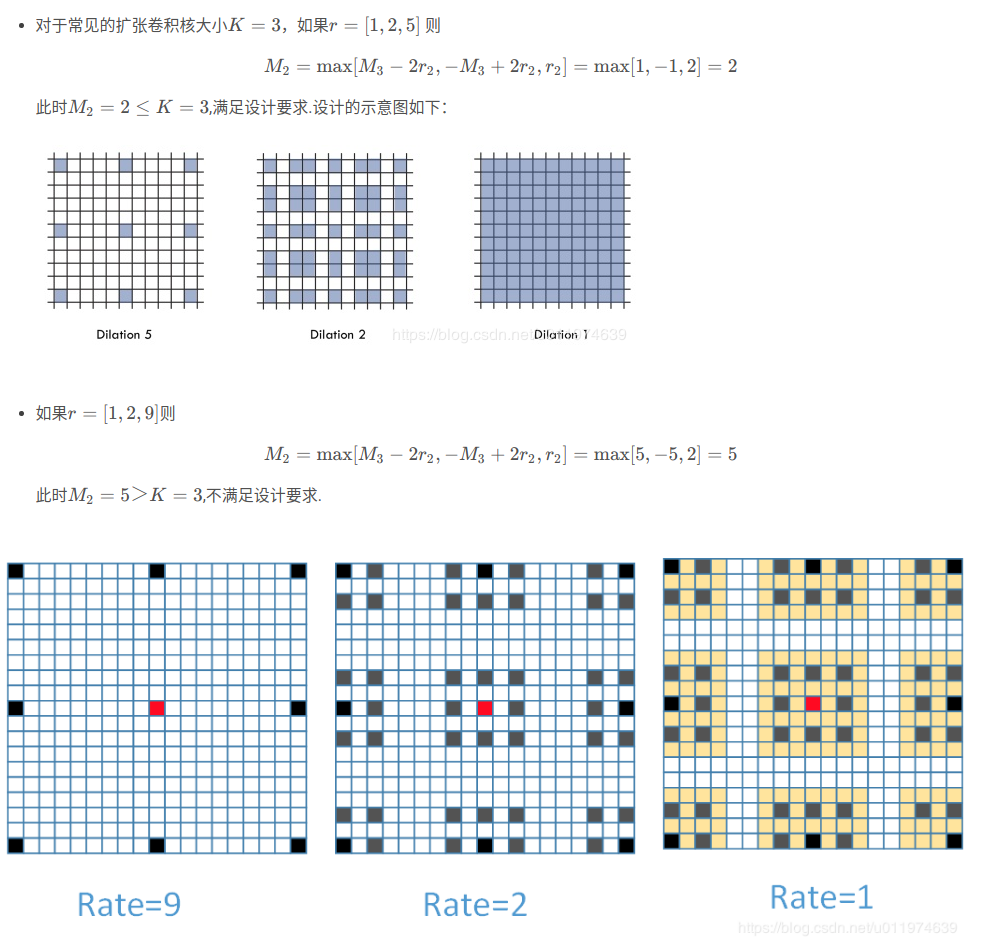

论文提出了HDC用于缓解”gridding”产生的影响:考虑到一个N个的size为K×K的扩张卷积,对应的扩张率为[r1, …, ri, .., rn],HDC的目标是让最后的接收野全覆盖整个区域(没有任何空洞或丢失边缘),我们定义两个非零点之间最大距离为:其中Mn=rn, 设计的目标是让M2≤K.

满足了要求之后, 既可以得到可以缓解这种影响的组合.

参考文章作者举了两个例子:

图片来自参考文章

论文给出使用不同扩张率的扩张卷积策略是锯齿波(sawtooth wave-like)变化形式:即取几层为一组,每个组的扩张率从低向高增加,每个组类似,即扩张率变换类似锯齿波。锯齿波能同时满足小物体大物体的分割要求(小rate提取本地信息,大rate提取长距离信息)。

例如:对于r=2的层,将3个层组成一组,对应的扩张率分别为1,2,3。这样顶层可以获取更宽阔的区域信息,这能在保持接收野大小不变的情况下提高信息利用率。

需要注意的是,一个组内的卷积不应该有一个固定的变换因子,即不要用大于1的公约数(例如2,4,8的公约数为2>1),否则依旧无法减小”girdding”效应。

HDC的另一个好处是可以使用任意的扩张率,很自然的扩大了接收野且不需要添加额外的模块,这对识别大型相关目标很关键。