- 数据形式

- 元素运算

- 矩阵运算

- 转置(Transpose)

- 重塑(Reshaping)

- 迹(Trace)

- 对角矩阵(Diag)

- 点乘(Dot product)

- 矩阵-向量乘法(Matrix-vector prodcut)

- 矩阵-矩阵乘法(Matrix-matrix product)

- 对称矩阵(Symmetric)

- 正定和半正定(Positve definite&semi-definite)">正定和半正定(Positve definite&semi-definite)

- 逆矩阵 非奇异矩阵

- 伪逆矩阵 一般化的逆矩阵

- 特征值和特征向量(Eigenvalues&Eigenvectors)">特征值和特征向量(Eigenvalues&Eigenvectors)

- 奇异值分解(SVD)">奇异值分解(SVD)

- Norms

- 张量运算

- Source

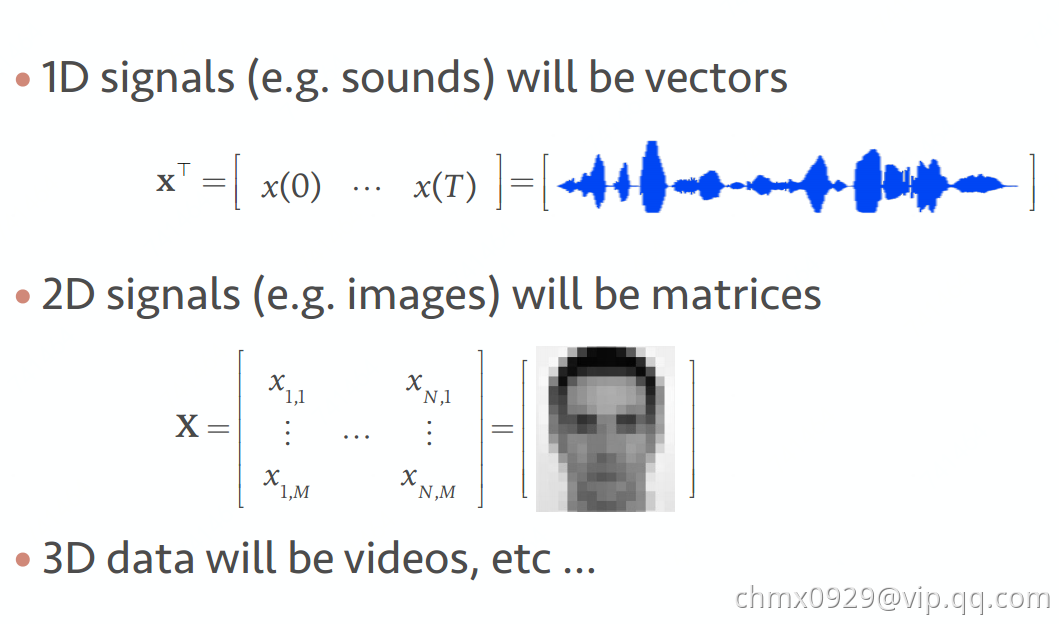

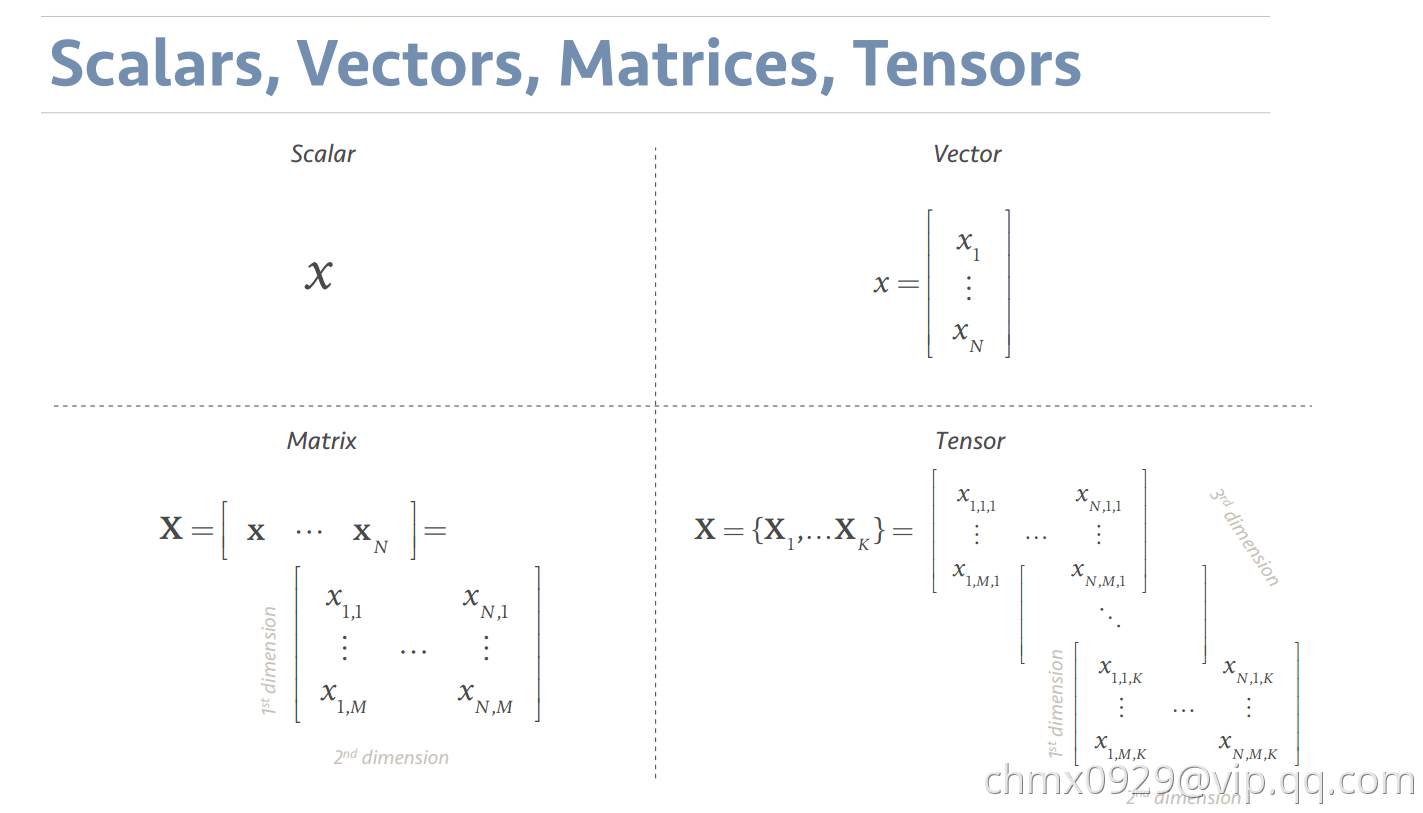

数据形式

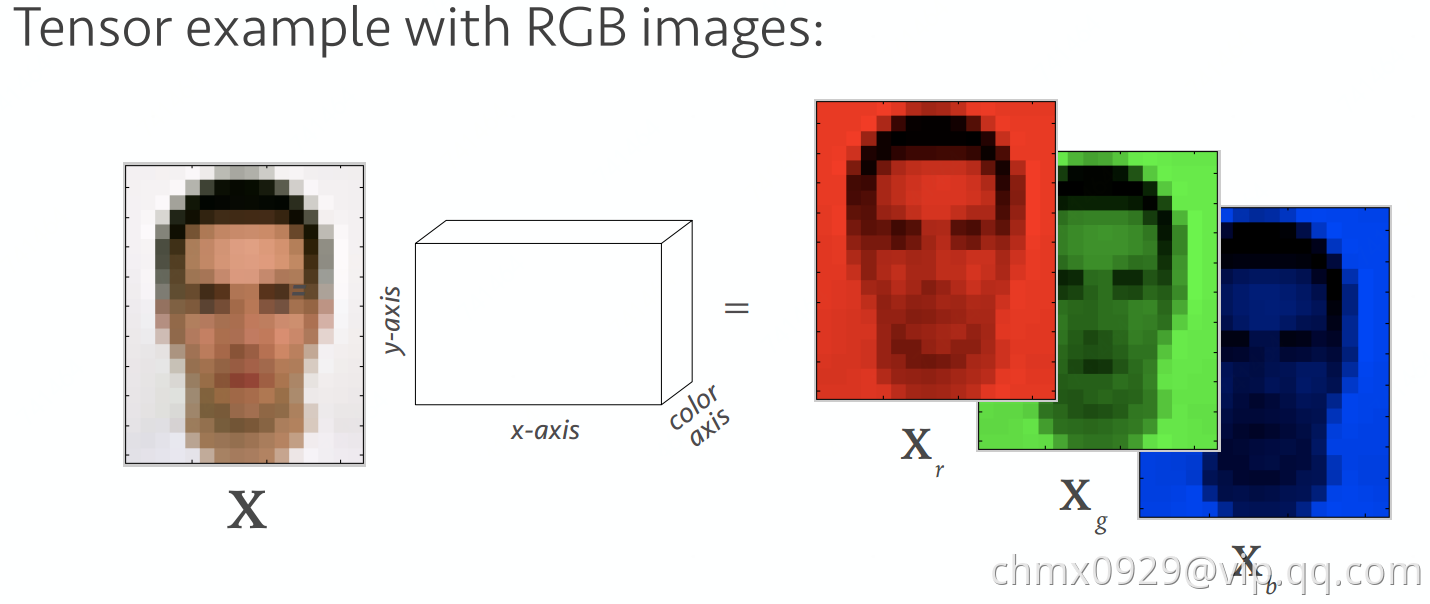

标量/向量/矩阵/张量

1D/2D/3D信号

元素运算

加/减(Addition/subtraction)

乘(Hadamard product)

或

或

除(Division)

将乘法反用

矩阵运算

转置(Transpose)

重塑(Reshaping)

vec:回滚回列级(相当于降维度,可帮助避开矩阵或张量)

vec-transpose: 重塑一个

重塑一个 的矩阵

的矩阵

迹(Trace)

矩阵主对角线元素之和

对角矩阵(Diag)

点乘(Dot product)

矩阵-向量乘法(Matrix-vector prodcut)

从点乘运算衍生来,矩阵 的列数必须与向量

的元素数一致

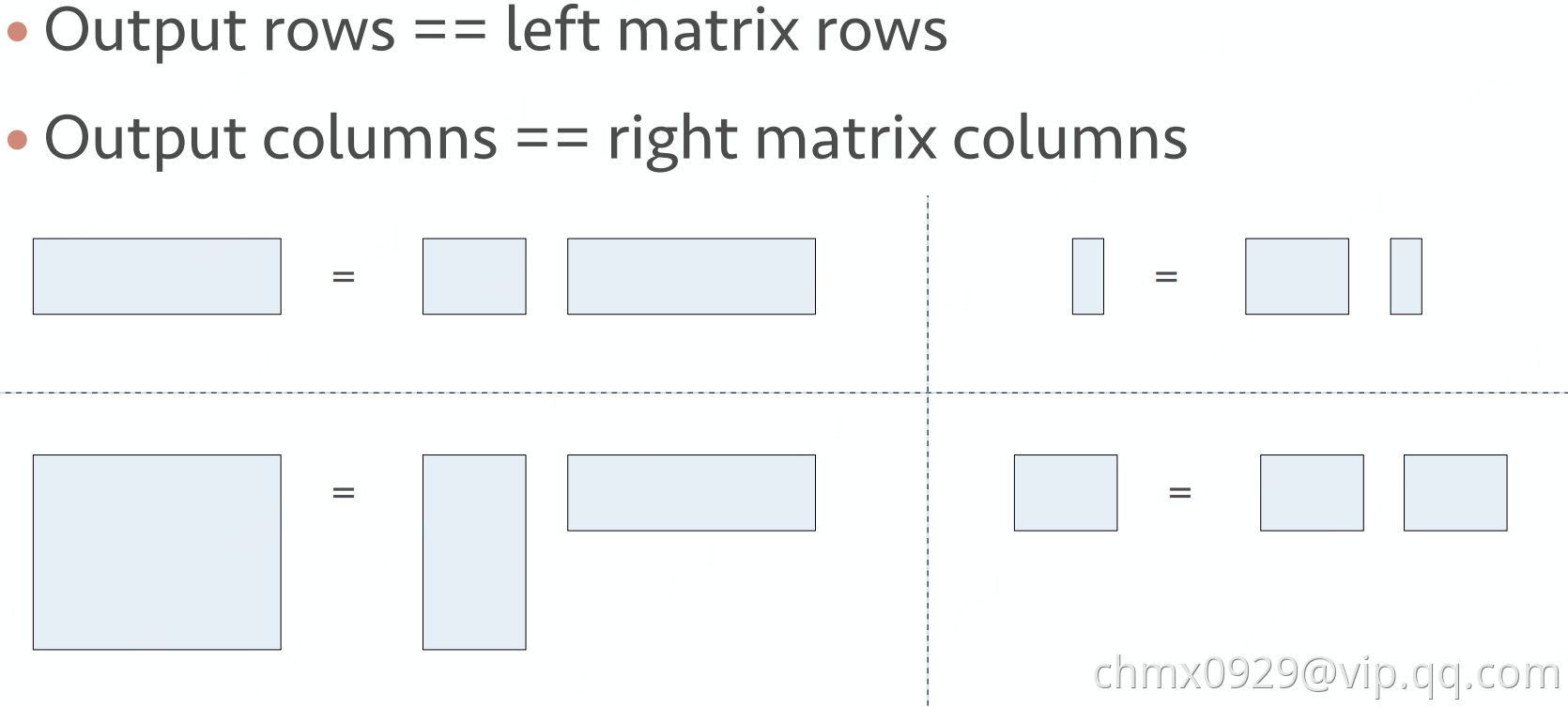

矩阵-矩阵乘法(Matrix-matrix product)

矩阵 的列数必须与矩阵

的行数一致,即

对称矩阵(Symmetric)

正定和半正定(Positve definite&semi-definite)

正定和半正定这两个词的英文分别是positive definite和positive semi-definite,其中,definite是一个形容词,表示“明确的、确定的”等意思。初学线性代数的读者可能会被这两个词“唬住”,但正定矩阵和半正定矩阵的定义实际上是很简单的 (不考虑复数构成的矩阵):

【定义1】给定一个的实对称矩阵(即矩阵内元素都是实数的对称矩阵)

,若对于任意长度为

的非零向量

,有

恒成立,则矩阵

是一个正定矩阵。

【定义2】给定一个的实对称矩阵(即矩阵内元素都是实数的对称矩阵)

,若对于任意长度为

的非零向量

,有

恒成立,则矩阵

是一个半正定矩阵。注意,正定要求是大于0,半正定可以等于0。

【例1】单位矩阵是否是正定矩阵?

解:设向量为非零向量,则

。由于

,故

恒成立,即单位矩阵

是正定矩阵。类推,对于任意单位矩阵

,给定非零向量

,恒有

。所以,单位矩阵是正定矩阵(positive definite)。

【例2】实对称矩阵是否是正定矩阵?

解:设向量为非零向量,则

,因此,矩阵

是正定矩阵。

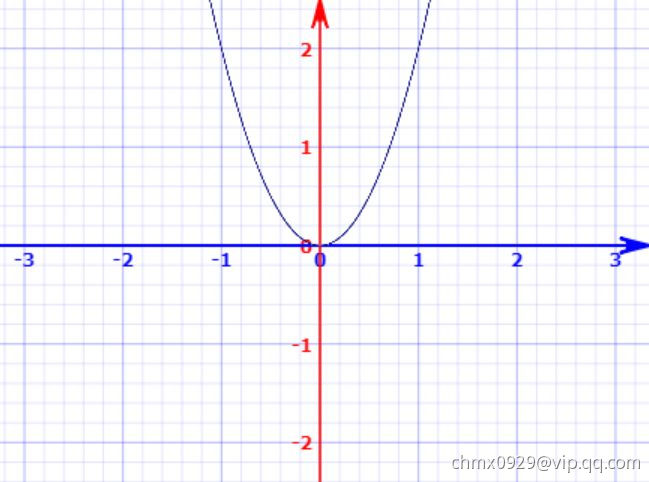

从二次函数到正定/半正定矩阵

在初中数学中,我们学习了二次函数,该函数的曲线会经过坐标原点,当参数

时,曲线的“开口”向上,参数

时,曲线的“开口”向下。以

为例,曲线如下:

实际上,我们可以将视作

的多维表达式。当我们希望

对于任意向量

都恒成立,就要求矩阵

是一个半正定矩阵,对应于二次函数,

需要使得

。

另外,在中,我们还知道:若

,则对于任意

,有

恒成立。这在

也有契合之处,当矩阵

是正定矩阵时,对于任意

,

恒成立。

正定矩阵和半正定矩阵的直观解释

【定义3】若给定任意一个正定矩阵和一个非零向量

,则两者相乘得到的向量

与向量

的夹角恒小于

(等价于

)

【定义4】若给定任意一个半正定矩阵和一个非零向量

,则两者相乘得到的向量

与向量

的夹角恒小于或等于

(等价于

)

【例3】给定向量,对于单位矩阵

,则

。向量

和

之间的夹角为

,即两个向量之间的夹角为0度。

【例4】给定向量,对于实对称矩阵

,则

。向量

和

之间的夹角为

,即两个向量之间的夹角小于

。

协方差矩阵与半正定

协方差的定义:对于任意多元随机变量,协方差矩阵为

现给定任意一个向量,则

,其中

。由于

,因此,

,协方差矩阵

是半正定的。

逆矩阵非奇异矩阵

在线性代数中,给定一个阶方阵

,若存在一

阶方阵

,使得

,其中

为

阶单位矩阵,则称

是可逆的,且

是

的逆矩阵,记作

。

只有正方形的矩阵,亦即方阵,才可能、但非必然有逆矩阵。若方阵

的逆矩阵存在,则称

为非奇异方阵或可逆方阵。

伪逆矩阵一般化的逆矩阵

众所周知只有方阵才有逆矩阵,非方阵没有逆矩阵。这个不和谐的问题已在20世纪初被数学家E. H. Moore等人解决掉了,因为他们发明了一般化的逆矩阵(generalized inverse),也称为伪逆矩阵(Moore–Penrose pseudoinverse)。对任意一个的矩阵

,

的伪逆矩阵

必然存在,且

必然满足以下四条件:

在应用中,我们利用其性质进行

特征值和特征向量(Eigenvalues&Eigenvectors)

在一般情况下,特征向量矩阵的特征向量

满足下列式子:

其中是所谓的“特征值”的一个标量值。这意味着,向量

上的线性变换

完全由

定义。我们可以重写式子为:

然而,假定不是空向量,等式只能在

不可逆的时候才能被定义。如果一个方阵是不可逆的,这意味着它的行列式必须等于零。因此,要找到

的特征向量,我们只需要解决以下公式:

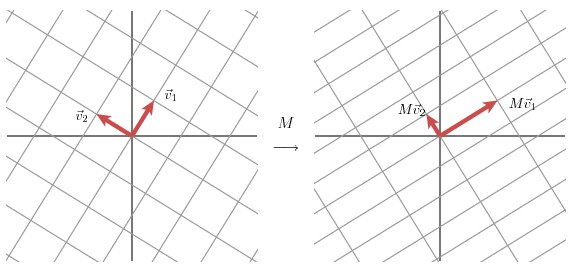

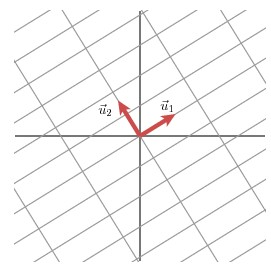

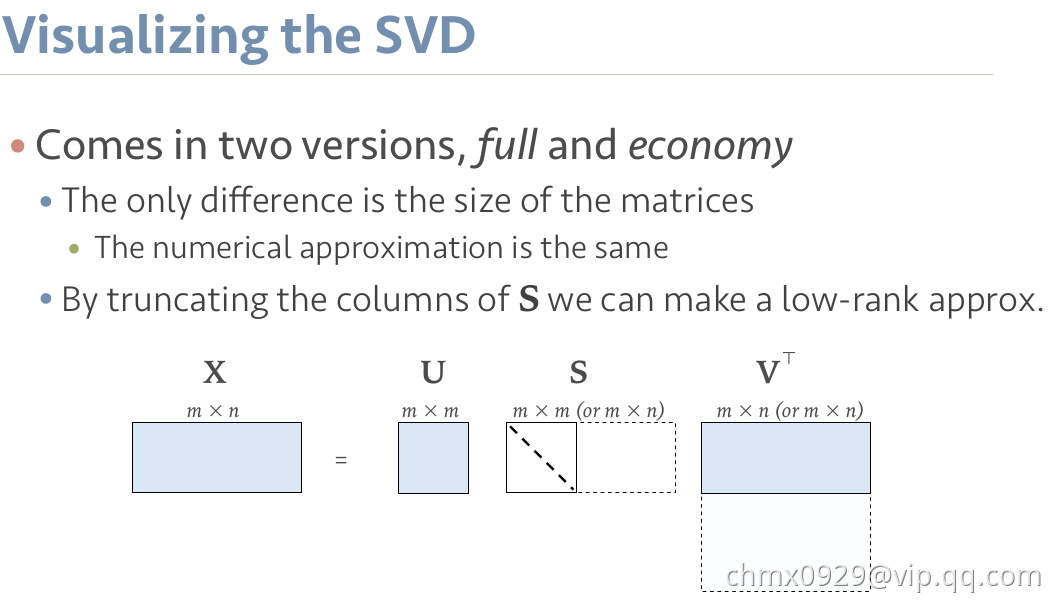

奇异值分解(SVD)

从几何层面上去理解二维的SVD:对于任意的矩阵,通过SVD可以将一个相互垂直的网格(orthogonal grid)变换到另外一个相互垂直的网格。 我们可以通过向量的方式来描述这个事实: 首先,选择两个相互正交的单位向量

和

, 向量

和

正交。

和

分别表示

和

的单位向量,

和

。

和

分别表示这不同方向向量上的模,也称作为矩阵

的奇异值。

这样我们就有了如下关系式:

我们现在可以简单描述下经过线性变换后的向量

的表达形式。由于向量

和

是正交的单位向量,我们可以得到如下式子(单位向量乘以向量即此向量在单位向量方向上的映射)

这就意味着:

向量内积可以用向量的转置来表示,如下所示:

最终的式子为:

上述的式子经常表示成:

矩阵的列向量分别是

,

是一个对角矩阵,对角元素分别是对应的

和

,

矩阵的列向量分别是

。上角标

表示矩阵

的转置。

Norms

2-norms

p-norms

Frobenius norm

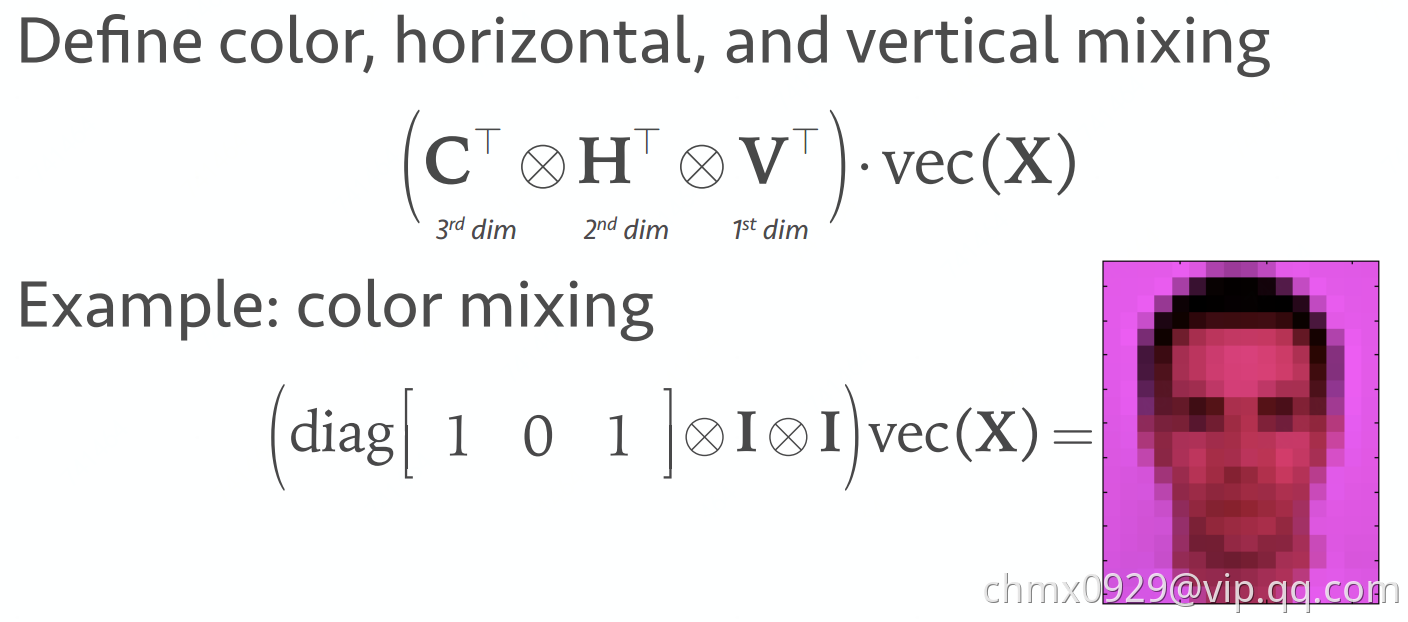

张量运算

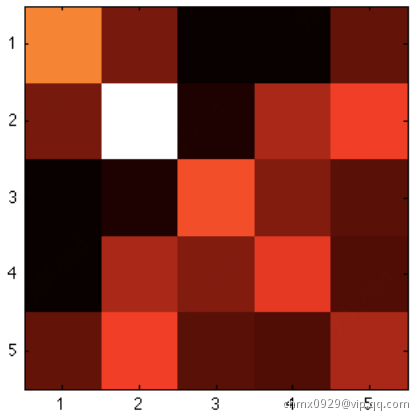

Kronecker product

矩阵中每个元素作为标量去乘矩阵

,其结果对应元素在矩阵

中位置

通过Kronecker products以及vec运算我们可以完成多线性转换

Source

http://shartoo.github.io/SVD-decomponent/

https://blog.csdn.net/u010182633/article/details/45921929

https://github.com/chmx0929/UIUCclasses/blob/master/598MachLrngforSignalProcessng/Slide/Lecture 1 - Intro%2C Linear Algebra.pdf

https://zhuanlan.zhihu.com/p/44860862