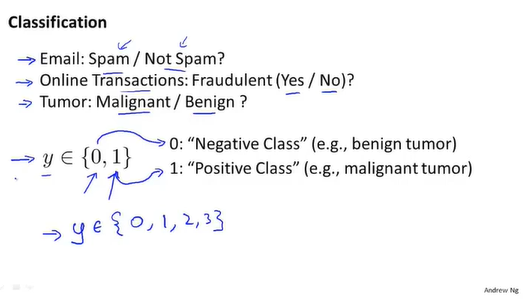

分类问题

二分类、三分类…n分类。线性回归显然不适合此种场合。

二分类——Logistic回归

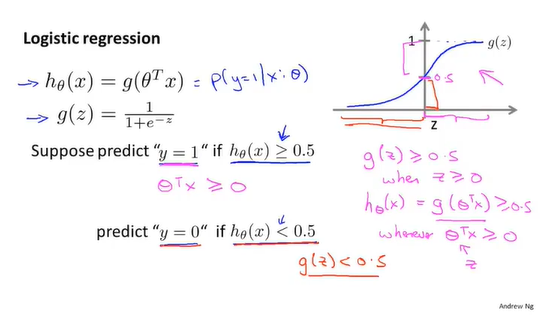

对于二分类问题,我们希望目标函数的值域始终位于[0,1]的区间内。对于普通的线性回归函数h(x),最好能有一个函数g(x),使估计函数始终落在[0,1]内。

由此引入如下方程组

得到

这就是Logistic(sigmoid)函数。对于回归问题,我们需要找到参数得到最终方程

logistic回归函数的意义即:意为x取特定值时y=1的概率,其中参数

待定。

函数图像如下

显然,当z值>0时,g(z)的估值就为1,z<0,g(z)的估值就为0

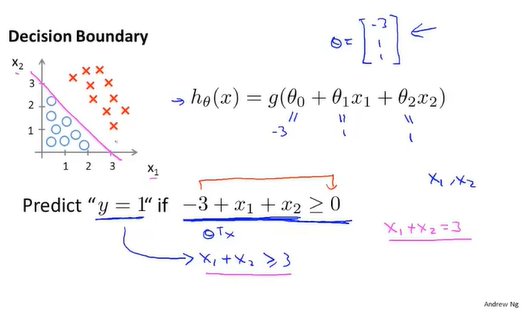

- 线性回归的决策边界

从以上结论中,我们知道通过z<0或者z>0,就可借由g(z)判断出估值为0或者1。当z为多项式时,我们就可绘制出该logistic函数的决策边界。

直线即决策边界

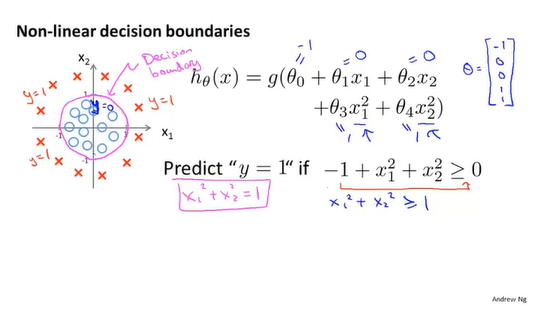

- 非线性回归的决策边界

推导过程相似

代价函数

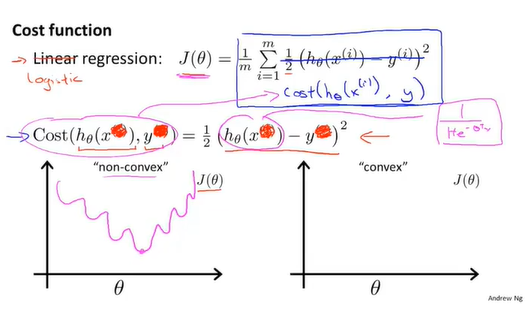

普通线性回归采用的代价函数为最小二乘估计法,在logistic回归中并不适用

如图所示,由于该代价函数具有许多局部最小值,若使用该代价函数进行梯度下降,难以获得全局最优值。这样的函数称为非凸函数。

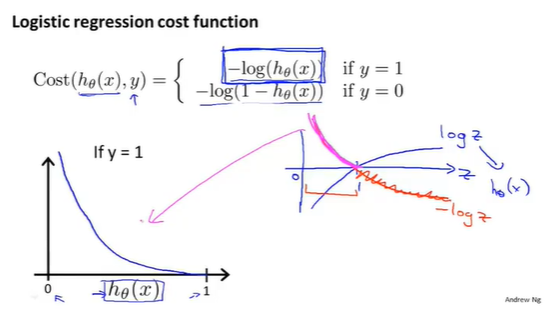

我们这样定义logistic的代价函数。如图所示,函数即为x轴之上的区域。

总之,无论在1的哪一侧,越趋近于1,代价函数的值就越小,反之亦然。

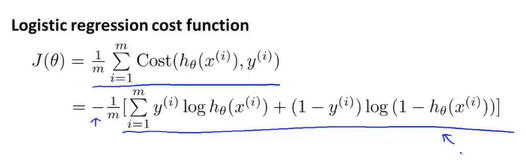

代价函数还可作进一步简化

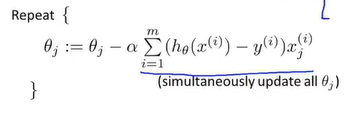

根据该代价函数,做梯度下降:

我们惊讶地发现,对求完偏导后所得的项竟与线性回归使用最小二乘估计作为代价函数时所得项完全相同。

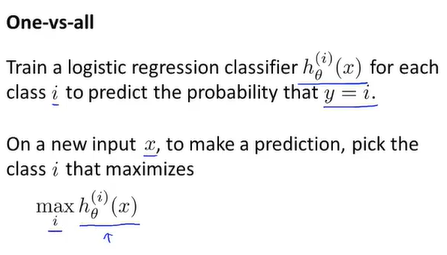

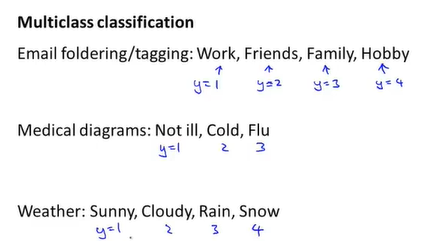

多分类问题

以下为一些多分类问题的例子:

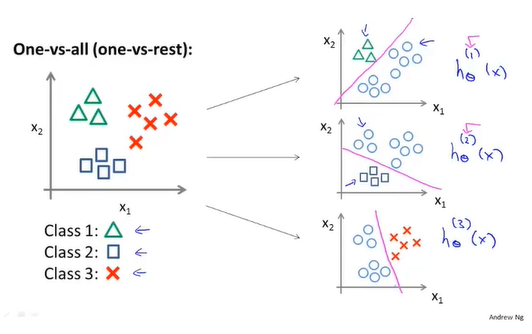

对于多分类问题,可以考虑将三个类别分别进行logistic回归。如先对class1进行研究,则只将class1的点标为正,其他class全标为负相关,从而进行logistic回归并确定决策边界

因此,确定几个logistic函数的参数之后,将待预测点分别代入几个函数之中,挑选出使最大的类别。无论i取多少,都能给予最高的预测值,于是我们就将它作为最终的预测值。