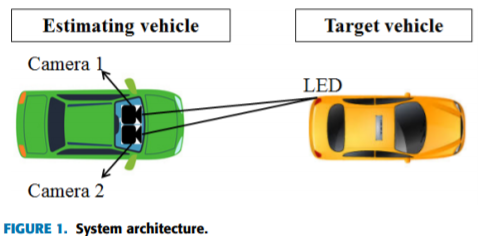

18.Vehicle-to-Vehicle Distance Estimation Using a Low-Resolution Camera Based on Visible Light Communications2018双目

本文提出了一种新算法,该算法使用两个摄像头来估算两个车辆之间的距离,前提是仅捕获了来自目标车辆的一个LED。这很重要,因为在交通繁忙的情况下,从后方车辆只能看到车辆中两个LED灯中的一个,并且所提出的算法允许后方车辆在这种困难的情况下估计距离。其次,本文提出了一种补偿方法,以减少由于相机分辨率低而引起的估计误差。在两辆车之间的距离很近的情况下,相机的低分辨率可能不是一个大问题。但是,当距离变长时,相机的低分辨率将大大降低估计精度,如模拟所示。通过使用提出的补偿方法,可以以更高的精度估算车辆之间的距离,更重要的是,随着距离的增加,距离估算的精度几乎保持不变。来计算两辆汽车之间的更精确距离。 之后,使用卡尔曼滤波器和中位数选择方法确定两辆车之间的最精确距离。

19.Toward Real-time Vehicle Detection Using Stereo Vision and an Evolutionary Algorithm2012双目

本文介绍了一种基于立体视觉和进化算法(SEA)的车辆检测和距离估计的新方法。首先,我们将基于FPGA的基于普查的相关性在立体声匹配方面的最新工作重用。接下来,SEA使用从FPGA系统获得的灰度左侧图像和视差信息来检测在前车辆并估算其距离。本文介绍了一种有效的适应度函数,该功能使我们提出的方法与现有的基于进化算法(EA)的方法相比具有更高的性能和更高的准确性。引入了一种新的交叉类型,即锦标赛交叉,以减少我们提出的收敛时间。本文还介绍了一种估计适应度函数参数的新方法。此估计与传统EA不同,因为这些参数通常是通过实验创建的。此外,通过将全局搜索转换为具有V视差图的本地搜索,可以提高SEA的处理时间和准确性。强大的实验证明,SEA成功地检测了前方车辆,并承受了沿道路出现的不同物体的噪音。检测范围为10m-140m,检测率为95%,在CPU上的平均处理时间约为31 ms /帧。这些结果证明SEA适用于实时系统。

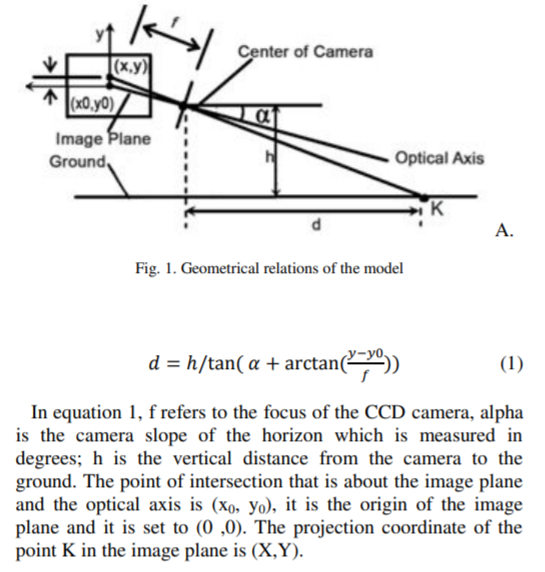

20.Vehicle Distance Detection Based on Monocular Vision 2016X单目&透视原理

在本文中,我们修改了建议的区域,缩小了检测区域,提高了检测效率。 距离计算部分几乎没有时间消耗,并且整个系统集中于提高对象定位的精度。 通过修改边界框,系统可以尝试确保检测到车辆宽度。 因此,我们消除了由检测本身引起的错误。 系统误差集中在实际车辆宽度和我们使用的平均车辆宽度之间的差异上。 当目标车辆不平行于光轴时,可以提高宽度的精度。 在这里,我们仅使用灯光的颜色特征来检测车辆宽度,当距离很远时,这不是很有效。 将来,可以使用更多功能来提高准确性。 为了提高物体区域的精度,我们也可以尝试使用车道检测,车道线和图像下边界的区域通常是三角形区域。 通常,车道检测可以减少到特定功能的定位,例如涂在路面上的车道标记[11]。 这样可以进一步减少区域提案的数量。

21.Distance Estimation and Vehicle position detection Based on Monocular Camera 2016单目

25.Vision-based Vehicle Detection and Inter-Vehicle Distance Estimation2012绝对距离

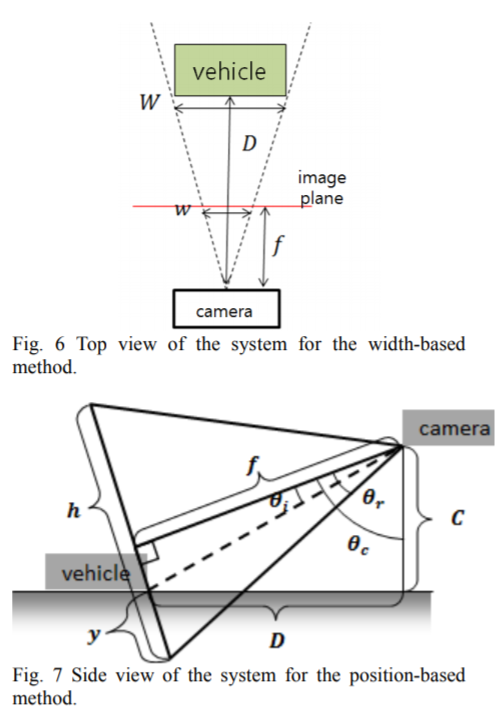

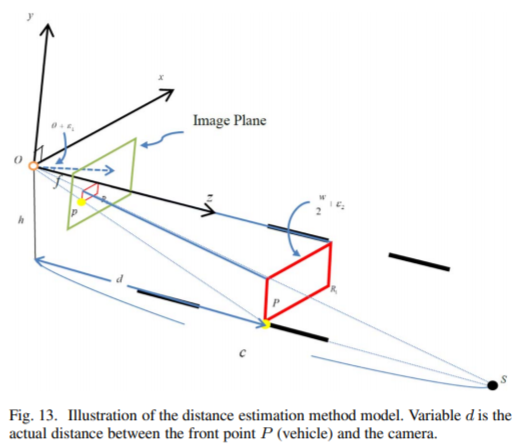

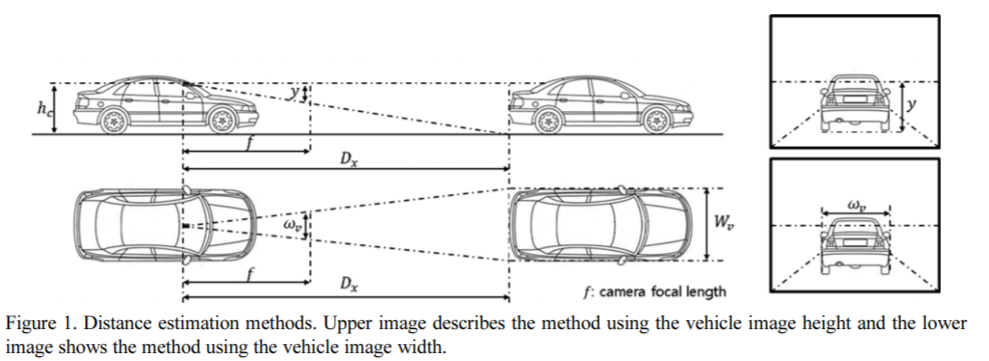

在本文中,我们提出了一种用于驾驶辅助系统的基于视觉的鲁棒车辆检测和车距估计算法。 它使用方向性边缘特征以及汽车后阴影的类似Haar的特征来检测前车。 使用附加的车辆边缘功能可大大减少假阳性错误。 并且,在分析了基于车辆位置和基于车辆宽度的两种车辆间距离估计方法之后,提出了一种利用这两种方法的优点的改进的车辆间距离估计算法。 各种实验结果表明了该方法的有效性。

我们的研究假设摄像机位于固定位置,并且道路车辆在平坦的道路上行驶,因此我们可以从2D单张图像中获得3D距离信息。 本文将基于位置的方法[6]和基于宽度的方法[3]结合起来以弥补它们的缺点。

1.A Novel Distance Estimation Method Leading a Forward Collision Avoidance Assist System for Vehicles on Highways2D检测法2017 & 基于几何 & 逆透视

透视和逆透视

4.Robust Inter-Vehicle Distance Estimation2D检测法2019福大

28.Robust Vehicle Detection and Distance Estimation Under Challenging Lighting Conditions2D检测法2015

避免了基于立体视觉算法的高计算成本和校准问题,本文提出了基于实时单目视觉的技术,用于同时进行车辆检测和车辆之间的距离估计,其中系统的性能和鲁棒性保持竞争力,即使是极富挑战性的基准数据集。本文通过检测前方车辆并在即将发生的碰撞发生之前识别安全距离以帮助分心的驾驶员,开发了一种碰撞警告系统。我们为车辆检测,尾灯分割,虚拟对称检测,车距估计以及高效的单传感器多特征融合技术引入了自适应的类似Haar的特征,以提高算法的准确性和鲁棒性。所提出的算法能够在白天或晚上以及短距离和远距离的情况下检测前方车辆。在各种天气和光照条件下(包括晴天,雨天,大雾或下雪)的实验结果表明,该算法优于最新算法。

3.Measuring the absolute distance of afront vehicle from an in-car camerabased on monocular vision and instance segmentation福大192D检测法

6.3D bounding box estimation using deep learning and geometry(2017cvpr 本文3D检测网络基础)

我们提出了一种用于从单个图像进行3D对象检测和姿态估计的方法。与仅对对象的3D方向进行回归的当前技术相比,我们的方法首先使用深度卷积神经网络对相对稳定的3D对象属性进行回归,然后将这些估计值与2D对象边界框提供的几何约束相结合,以生成完整的3D边界框。第一个网络输出使用一种新颖的混合离散连续损失(其性能明显优于L2损失)来估算3D对象方向。第二个输出对3D对象尺寸进行回归,该3D对象尺寸与替代尺寸相比变化较小,并且通常可以针对许多对象类型进行预测。这些估计值加上2D边界框对平移施加的几何约束,使我们能够恢复稳定且准确的3D对象姿态。我们在具有挑战性的KITTI对象检测基准[2]上评估我们的方法,既基于3D方向估计的官方度量,也基于获得的3D边界框的准确性。尽管从概念上讲很简单,但我们的方法优于利用语义分割,实例级别分割和平坦先验[4]和子类别检测[23] [24]的更复杂且计算成本更高的方法。我们的离散连续损失也为Pascal 3D +数据集上的3D视点估计提供了最先进的结果[26]。

7、Monocular 3D Object Detection for Autonomous Driving

本文的目标是在自动驾驶领域从单个单眼图像执行3D对象检测。 我们的方法首先旨在生成一组候选类特定对象建议,然后通过标准CNN管道运行这些建议以获得高质量的对象检测。 本文的重点是提案的生成。 特别是,我们提出了一种能量最小化方法,该方法使用对象应位于地平面上的事实将对象候选放置在3D中。 然后,我们通过编码语义分割,上下文信息,大小和位置先验以及典型对象形状的几种直观电位对投影到图像平面的每个候选框进行评分。 我们的实验评估表明,在已发布的单眼竞争对手中,我们的目标提案生成方法明显优于所有单眼方法,并且在具有挑战性的KITTI基准测试中实现了最佳检测性能。

34. 2D检测网络

2D检测网络

11.KITTI数据集

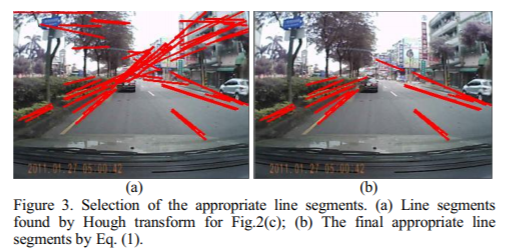

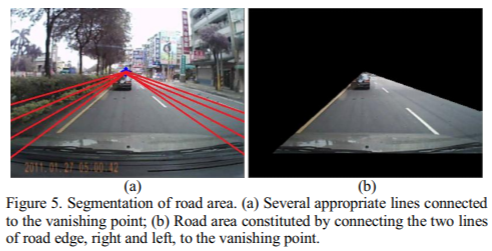

30.Front vehicle detectionanddistanceestimationusingsingle-lensvideocamera2015基于几何

本文致力于在城市和郊区道路上使用一台单镜头汽车摄像机对前方车辆进行检测及其距离估算。 所提出的方法主要包括道路面积检测和前车检测与距离计算。 首先,使用霍夫变换来检测选择了适当直线的线,并利用它们的交点获得消失点。 然后,提取左右两边的强边并将其连接到消失点以分割道路区域,并在该区域上利用前排车辆的底影定位车辆的位置。 最后,基于车辆的位置和消失点计算本车与前方车辆之间的距离。 实验结果表明,该技术能够对城市和郊区道路上的前车进行适度的检测,检测率至少为78%。

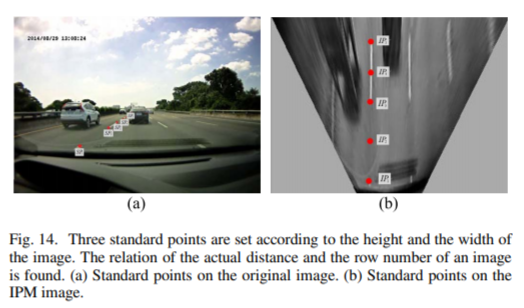

31.Distance Detection Technique Using Enhancing Inverse Perspective Mapping 2018 3rd International Conference on Computer and Communication Systems数学回归与建模

本文提出了一种使用单个前向摄像机的图像进行距离确定的技术。 由于图像太暗或太亮以及物体高度和与相机的距离之间的非线性关系都会影响检测过程的性能。 因此,在提出的方案中应用了自动亮度调节和反透视映射(IMP)。 另外,确定感兴趣区域(ROI)可减少处理时间。 实验结果证明,该技术可以检测到汽车前方物体的距离,误差为7.96%。

46.Vision-Based Detection and Distance Estimation of Micro Unmanned Aerial Vehicles2015数学回归与建模

32Vehicle detection and inter-vehicle distance estimation using single-lens video camera on urban/suburb roads2017透视

本文提出了一种在城市/郊区道路上使用单镜头摄像机进行车辆检测和车距估计的驾驶员辅助系统。 由于城市/郊区道路的场景复杂性高,车辆检测任务更具挑战性。 在这项工作中,首先使用时间差移除主车辆内部车架的静止区域,然后检测消失点。 然后使用消失点和道路边缘线进行道路区域分割。 使用HOG功能和SVM分类器验证的车辆底部阴影区域用于检测车辆位置。 根据检测到的车辆的位置和消失点来估算主机与其前部车辆之间的距离。 实验结果表明,在不同的城市/郊区道路场景下,车辆检测性能各不相同,检测率可达94.08%,说明了该方法的可行性。

本文是我们先前工作的延伸[29]。图1显示了所提出的车辆检测和车辆间距离估计方法的流程图,该方法由多个子系统组成,包括图像预处理,信息收集,消失点检测,道路区域分割,前车检测和车辆间估计-车辆距离。首先将输入图像转换为灰度图像,因为在此工作中未使用颜色信息。然后,引入下采样和去除帧的静止区域以提高计算效率。有关消失点检测的信息收集涉及Canny边缘检测,水平和垂直线的去除,霍夫变换以及左右线的标识。在此阶段,将找到消失点,然后使用DBSCAN(带有噪声的应用程序的基于密度的空间聚类)算法进行验证,以获得最终的消失点。根据消失点和两条道路边缘线,可以完全分割道路区域。之后,使用阴影特征在分段的道路区域内检测前车,然后使用HOG特征和SVM分类器验证假设生成(HG)。最后,使用消失点的信息和真实距离与图像像素的比率来估计车距。这些过程的详细信息在以下小节中描述。在第3.1节中,描述了图像预处理,在第3.2节和第3.3节中分别介绍了信息收集和消失点检测。然后,在第3.4节中说明道路区域的分割。最后,分别在第3.5节和第3.6节中给出了前车检测和车距估计。

33.VEHICLE DISTANCE ESTIMATION USING A MONO-CAMERA FOR FCW/AEB SYSTEM2016透视

在这项研究中,我们开发了使用单眼相机的目标车辆的测量估算算法。该方法通过使用检测到的车道信息和针孔摄像机模型来估算目标车辆的两种车宽情况。之后,对于每个估计的车辆宽度,通过使用卡尔曼滤波器来估计目标车辆的位置,速度,加速度和TTC。为了提高鲁棒性,将使用检测到的车道信息的估计结果与针孔摄像机模型两者融合。评估了该估算算法,并将其与最新技术进行了比较。结果,所提出的测量输出估计方法可以改善FCW / AEB系统的性能。

**

**

**

**

**