0.2662019.01.26 14:01:39 字数 582 阅读 20,681

每次只选取 1 个样本,然后根据运行结果调整参数,这就是著名的随机梯度下降(SGD),而且可称为批大小(batch size)为 1 的SGD。

批大小,就是每次调整参数前所选取的样本(称为mini-batch或batch)数量:

如果批大小为 N,每次会选取 N 个样本,分别代入网络,算出它们分别对应的参数调整值,然后将所有调整值取平均,作为最后的调整值,以此调整网络的参数。

如果批大小 N 很大,例如和全部样本的个数一样,那么可保证得到的调整值很稳定,是最能让全体样本受益的改变。

如果批大小 N 较小,例如为 1,那么得到的调整值有一定的随机性,因为对于某个样本最有效的调整,对于另一个样本不一定最有效(就像对于识别某张黑猫图像最有效的调整,不一定对于识别另一张白猫图像最有效)。

那么批大小是否越大越好?绝非如此,很多时候恰好相反。合适的批大小对于网络的训练很重要。

训练中的另一个重要概念是epoch。每学一遍数据集,就称为 1 个epoch。

举例,若数据集中有 1000 个样本,批大小为 10,那么将全部样本训练 1 遍后,网络会被调整 1000/10=100 次。但这并不意味着网络已达到最优,我们可重复这个过程,让网络再学 1 遍、2 遍、3 遍数据集。

注意每一个epoch都需打乱数据的顺序,以使网络受到的调整更具有多样性。同时,我们会不断监督网络的训练效果。通常情况下,网络的性能提高速度会越来越慢,在几十到几百个epoch后网络的性能会趋于稳定,即性能基本不再提高。

转自:

1、《深度卷积网络 原理与实践》 机械工业出版社

更多精彩内容,就在简书 APP

“小礼物走一走,来简书关注我”

还没有人赞赏,支持一下

总资产 10 共写了 5.1W 字获得 230 个赞共 167 个粉丝

推荐阅读更多精彩内容

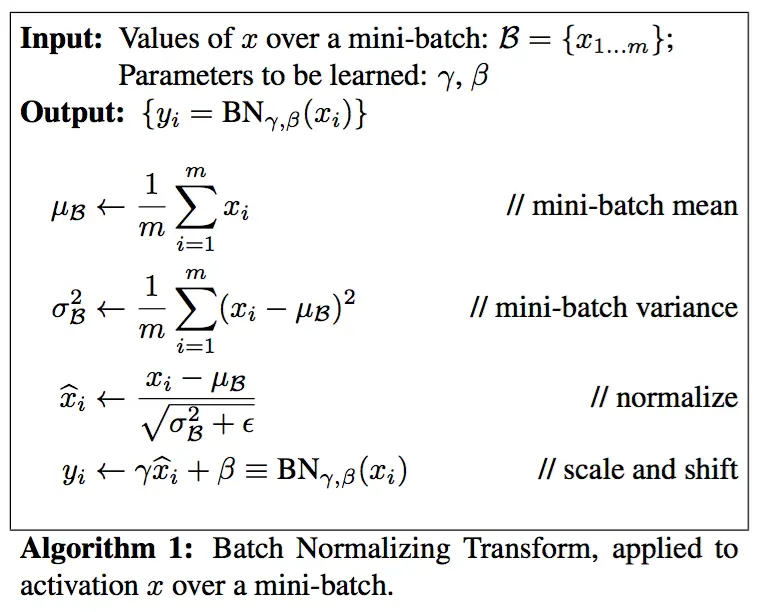

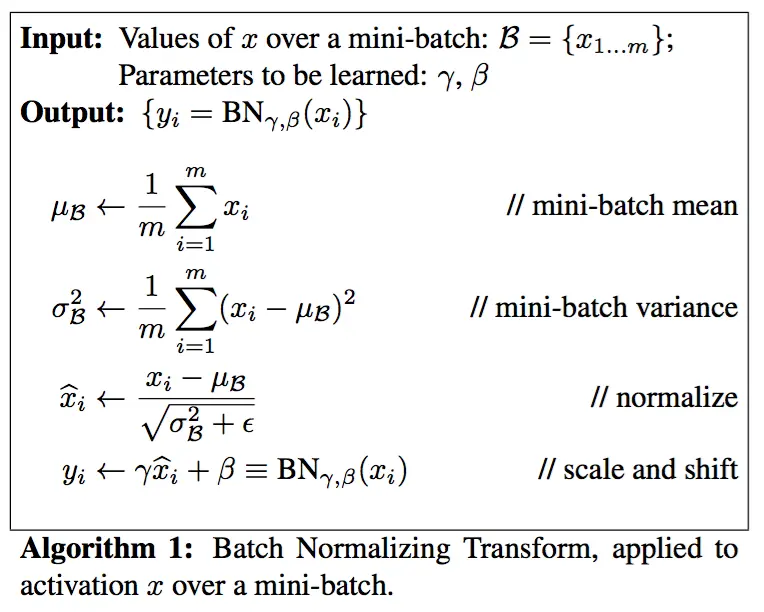

文章作者:Tyan 博客:noahsnail.com[http://noahsnail.com\)] | CSDN…

[

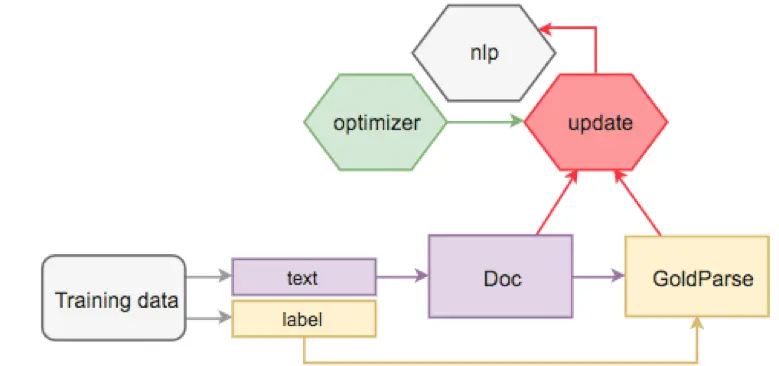

Training spaCy’s Statistical Models 训练 spaCy 模型 This guide d…

上周日晚上 7 点左右,突然电话响了。电话那头是一位学校里孩子的母亲,她说:“孙老师,我有个事和你说一下,是关…

书香絮阅读 374 评论 1 赞 0

感恩上师三宝慈悲加持,感恩十方诸佛菩萨极大庇护我,感恩佛法指引我修行,让我可以在每次不觉犯错误的时候,心怀…

言润阅读 46 评论 0 赞 0- 投资 投资原则: 没有好的项目,不投 不跟风 帮助朋友成立自己的公司。 【朋友圈里应该有企业家和投资人,未来…

马骋阅读 451 评论 0 赞 1

https://www.jianshu.com/p/99d790f8208b

- 投资 投资原则: 没有好的项目,不投 不跟风 帮助朋友成立自己的公司。 【朋友圈里应该有企业家和投资人,未来…