机器学习中几乎都可以看到损失函数后面会添加一个额外项,常用的额外项一般有两种,一般英文称作 ℓ1 \ell_1-norm 和 ℓ2 \ell_2-norm,中文称作 L1 正则化 和 L2 正则化,或者 L1 范数 和 L2 范数。

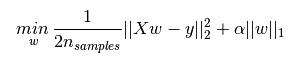

L1 正则化和 L2 正则化可以看做是损失函数的惩罚项。所谓『惩罚』是指对损失函数中的某些参数做一些限制。对于线性回归模型,使用 L1 正则化的模型建叫做 Lasso 回归,使用 L2 正则化的模型叫做 Ridge 回归(岭回归)。下图是 Python 中 Lasso 回归的损失函数,式中加号后面一项α∣∣w∣∣1 \alpha||w||_1 即为 L1 正则化项。

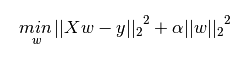

下图是 Python 中 Ridge 回归的损失函数,式中加号后面一项α∣∣w∣∣22 \alpha||w||_2^2 即为 L2 正则化项。

一般回归分析中 w w 表示特征的系数,从上式可以看到正则化项是对系数做了处理(限制)。L1 正则化和 L2 正则化的说明如下:

- L1 正则化是指权值向量 w w 中各个元素的绝对值之和,通常表示为∣∣w∣∣1 ||w||_1

- L2 正则化是指权值向量 w w 中各个元素的平方和然后再求平方根(可以看到 Ridge 回归的 L2 正则化项有平方符号),通常表示为∣∣w∣∣2 ||w||_2

一般都会在正则化项之前添加一个系数,Python 的机器学习包sklearn中用α \alpha 表示,一些文章也用λ \lambda 表示。这个系数需要用户指定。

那添加 L1 和 L2 正则化有什么用?下面是 L1 正则化和 L2 正则化的作用,这些表述可以在很多文章中找到。

- L1 正则化可以产生稀疏权值矩阵,即产生一个稀疏模型,可以用于特征选择

- L2 正则化可以防止模型过拟合(overfitting);一定程度上,L1 也可以防止过拟合

稀疏模型与特征选择的关系

上面提到 L1 正则化有助于生成一个稀疏权值矩阵,进而可以用于特征选择。为什么要生成一个稀疏矩阵?

稀疏矩阵指的是很多元素为 0,只有少数元素是非零值的矩阵,即得到的线性回归模型的大部分系数都是 0. 通常机器学习中特征数量很多,例如文本处理时,如果将一个词组(term)作为一个特征,那么特征数量会达到上万个(bigram)。在预测或分类时,那么多特征显然难以选择,但是如果代入这些特征得到的模型是一个稀疏模型,表示只有少数特征对这个模型有贡献,绝大部分特征是没有贡献的,或者贡献微小(因为它们前面的系数是 0 或者是很小的值,即使去掉对模型也没有什么影响),此时我们就可以只关注系数是非零值的特征。这就是稀疏模型与特征选择的关系。

这部分内容将解释为什么 L1 正则化可以产生稀疏模型(L1 是怎么让系数等于零的),以及为什么 L2 正则化可以防止过拟合。

正则化和特征选择的关系

假设有如下带 L1 正则化的损失函数:

J=J0+α∑w∣w∣(1) J = J_0 + \alpha \sum_w{|w|} \tag{1}

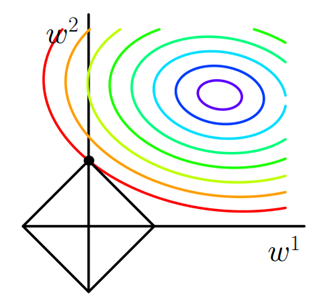

其中 J0 J_0 是原始的损失函数,加号后面的一项是 L1 正则化项,α \alpha 是正则化系数。注意到 L1 正则化是权值的绝对值之和,J J 是带有绝对值符号的函数,因此 J J 是不完全可微的。机器学习的任务就是要通过一些方法(比如梯度下降)求出损失函数的最小值。当我们在原始损失函数 J0 J_0 后添加 L1 正则化项时,相当于对 J0 J_0 做了一个约束。令 L=α∑w∣w∣ L = \alpha \sum_w{|w|},则 J=J0+L J = J_0 + L,此时我们的任务变成在 L L 约束下求出 J0 J_0 取最小值的解。考虑二维的情况,即只有两个权值 w1 w^1 和 w2 w^2,此时 L=∣w1∣+∣w2∣ L = |w2|。对于梯度下降法,求解 J0 J_0 的过程可以画出等值线,同时 L1 正则化的函数 L L 也可以在 w1w2 w2 的二维平面上画出来。如下图:

图 1 L1 正则化

图中等值线是 J0 J_0 的等值线,黑色方形是 L L 函数的图形。L=∣w1∣+∣w2∣ L = |w2|,这个函数画出来就是一个方框(可以自己动手画一下)。

在图中,当 J0 J_0 等值线与 L L 图形首次相交的地方就是最优解。上图中 J0 J_0 与 L L 在 L L 的一个顶点处相交,这个顶点就是最优解。注意到这个顶点的值是 (w1,w2)=(0,w) (w^1, w^2) = (0, w)。可以直观想象,因为 L L 函数有很多『突出的角』(二维情况下四个,多维情况下更多),J0 J_0 与这些角接触的机率会远大于与 L L 其它部位接触的机率(这是很直觉的想象,突出的角比直线的边离等值线更近写),而在这些角上,会有很多权值等于 0(因为角就在坐标轴上),这就是为什么 L1 正则化可以产生稀疏模型,进而可以用于特征选择。

而正则化前面的系数α \alpha,可以控制 L L 图形的大小。α \alpha 越小,L L 的图形越大(上图中的黑色方框);α \alpha 越大,L L 的图形就越小,可以小到黑色方框只超出原点范围一点点,这是最优点的值 (w1,w2)=(0,w) (w1,w2)=(0,w) 中的 w w 可以取到很小的值。

类似地,假设有如下带 L2 正则化的损失函数:

J=J0+α∑ww2(2) J = J_0 + \alpha \sum_w{w^2} \tag{2}

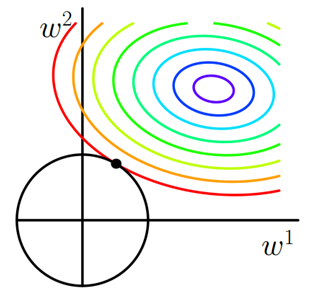

同样可以画出他们在二维平面上的图形,如下:

图 2 L2 正则化

二维平面下 L2 正则化的函数图形是个圆(绝对值的平方和,是个圆),与方形相比,被磨去了棱角。因此 J0 J_0 与 L L 相交时使得 w1 w^1 或 w2 w^2 等于零的机率小了许多(这个也是一个很直观的想象),这就是为什么 L2 正则化不具有稀疏性的原因,因为不太可能出现多数 w w 都为 0 的情况。

为什么梯度下降的等值线与正则化函数第一次交点是最优解?

评论中有人问到过这个问题,这是带约束的最优化问题。这应该是在大一的高等数学就学到知识点,因为这里要用到拉格朗日乘子。如果有这样的问题,就需要复习一下高等数学了。这里有一个比较详细的数学讲解,可以参考:带约束的最优化问题。

L2 正则化和过拟合的关系

拟合过程中通常都倾向于让权值尽可能小,最后构造一个所有参数都比较小的模型。因为一般认为参数值小的模型比较简单,能适应不同的数据集,也在一定程度上避免了过拟合现象。可以设想一下对于一个线性回归方程,若参数很大,那么只要数据偏移一点点,就会对结果造成很大的影响;但如果参数足够小,数据偏移得多一点也不会对结果造成什么影响,专业一点的说法是『抗扰动能力强』。

那为什么 L2 正则化可以获得值很小的参数?

以线性回归中的梯度下降法为例,使用 Andrew Ng 机器学习的参数表示方法。假设要求解的参数为θ \theta,hθ(x) h\theta(x) 是我们的假设函数。线性回归一般使用平方差损失函数。单个样本的平方差是 (hθ(x)−y)2 (h\theta(x) - y)^2,如果考虑所有样本,损失函数是对每个样本的平方差求和,假设有 m m 个样本,线性回归的代价函数如下,为了后续处理方便,乘以一个常数 12m \frac{1}{2m}:

J(θ)=12m∑i=1m(hθ(x(i))−y(i))2(3) J(\theta) = \frac{1}{2m}\sum_{i=1}{(i)}) - y2 \tag{3}

在梯度下降算法中,需要先对参数求导,得到梯度。梯度本身是上升最快的方向,为了让损失尽可能小,沿梯度的负方向更新参数即可。

对于单个样本,先对某个参数θj \theta_j 求导:

∂∂θjJ(θ)=1m(hθ(x)−y)∂∂θjhθ(x)(3.1) \frac{\partial}{\partial \thetaj} J(\theta) = \frac{1}{m} (h\theta(x) - y) \frac{\partial}{\partial \thetaj} h\theta(x) \tag{3.1}

注意到 hθ(x) h\theta(x) 的表达式是 hθ(x)=θ0x0+θ1x1+⋯+θnxn h\theta(x)=\theta0 x_0 + \theta_1 x_1 + \dots + \theta_n x_n. 单个样本对某个参数θj \theta_j 求导,∂∂θjhθ(x)=xj \frac{\partial}{\partial \theta_j} h\theta(x) = x_j. 最终 (3.1) 式结果如下:

∂∂θjJ(θ)=1m(hθ(x)−y)xj(3.2) \frac{\partial}{\partial \thetaj} J(\theta) = \frac{1}{m} (h\theta(x) - y) x_j \tag{3.2}

在考虑所有样本的情况,将每个样本对θj \theta_j 的导数求和即可,得到下式:

∂∂θjJ(θ)=1m∑i=1m(hθ(x(i))−y(i))xj(i)(3.3) \frac{\partial}{\partial \thetaj} J(\theta) = \frac{1}{m} \sum{i=1}^m (h_\theta(x^{(i)}) - y^{(i)}) x_j^{(i)} \tag{3.3}

梯度下降算法中,为了尽快收敛,会沿梯度的负方向更新参数,因此在 (3.3) 式前添加一个负号,并乘以一个系数α \alpha(即学习率),得到最终用于迭代计算参数θj \theta_j 的形式:

θj:=θj−α1m∑i=1m(hθ(x(i))−y(i))xj(i)(4) \thetaj := \theta_j - \alpha \frac{1}{m}\sum{i=1}{(i)}) - y{(i)} \tag{4}

其中α \alpha 是学习率(learning rate)。 上式是没有添加 L2 正则化项的迭代公式,如果在原始代价函数之后添加 L2 正则化,则迭代公式会变成下面的样子:

θj:=θj(1−αλm)−α1m∑i=1m(hθ(x(i))−y(i))xj(i)(5) \thetaj := \theta_j(1-\alpha \frac{\lambda}{m}) - \alpha \frac{1}{m}\sum{i=1}{(i)}) - y{(i)} \tag{5}

其中λ \lambda就是正则化参数。从上式可以看到,与未添加 L2 正则化的迭代公式相比,每一次迭代,θj \theta_j 都要先乘以一个小于 1 的因子(即 (1−αλm) (1-\alpha \frac{\lambda}{m})),从而使得θj \theta_j 不断减小,因此总的来看,θ \theta 是不断减小的。

最开始也提到 L1 正则化一定程度上也可以防止过拟合。之前做了解释,当 L1 的正则化系数很小时,得到的最优解会很小,可以达到和 L2 正则化类似的效果。

L1 正则化参数

通常越大的λ \lambda 可以让代价函数在参数为 0 时取到最小值。因为正则化系数越大,正则化的函数图形(上文图中的方形或圆形)会向坐标轴原点收缩得越厉害,这个现象称为shrinkage,过程可以称为shrink to zero. 下面是一个简单的例子,这个例子来自Quora 上的问答。为了方便叙述,一些符号跟这篇帖子的符号保持一致。

假设有如下带 L1 正则化项的代价函数:

F(x)=f(x)+λ∣∣x∣∣1 F(x) = f(x) + \lambda ||x||_1

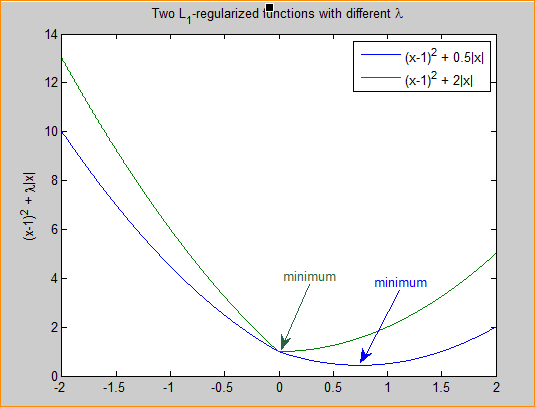

其中 x x 是要估计的参数,相当于上文中提到的 w w 以及θ \theta. 这个例子中的正则化函数 L L 就是 L=λ∣x∣ L=\lambda |x|。注意到 L1 正则化在某些位置是不可导的,当λ \lambda 足够大时可以使得 F(x) F(x) 在 x=0 x = 0 时取到最小值。如下图:

图 3 L1 正则化参数的选择

作为一个直观的例子,这个图的示例中,取了 f(x)=(x−1)2 f(x) = (x-1)^2 作为损失函数,其实可以取更复杂的,但不好画图,不过原理是一样的,因为损失函数都是凸函数,很多性质是一样的。

正则化分别取λ=0.5 \lambda = 0.5 和λ=2 \lambda = 2,可以看到越大的λ \lambda 越容易使 F(x) F(x) 在 x=0 x=0 时取到最小值。

此外也可以自己计算一下,当损失函数 f(x) f(x) 和正则化函数 L=∣x∣ L=|x | 在定义域内第一次相交的地方,就是整个代价函数 F(x) F(x) 的最优解。

L2 正则化参数

从公式 5 可以看到,λ \lambda 越大,θj \theta_j 衰减得越快。另一个理解可以参考图 2,λ \lambda 越大,L2 圆的半径越小,最后求得代价函数最值时各参数也会变得很小,同样是一个 shrink to zero 的过程,原理与 L1 正则化类似。

过拟合的解释:

https://hit-scir.gitbooks.io/neural-networks-and-deep-learning-zh_cn/content/chap3/c3s5ss2.html

正则化的解释:

https://hit-scir.gitbooks.io/neural-networks-and-deep-learning-zh_cn/content/chap3/c3s5ss1.html

正则化的解释:

http://blog.csdn.net/u012162613/article/details/44261657

正则化的数学解释(一些图来源于这里):

http://blog.csdn.net/zouxy09/article/details/24971995

https://blog.csdn.net/jinping_shi/article/details/52433975