1. Convolution Kernal & Filter

我们对图像进行卷积的时候,

目的是为了用卷积核/Filter对图像的特征进行提取。

一个fliter,一组weights,代表一个特征

用特征扫描整张原图的每一个局部,确认每一个局部是否存在这个特征,如果有这个特征就一定能找到。

2.Spatial Hierarchies of patterns

第一层的Convotional layer学习最简单的特征

第二层的也有同样大小和尺寸的Filter,但数量更多

为什么深层的Convotional layer的filter数量要更高?

初级特征少(比如说,26个英文字母和小说)

高级特征可以在初级特征上衍生更多

第二层Convotional layer在第一层convolutional layer的基础上学习更多,提炼更多,学习更复杂的特征

第二层的output neuron是对第一层一个局部特征扫描后的总结,同样是一个neuron,第二层的neuron信息量更大。因为种类多了,概率低了,信息量就大了。

第二层的output feature maps在用更复杂,更抽象的特征作为单位来重塑原图。

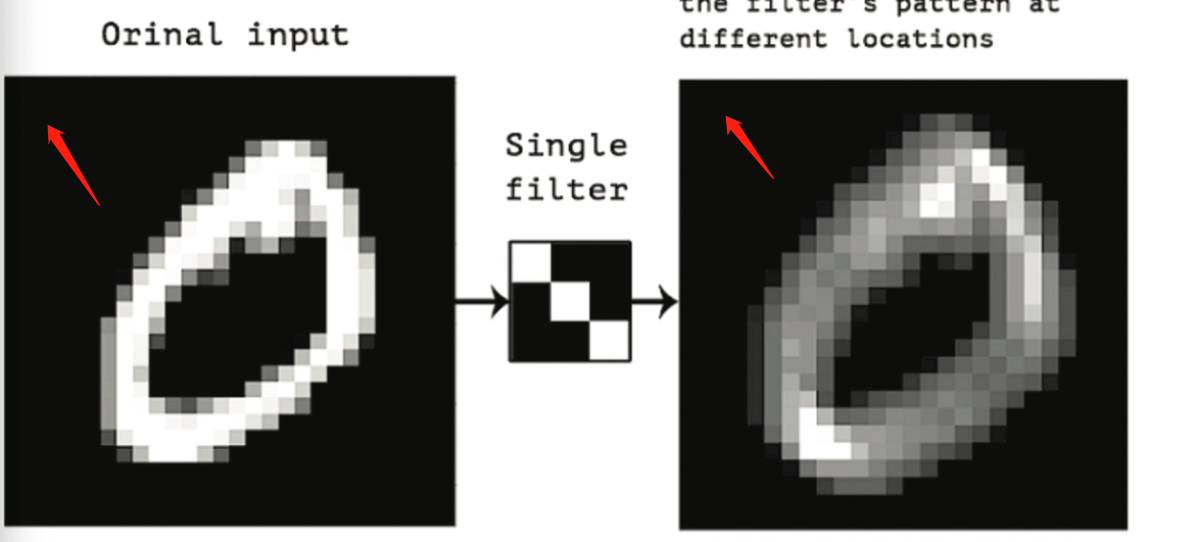

3. 如何理解filter和feature maps的关系

filter:

特征扫描器,扫描原图所有局部

每个局部是否存在某个特征状态,作为一个feature map neuron

一副feature maps是由非常多的neuron组成的。比如说在图中,

用filter对图1做卷积,输出的结果为图2,单论每一个filter输出的都是一个neuron,图二就是非常多neuron组成的图形。

由于图二是由filter这样的feature卷积得到的,所以图2叫feature maps

feature maps:

以某个特征为单位的neuron来重塑原图

用某个特征来重塑原图。