1. 入门案例

2. netcat的发送和监听

安装

sudo yum install -y nc #安装netcat工具sudo netstat -tunlp | grep 44444 #判断44444端口是否被占用

使用nc发送和接受消息 此操作在一个机器上 2个ssh窗口中操作

接受

nc -l 44444 # 监听44444端口

发送

nc hadoop102 44444 #发送输入内容

也可以在其他机器向指定ip 端口 发送消息

监听和发送的端口必须一致

默认为tcp协议

3. 监控端口数据在控制台输出 官方案例 netcat

#r1:表示a1的Source的名称 多个名称之前空格隔开a1.sources = r1#k1:表示a1的Sink名称a1.sinks = k1#c1:表示channels的名称a1.channels = c1# a1的输入源类型为netcat端口类型a1.sources.r1.type = netcat# a1的监听地址a1.sources.r1.bind = localhost# a1的监听端口a1.sources.r1.port = 44444# a1的输出目的地是控制台logger类型a1.sinks.k1.type = logger# a1的channel类型是memory内存型a1.channels.c1.type = memory# a1的channel总容量1000个event 默认为100a1.channels.c1.capacity = 1000# a1的channel传输时收集到了100条event以后再去提交事务a1.channels.c1.transactionCapacity = 100#声明source sink 和 channel 之间的关系#将r1和c1连接起来a1.sources.r1.channels = c1#将k1和c1连接起来 注意一个sink只能对应一个channela1.sinks.k1.channel = c1

在/opt/module/flume下启动

flume-ng agent --conf conf/ --name a1 --conf-file datas/netcatsource_loggersink.conf -Dflume.root.logger=INFO,console#或flume-ng agent -c conf/ -n a1 -f job/flume-netcat-logger.conf -Dflume.root.logger=INFO,console

- —conf/-c:表示配置文件存储在conf/目录

- —name/-n:表示给agent起名为a1

- —conf-file/-f:flume本次启动读取的配置文件是在job文件夹下的flume-telnet.conf文件。

- -Dflume.root.logger=INFO,console :-D表示flume运行时动态修改flume.root.logger参数属性值,并将控制台日志打印级别设置为INFO级别。日志级别包括:log、info、warn、error。

在另外一个ssh窗口中使用netcat发送消息

nc localhost 44444 #地址为配置文件中配置的地址#输入文字

4. 配置log4j.properties

vim /opt/module/flume/conf/log4j.properties#flume.root.logger=DEBUG,consoleflume.root.logger=INFO,LOGFILE #日志级别 和 输出位置flume.log.dir=./logs #log文件存放路径flume.log.file=flume.log #log文件名

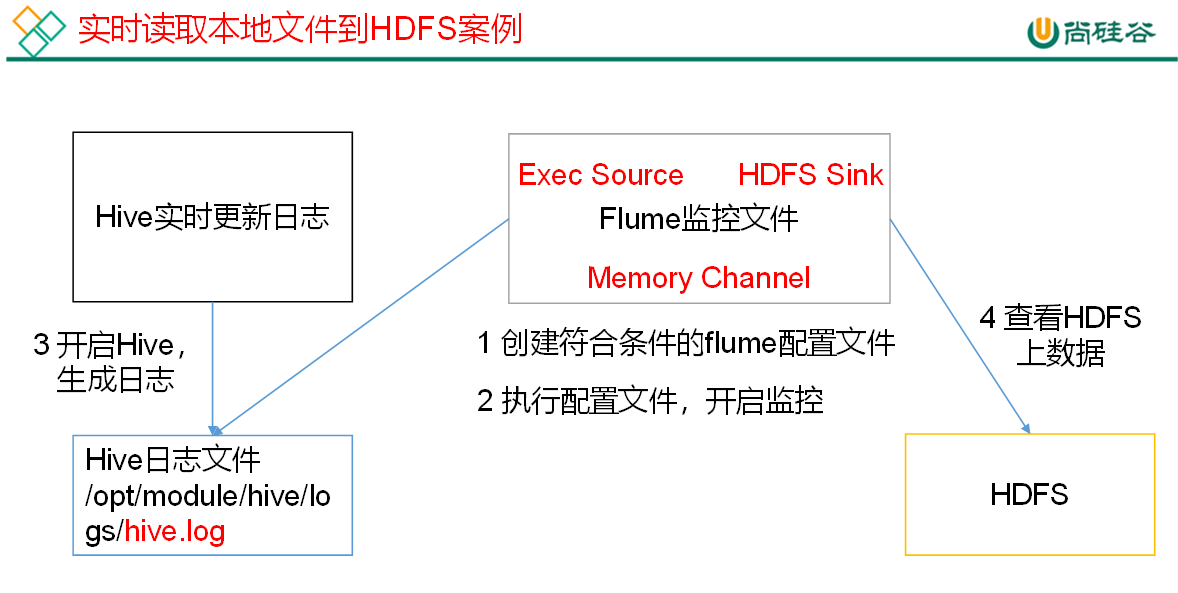

5. 实时监控单个追加文件到HDFS案例 exec

创建案例配置文件

cd /opt/module/flume/datastouch 123.logvim execsource_hdfssink.conf

a2.sources = r2a2.sinks = k2a2.channels = c2# 监听文件类型a2.sources.r2.type = exec# 监听命令a2.sources.r2.command = tail -F /opt/module/flume/datas/123.log#HDFS Sinka2.sinks.k2.type = hdfs#如果要使用时间转义序列 则需要开启本地时间戳 或者 在event中headers中带时间戳a2.sinks.k2.hdfs.path = hdfs://hadoop102:8020/flume/%Y%m%d/%H#上传文件的前缀a2.sinks.k2.hdfs.filePrefix = logs-#下面3个配置定义了多久时间单位创建一个新的文件夹#是否按照时间滚动文件夹a2.sinks.k2.hdfs.round = true#多少时间单位创建一个新的文件夹a2.sinks.k2.hdfs.roundValue = 1#重新定义时间单位a2.sinks.k2.hdfs.roundUnit = hour#是否使用本地时间戳a2.sinks.k2.hdfs.useLocalTimeStamp = true#积攒多少个Event才flush到HDFS一次a2.sinks.k2.hdfs.batchSize = 100#设置文件类型,可支持压缩a2.sinks.k2.hdfs.fileType = DataStream#多久生成一个新的文件 秒为单位a2.sinks.k2.hdfs.rollInterval = 60#设置每个文件的滚动大小 字节单位a2.sinks.k2.hdfs.rollSize = 134217700#文件的滚动与Event数量无关 0为禁用 也可以设置为指定数 当Event到达一定数量则文件滚动a2.sinks.k2.hdfs.rollCount = 0# Use a channel which buffers events in memorya2.channels.c2.type = memorya2.channels.c2.capacity = 1000a2.channels.c2.transactionCapacity = 100a2.sources.r2.channels = c2a2.sinks.k2.channel = c2

启动

cd ..

flume-ng agent -n a2 -c conf/ -f datas/execsource_hdfssink.conf -Dflume.root.logger=INFO,console

echo 123 >> /opt/module/flume/datas/123.log #写入内容测试 hdfs上是否创建文件

echo ccc >> /opt/module/flume/datas/123.log #等待60s 追内容 是否滚动文件生成新的采集文件

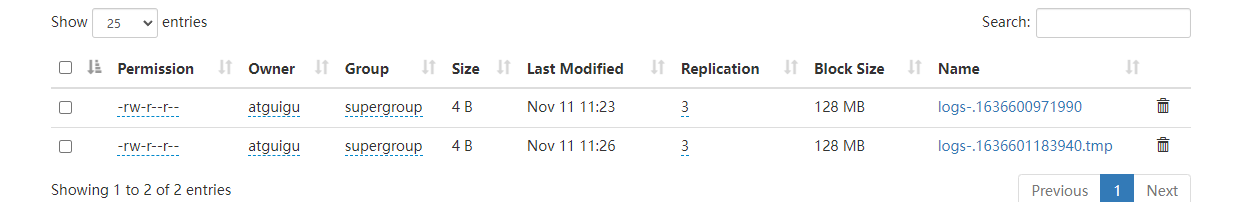

当前正在写入的文件为tmp 只有滚动文件后次缓存文件会修改为普通文件

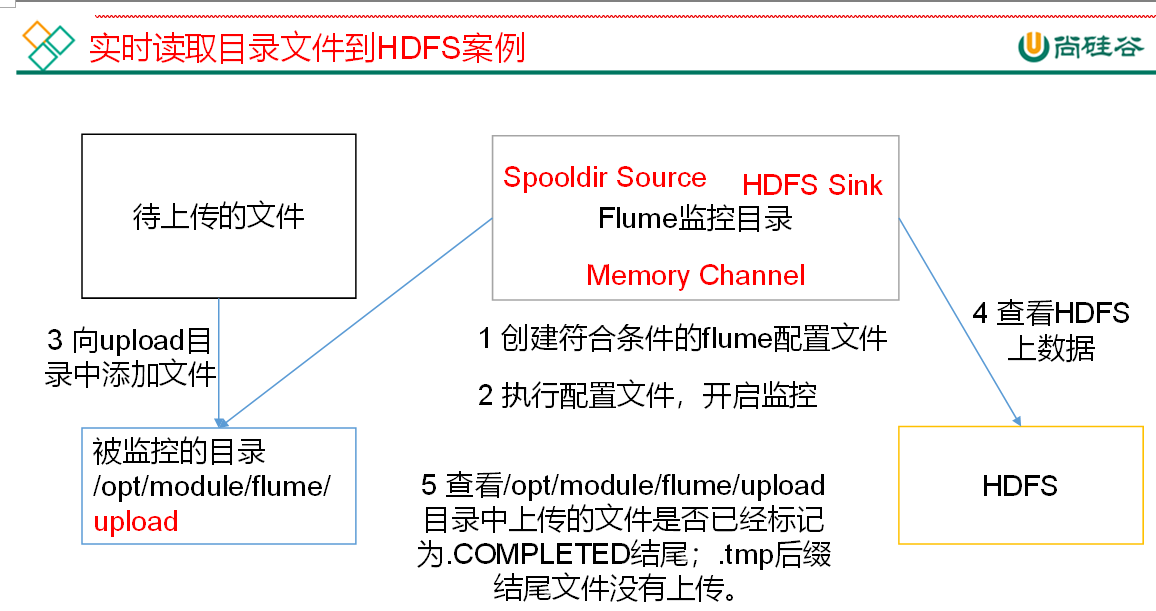

6. 实时监控目录下多个新文件到HDFS spooldir

cd /opt/module/flume/

mkdir upload

vim datas/flume-dir-hdfs.conf

配置文件

a3.sources = r3

a3.sinks = k3

a3.channels = c3

# Describe/configure the source

# 监听一个指定的文件夹 自动收集目录中的内容

a3.sources.r3.type = spooldir

#目录 目录下的文件名不能相同 否则抛异常

a3.sources.r3.spoolDir = /opt/module/flume/upload

#如果目录下的文件名读取完后 文件名相同 可以采取读取完后删除文件 默认为加后缀名

#设置为 immediate 读取完后删除 默认值为 never 保留

#a3.sources.r3.deletePolicy = immediate

#被读取完毕后的文件 后缀名被更改为 默认值为.COMPLETED

a3.sources.r3.fileSuffix = .COMPLETED

a3.sources.r3.fileHeader = true

#忽略所有以.tmp结尾的文件,不上传

a3.sources.r3.ignorePattern = ([^ ]*\.tmp)

# Describe the sink

a3.sinks.k3.type = hdfs

a3.sinks.k3.hdfs.path = hdfs://hadoop102:8020/flume2/upload/%Y%m%d/%H

#上传文件的前缀

a3.sinks.k3.hdfs.filePrefix = upload-

#是否按照时间滚动文件夹

a3.sinks.k3.hdfs.round = true

#多少时间单位创建一个新的文件夹

a3.sinks.k3.hdfs.roundValue = 1

#重新定义时间单位

a3.sinks.k3.hdfs.roundUnit = hour

#是否使用本地时间戳

a3.sinks.k3.hdfs.useLocalTimeStamp = true

#积攒多少个Event才flush到HDFS一次

a3.sinks.k3.hdfs.batchSize = 100

#设置文件类型,可支持压缩

a3.sinks.k3.hdfs.fileType = DataStream

#多久生成一个新的文件

a3.sinks.k3.hdfs.rollInterval = 60

#设置每个文件的滚动大小大概是128M

a3.sinks.k3.hdfs.rollSize = 134217700

#文件的滚动与Event数量无关

a3.sinks.k3.hdfs.rollCount = 0

# Use a channel which buffers events in memory

a3.channels.c3.type = memory

a3.channels.c3.capacity = 1000

a3.channels.c3.transactionCapacity = 100

# Bind the source and sink to the channel

a3.sources.r3.channels = c3

a3.sinks.k3.channel = c3

启动

flume-ng agent -n a3 -c conf/ -f datas/flume-dir-hdfs.conf -Dflume.root.logger=INFO,console

创建文本文件写入内容 移动到upload目录下

cd /opt/module/flume/

touch 123.log

echo eee >> 123.log

cp 123.log upload/

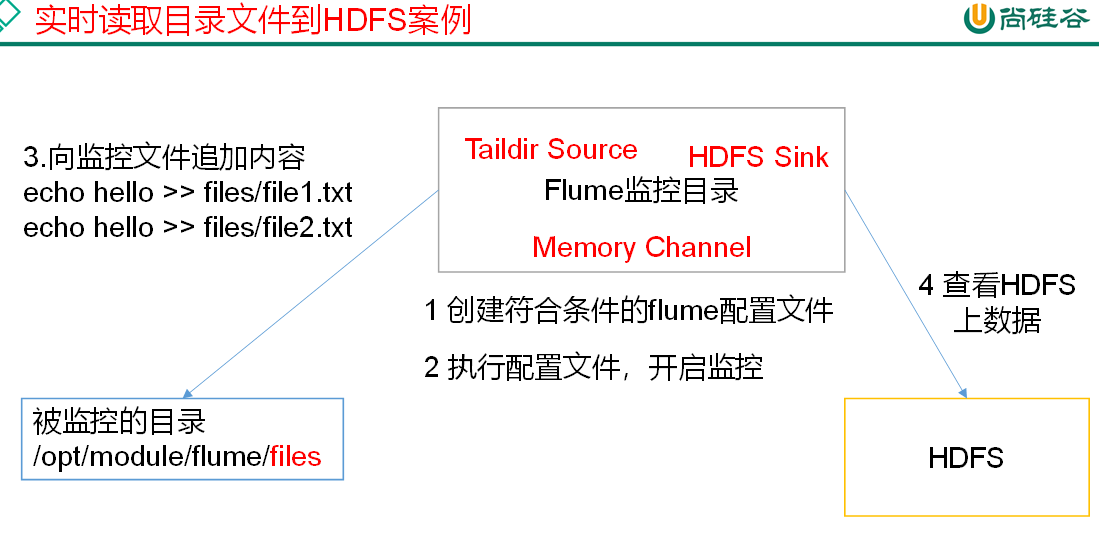

7. 实时监控目录下的多个追加文件 taildir

我们使用exec 读取单个文件追加内容时 如果flume挂掉后重新启动 会把文件从头到尾重新读取一遍 这是我们不希望的 而taildir读取多个文件追加内容时 会在positionFile 指定的json文件下 保留读取过的文件位置 当flume挂掉重新上线后 读取json文件记录的位置 继续监控读取内容

cd /opt/module/flume/

mkdir files

vim datas/flume-taildir-hdfs.conf

配置文件

a3.sources = r3

a3.sinks = k3

a3.channels = c3

# Describe/configure the source

#sources类型

a3.sources.r3.type = TAILDIR

#taildir保存读取文件内容的位置 如果发生宕机会从该文件中读取上次读取到位置 默认为~/.flume/taildir_position.json

a3.sources.r3.positionFile = /opt/module/flume/tail_dir.json

#定义组 不同组 指向不同文件 多个组之间空格隔开

a3.sources.r3.filegroups = f1 f2

#f1组 监控指定目录下名字包含file的文件 正则表达式

a3.sources.r3.filegroups.f1 = /opt/module/flume/files/.*file.*

#f2组 监控指定目录下名字包含的log的文件

a3.sources.r3.filegroups.f2 = /opt/module/flume/files/.*log.*

# Describe the sink

a3.sinks.k3.type = hdfs

a3.sinks.k3.hdfs.path = hdfs://hadoop102:8020/flume/upload2/%Y%m%d/%H

#上传文件的前缀

a3.sinks.k3.hdfs.filePrefix = upload-

#是否按照时间滚动文件夹

a3.sinks.k3.hdfs.round = true

#多少时间单位创建一个新的文件夹

a3.sinks.k3.hdfs.roundValue = 1

#重新定义时间单位

a3.sinks.k3.hdfs.roundUnit = hour

#是否使用本地时间戳

a3.sinks.k3.hdfs.useLocalTimeStamp = true

#积攒多少个Event才flush到HDFS一次

a3.sinks.k3.hdfs.batchSize = 100

#设置文件类型,可支持压缩

a3.sinks.k3.hdfs.fileType = DataStream

#多久生成一个新的文件

a3.sinks.k3.hdfs.rollInterval = 60

#设置每个文件的滚动大小大概是128M

a3.sinks.k3.hdfs.rollSize = 134217700

#文件的滚动与Event数量无关

a3.sinks.k3.hdfs.rollCount = 0

# Use a channel which buffers events in memory

a3.channels.c3.type = memory

a3.channels.c3.capacity = 1000

a3.channels.c3.transactionCapacity = 100

# Bind the source and sink to the channel

a3.sources.r3.channels = c3

a3.sinks.k3.channel = c3

启动

flume-ng agent -n a3 -c conf/ -f datas/flume-taildir-hdfs.conf -Dflume.root.logger=INFO,console

测试

cd files

echo hello >> file1.txt

echo atguigu >> log.txt

#关闭flume 重新启动 查看是否还读取 aaa 和 bbb 字段