听课总结的PPT,非常重要第一章.pptx

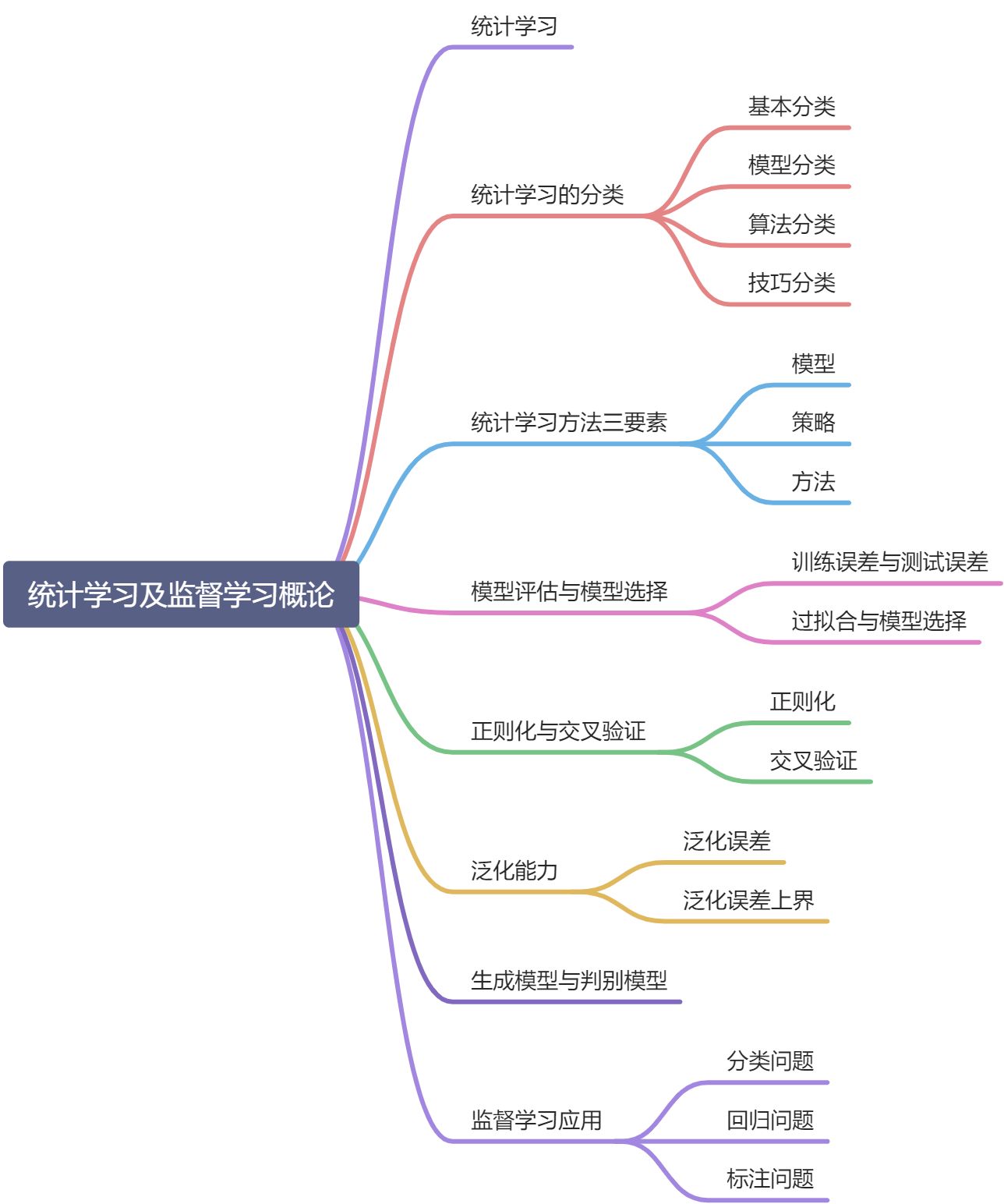

一、统计学习的分类

1.1基本分类

统计学习或机器学习一般包括监督学习、无监督学习、强化学习。有时还包括半监督学习、主动学习。

1.1.1监督学习

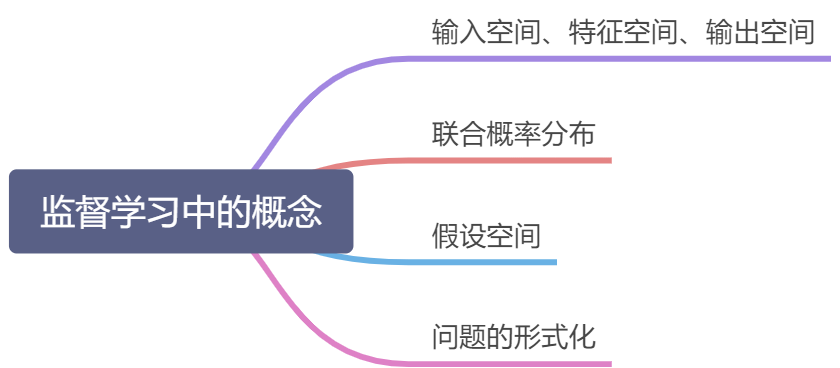

一、输入控件、输出空间、特征空间

- 输入空间:输入值所有可能取值的集合称为输入空间

- 输出空间:输出值所有可能取值的集合称为输出空间

- 特征空间:每个具体的输入是一个实例,通常用特征向量表示,所有特征向量存在的空间称为特征空间。例:输入实例

的特征向量记作

二、联合概率分布

联合概率分布:监督学习假设输入与输出的随机变量和

遵循联合概率分布

,

表示分布函数或者分布密度函数

三、假设空间

四、问题的形式化

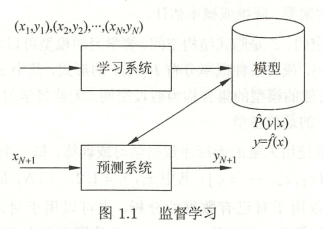

监督学习有学习和预测两个过程,使用训练集学习得到模型,然后使用测试集进行预测。输入是带有标注的数据集

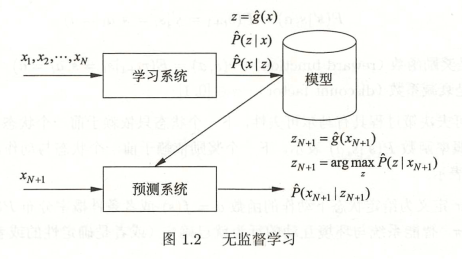

1.1.2无监督学习

1.1.3强化学习

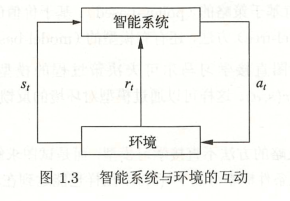

强化学习:指智能系统在与环境的连续互动中学习最优行为策略的机器学习问题。

智能系统根据环境给的(状态)和

(奖励)采取动作

;

环境根据智能系统给的动作决定下一个状态

和奖励

。

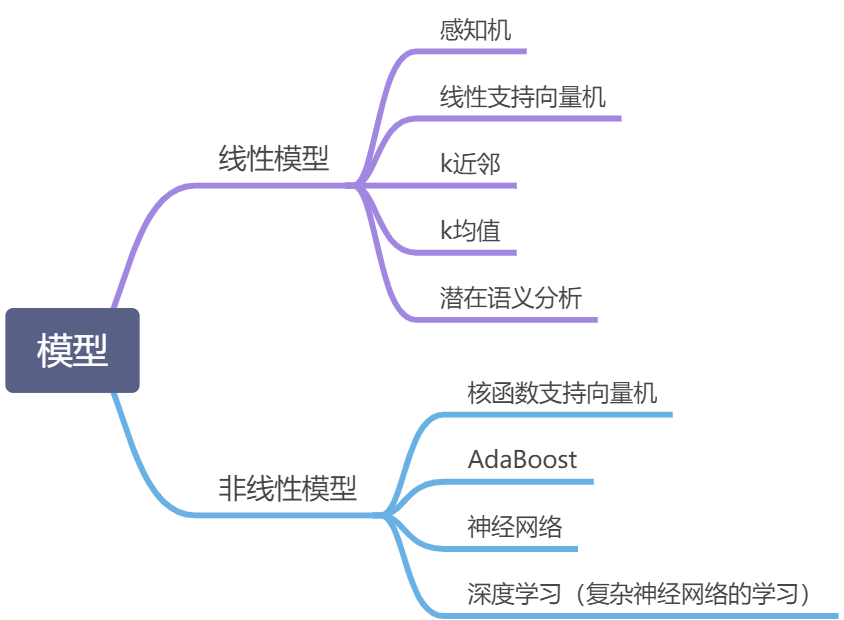

1.2按模型分类

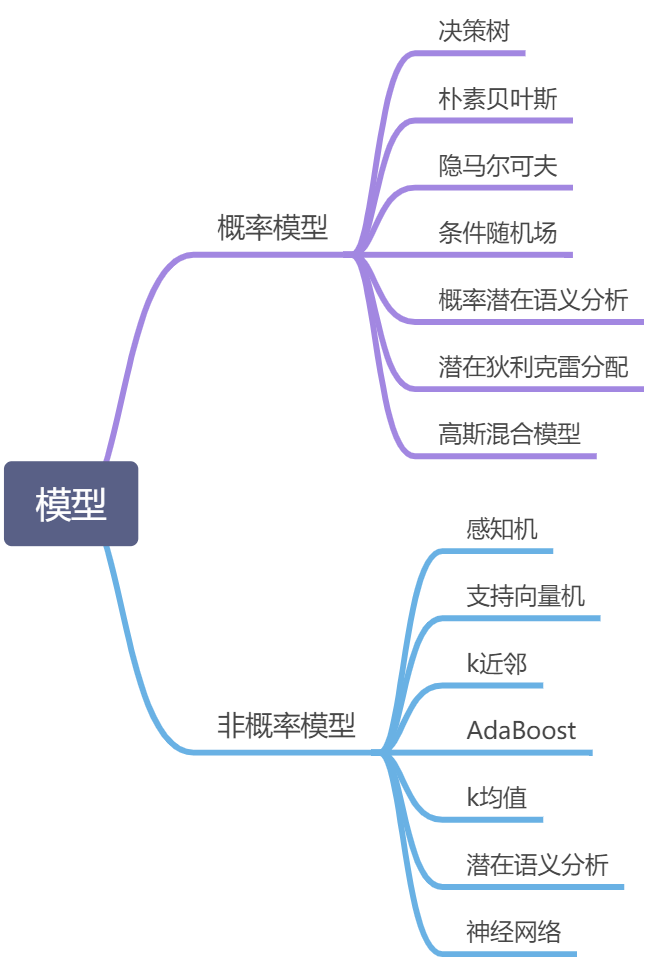

1.2.1概率(条件概率)与非概率(函数形式)模型

监督学习的概率模型的条件概率分布形式为,非概率模型模型取函数形式

,监督学习中的概率模型是生成式模型,非概率模型是判别模型。

非监督学习的概率模型的条件概率分布形式为,非概率模型取函数形式为

。

联合概率分布的基本概率公式规则:

1.2.2线性模型和非线性模型

1.2.3参数化模型和非参数化模型

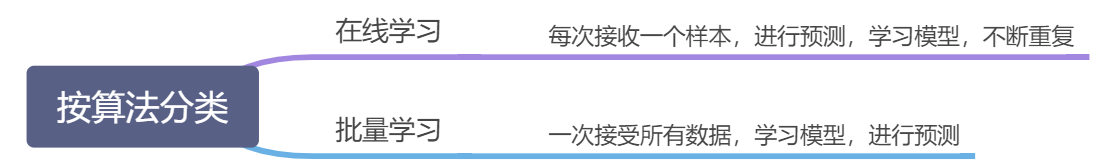

1.3按算法分类

1.4按技巧分类

1.4.1贝叶斯学习

其中为后验概率,

为先验概率,

是似然函数。

模型估计时,估计整个后验概率,通常取后验概率最大的模型。

预测时,计算数据对后验概率分布的期望值:

这里是新样本。

贝叶斯学习链接

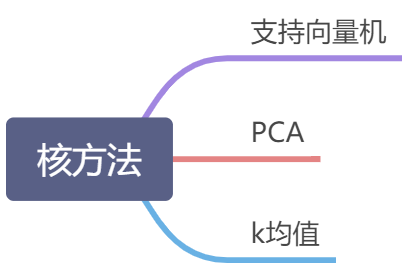

1.4.2核方法

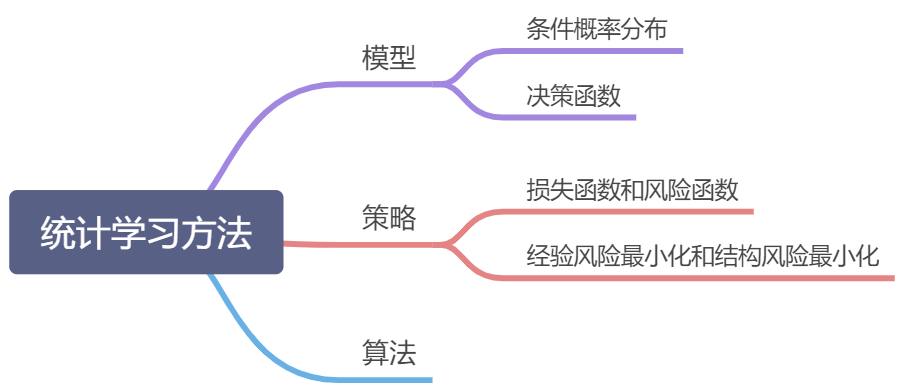

二、统计学习三要素

2.1策略

2.1.2损失函数和风险函数

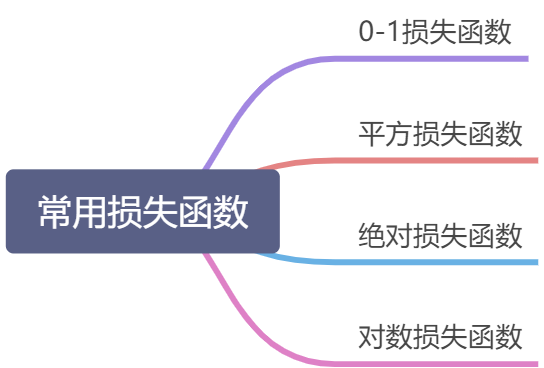

监督学习中在假设空间中选取模型

作为决策函数,输出的预测值

与真实值

可能一致也可能不一致,使用损失函数或代价函数来度量预测错误的程度。损失函数值越小,模型就越好。

由于模型的输入、输出

由于模型的输入、输出是随机变量,遵循联合分布

,所以损失函数的期望是:

这是理论上模型关于联合分布

的平均意义下的损失,称为风险函数或期望损失。

例如:

给定一个训练数据集,模型

关于训练数据集的平均损失称为经验风险或经验损失,记作

:

期望风险是模型关于联合分布的期望损失,经验风险

是模型关于训练样本集的平均损失。根据大数定律,当样本容量

时,经验风险

趋近于期望风险

。

2.1.2经验风险最小化和结构风险最小化

经验风险最小化策略认为:经验风险最小的模型是最优的模型

这个策略在数据量很大的时候比较准确(因为经验风险趋近于期望风险),但在数据量较少的时候,容易产生过拟合现象。

结构风险最小化:为了防止过拟合提出来的策略,结构风险最小化等价于正则化,结构风险 = 经验风险 + 表示模型复杂度的正则化项或惩罚项。

贝叶斯估计中的最大后验概率估计就是结构风险最小化的一个例子。

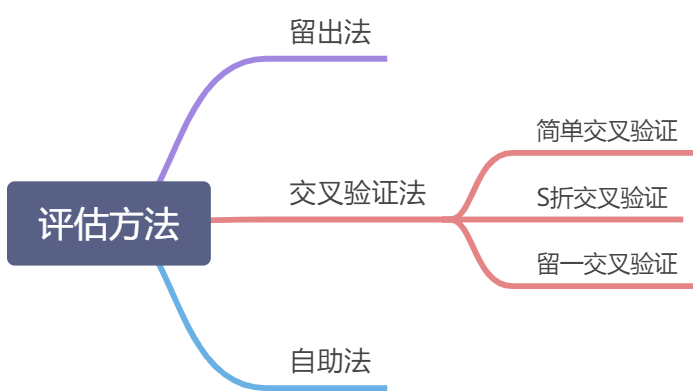

三、模型评估与模型选择

3.1训练误差与测试误差

监督学习中,训练数据集与真实数据集不同的训练误差:

测试数据集(预测)与真实数据集不同的测试误差:

3.2过拟合与模型选择

过拟合:如果一味地追求提高对训练数据的预测能力,所选模型的复杂度往往会比真模型更高,这种现象称为过拟合。对已知的数据预测的很好,对未知数据预测的很差。

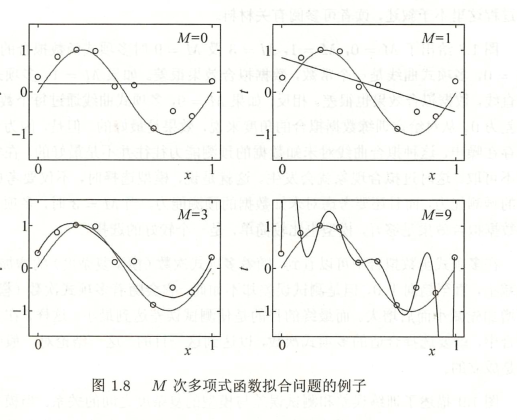

例子:多项式函数的拟合问题为例,说明过拟合与模型选择,这是一个回归问题。

假设给定一个训练数据集:,根据给定的数据拟合M次多项式函数。假定图中所示的10个数据点,用0~9次多项式函数对数据进行拟合。

M次多项式的形式为:

解决步骤: