Li, Hongyang, et al. “Finding task-relevant features for few-shot learning by category traversal.” Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2019.

论文:链接

代码:https://github.com/Clarifai/few-shot-ctm

关键词: **“Category Traversal”

更详细可以参考我的另一篇笔记——> **https://www.yuque.com/weijiawu/research/vt83eg

Introduction

背景:近年来一些metric-learning的方法学习feature相似度在test example和training example上。作者认为这些approaches 对待training example的例子单独,而不是看成一个entire task。因此这个限制了testing的时候,模型使用的是同一组feature,这就阻碍了区分当前任务最相关的维度能力。

解决办法:因此论文中提出了一种 Category Traversal Module,这个模块遍历整个entire support,根据特征空间中的类内唯一性和类间的唯一性来识别与任务相关的特征。

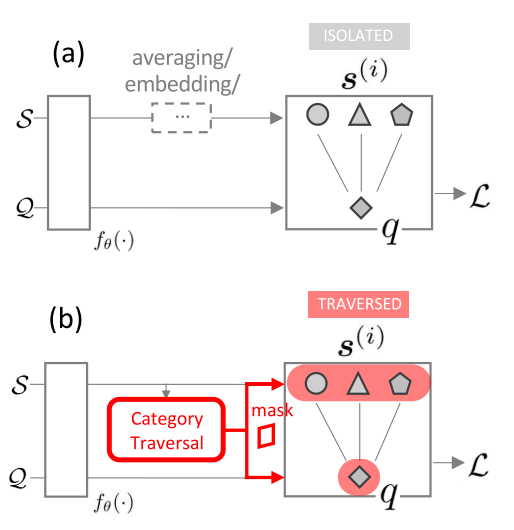

The proposed method和之前的方法存在的区别如上图所示:(a)表示传统的few-shot,直接将query 和 support based的feature做一个相似度的对比,很简单粗暴 (b)提出的Category Traversal Module遍历所有的categories去寻找task-relevant features.

Methodology

To which category in the support set does query belong?

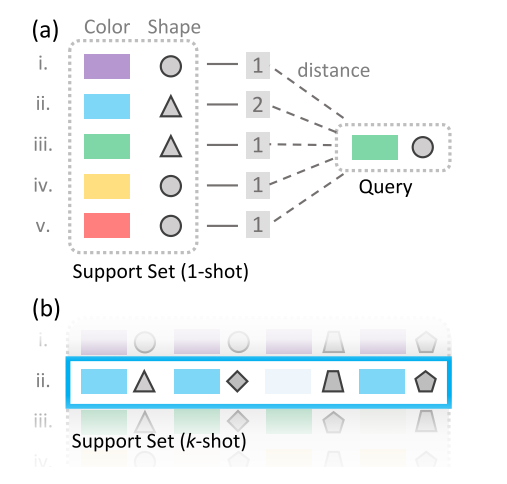

那什么特征是相关的呢,或者有效的?如上图(a)所示,在这里query是一个绿色的圆,可以看出suppor set相比query有一个unique feature: 颜色,但是他的shape是相同的,因此在这里这个relevant feature就是color。但是对于先前的method是很难知道which dimension (color or shape) is more relevant。在这个算法里面,是通过遍历entire support set去搜索discriminating dimension。inter-class uniqueness。

对于上图的(b),我们更清楚的可以看出来在class内部,颜色大多数是相同的,但是shape是不同的,因此这个相关特征也可以用intra-class commonality去寻找到。

因此为了实现寻找这个discriminating dimension,论文中提出了一种category traversal module (CTM),去提取更高效的特征,通过遍历类别内和类别间的feature dimensions。CTM包括一个concentrator unit 去提取一个class内的embeddings for commonality,和一个**projector unit去提出class之间的uniqueness。

[1] Russakovsky, Olga, et al. “Imagenet large scale visual recognition challenge.” International journal of computer vision 115.3 (2015): 211-252.