3.2 Logistic/Softmax Regression

LR预测公式和损失函数公式是什么?

预测公式为:

LR的梯度下降迭代的公式是什么?

*softmax采用交叉熵损失的梯度下降迭代公式的推导过程?

*softmax函数在数值计算时的溢出是什么意思?

本质上是计算机在表示实数时会有一定的误差,在计算时,误差累积导致结果错误。

下溢:接近为0的数被四舍五入为0,从而导致除法错误

上溢:较大的数被近似为无穷大,引发上溢

以softmax为例,其公式为,假如假如xj是一个极小的数,那么exp会发生下溢,认为exp(xj)=0,从而导致分母可能为0,出现NaN;而如果xi很大,exp(xi)=inf,从而导致上溢,出现NaN。

详见《deep learning》第四章 数值计算

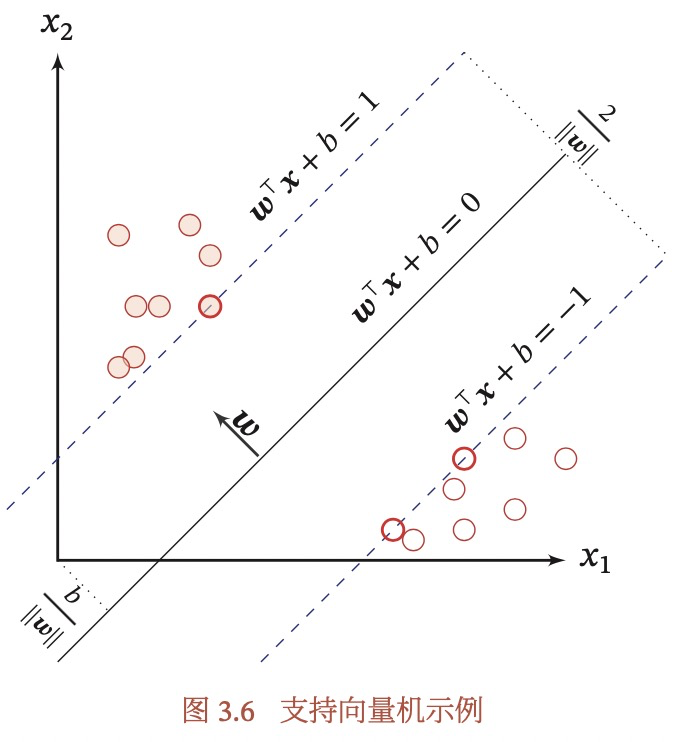

3.5 SVM

描述一下SVM?SVM的loss和参数迭代公式?

SVM是寻找一个使得间隔最大的分割超平面,间隔是指数据集D中样本到分割超平面的最小距离。

怎么理解SVM的核函数?

怎么理解SVM的软间隔?

如何理解拉格朗日乘子法?

https://www.matongxue.com/madocs/939/

https://www.bilibili.com/video/BV1Ht4y1v7FQ