本地部署 Llama 3(包含中文版本)

以下版本为 Win 系统

Mac 操作方式一致,命令需要在终端中运行;

Ollama Github 主页

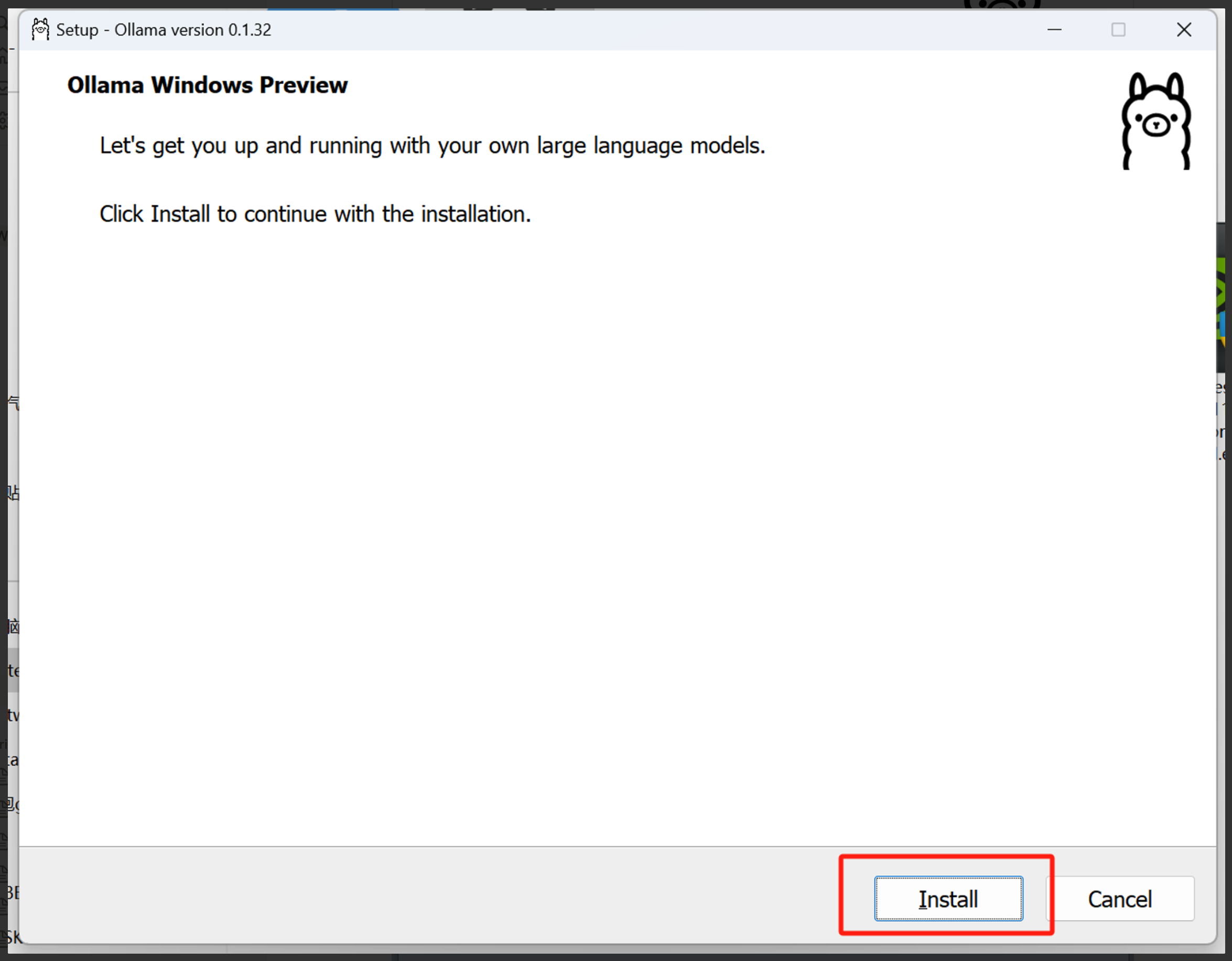

首先需要下载安装一个 Ollama 平台

下载后解压安装,安装过程就不展示了

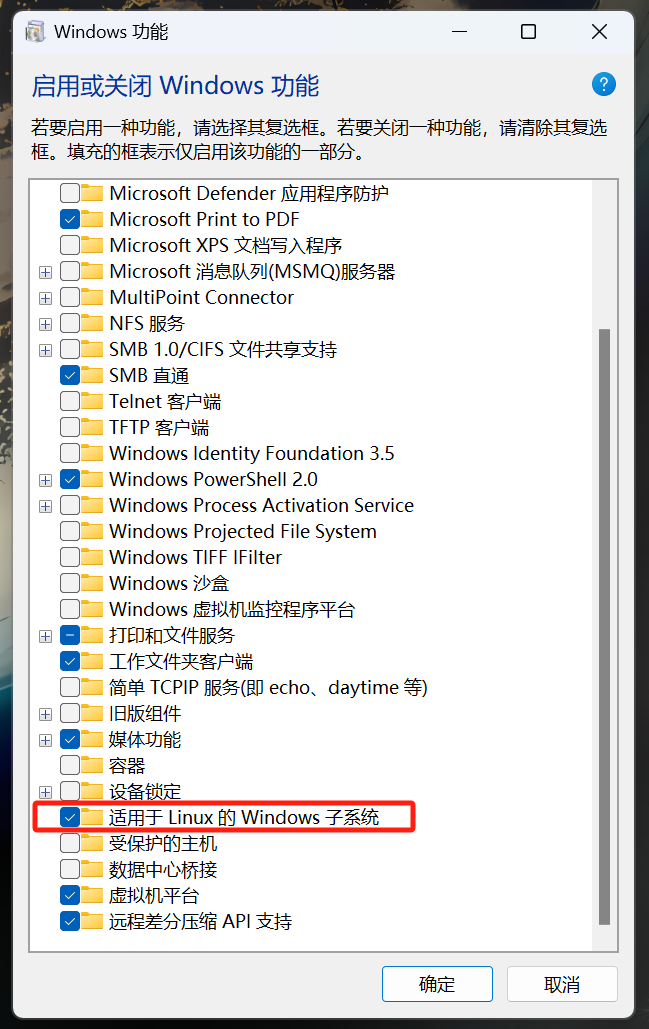

搜索电脑里的 启用或关闭 windows 功能

打开适用于 linux 的 windows 子系统,并重启电脑

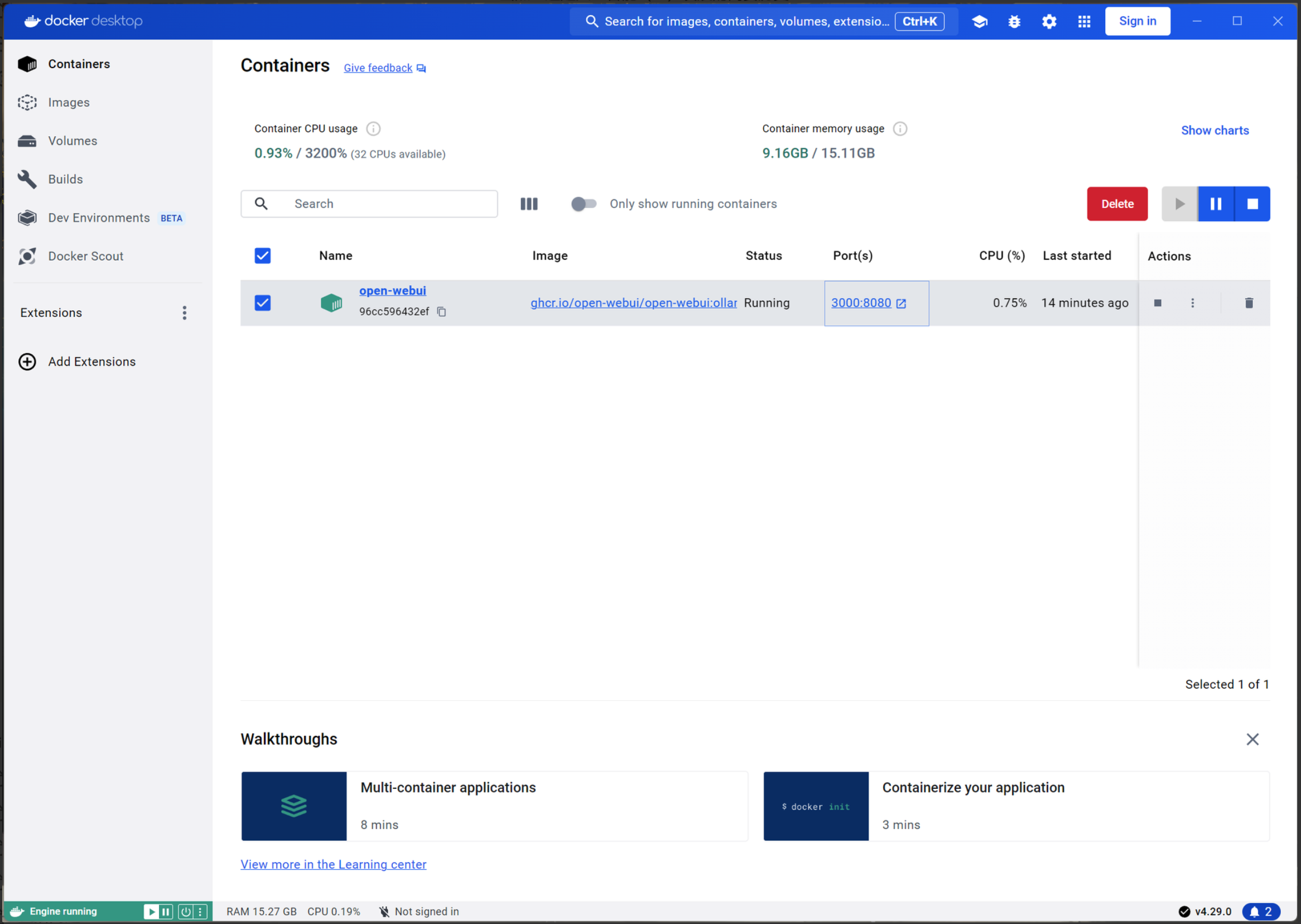

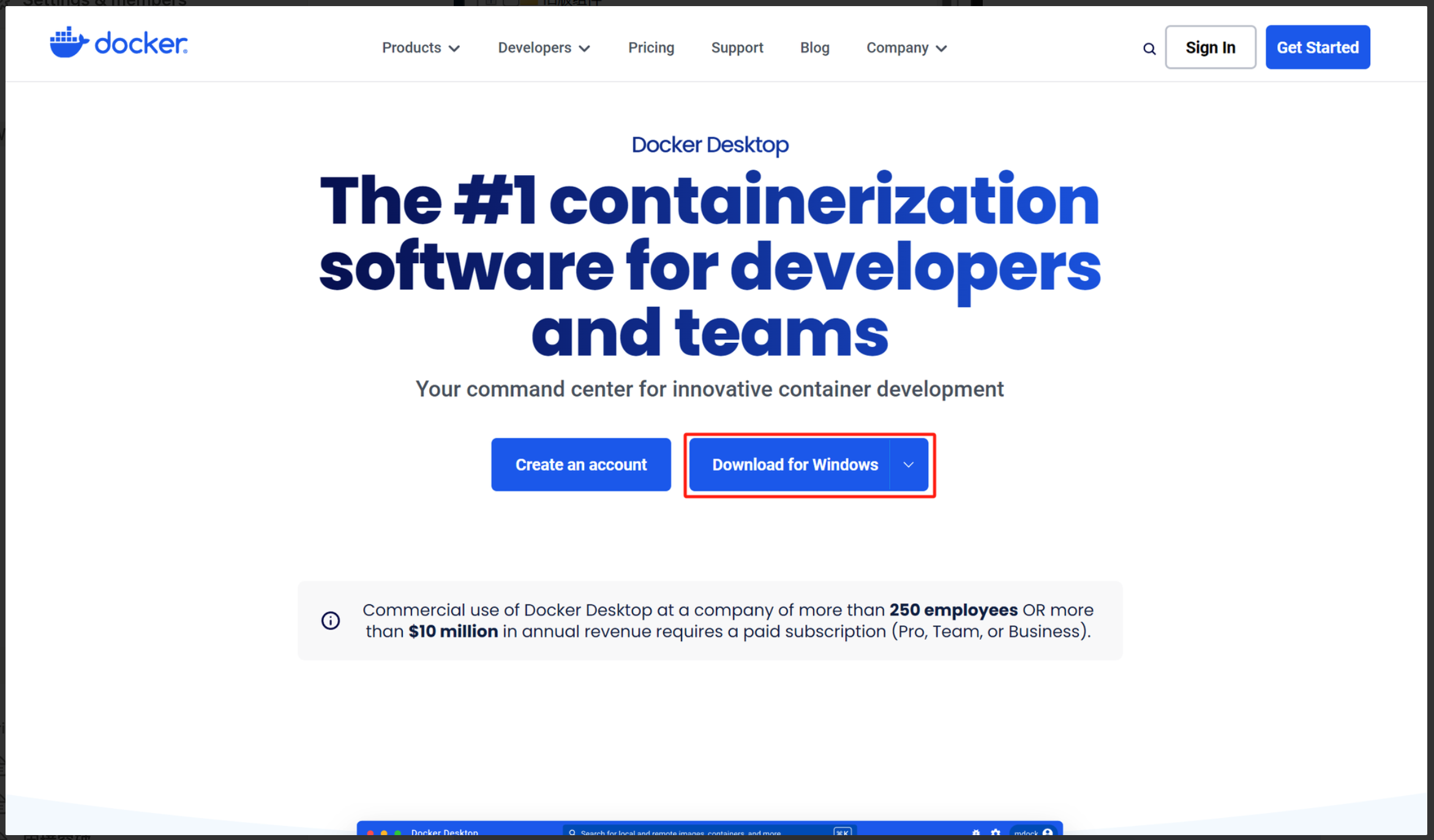

重启电脑后,安装 Docker 桌面

Docker Desktop: The #1 Containerization Tool for Developers | Docker

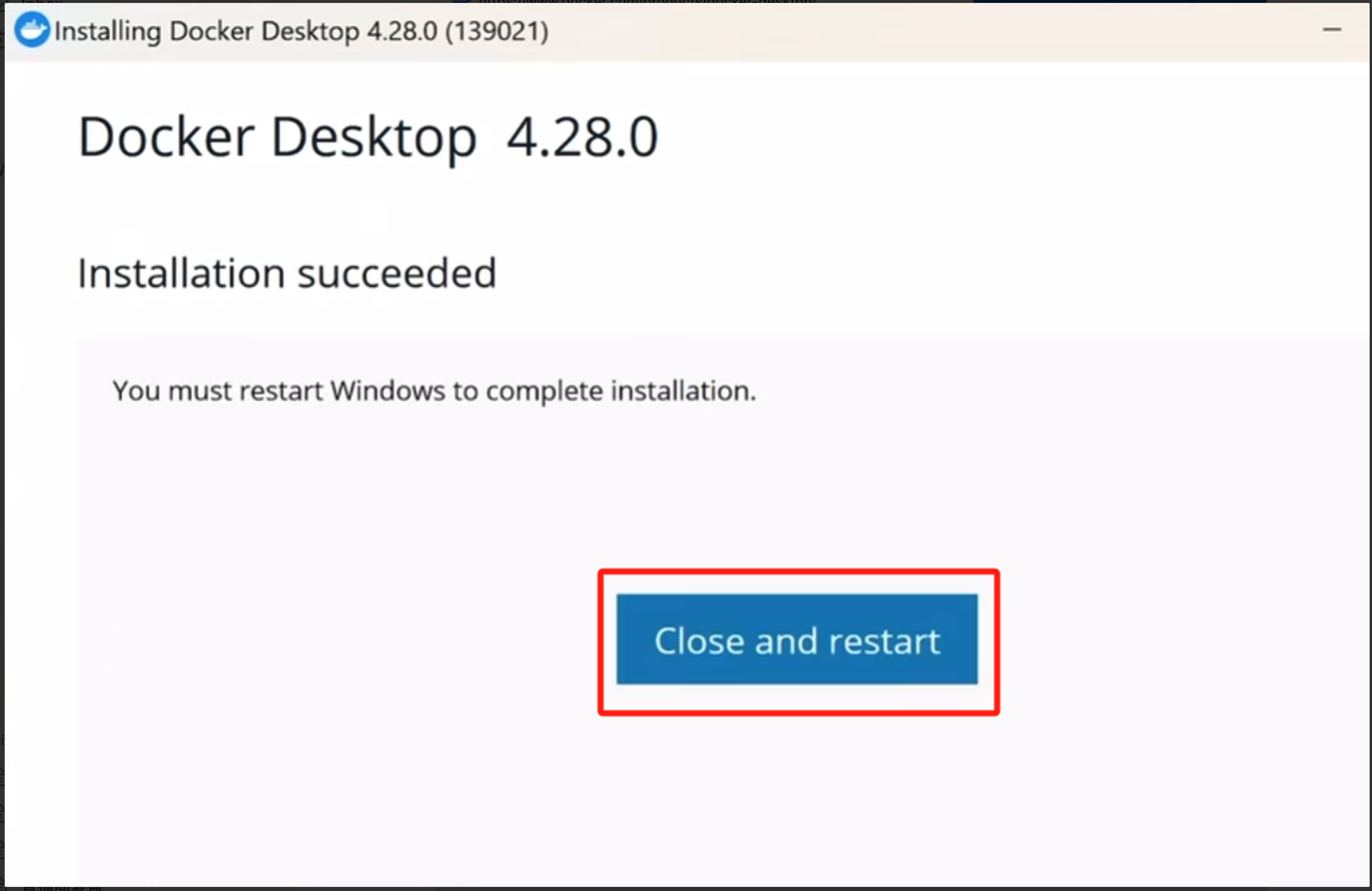

安装好后,需要再次重启电脑

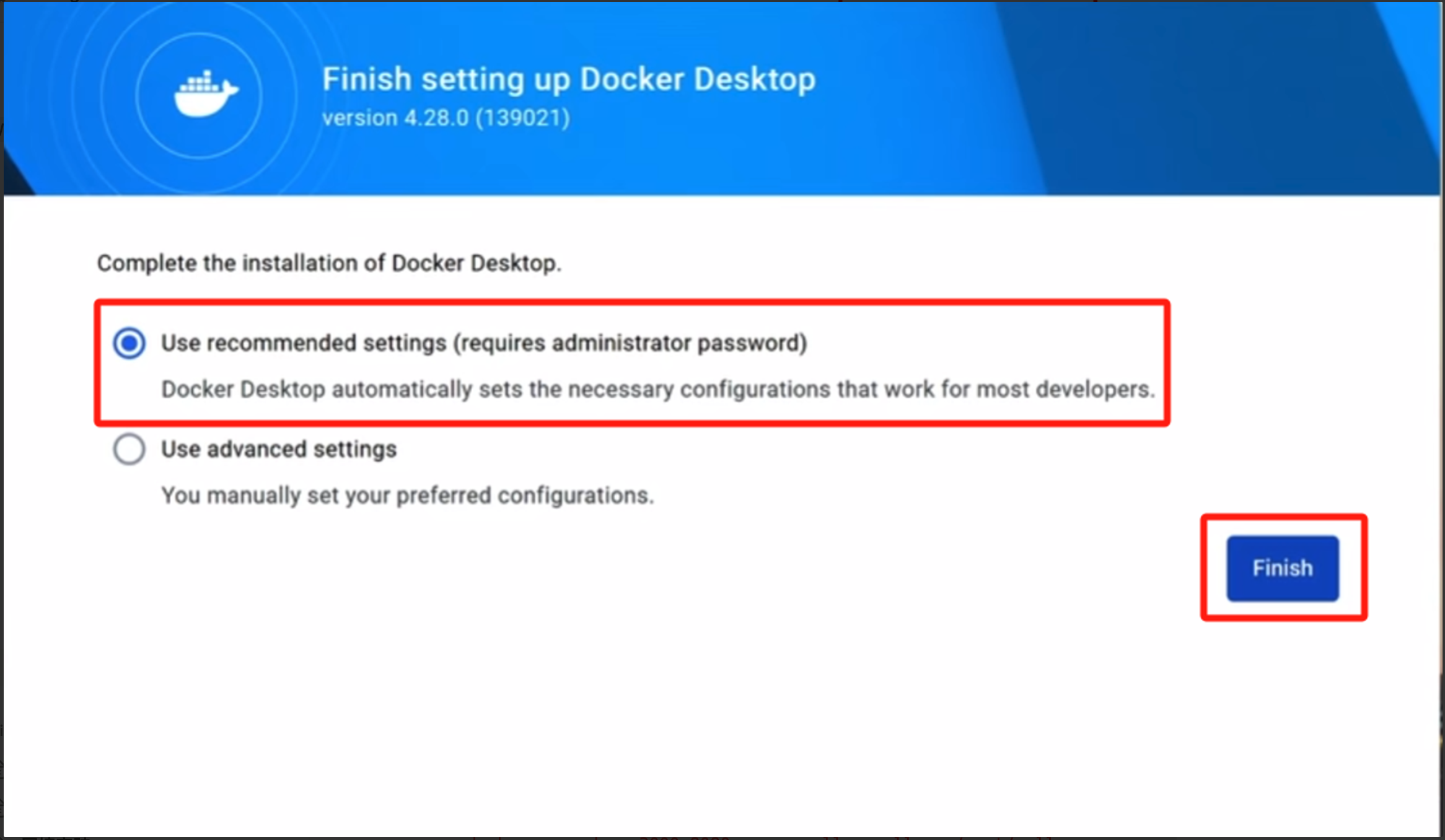

重启后。继续安装

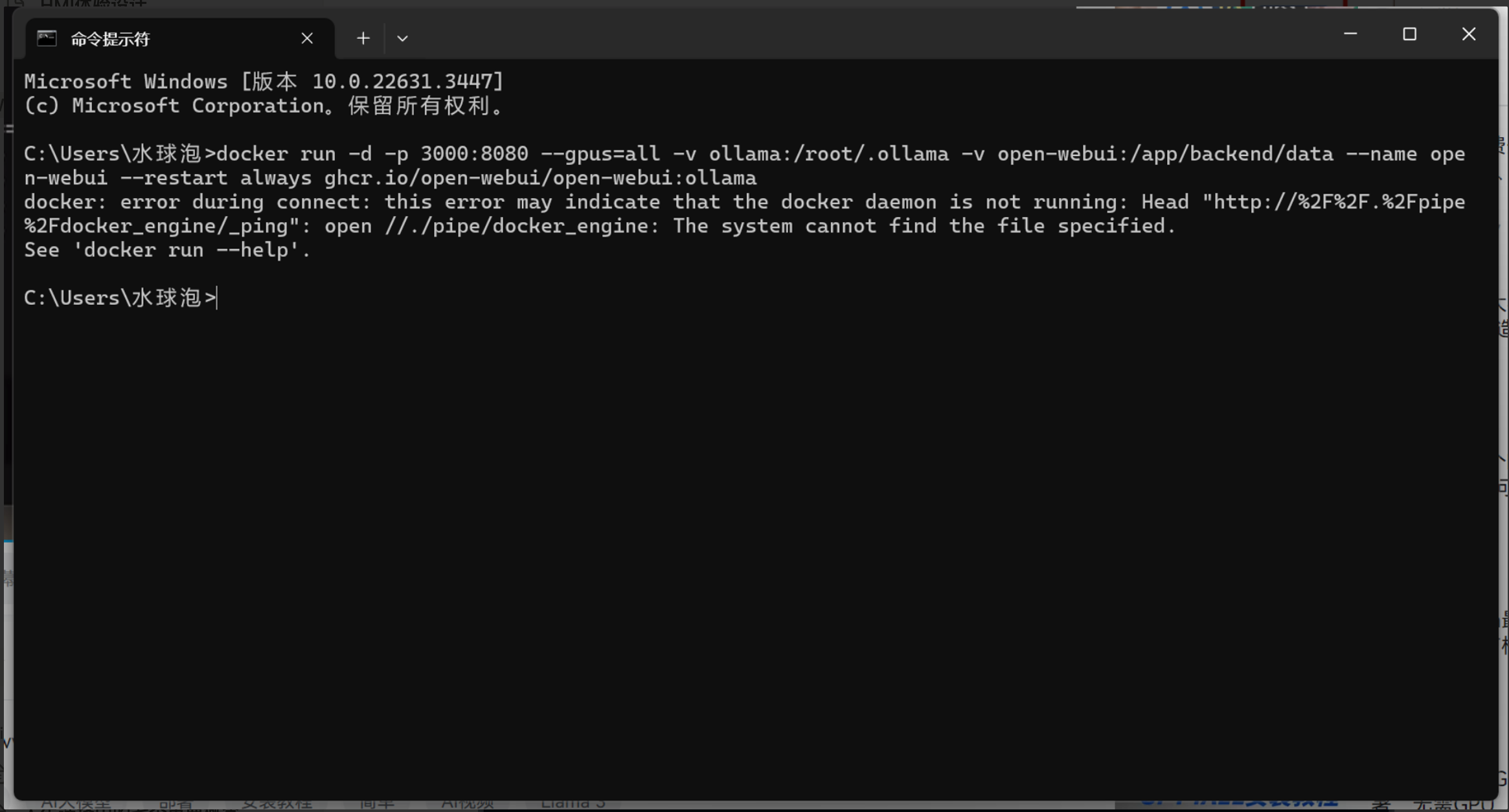

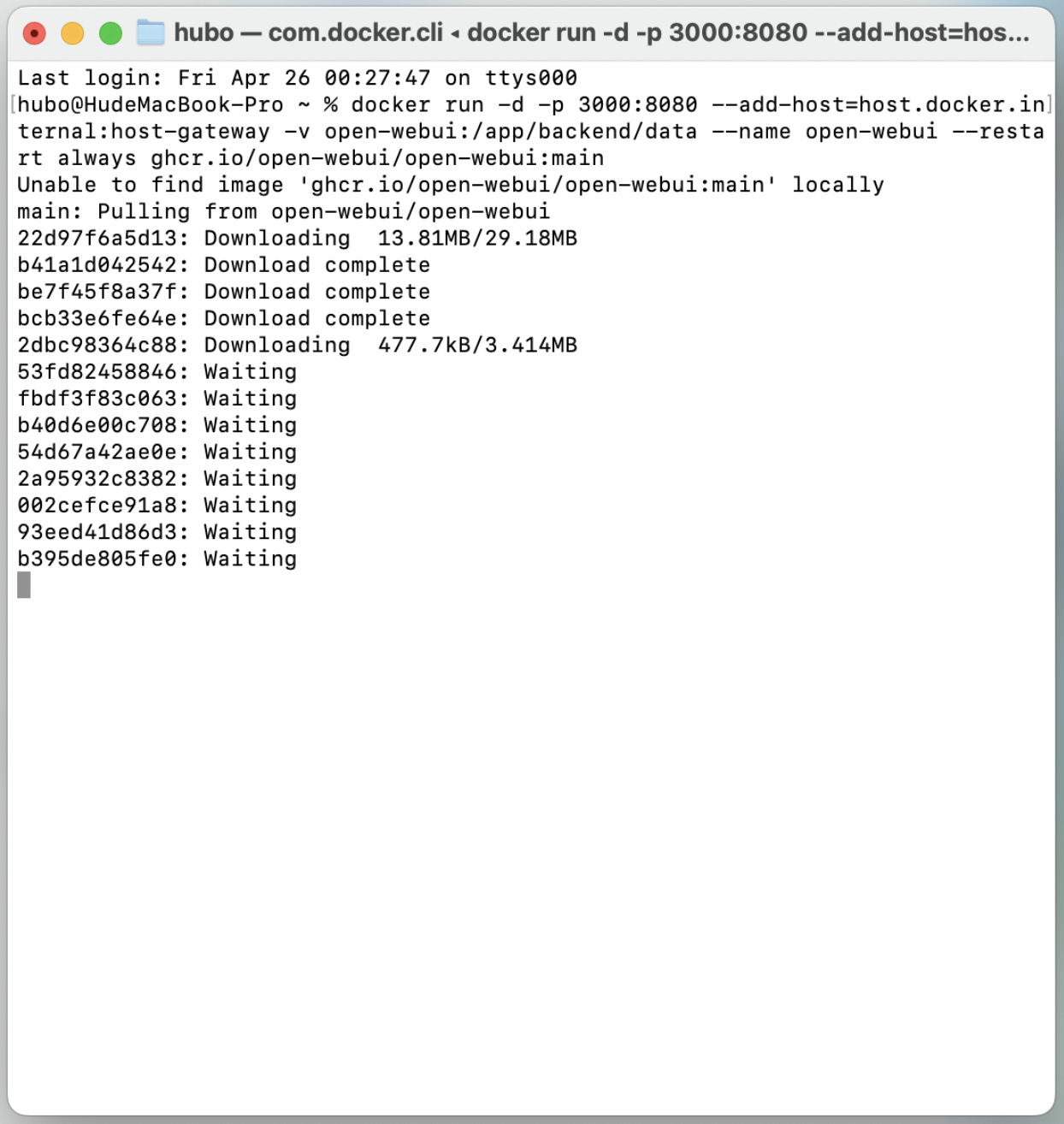

安装完成后,启动电脑命令提示符,输入一下命令。进行安装(Win系统)

大概下载时间为,10分钟左右

其实这一步只是为了,可以有一个类似ChatGPT的对话UI界面

官方具体说明如下:

GitHub - open-webui/open-webui: User-friendly WebUI for LLMs (Formerly Ollama WebUI)

docker run -d -p 3000:8080 --gpus=all -v ollama:/root/.ollama -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:ollama

Mac 系统如下。在终端中运行

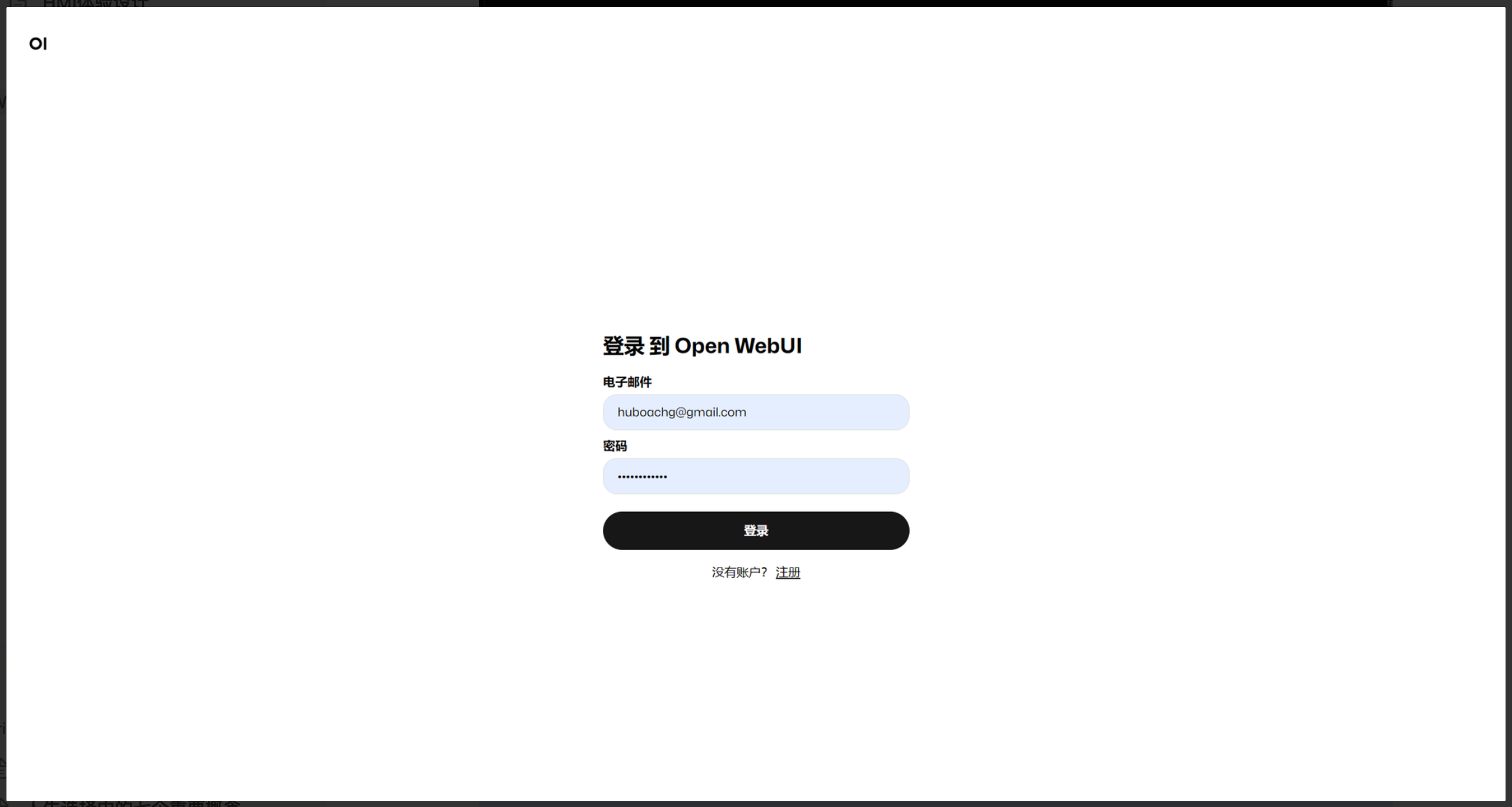

安装完成,打开地址 http://127.0.0.1:3000

任何邮箱都可以注册 OpenWebUI

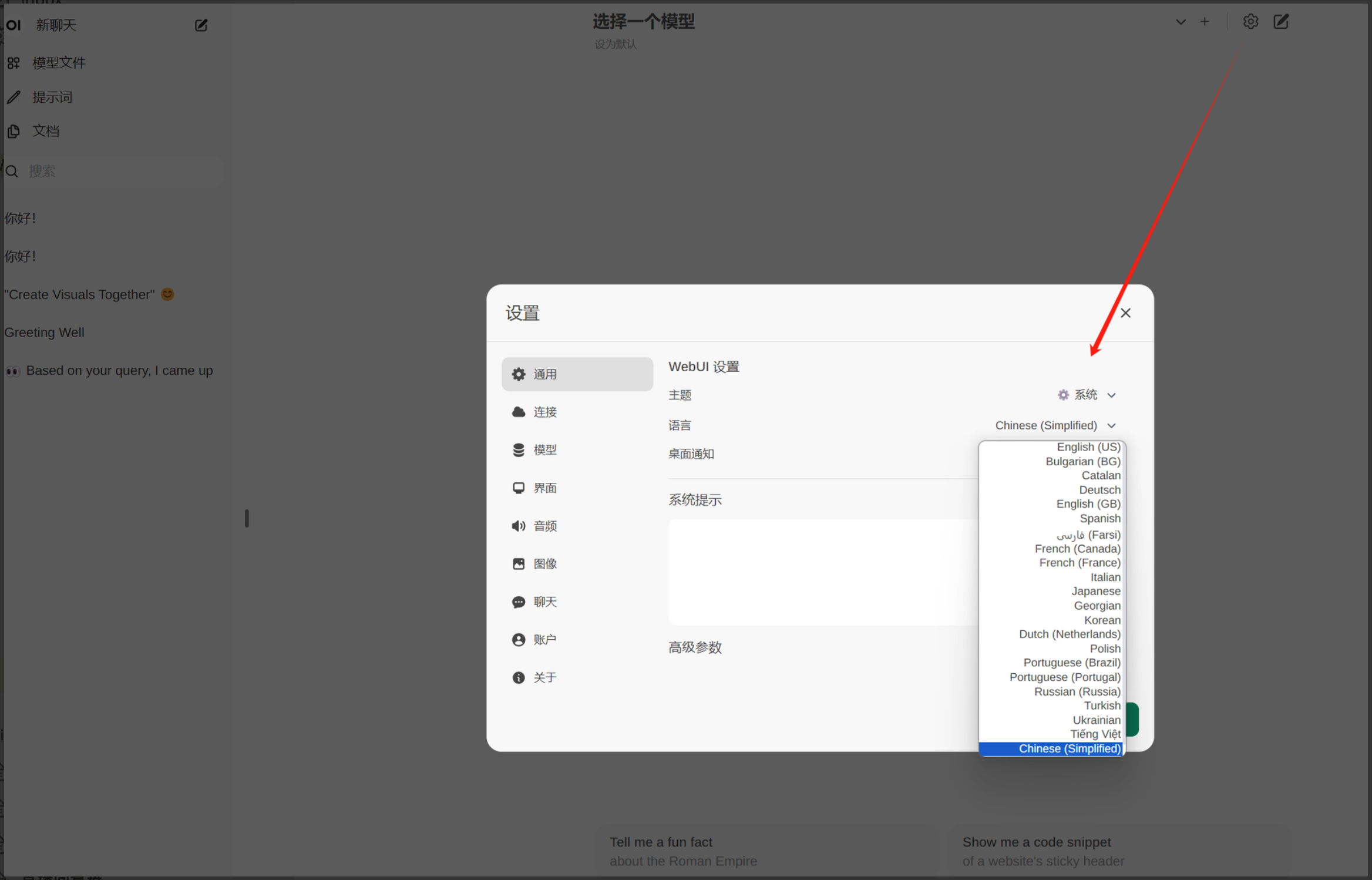

登录后,可切换语言

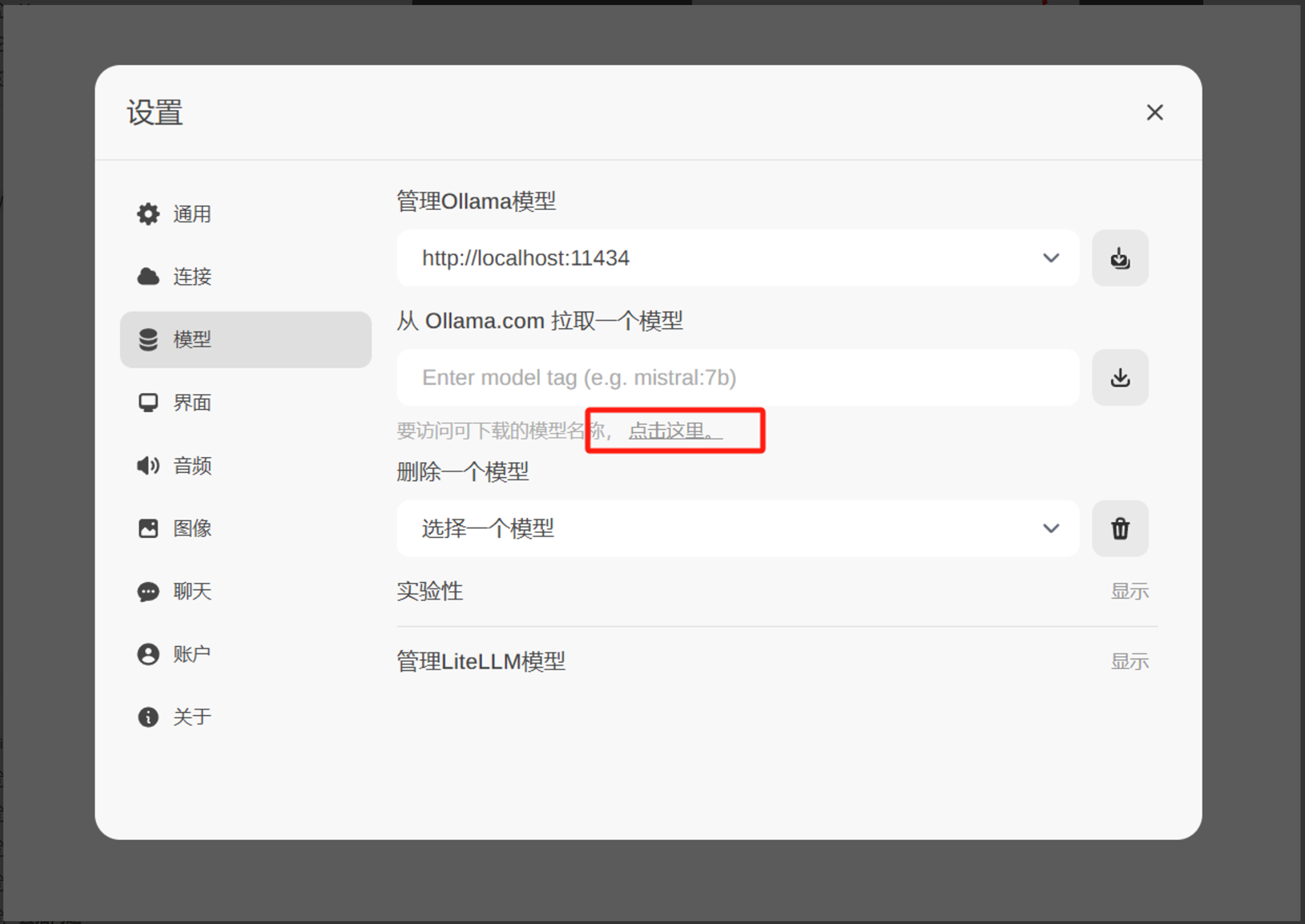

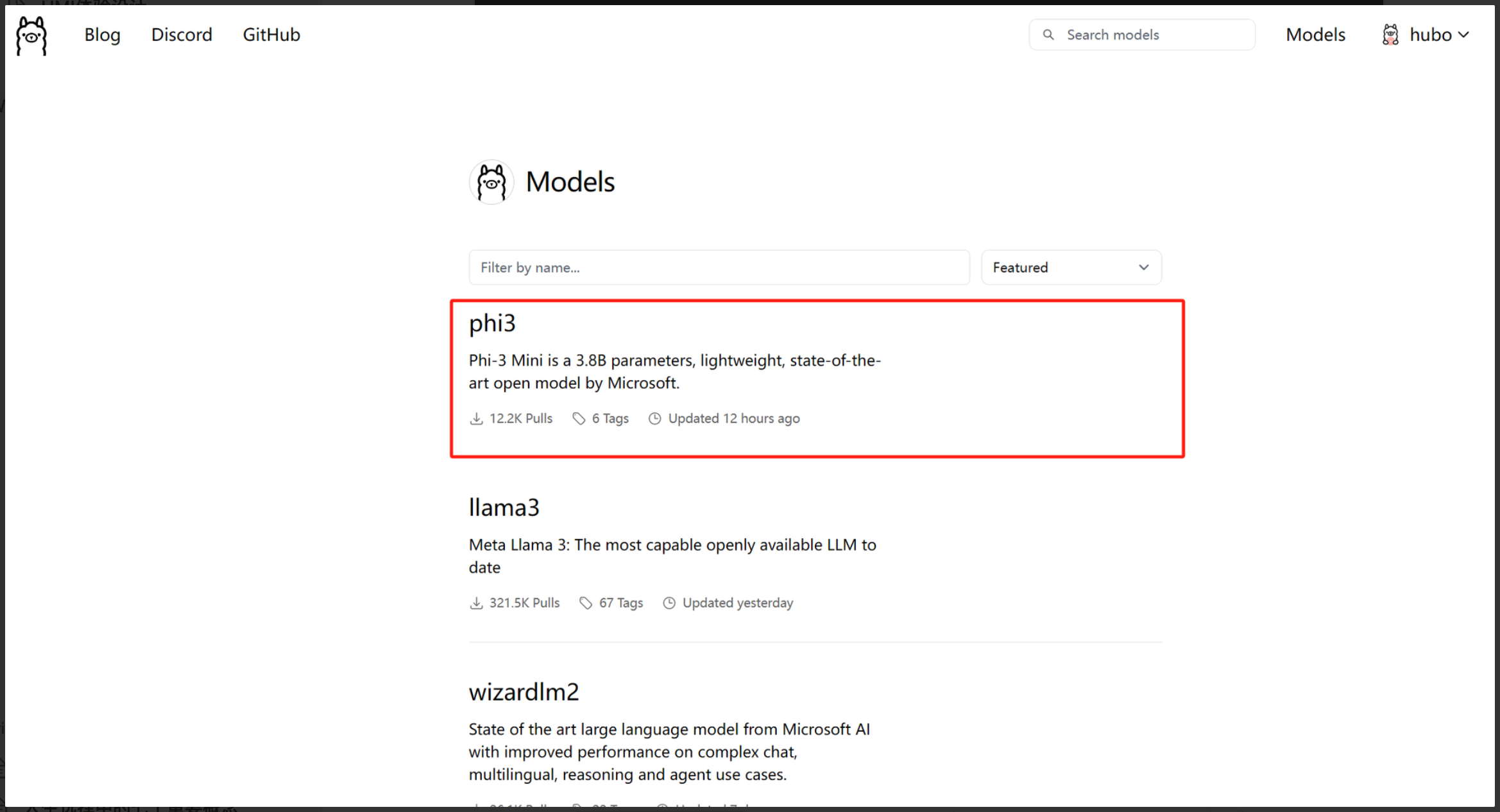

切换到模型,搜索模型

目前国内外市场上主流开源模型这里都可以找到

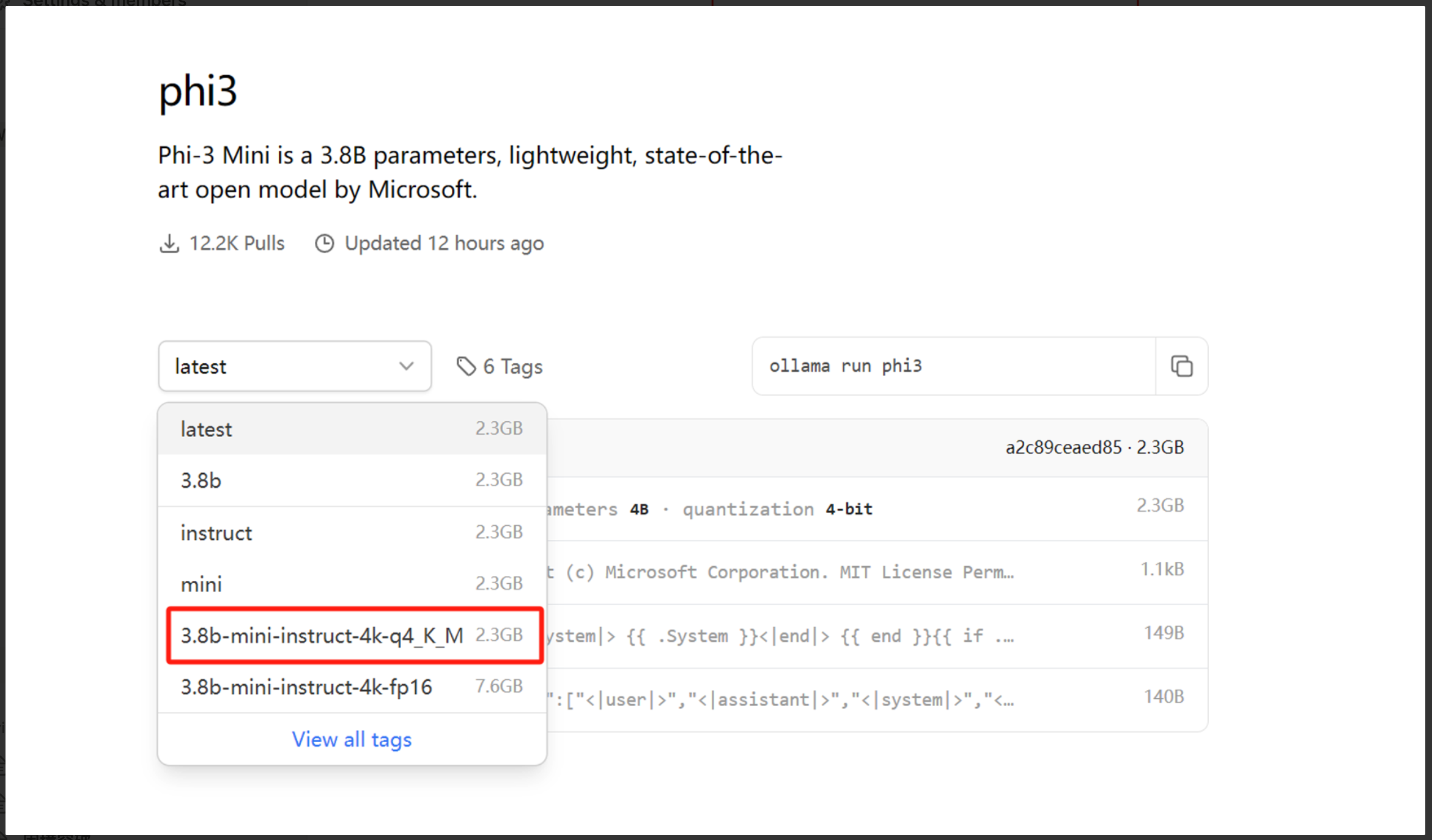

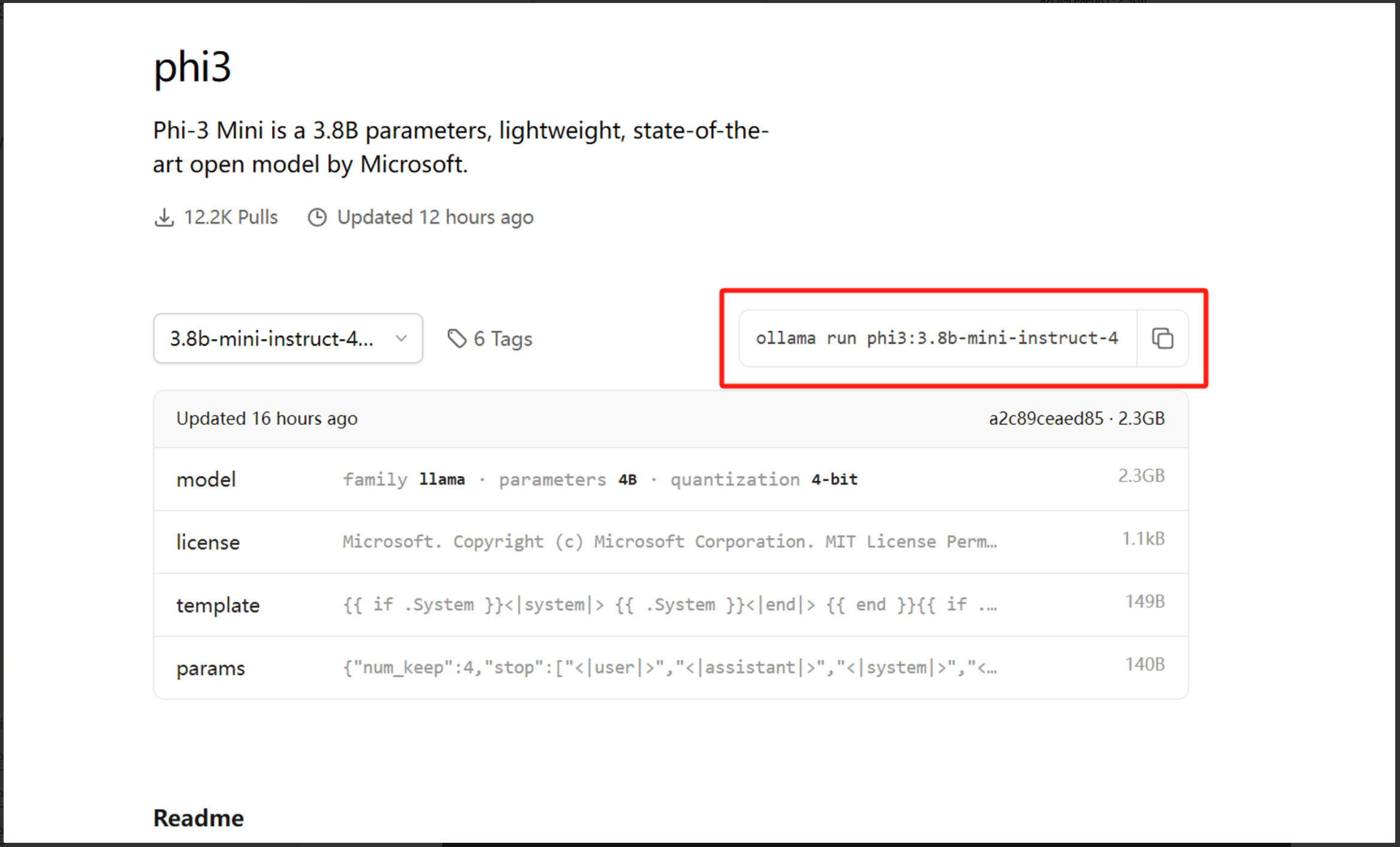

选择模型版本号

复制模型名称

删除,模型名的前缀

开始进入下载

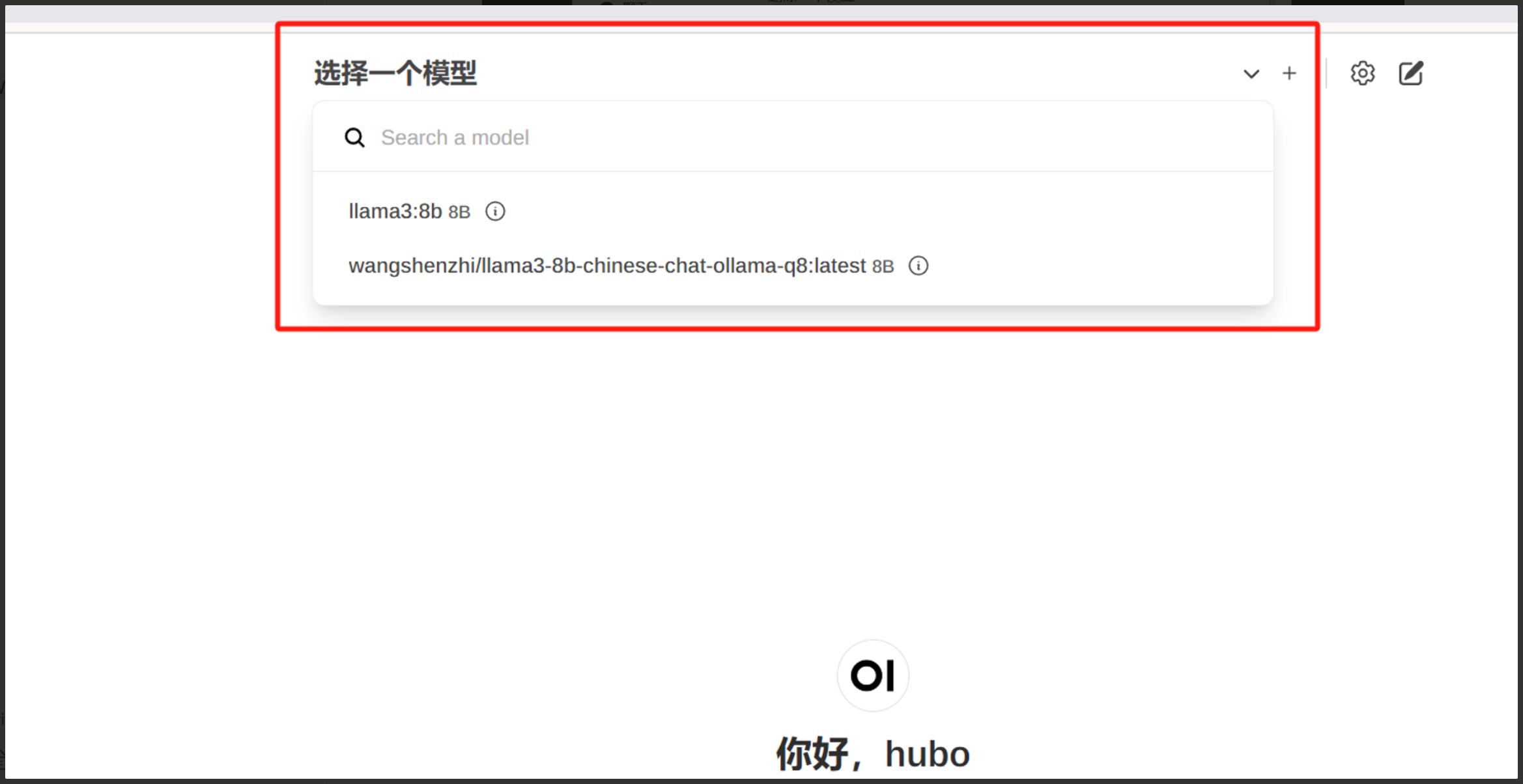

下载完成后,即可切换模型使用了

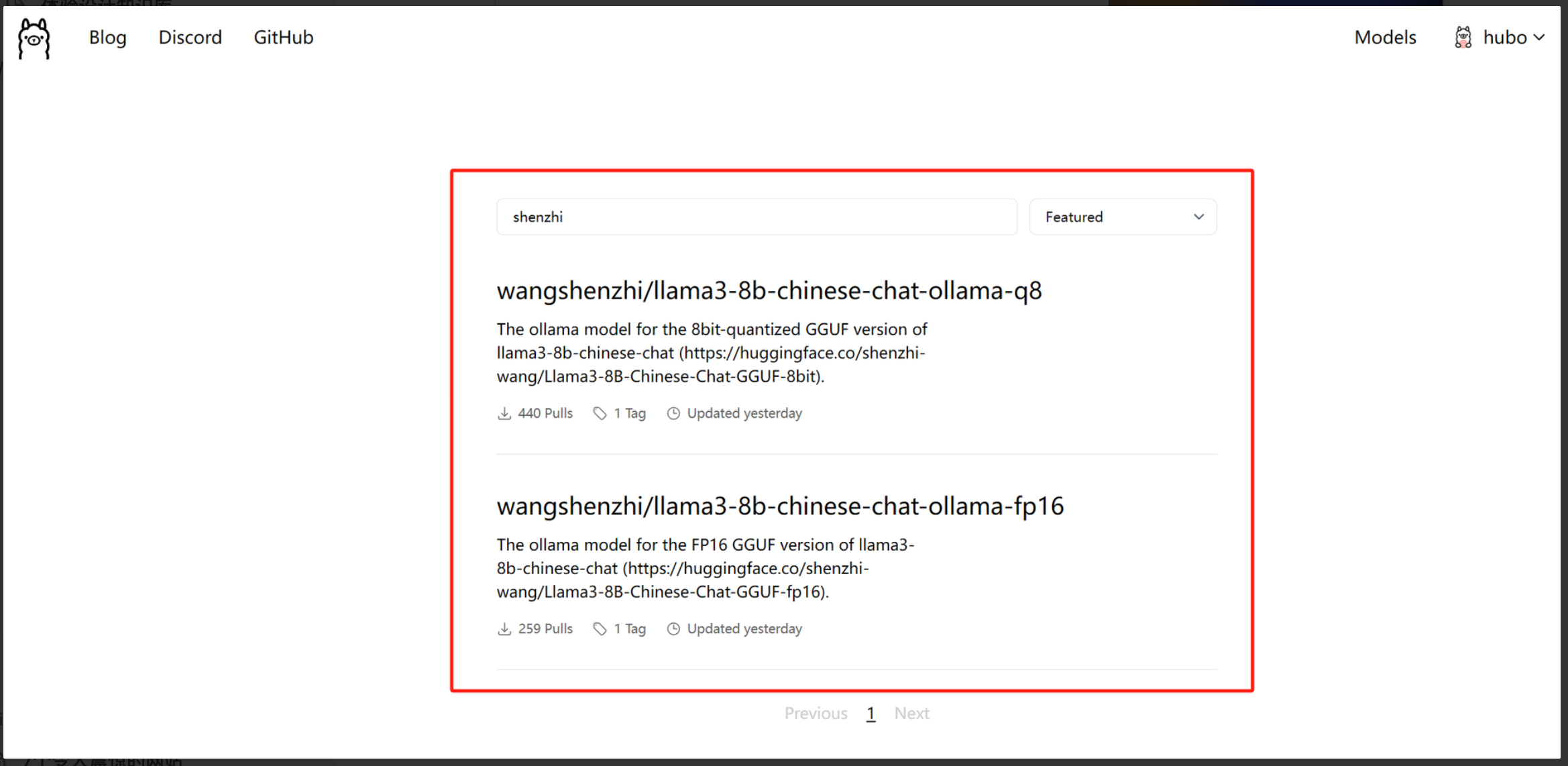

看到很多同学对于 Llama 3 中文理解不友好的问题,也找到了解决办法

是由 王慎执 博士微调后的中文版 Llama 3

以下为,huggingface主页

https://huggingface.co/shenzhi-wang/Llama3-8B-Chinese-Chat

在搜索框搜索 shenzhi 即可找到

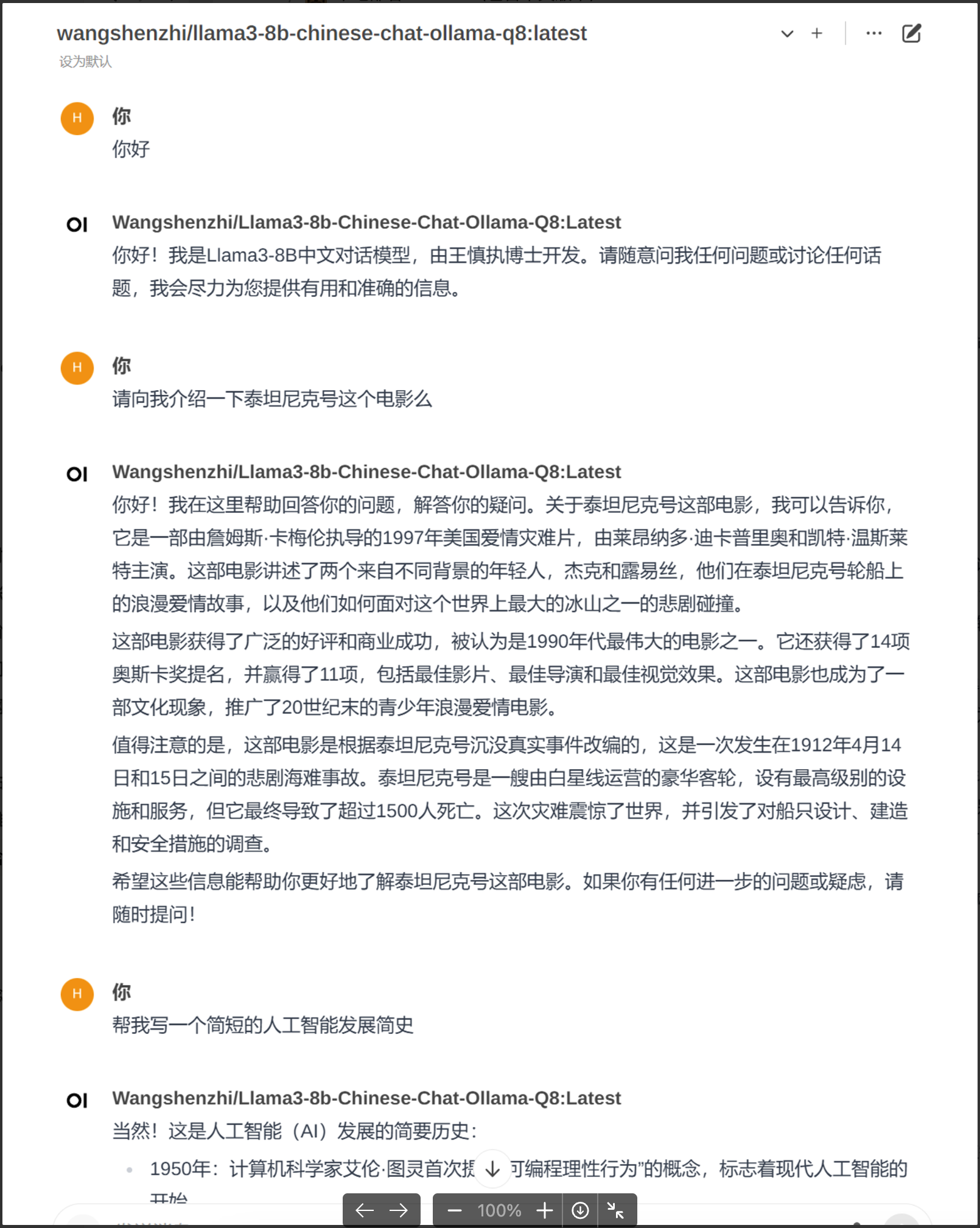

演示结果,不会出现英文

二次启动只需要,启动 Docker 桌面即可,并且可以完全断网使用