:::color2 点击下方链接关注京东设计部

:::

人工智能技术正在不断发展和演变,因此设计师需要时刻保持学习和更新的状态,以跟上技术的发展,帮助自己创造出更加创新和独特的设计作品。

前言

前段时间铺天盖地关于AI创作的文章,充分感受到大家的焦虑。而我和大多数设计师一样都抱着打不过就加入的心态,尽可能的利用AI投入设计生产。今天和大家一起简单聊聊关于我对AI的应用和思考🤔。

三款绘图AI的优劣势

1· Stable Diffusion 优势可本地部署,定制化模型且无版权风险,但是劣势也很明显,对本地部署机型有一定限制,研究下来大多数MAC机型基本部署不了,对于使用MAC机型的设计师很不友好。 2· **Midjourney** 整体操作使用友好,出图质量极高,无版权风险,但是不可定制化模型,其次可控性稍差,对一些拟人化IP的理解差强人意😓····· 3· Vega 国产版本的SD,操作使用简单,可定制化模型,投喂大量素材可相对稳定输出IP形象。但是整体输出质量相较于前两者还是有较大差距。版权也存在一定的风险。

可控代表创作过程的长短效率,质量代表创作结果的喜人程度。

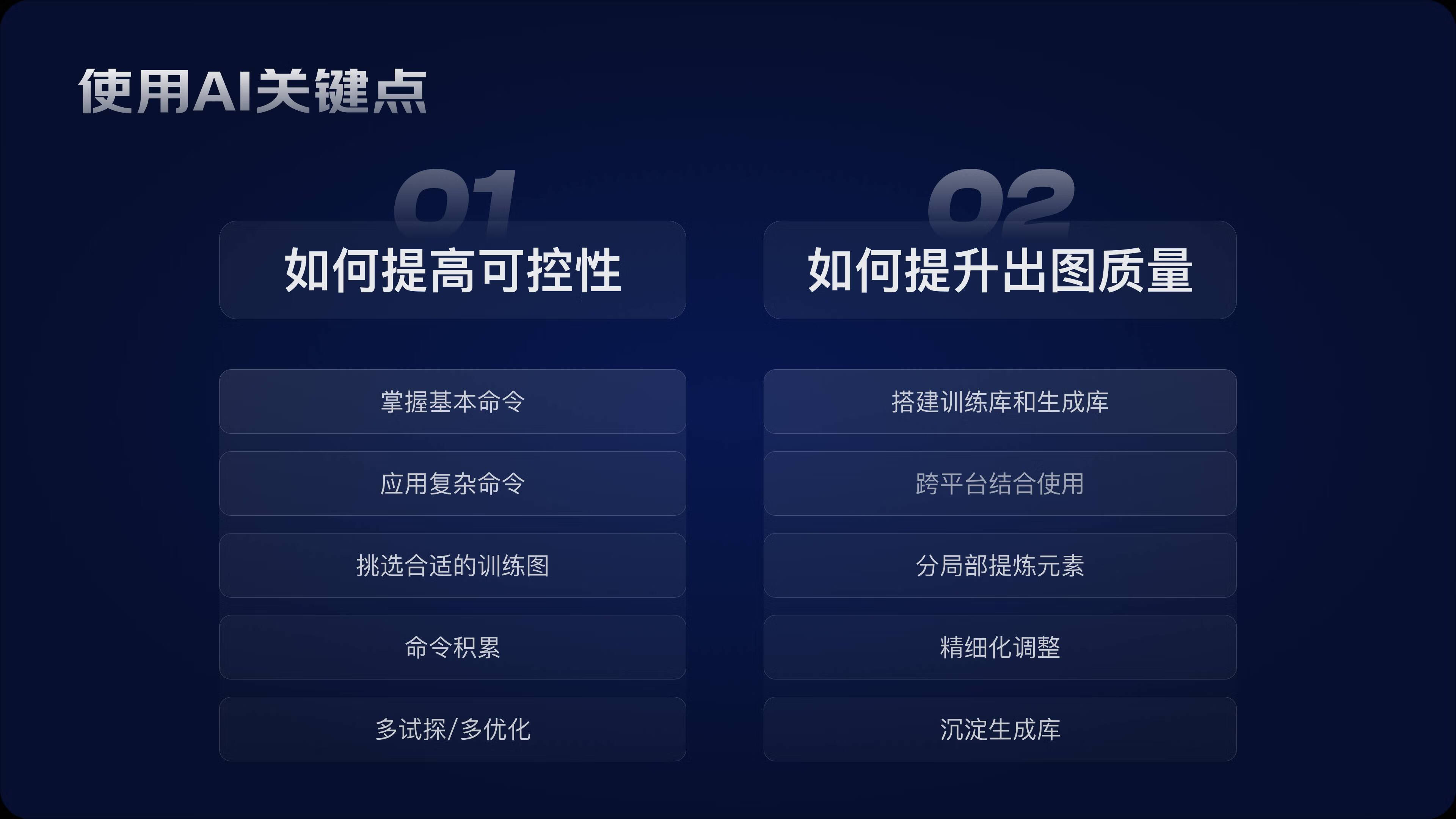

01、如何提高可控性拆分以下几个小的关键点- 掌握基本命令

- 应用复杂命令

- 挑选合适的训练图

- 命令积累

- 多试探/多优化

- 搭建训练库和生成库

- 跨平台结合使用

- 分局部提炼元素

- 精细化调整

- 沉淀生成库

提高可控性

1·掌握基本命令

这里所说的基本命令,指的是Midjourney这款媒介。我们需要掌握的有三点。- 了解常用命令提示符的用意和指代比如/imagine/settings/describe/blend;

- 了解描述词之间的使用规范和技巧;避免命令生成报错。

- 了解常用参数值的概念。

在详细拿Settings举例子

在对话框中输入Settings回车,调出设置面板,图中标注的第一部分为模型版本,常用的为 —v5(偏向写实风格) — niji 5(偏向二次元风格),第二部分关于图像质量(— q 50),第三部分为风格参数(— s 750),第四部分为其他设置。

2·应用复杂命令

01、需要“善于利用资源”

善用资源指的是在前期入门时,善用别人的“命令”,在使用别人命令的过程中找到不同风格的一些规律,并且提炼关键词,以此进行发散延展; 下面是几个AI作品网站,里面的每张作品都有对应的命令词可供参考。

02、善用“命令生成器”

命令生成器里会有对质量、风格、作者、光效、构图 等不同关键词的描述。有些风格当我们怎么尝试都不理想的时候就可以借此辅助自己完成创作。

3· 挑选合适的训练图

大概对基本命令和使用复杂命令有一定的方式方法后, 接下来挑选合适的训练图(垫图)也尤为重要,推荐以下几个网站,日常我们也可以多积累相关素材网站。

4.命令积累

上面我们说的都是关于对当下已有资源的一个利用。那提高可控性的最重要的一步,则是把收集的命令资源进行整合,变化为自己的东西。这也是筛选、整理、归纳、整合的一个过程,我们可以通过脑图或是一个能承载信息的媒介比如(Notion)来建立属于自己“命令”这一板块的第二大脑。当我们下次创作时,可以对过往命令进行随取随用。

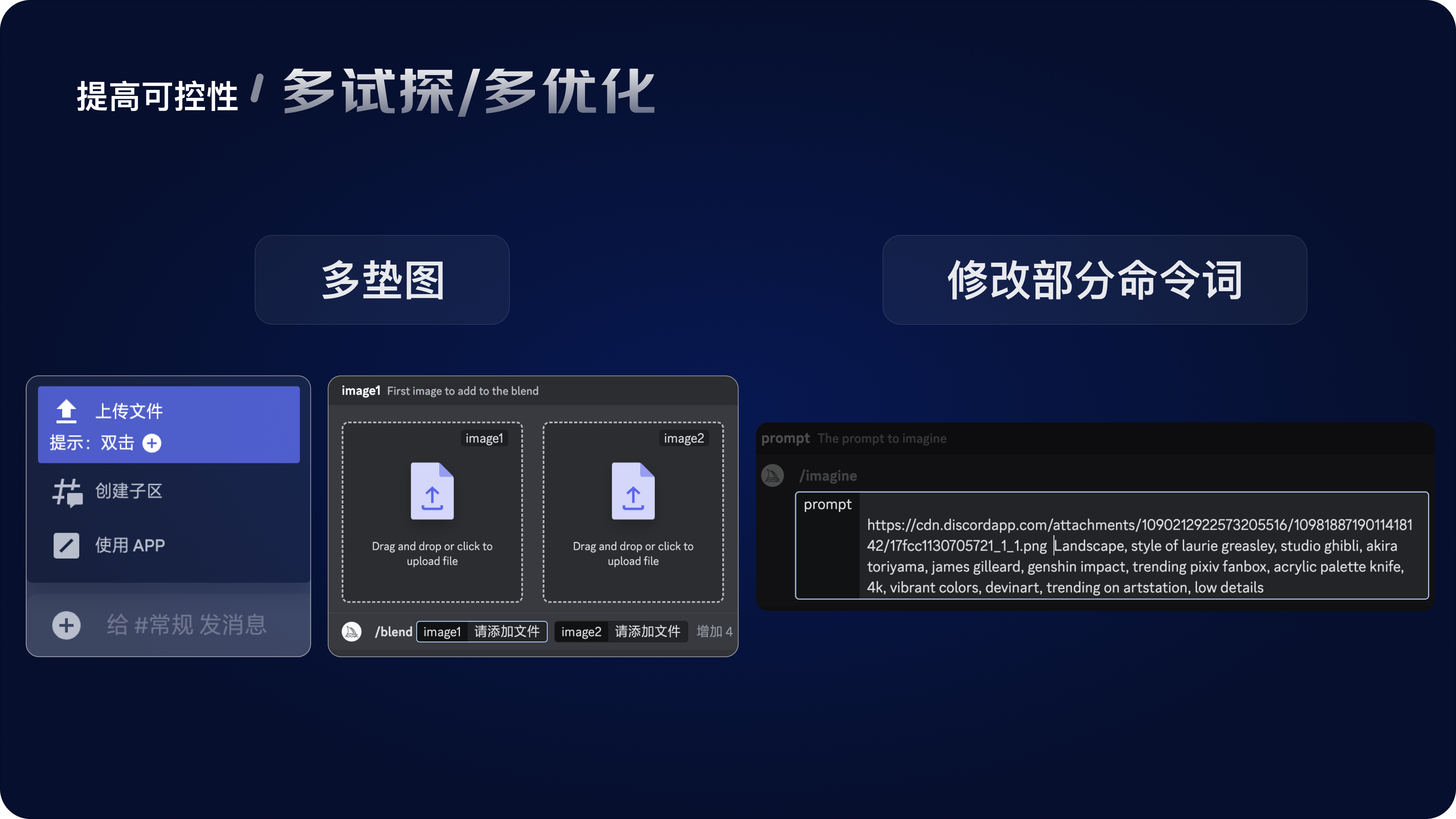

5.多次尝试

以上四点说的是关于我们利用主观能动性,借助工具和外力的帮助,但毕竟客观来看AI不能被我们完全可控,那这个时候就需要去投入时间和精力多尝试多优化,比如对一些命令里的关键词的调整、替换垫图或者增加垫图的张数,去找到自己使用AI手感,就像以前画画也需要投入大量时间找到手感,才可能完成一张令自己满意的创作多少有点相似。

提高出图质量

1·建立训练库及生成库

上面提到对命令的积累可以使用脑图或者Notion进行管理储备,那针对于在创作过程中收集使用的垫图和生成后的画面、素材我们更需要进行轻量化的整合管理。例如在Egael上进行统一的管理沉淀。

2·跨平台结合使用&分局部提炼元素

前面提到关于三个AI平台的优劣势,接下来具体看看如何利用不同平台的优势为我们所用。我通过工作中一个实际案例(母亲节节气插画)进行分析。

国产SD虽然出图质量差点意思,但是可以定制化模型,且可以投喂素材进行IP训练,而Midjourney虽然不能定制化训练但是出图质量极高,那就可以结合着这两款媒介分别获取提炼我想要的画面内容。

Step1:首先明确了画面元素为“母亲抱着孩子,joy在献花”

Step2:拆分来创作,先通过国产SD风格定制获得想要的风格以此创作出母亲抱着孩子的画面。对画面质量不太满意,在将国产SD里创作的图片,垫图到MJ进行二次创作,得到想要的主元素“妈妈抱着孩子”(如果你在创作的过程中不满意当前的画面,也可以点击刷新,或者修改部分关键词继续延展)

Step3:通过国产SD投喂素材进行JOY IP形象训练,获得joy献花这部分画面。(这也是MJ欠缺的一部分功能)

Step4:对于分别提炼的素材通过UpscayI这个软件,去进行像素的提升,方便我们后续的精细化调整。

Step5:第五步则是将放大后的画面元素整合到一起,调整构图,获得我们的画面初稿。

这个时候我们会发现,画面的色调、光感、妈妈的脖子啊、孩子的手啊、joy的身体构成都有一些不OK的地方,那接下来就需要依赖自身的设计判断能力和审美能力来对画面进行细化调整。这也是保证最终创作质量的最重要一步。

3· 依据主题精细化调整

Step1:调整色调 , 母亲节更希望画面整体偏向温暖治愈明亮,因此需要将色调由冷色到暖色进行调整变化。

Step2:调整细节,对于基本人体结构的错误进行调整,比图妈妈的脖子过长,宝宝的手,地毯等细节进行调整。

Step3:调整光感和画面的统一度,比如去灰度、提亮主光源,调整元素之间的环境光,整体的色彩平衡和色彩饱和以及局部的曲线调整得到我们最终的画面(这里出完画面后得知JOY形象进行了新一轮的品牌更新,因此这里临时替换了JOY 的部分🐶)

4· 沉淀生成库

最后又回归到了第一步,将我们创作过程中的画面进行整理,沉淀到生成库,完成一轮循环。

“上帝,赐予我平静,去接受我无法改变的。给予我勇气,去改变我能改变的,赐我智慧,分辨这两者的区别。

网站链接链接**🔗**合集:

AI作品合集可参考命令: 命令生成器: 训练图素材网站: 图片放大软件获取链接 AI网站链接