输入数据接口:InputFormat

默认使用的实现类是:TextInputFormat

用户根据业务需求实现其中三个方法:map() setup() cleanup ()

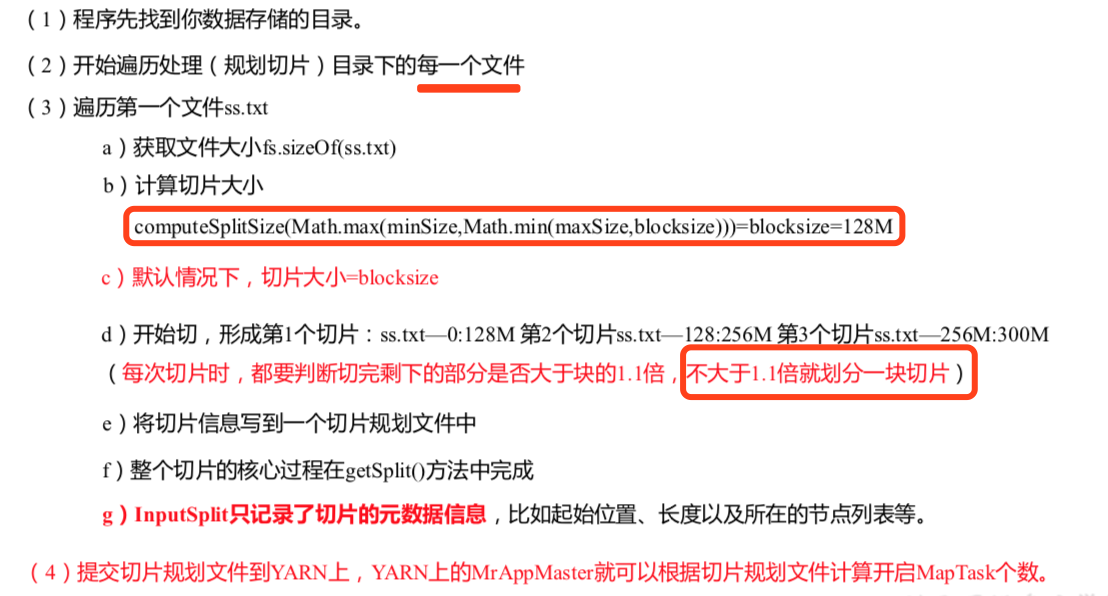

- Map阶段并行度由input的切片数决定 (不是hdfs块数)

- 对文件而不是目录进行切片,不大于1.1倍就切一片

- 默认情况下,切片大小=BlockSize

- 针对每一个文件单独切片

//切片参数设置Math.max(minSize, Math.min(maxSize, blockSize));mapreduce.input.fileinputformat.split.minsize=1 默认值为1mapreduce.input.fileinputformat.split.maxsize= Long.MAXValue 默认值Long.MAXValue

Partitioner 分区

- 有默认实现 HashPartitioner,逻辑是根据 key 的哈希值和 numReduces 来返回一个分区号;key.hashCode()&Integer.MAXVALUE % numReduces

-

Comparable 排序

对于MapTask,它会将处理的结果暂时放到环形缓冲区中,当环形缓冲区使 用率达到一定阈值后,再对缓冲区中的数据进行一次快速排序,并将这些有序数 据溢写到磁盘上,而当数据处理完毕后,它会对磁盘上所有文件进行归并排序。

对于ReduceTask,它从每个MapTask上远程拷贝相应的数据文件,如果文件大 小超过一定阈值,则溢写磁盘上,否则存储在内存中。如果磁盘上文件数目达到 一定阈值,则进行一次归并排序以生成一个更大文件;如果内存中文件大小或者 数目超过一定阈值,则进行一次合并后将数据溢写到磁盘上。当所有数据拷贝完 毕后,ReduceTask统一对内存和磁盘上的所有数据进行一次归并排序 当我们用自定义的bean作为 key 来输出时,就必须要实现WritableComparable 接口,重写其中的 compareTo()方法。

排序分类:

Combiner 合并 对灭一个maptask进行局部汇总,可以提高程序执行效率,减少 IO 传输。但是使用时必须不能影响原有的业务处理结果。

逻辑处理接口:Reducer

用户根据业务需求实现其中三个方法:reduce() setup() cleanup ()

输出数据接口:OutputFormat

默认实现类是 TextOutputFormat,功能逻辑是:将每一个 KV 对,向目标文本文件输出一行。

- 用户还可以自定义 OutputFormat。