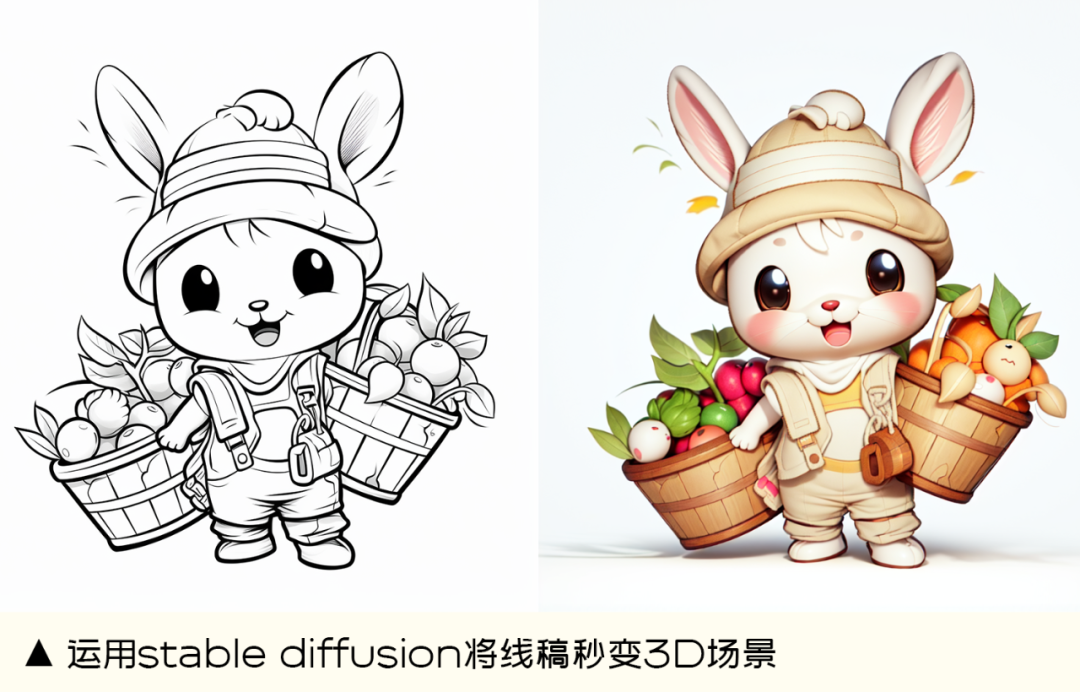

(1)线稿秒变3D场景

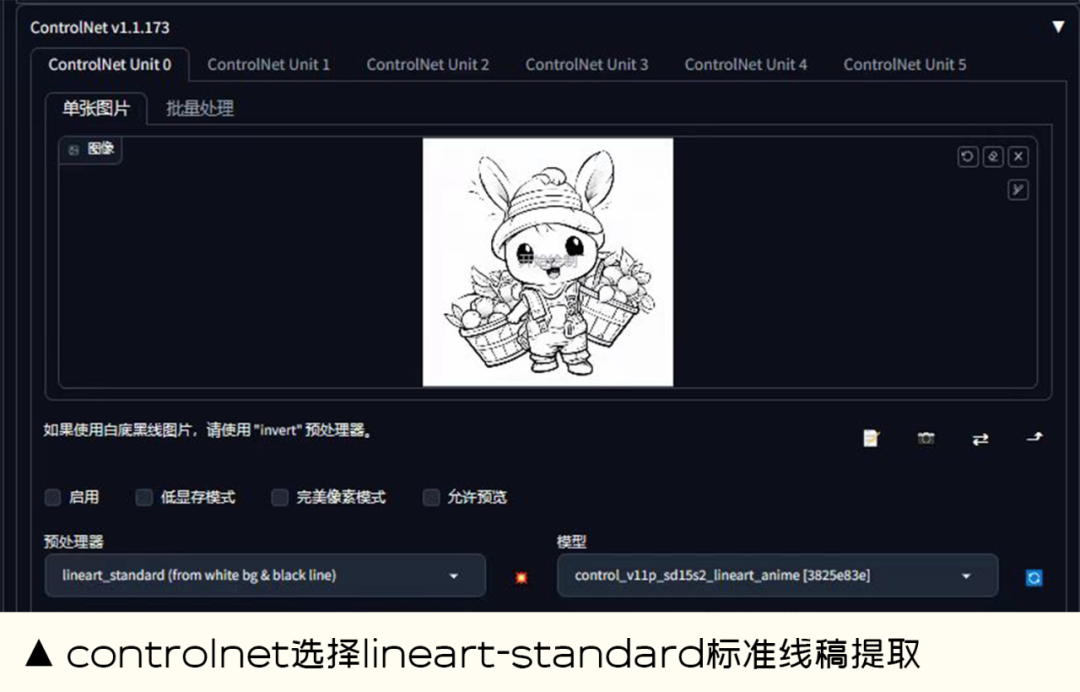

在人工智能绘画软件之前,我们如果想将一张线稿设计图转变为一幅3d场景可能需要非常复杂的过程,比如:线稿填色成平面插画,然后根据画面物体的结构在3d软件中进行建模,最终根据配色进行打光渲染等步骤来完成。而现在我们运用stable diffusion甚至数秒的时间就可以完成一系列方案。 关于stable diffusion的使用原理网络上有许多详细的教程,在这里就不向大家赘述。接下来我将向大家分享如何运用SD将midjourney生成的线稿图转变为3d场景。

(2)平面卡通IP秒变3D角色

除了上述的线稿转3d场景之外,我们日常的平面IP卡通人物也可以通过stable diffuson秒变3d人物,在实现过程上述的案例有所不同,因为我们需要更加精准的按照我们的平面插画进行3d人物的制作,当然我们更期望最终的3d形象与我们的平面效果完全吻合,因此这里我们不再使用文生图模式,而是采用图生图模式来进行更精准的控制。以一张用midjourney生成的ip卡通平面三视图为例:根据我们卡通人物的特征,添加详细的正反向描述关键词来构建预期效果,重绘幅度数值设置为0.5。另外,在模型的使用上还是有很大区别的,大模型选用了revanimated_v122.safetensors,滤镜是animevae.pt。controlnet采用depth-zoe控制深度;canny或者lineart-anime控制外形线稿的提取;关于lora模型选择了blindbox给予类似于盲盒有趣的3d效果,另外还使用了charturnerv2:0.4这个lora模型用来增强模型的塑料质感,最终就形成了如图的3D角色。