1. [18 ECCV] Interactive Boundary Prediction for ObjectSelection

主要看点:

- 对boundary-based方法的优点陈述;

- 基于深度学习的boundary-based方法;

- 评测时的取点策略。

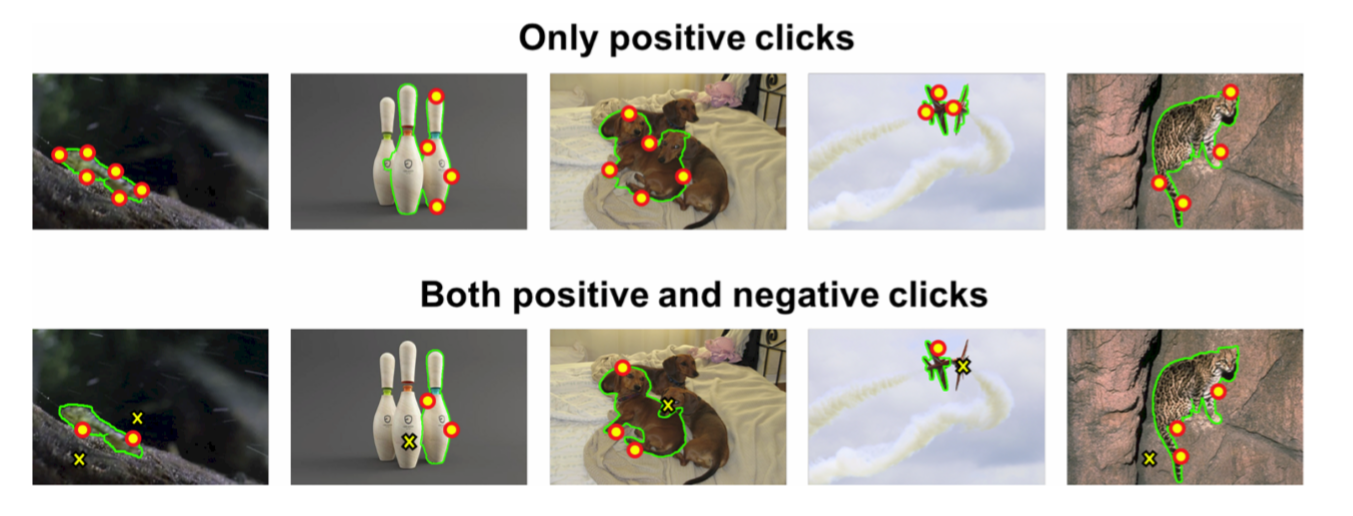

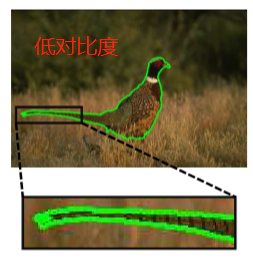

作者说基于Region的点交互分割方法无法精细地分割边缘,尤其在较大纹理块(highly textured regions / textures with large patterns)和低对比度边缘的情况下,如下图:

方法部分

作者设计了一个网络接受用户的输入图片,输出边缘的预测和一个粗糙的分割结果。

交互输入做了三种不同尺度的模糊,拼接起来进行输入,其中d是欧氏距离,L是图像的短边。(不知道这个作用如何)

损失函数分为三个部分,一个是边缘的,一个是分割的,还有一个是聚焦于交互点附近的,具体说下最后一个:

⊙ 代表元素乘,是交互点的spatial mask。

在训练中,点是在GT的边缘上随机取k个。

最后用Geodesi path做后处理,这一点文中没有具体写。

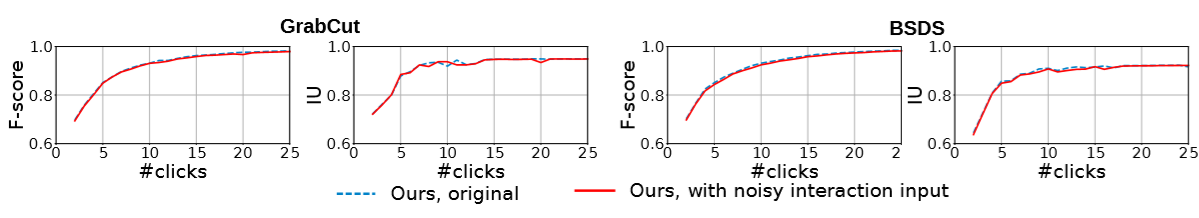

评测时如何模拟取点的策略? 选择一个具有最低F-score的边界段(在两个现有的连续控制点之间)。从相应的GT边界段中,模拟器选择距离当前预测段最远的点作为新的控制点。该过程从两个随机选择的控制点开始,一直持续到达到最大迭代次数。

实验中有一段探究控制点偏移的值得看一下 (Robustness against imperfect user inputs)。作者把用户点做了偏移(基于真实地用户行为统计),结果仍然是鲁棒的。

2. [19 IJCV] Click Carving: Interactive Object Segmentation in Images and Videos with Point Clicks

代码链接:Project

这篇文章在2016年就放在了arXiv上了,是一个比较久远的方法,video的部分暂时先不讲,以后可能会补充。

和第一个方法相比,这个方法完全不同。18 ECCV那一篇是将Click输入和原图一起预测的,而这一篇是先生成很多可能的分割,然后用点去选择。

做法是先用MCG产生Proposals,然后用在边缘点Click去选择(投票)。这个做法也许启发了后面👇这项工作

[19 CVPR] Content-Aware Multi-Level Guidance for Interactive Instance Segmentation

本文也实现了使用负点修正错误分割的功能。