参考文档

https://zhuanlan.zhihu.com/p/69411064

pytorch中六种学习率调整方法

1. StepLR

class torch.optim.lr_scheduler.StepLR(optimizer, step_size, gamma=0.1, last_epoch=-1)

功能: 等间隔调整学习率,调整倍数为gamma倍,调整间隔为step_size。间隔单位是step。需要注意的是,step通常是指epoch,不要弄成iteration了。

参数:

- step_size(int) - 学习率下降间隔数,若为30,则会在30、60、90……个step时,将学习率调整为lr*gamma。

- gamma(float) - 学习率调整倍数,默认为0.1倍,即下降10倍。

last_epoch(int) - 上一个epoch数,这个变量用来指示学习率是否需要调整。当last_epoch符合设定的间隔时,就会对学习率进行调整。当为-1时,学习率设置为初始值。

2. MultiStepLR

class torch.optim.lr_scheduler.MultiStepLR(optimizer, milestones, gamma=0.1, last_epoch=-1)

功能: 按设定的间隔调整学习率。这个方法适合后期调试使用,观察loss曲线,为每个实验定制学习率调整时机。

参数:milestones(list) - 一个list,每一个元素代表何时调整学习率,list元素必须是递增的。如 milestones=[30,80,120]

- gamma(float) - 学习率调整倍数,默认为0.1倍,即下降10倍。

last_epoch(int) - 上一个epoch数,这个变量用来指示学习率是否需要调整。当last_epoch符合设定的间隔时,就会对学习率进行调整。当为-1时,学习率设置为初始值。

3. ExponentialLR

class torch.optim.lr_scheduler.ExponentialLR(optimizer, gamma, last_epoch=-1)

功能: 按指数衰减调整学习率,调整公式: lr = lr gamma**epoch

*参数:gamma - 学习率调整倍数的底,指数为epoch,即 gamma**epoch

last_epoch(int) - 上一个epoch数,这个变量用来指示学习率是否需要调整。当last_epoch符合设定的间隔时,就会对学习率进行调整。当为-1时,学习率设置为初始值。

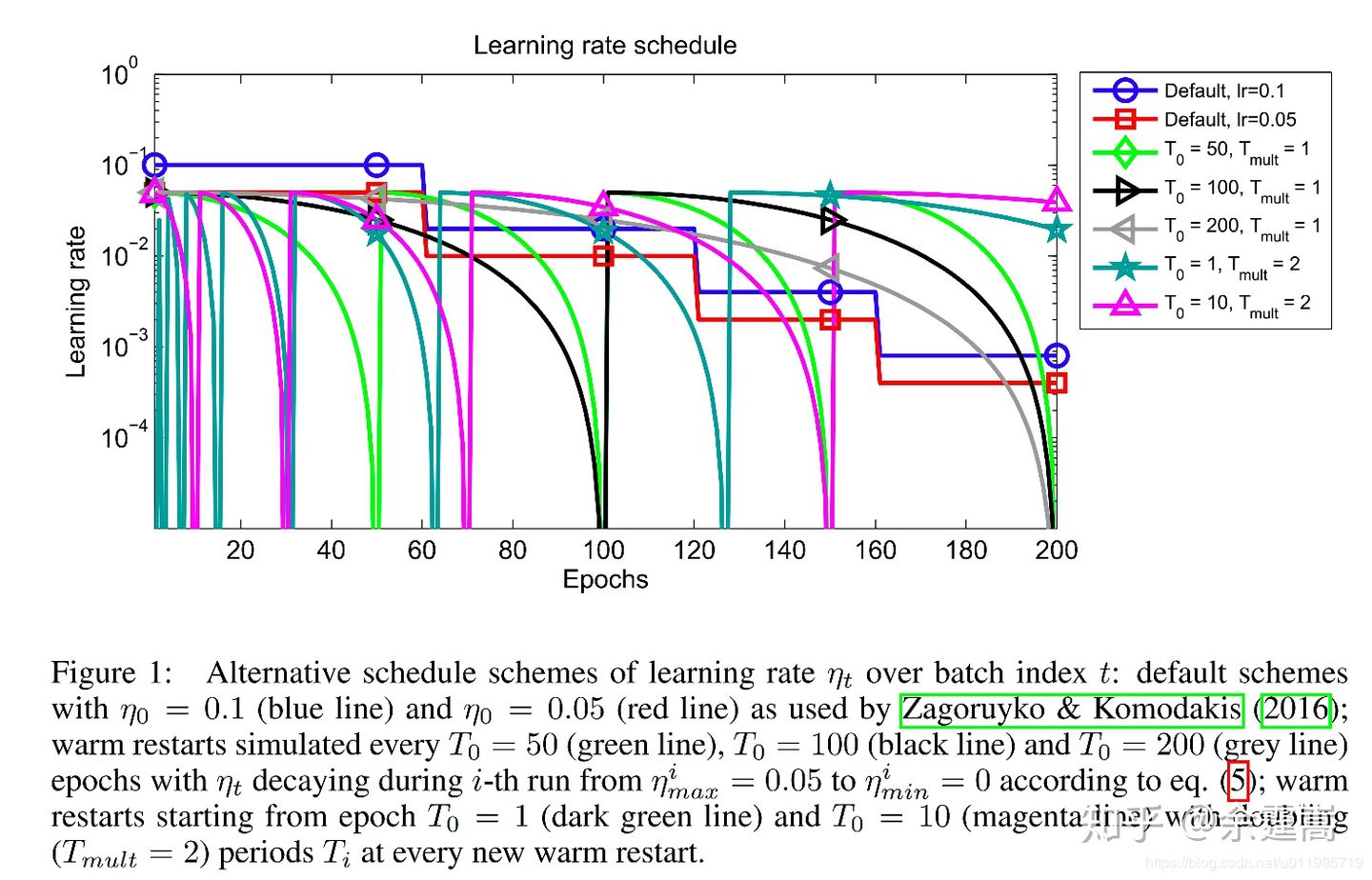

4. CosineAnnealingLR

class torch.optim.lr_scheduler.CosineAnnealingLR(optimizer, T_max, eta_min=0, last_epoch=-1)

功能: 以余弦函数为周期,并在每个周期最大值时重新设置学习率。具体如下图所示

详细请阅读论文 https://arxiv.org/abs/1608.03983

参数:T_max(int) - 一次学习率周期的迭代次数,即T_max个epoch之后重新设置学习率。

- eta_min(float) - 最小学习率,即在一个周期中,学习率最小会下降到eta_min,默认值为0。

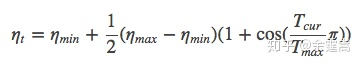

学习率调整公式为:

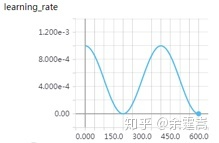

可以看出是以初始学习率为最大学习率,以2*Tmax为周期,在一个周期内先下降,后上升。

实例: T_max = 200, 初始学习率 = 0.001, eta_min = 0

5. ReduceLROnPlateau

class torch.optim.lr_scheduler.ReduceLROnPlateau(optimizer, mode='min', factor=0.1, patience=10, verbose=False, threshold=0.0001, threshold_mode='rel', cooldown=0, min_lr=0, eps=1e-08)

功能: 当某指标不再变化(下降或升高),调整学习率,这是非常实用的学习率调整策略。例如,当验证集的loss不再下降时,进行学习率调整;或者监测验证集的accuracy,当accuracy不再上升时,则调整学习率。

参数:

- mode(str) - 模式选择,有 min和max两种模式,min表示当指标不再降低(如监测loss),max表示当指标不再升高(如监测accuracy)。

- factor(float) - 学习率调整倍数(等同于其它方法的gamma),即学习率更新为 lr = lr * factor

- patience(int) - 直译——“耐心”,即忍受该指标多少个step不变化,当忍无可忍时,调整学习率。注,可以不是连续5次。

- verbose(bool) - 是否打印学习率信息

- threshold(float) - 配合threshold_mode使用,默认值1e-4。作用是用来控制当前指标与best指标的差异。

- threshold_mode(str) - 选择判断指标是否达最优的模式,有两种模式,rel和abs。 当threshold_mode = rel,并且mode = max时,dynamic_threshold = best ( 1 + threshold ); 当threshold_mode = rel,并且mode = min时,dynamic_threshold = best ( 1 - threshold ); 当threshold_mode = abs,并且mode = max时,dynamic_threshold = best + threshold ; 当threshold_mode = rel,并且mode = max时,dynamic_threshold = best - threshold

- cooldown(int) - “冷却时间“,当调整学习率之后,让学习率调整策略冷静一下,让模型再训练一段时间,再重启监测模式。

- min_lr(float or list) - 学习率下限,可为float,或者list,当有多个参数组时,可用list进行设置。

eps(float) - 学习率衰减的最小值,当学习率变化小于eps时,则不调整学习率。

6. LambdaLR

class torch.optim.lr_scheduler.LambdaLR(optimizer, lr_lambda, last_epoch=-1)

功能: 为不同参数组设定不同学习率调整策略。调整规则为,lr = base_lr lmbda(self.last_epoch) 。

*参数:lr_lambda(function or list) - 一个计算学习率调整倍数的函数,输入通常为step,当有多个参数组时,设为list。

- last_epoch(int) - 上一个epoch数,这个变量用来指示学习率是否需要调整。当last_epoch符合设定的间隔时,就会对学习率进行调整。当为-1时,学习率设置为初始值。