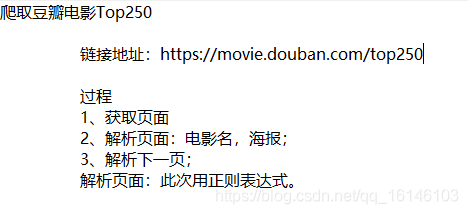

爬取 #豆瓣电影

1、对页面进行分析

①对网页进行解析

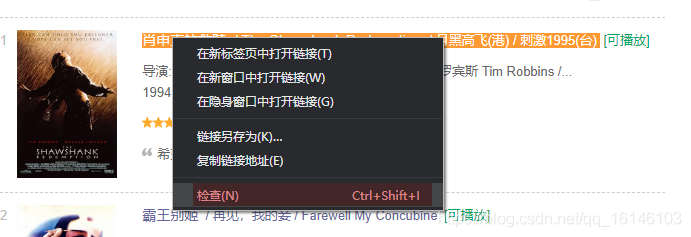

鼠标对准我们需要解析的地方,右键点击检查:

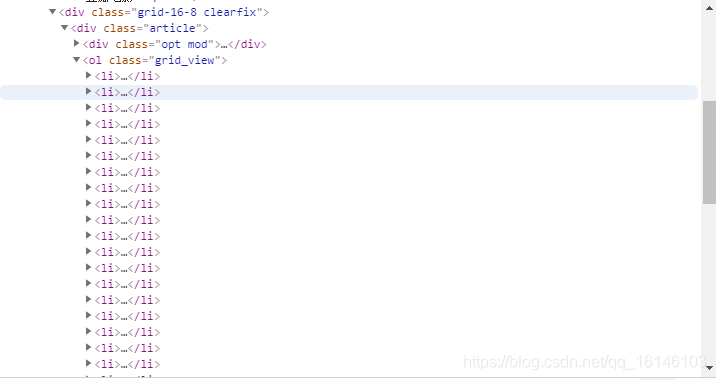

这时我们可以看到网页的基本结构:

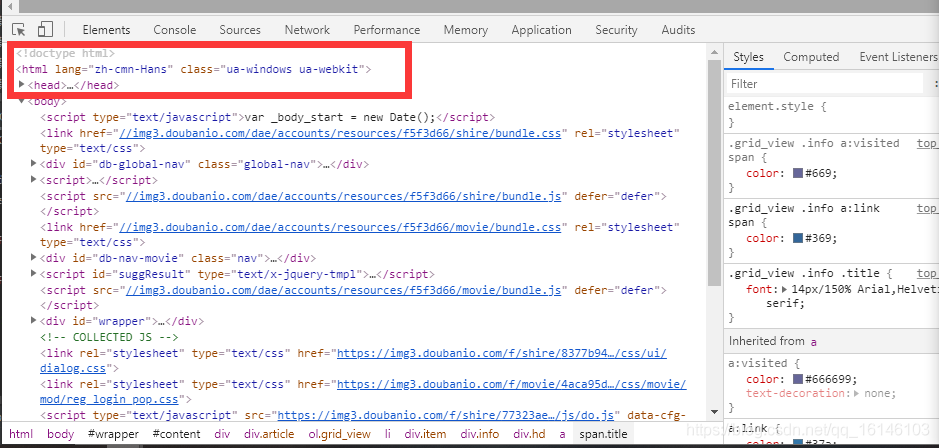

打开以后,我们需要找到此次爬取重点:图片以及电影名称

我们可以先把小的标签头缩小,看下所有的电影的标签:

由此,我们可以知道所有的电影信息都在上图所示的标签里

②分步骤进行分析

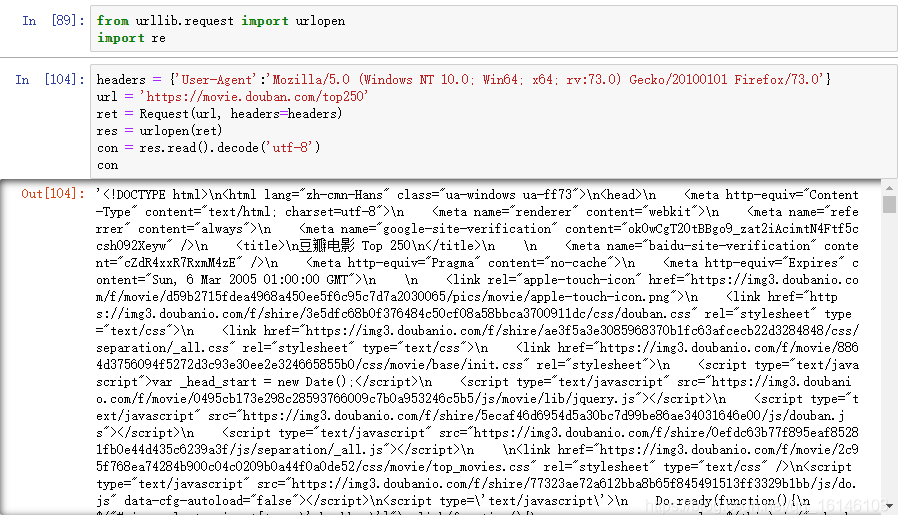

1)首先我们先读取页面信息

通过添加模块,请求头进行网页解析

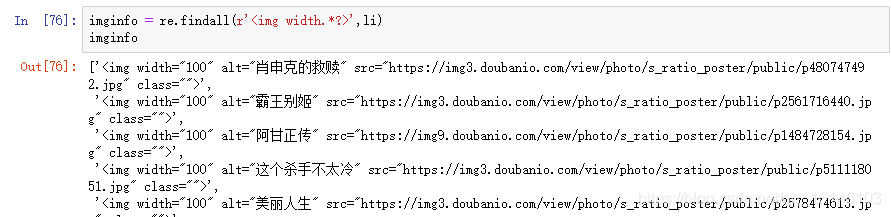

2)找到所有的 li(即所有电影的存放位置)

通过 findall 查找所有的电影信息,查找用到正则表达式,如果对正则表达式不懂,可以百度了解下。

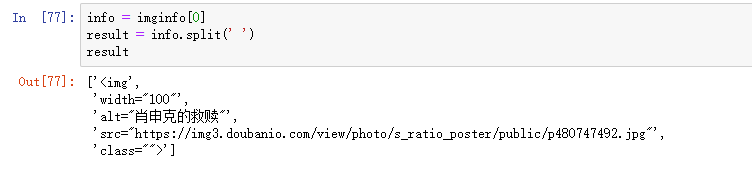

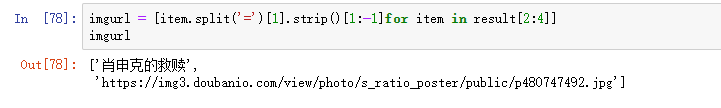

3)进行字符串解析,对上面的进行切分

4)切分之后,选取所需要的

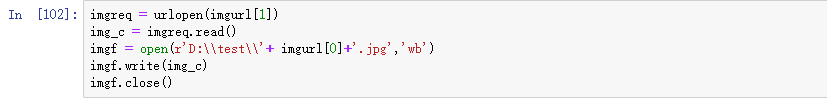

5)保存到本地

好了,以上的为保存图片所需要的步骤。

③分析网页一页有多少电影,以及每一页之间的联系

由上面我们可以知道每一页可以自己构造页数。

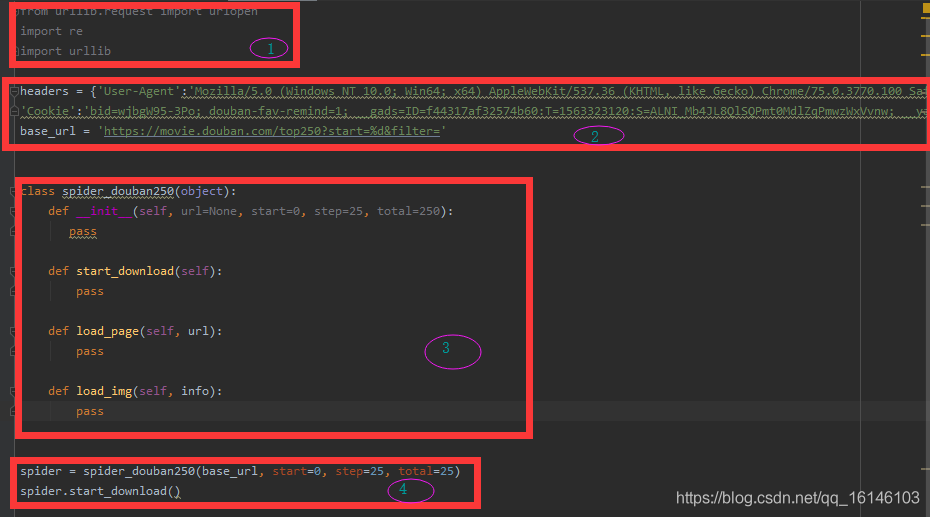

2、准备框架

①导入模块

②添加网址与请求头

③定义类,并在类内定义函数

④实现

from urllib.request import urlopenimport reimport urllibheaders = {'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/75.0.3770.100 Safari/537.36','Cookie':'bid=wjbgW95-3Po; douban-fav-remind=1; __gads=ID=f44317af32574b60:T=1563323120:S=ALNI_Mb4JL8QlSQPmt0MdlZqPmwzWxVvnw; __yadk_uid=hwbnNUvhSSk1g7uvfCrKmCPDbPTclx9b; ll="108288"; _vwo_uuid_v2=D5473510F988F78E248AD90E6B29E476A|f4279380144650467e3ec3c0f649921e; trc_cookie_storage=taboola%2520global%253Auser-id%3Dff1b4d9b-cc03-4cbd-bd8e-1f56bb076864-tuct427f071; viewed="26437066"; gr_user_id=7281cfee-c4d0-4c28-b233-5fc175fee92a; dbcl2="158217797:78albFFVRw4"; ck=4CNe; _pk_ref.100001.4cf6=%5B%22%22%2C%22%22%2C1583798461%2C%22https%3A%2F%2Faccounts.douban.com%2Fpassport%2Flogin%3Fredir%3Dhttps%253A%252F%252Fmovie.douban.com%252Ftop250%22%5D; _pk_ses.100001.4cf6=*; __utma=30149280.1583974348.1563323123.1572242065.1583798461.8; __utmb=30149280.0.10.1583798461; __utmc=30149280; __utmz=30149280.1583798461.8.7.utmcsr=accounts.douban.com|utmccn=(referral)|utmcmd=referral|utmcct=/passport/login; __utma=223695111.424744929.1563344208.1572242065.1583798461.4; __utmb=223695111.0.10.1583798461; __utmc=223695111; __utmz=223695111.1583798461.4.4.utmcsr=accounts.douban.com|utmccn=(referral)|utmcmd=referral|utmcct=/passport/login; push_noty_num=0; push_doumail_num=0; _pk_id.100001.4cf6=06303e97d36c6c15.1563344208.4.1583798687.1572242284.'}base_url = 'https://movie.douban.com/top250?start=%d&filter='class spider_douban250(object):def __init__(self,url = None, start = 0, step = 25 , total = 250):self.durl = urlself.dstart = startself.dstep =stepself.dtotal = totaldef start_download(self):while self.dstart < self.dtotal:durl = self.durl%self.dstartprint(durl)self.load_page(durl)self.dstart += self.dstepdef load_page(self,url):req=urllib.request.Request(url=url,headers=headers)req = urlopen(req)if req.code != 200:returncon = req.read().decode('utf-8')listli = re.findall(r'<li>(.*?)</li>', con,re.S)if listli:listli = listli[1:]else:returnfor li in listli:imginfo = re.findall(r'<img.*?>', li)if imginfo:imginfo = imginfo[0]info = [item.split('=')[1].strip()[1:-1] for item in imginfo.split(' ')[2:4]]self.load_img(info)def load_img(self,info):print("callhere load img:", info)req = urllib.request.Request(url=info[1], headers=headers)imgreq = urlopen(req)img_c = imgreq.read()path = r'D:\\test\\' + info[0] + '.jpg'print('path:', path)imgf = open(path, 'wb')imgf.write(img_c)imgf.close()spider = spider_douban250(base_url,start=0,step=25,total=25)spider.start_download()

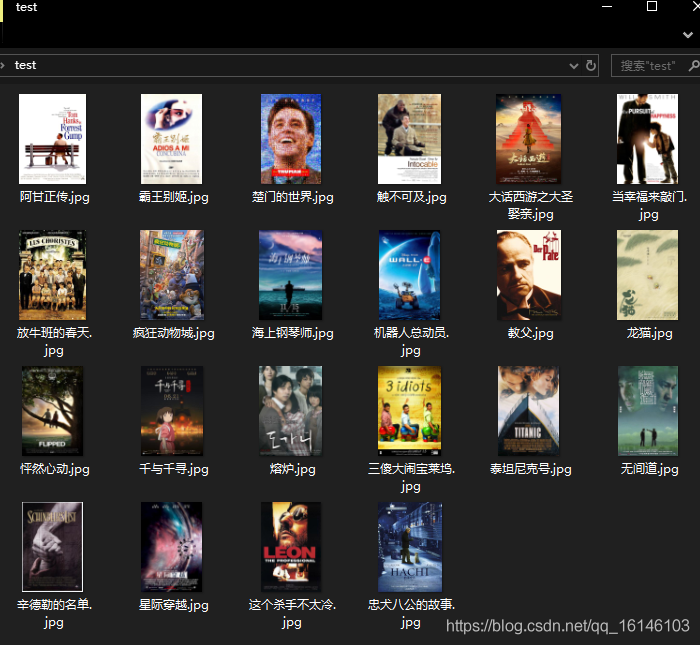

总的来说这个挺简单的,但是如果仔细看的话,还有很多改进的地方,比如说可以使用Requests库、time库、FakeUserAgent库等等。并且此代码仅仅只是爬取电影图片。可拓展性还很强。第一次写博客,有些没有说明白地方可以留言或者私信我,我会改正并争取早日称为一个合格的博主的。最后放出程序运行成功的截图: