逻辑回归部分,介绍逻辑回归用于解决二分类问题,通过激活函数对线性运算结果投影成概率,再通过决策边界判定为离散的0-1逻辑值,推导出完整的逻辑回归模型。然后设计它的代价函数,并推导如何在逻辑模型上进行梯度下降,还稍微提了一下其他的优化代价方程的方法,最后多分类问题可以看成多个逻辑回归问题。

正则化部分,先提出过拟合的问题,然后提出正则项的解决办法,并推导加入正则项后的线性回归、逻辑回归的代价方程和它们的梯度下降过程。

逻辑回归 Logistic Regression

3.1 Classification and Representation

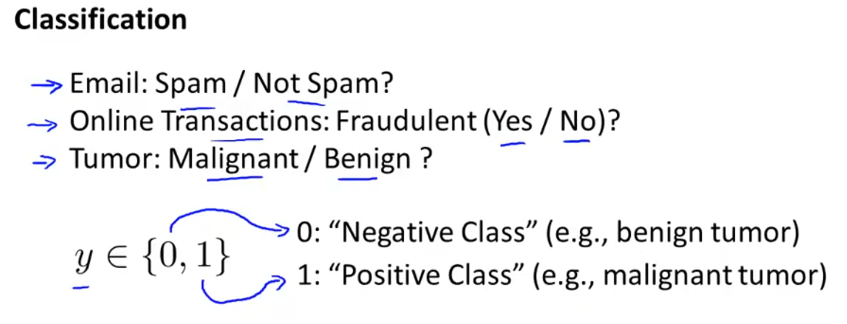

分类 Classification

首先,让我们看看什么是分类问题。

线性回归并不能很好的适用于分类问题。

我们需要一种新的表示,输出当前样本属于某一个类别的可能性。

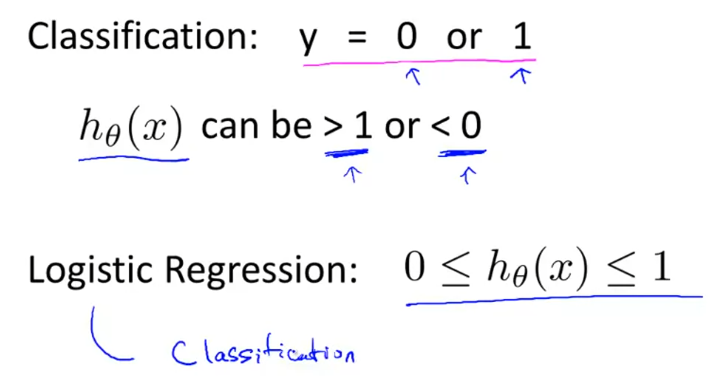

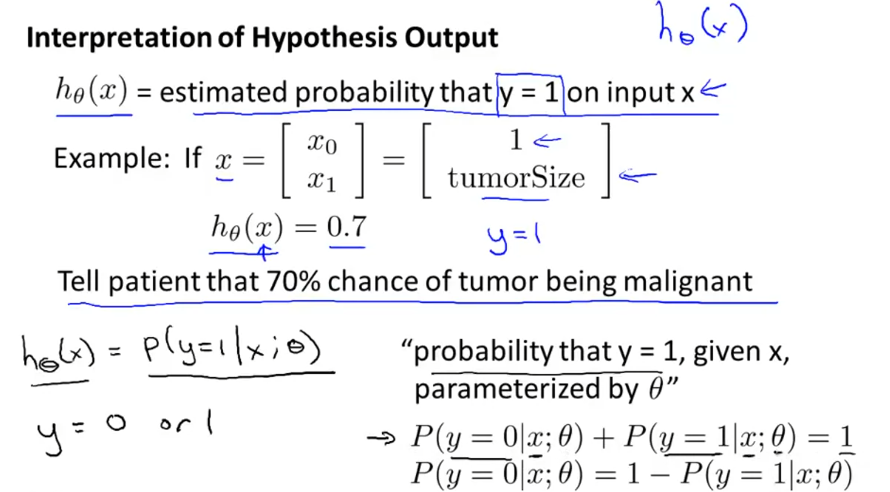

假设表示 Hypothesis Representation

逻辑回归模型希望输出一个0-1之间的概率,所以我们在线性表示的基础上,套上一层激活函数。

这里选择sigmoid函数作为逻辑(激活)函数

在二分类中,同一样本正类和负类的概率和为1。

决策边界 Decision Boundary

在激活函数映射计算出一个概率值后,我们需要判断,多大的概率才可信。并不是所有情况下都会选择下图中的0.5.

当sigmoid函数结果大于0.5,线性函数结果大于0。根据这个性质,可以在下图中滑出分割结果的一条线。

3.2 逻辑回归模型 Logistic Regression Model

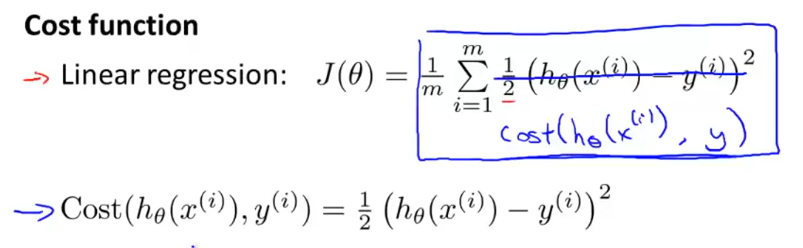

Cost Function

回顾线性回归的代价方程(均方误差方程),预测值和实际值的差值越大,代价越大。

那么对于逻辑回归给出的概率依据根据决策边界做出的对正类的判断,如果预测对了,则概率越大代价越小;如果预测错了,概率越大代价越大。

Simplified Cost Function and Gradient Descent

上节对于实际结果是0和1的情况,需要分类讨论,不利于梯度下降。我们将其简化成一个式子。

那么代价函数通过激活函数再对theta求偏导,得到的更新参数的梯度下降公式如下。

其他优化代价方程的方法 Advanced Optimization

除了梯度下降,我们还有共轭梯度法、变尺度法、限制变尺度法。

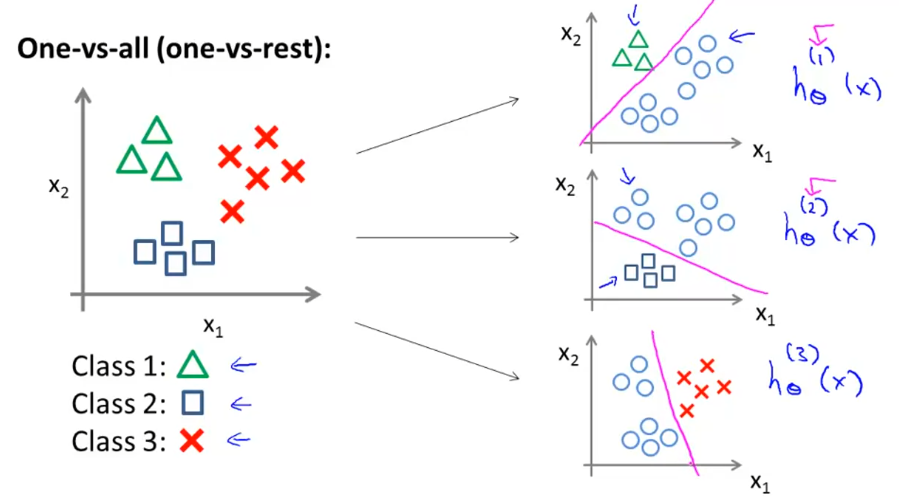

3.3 Multiclass Classification: One-vs-all

分类问题并不单单只有二分类问题,事实上我们经常需要甄别多种类别。

面对这些多分类问题时,我们可以把它们当成多个二分类问题。

正则化 Regularization

3.4 解决过拟合问题 Solving Problem of Overfitting

什么是过拟合?The Problem of Overfitting

过拟合是指面对过多特征时,假设函数过度适度训练集,而不能很好地在测试集上泛化。

欠拟合同样在测试集上表现很差,但是它在训练集上表现得也不如意。

面对过拟合,我们可以采用删除一些特征或者进行正则化。

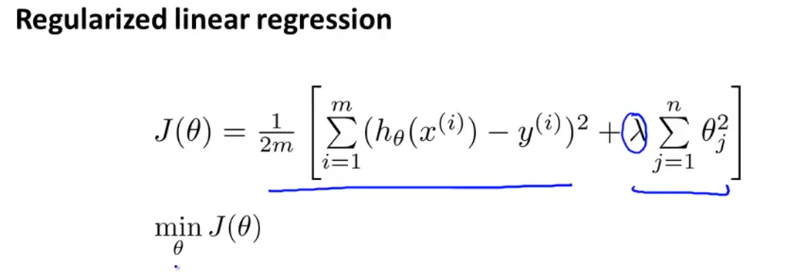

正则化的代价方程 Cost Function with Regularization

正则化指在代价方程中给每个特征添加一项正则项。

引入正则化之后,会抑制参数的大小,避免过拟合。

正则化项前都有一个正则化参数lambda,它不能太大否则只能获得一条直线,也不能太小否则没啥用了。

接下来我们看一下加入正则项后的代价方程在线性回归和逻辑回归中如何梯度下降。

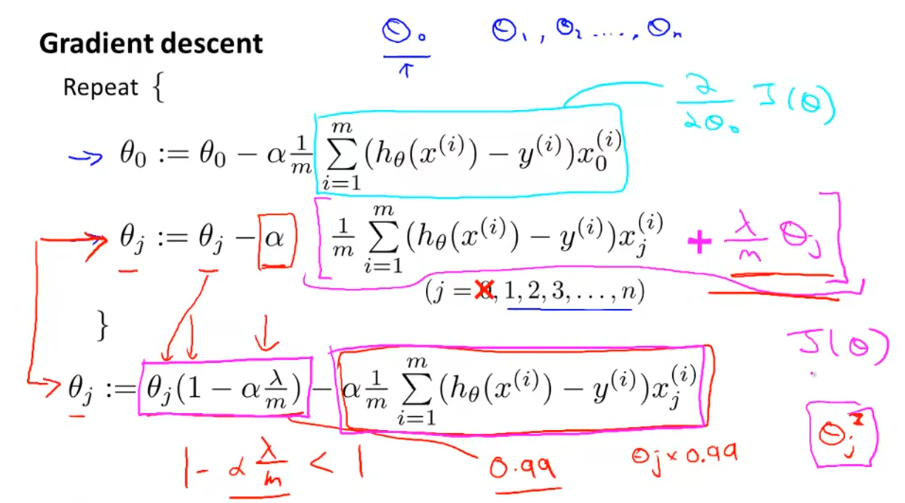

正则化后的线性回归 Regularized Linear Regression

对于线性回归的求解 我们之前 推导了两种学习算法 一种基于梯度下降 一种基于正规方程。

对于梯度下降

对于正规方程

正则化后的逻辑回归 Regularized Logistic Regression

因为使用sigmoid激活函数的逻辑回归梯度下降参数更新的式子和线性回归的差不多,所以正则化处理也差不多。