提出了一种利用自监督学习的测试时 Domain Adaptation 的方法,利用源域数据初始化模型,在测试时接近在线地对目标与数据进行适应。

算法分为几个主要模块:

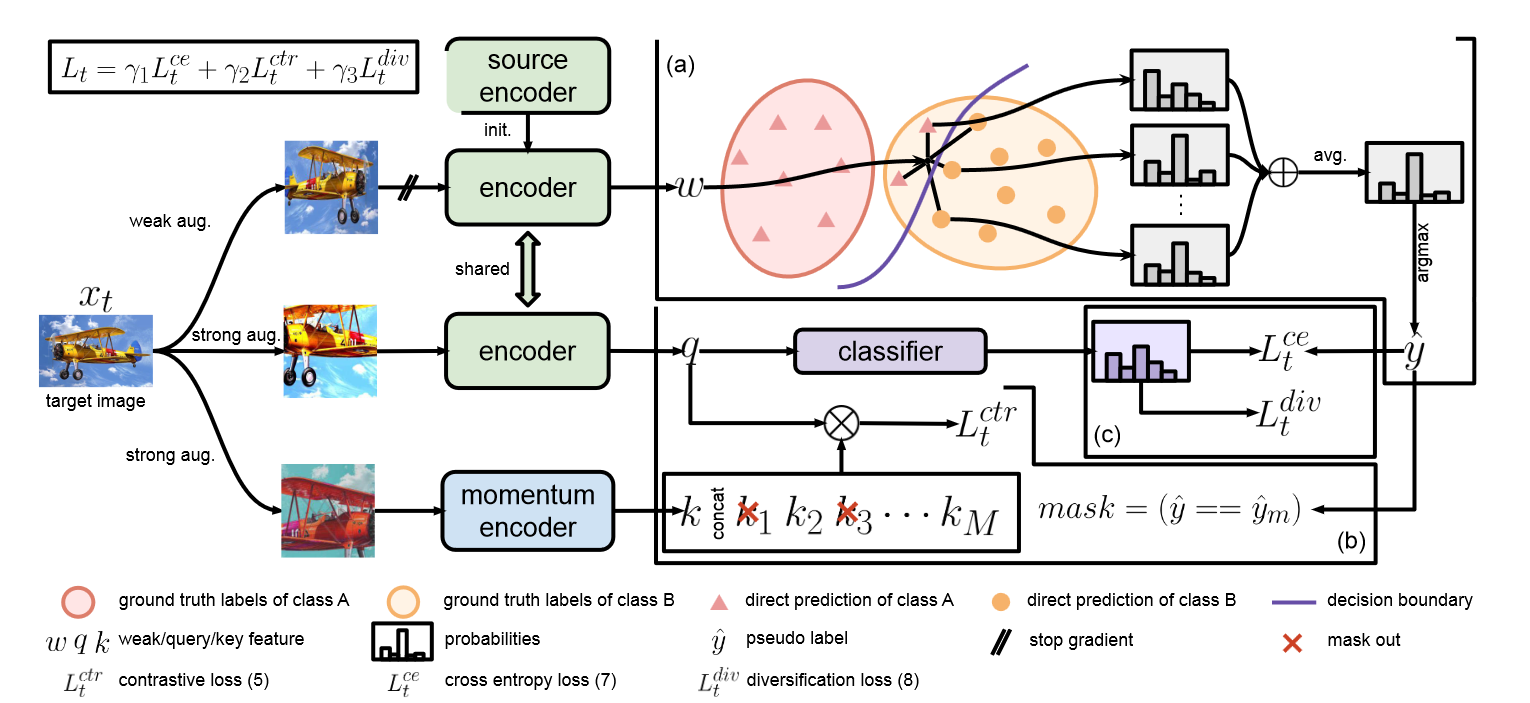

- 标记改正:构建一个存储样本的队列,利用样本的增广在队列中样本寻找临近样本,用临近样本地概率集成以改正样本的标记。

- 仅利用了一阶的临近信息,利用样本图修改标记能够提供更加丰富信息,例如借鉴 TLP 工作。

- 利用数据增广操作来数据的数据中的域变化。

- 模型在线更新:将单样本更新替换为 Mini-Batch 更新,利用改进的自监督方法 MoCo 从新数据逐渐优化模型。

- 在源域已经收敛的模型基础上更新,可以快速收敛。

- 对模型参数进行指数集成逐渐向新模型更新。

- 若干正则化损失:半监督正则化。

- FixMatch的强弱增广损失

- 熵最小化损失

代码:https://github.com/DianCh/AdaContrast

详情页:https://sites.google.com/view/adacontrast