线性回归

通过有监督的学习,学习到由x到y的映射f,因为y为连续值,所以是回归问题。

单变量:

多变量

线性回归的表达式(决策函数)

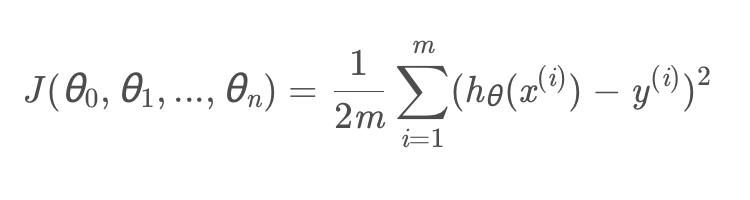

线性回归损失函数

利用损失函数来衡量,损失函数度量预测值和标准答案的偏差,不同的参数有不同的偏差,所以要通过最小化损失函数,也就是最小化偏差来得到最好的参数。

注:因为有m个样本,所以要平均,分母的2是为了求导方便

线性回归优化方法

监督学习的优化方法=损失函数+对损失函数的优化

找最低点,求极值是利用梯度下降法。求极值会遇到欠拟合和过拟合的问题,然后利用利用正则化以及增加数据解决过拟合问题,利用增加训练次数来解决欠拟合

欠拟合和过拟合:

传送门:https://www.yuque.com/dengxiaotian0212/klyctg/goh08k#MLcBn

正则化的作用:

① 控制参数变化幅度,对变化大的参数惩罚

② 限制参数搜索空间

添加正则化的损失函数:

逻辑回归

解决二分类问题,本质:在空间中找到一个决策边界来完成分类的决策

逻辑回归的表达式

为什么使用sigmoid函数:

- 首先是将 (−∞,+∞)映射到(0,1) 之间

- 求导简单

- 可以将 1/2 作为决策边界

逻辑回归损失函数

log的作用逻辑回归和线性回归区别

区别1: 线性回归可以预测连续值,但是不能解决分类问题,我们需要根据预测的结果判定其属于正类还是负类。所以逻辑回归就是将线性回归的 (−∞,+∞)结果,通过sigmoid函数映射到 ( 0 , 1 ) 之间。

区别2:损失函数:线性回归是均方误差+正则化(左图),逻辑回归是新定义的一个凸函数对数损失函数(右图),方便训练。为什么不用均方误差

为什么逻辑回归比线性回归好

虽然逻辑回归能够用于分类,不过其本质还是线性回归。它仅在线性回归的基础上,在特征到结果的映射中加入了一层sigmoid函数(非线性)映射,即先把特征线性求和,然后使用sigmoid函数来预测。

这主要是由于线性回归在整个实数域内敏感度一致,而分类范围,需要在[0,1]之内。而逻辑回归就是一种减小预测范围,将预测值限定为[0,1]间的一种回归模型,其回归方程与回归曲线如下图所示。逻辑曲线在z=0时,十分敏感,在z>>0或z<<0处,都不敏感,将预测值限定为(0,1)。

LR在线性回归的实数范围输出值上施加sigmoid函数将值收敛到0~1范围, 其目标函数也因此从差平方和函数变为对数损失函数, 以提供最优化所需导数(sigmoid函数是softmax函数的二元特例, 其导数均为函数值的f(1-f)形式)。请注意, LR往往是解决二元0/1分类问题的, 只是它和线性回归耦合太紧, 不自觉也冠了个回归的名字(马甲无处不在)。*若要求多元分类,就要把sigmoid换成大名鼎鼎的softmax了。

首先逻辑回归和线性回归首先都是广义的线性回归,其次经典线性模型的优化目标函数是最小二乘,而逻辑回归则是似然函数,另外线性回归在整个实数域范围内进行预测,敏感度一致,而分类范围,需要在[0,1]。逻辑回归就是一种减小预测范围,将预测值限定为[0,1]间的一种回归模型,因而对于这类问题来说,逻辑回归的鲁棒性比线性回归的要好。

逻辑回归的模型本质上是一个线性回归模型,逻辑回归都是以线性回归为理论支持的。但线性回归模型无法做到sigmoid的非线性形式,sigmoid可以轻松处理0/1分类问题。

————————————————

版权声明:本文为CSDN博主「呆呆的猫」的原创文章

原文链接:https://blog.csdn.net/jiaoyangwm/article/details/81139362