咕咕咕

实验 0:用多层全连接拟合一条二次曲线

问题一:什么是激励函数

在一个神经网络中,会有很多层,第一层为输出层,最后一层为输出层,中间的都为隐藏层。在神经网络中,上一层的(从输出层开始)神经元节点的值会作为输入属性值传递给下一层(直至输出层),那么在传递的过程中上一层与下一层应该有一个对应的函数关系,这个函数被称为激励函数。默认情况下激励函数为f(x)=x,这不就自己吗?(bushi。可以看出,在这种情况下,后面每一个隐藏层,甚至输出层的数值都是输入层数值的线性组合,这样的话隐藏层就失去了意义,就会使网络的逼能力相当有限。因此,要想网络的逼近能力比较强大,必须引入非线性的激励函数来作用。

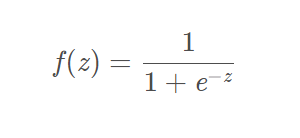

常见的激励函数有Sigmoid函数 ,这个函数离散老师提起过,说是可以让整个实数域与(0,1)对应,在计算机领域上有着相当重要的地位。

,这个函数离散老师提起过,说是可以让整个实数域与(0,1)对应,在计算机领域上有着相当重要的地位。

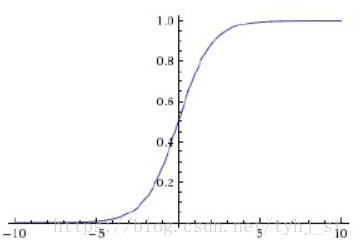

果不其然,它长这样 定义域(-∞,+∞),值域(0,1)

定义域(-∞,+∞),值域(0,1)

问题二:为什么不加激活函数多层全连接的输出一直是直线?

因为下一层的值是前一层的线性组合,然后无限套娃,输出值是输入值的线性组合

探索一:梯度下降在神经网络里是怎么工作的?

实验 1:帮忙!帮帮外星人,帮帮小L!帮不了啊

等我学会了就帮你