1、感知机

(有两个输入的感知机)

2、从感知机到神经网络

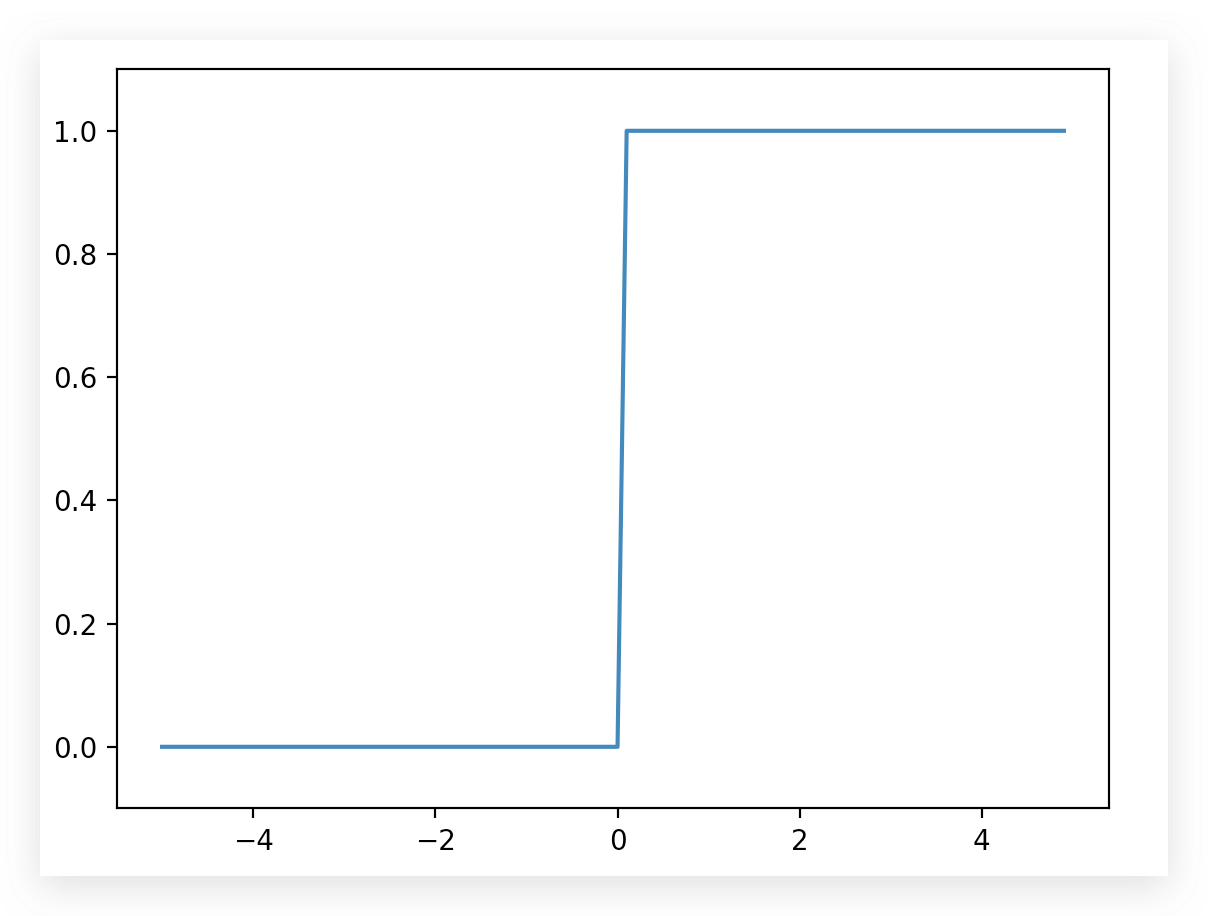

2.1 激活函数 — 阶跃函数(单层感知机)

def step_function(x):if x > 0:return 1else:return 0

(阶跃函数图形)

2.2 激活函数 — sigmod函数

一般用于逻辑回归中

import numpy as npdef sigmoid(x):return 1 / (1 + np.exp(-x))

(sigmoid函数图形)

2.3 激活函数 — ReLU函数

一般用于线性回归中

import numpy as npdef relu(x):return np.maximum(0, x)

(ReLU函数图形)

2.4 激活函数 — 恒等函数

2.5 激活函数 — softmax函数

函数特征:输出值是在0~1之间的实数,且输出值的总和是1。

import numpy as npdef softmax(a):# 此刻的c是为了防止指数过大导致溢出c = np.max(a)exp_a = np.exp(a - c)sum_exp_a = np.exp(exp_a)y = exp_a / sum_exp_areturn y

3、输出层激活函数的选择

在神经网络中,一般设计到的是分类和回归问题,此时需要我们根据不同的情况选择不同的激活函数。一般来说回归问题选择恒等函数,分类问题选择softmax函数