1、基本思想

K近邻算法,即是给定一个训练数据集,对新的输入实例,在训练数据集中找到与该实例最邻近的K个实例,这K个实例的多数属于某个类,就把该输入实例分类到这个类中。

2、如何选择距离

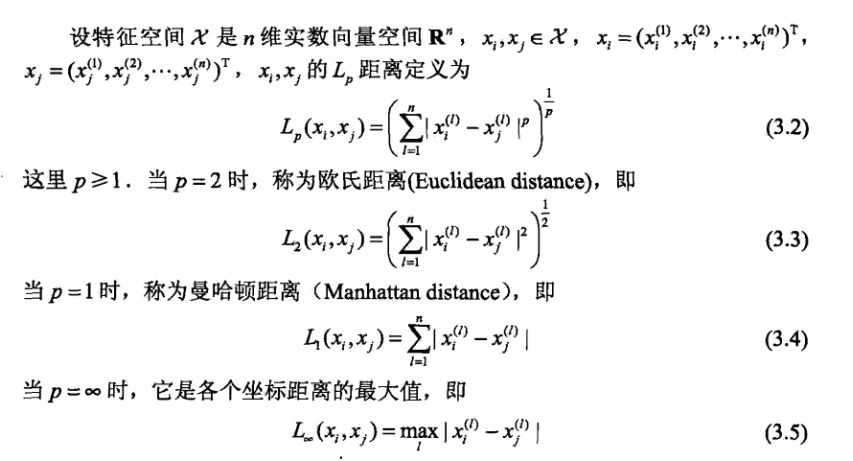

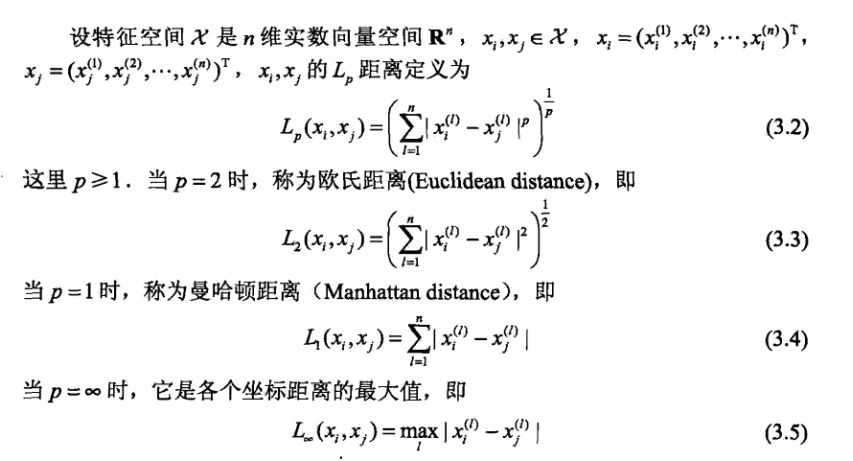

与该实例最近邻的k个实例,这个最近邻的定义是通过不同距离函数来定义,我们最常用的是欧式距离。

3、k值该如何选择?

我们一般选取一个较小的数值,通常采取 交叉验证法来选取最优的k值

4、特征归一化

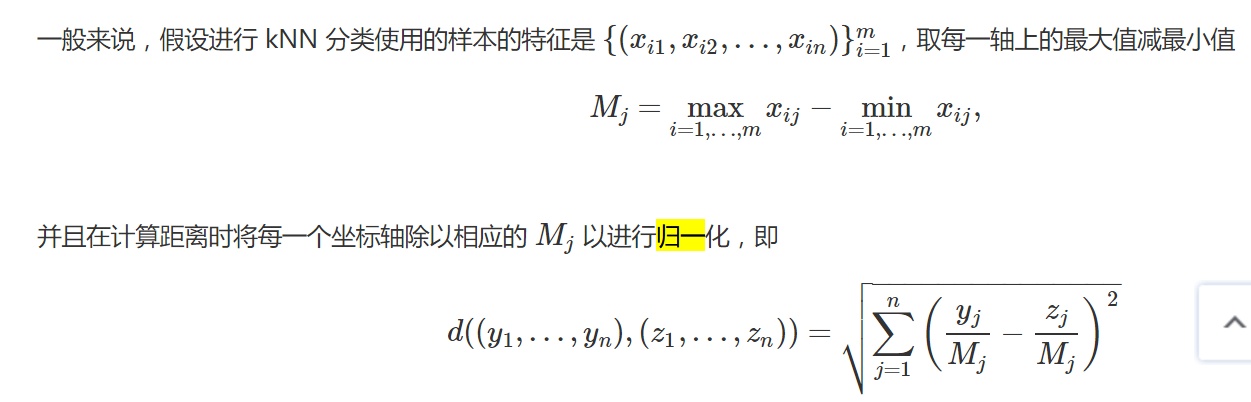

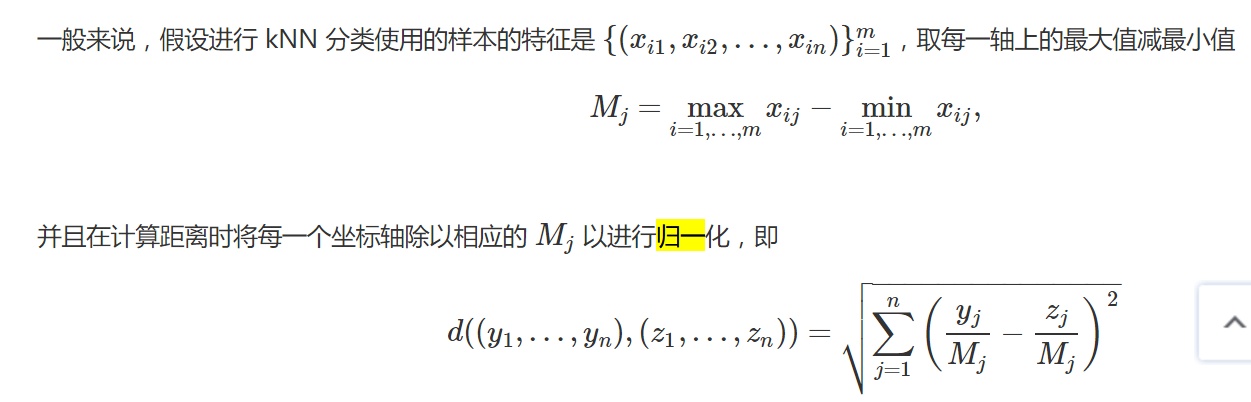

归一化的目的就是取消不同特征值的“权重”问题,使得不同的特征值是等价的

K近邻算法,即是给定一个训练数据集,对新的输入实例,在训练数据集中找到与该实例最邻近的K个实例,这K个实例的多数属于某个类,就把该输入实例分类到这个类中。

与该实例最近邻的k个实例,这个最近邻的定义是通过不同距离函数来定义,我们最常用的是欧式距离。

我们一般选取一个较小的数值,通常采取 交叉验证法来选取最优的k值

归一化的目的就是取消不同特征值的“权重”问题,使得不同的特征值是等价的

让时间为你证明