概述

Flume是一个分布式、可靠、和高可用的海量日志采集、聚合和传输的系统。flume可以适用于大部分的日常数据采集场景

- Flume可以采集文件,socket数据包、文件、文件夹、kafka等各种形式源数据,又可以将采集到的数据(下沉sink)输出到HDFS、hbase、hive、kafka等众多外部存储系统中

- 一般的采集需求,通过对flume的简单配置即可实现

- Flume针对特殊场景也具备良好的自定义扩展能力

运行机制

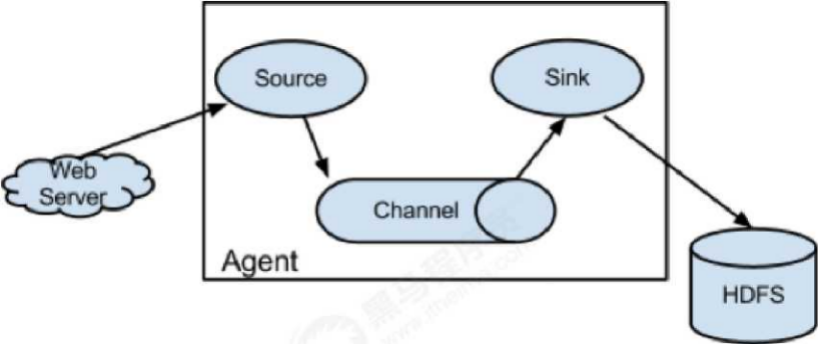

- Flume分布式系统中最核心的角色是agent, flume采集系统就是由一个个agent所连接起来形成

每一个agent相当于一个数据传递员,内部有三个组件:

1. Source:采集组件,用于跟数据源对接,以获取数据<br /> 2. Sink:下沉组件,用于往下一级agent传递数据或者往最终存储系统传递数据<br /> 3. Channel:传输通道组件,用于从source将数据传递到sink<br />

安装

Step 1:下載解压修改配置文件

下载地址:http://archive.apache.org/dist/flume/1.8.0/apache-flume-1.8.0-bin.tar.gz

Flume的安装非常简单,只需要解压即可,当然前提是已有hadoop环境,然后上传安装包到数据源所在节点上。这里我们采用在第三台机器来进行安装cd /export/softwares/# 将安装包解压到我们的servers目录tar -zxvf apache-flume-1.8.0-bin.tar.gz -C ../servers/cd /export/servers/apache-flume-1.8.0-bin/confcp flume-env.sh.template flume-env.shvim flume-env.sh# 打开注释,配置java环境export JAVA_HOME=/export/servers/jdkl.8.0_141

Step 2:开发配置文件

根据数据采集的需求配置采集方案,描述在配置文件中(文件名可任意自定义)配置我们的网络收集的配置文件。在flume的conf目录下新建一个配置文件(采集方案),a1代表agent ```shell vim /export/servers/apache-flume-1.8.0-bin/conf/netcat-logger.conf定义这个agent中各组件的名字

a1.sources = r1 a1.sinks = k1 a1.channels = c1

描述和配置source组件:r1

a1.sources.r1.type = netcat a1.sources.r1.bind = 192.168.174.120 a1.sources.r1.port = 44444

描述和配置sink组件:k1

a1.sinks.k1.type = logger

描述和配置channel组件,此处使用是内存缓存的方式

a1.channels.c1.type = memory a1.channels.c1.capacity = 1000 a1.channels.c1.transactionCapacity = 100

描述和配置source channel sink之间的连接关系

a1.sources.r1.channels = c1 a1.sinks.k1.channel = c1

**Step 3: **启动配置文件 <br />指定采集方案配置文件,在相应的节点上启动flflume agent ,进入它的bin目录执行启动agent去采集数据 。```shellbin/flume-ng agent -c conf -f conf/netcat-logger.conf -n a1 -Dflume.root.logger=INFO,c

-c conf 指定flflume自身的配置文件所在目录 -f conf/netcat-logger.con 指定我们所描述的采集方案 -n a1 指定我们这个agent的名字

Step 4: 安装 Telnet 准备测试

在node02机器上面安装telnet客户端,用于模拟数据的发送 ,然后通过flume采集网络端口数据

yum -y install telnet# 使用node02向 node03 telnet模拟数据发送telnet node03 44444

案例

案例一(目录)

某服务器的某特定目录下,会不断产生新的文件,每当有新文件出现,就需要把文件采集到HDFS中去。比我我们项目中的日志文件log4j

实现步骤

配置conf文件,并启动flume

编写一个配置文件xxxx.conf,编写完成并启动

# 定义这个agent中各组件的名字a1.sources = r1a1.sinks = k1a1.channels = c1# 描述和配置source组件:r1a1.sources.r1.type = spooldir #监控文件目录,只要显示新文件就会采集文件中的内容 ,采集完成的文件会被agnet自动添加一个后缀:COMPLETED,监控目录不允许同名文件a1.sources.r1.spoolDir = /export/servers/dirfilea1.sources.r1.fileHeader = true# 描述和配置channel组件,此处使用是内存缓存的方式a1.channels.c1.type = memorya1.channels.c1.capacity = 1000 #默认该通道中最大的可以存储的event数量a1.channels.c1.transactionCapacity = 100 #每次最大可以从source中拿到或者送到sink中的event数量# 描述和配置sink组件:k1a1.sinks.k1.type = hdfsa1.sinks.k1.hdfs.path = hdfs://node01:8020/spooldir/files/%y-%m-%d/%H%M/ #会自动创建a1.sinks.k1.hdfs.filePrefix = events-a1.sinks.k1.hdfs.round = truea1.sinks.k1.hdfs.roundValue = 10a1.sinks.k1.hdfs.roundUnit = minutea1.sinks.k1.hdfs.rollInterval = 3 #每间隔3s产生一个新文件a1.sinks.k1.hdfs.rollSize = 20 #文件(hdfs临时文件)大小达到20个产生新文件a1.sinks.k1.hdfs.rollCount = 5 #文件(hdfs临时文件)大小达到5个event产生新文件a1.sinks.k1.hdfs.batchSize = 1a1.sinks.k1.hdfs.useLocalTimeStamp = true#生成的文件类型,默认是Sequencefile,可用DataStream,则为普通文本a1.sinks.k1.hdfs.fileType = DataStream# 描述和配置source channel sink之间的连接关系a1.sources.r1.channels = c1a1.sinks.k1.channel = c1

bin/flume-ng agent -c ./conf -f ./conf/xxxx.conf -n a1 -Dflume.root.logger=INFO,console

上传文件到指定目录

此时我们程序就阻塞在这里,进入到我们监控的目录,手动上传文件进去即可。每上传一个文件,就会发现hdfs中对应目录也会上传,但是此时发现了两个文件,原因应该是我们触发条件的问题,可以将触发产生文件的阈值调大一些。

cd /export/servers/dirfilescp 文件到指定目录

案例二(单个文件)

业务系统使用log4j生成的日志,日志内容不断增加,需要把追加到日志文件中的数据实时采集到

hdfs

实现步骤

配置conf,并启动

# 定义这个agent中各组件的名字agent1.sources = source1agent1.sinks = sink1agent1.channels = channel1agent1.sources.source1.type = execagent1.sources.source1.command = tail -F /export/servers/taillogs/access_logagent1.channels.channel1.type = memoryagent1.channels.channel1.keep-alive = 120agent1.channels.channel1.capacity = 500000agent1.channels.channel1.transactionCapacity = 600 # Bind the source and sink to the channelagent1.sinks.sink1.type = hdfs #a1.sinks.k1.channel = c1agent1.sinks.sink1.hdfs.path = hdfs://node01:8020/weblog/flume-collection/%y-%m-%d/%H-%agent1.sinks.sink1.hdfs.filePrefix = access_log agent1.sinks.sink1.hdfs.maxOpenFiles = 5000agent1.sinks.sink1.hdfs.batchSize= 100agent1.sinks.sink1.hdfs.fileType = DataStreamagent1.sinks.sink1.hdfs.writeFormat =Textagent1.sinks.sink1.hdfs.round = trueagent1.sinks.sink1.hdfs.roundValue = 10agent1.sinks.sink1.hdfs.roundUnit = minuteagent1.sinks.sink1.hdfs.useLocalTimeStamp = true # Use a channel which buffers events in memoryagent1.sources.source1.channels = channel1agent1.sinks.sink1.channel = channel1

cd /export/servers/apache-flume-1.6.0-cdh5.14.0-binbin/flume-ng agent -c conf -f conf/tail-file.conf -n agent1 -Dflume.root.logger=INFO,console

shell脚本定时追加文件内容

每过0.5s向文件输入内容,模拟日志。如果文件达到我们conf设置的阈值,就会产生新文件

mkdir -p /export/servers/shellscd /export/servers/shells/vi tail-file.sh

#!/bin/bashwhile truedodate >> /export/servers/taillogs/access_log;sleep 0.5;done

案例二(目录下多个文件)

对于nginx日志生成场景,如果通过flume(1.6)收集,无论是sqoop directory source和exec source均不能满足动态实时收集的需求,在当前flume1.7稳定版本中,提供了一个非常好用的TarldirSource,这个source可以监控一个目录,并使用正则表达式匹配该目录的文件名进行实时收集。

核心配置如下

a1.sources=r1a1.sources.r1.type=TAILDIRa1.sources.r1.channels=c1a1.sources.r1.positionFile=/var/log/flume/taildir_position.jsona1.sources.r1.filegroups= f1 f2a1.sources.r1.filegroups.f1=/var/log/test1/example.loga1.sources.r1.filegroups.f1=/var/log/test2/*.log.*

- filegroups:监控的文件组,f1 f2表示不同的目录,可以有多个,用空格分隔,也就是说它可以监控多个目录下的文件。

- positionFile:配置检查点文件路径,检查点文件会以json的格式保存。已经tail文件的位置,解决了断电不能续传的缺陷

- filegroups.

:配置了每个filegroup的文件绝对路径,文件名可以使用正则表达式匹配

通过以上配置,就可以监控文件内容的增加和文件的增加。产生和所配置的文件名正则表达式不匹配的文件,则不会被tail

日志

access.log 可以发现这个日志格式是不整齐的,需要我们对数据进行清洗。

参考文档

apache文档参考地址:https://cwiki.apache.org/confluence/#all-updates flume文档参考地址:https://cwiki.apache.org/confluence/display/FLUME/Getting+Started