网络流控的概念与背景

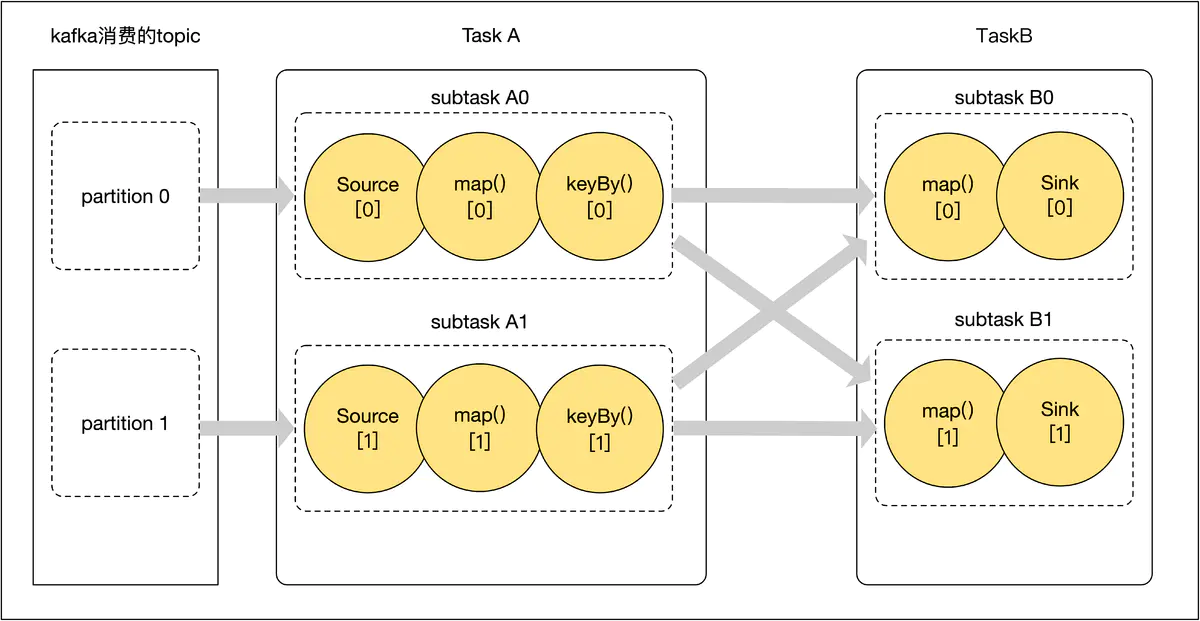

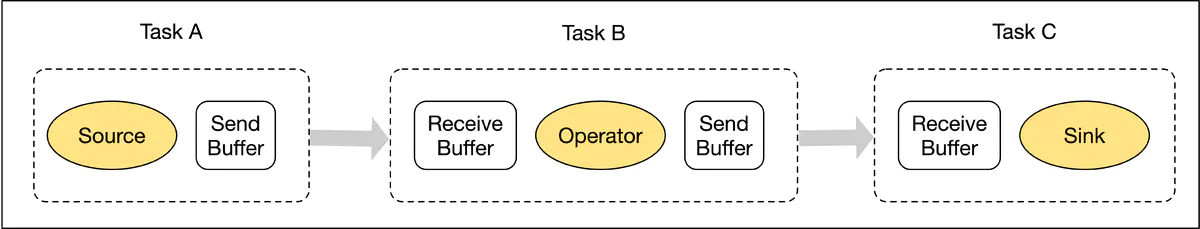

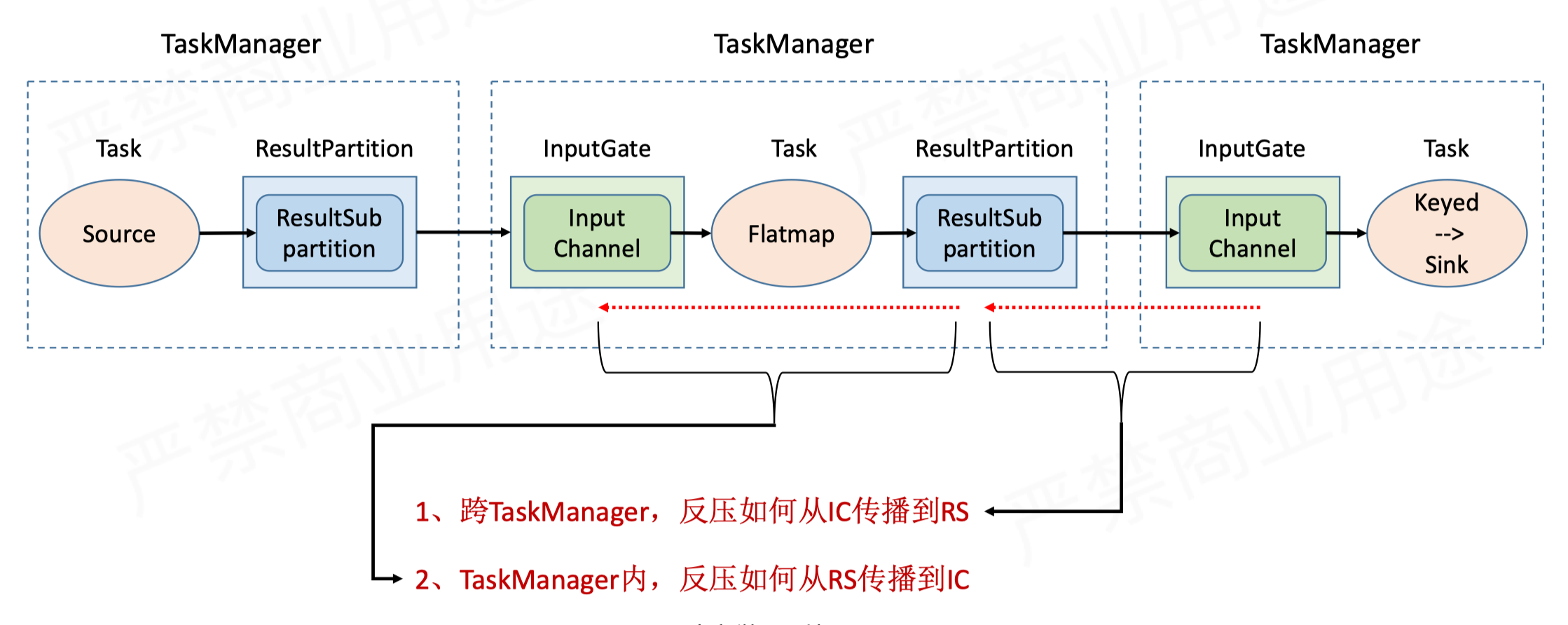

分析一个简单的 Flink 流任务,下图是一个简单的 Flink 流任务执行图:任务首先从 Kafka 中读取数据、 map 算子对数据进行转换、keyBy 按照指定 key 对数据进行分区(相同 key 的数据经过 keyBy 后分到同一个 subtask 实例中),keyBy 后对数据接着进行 map 转换,然后使用 Sink 将数据输出到外部存储。

Flink任务简单示例图

众所周知,在大数据处理中,无论是批处理还是流处理,单点处理的性能总是有限的,我们的单个 Job 一般会运行在多个节点上,多个节点共同配合来提升整个系统的处理性能。图中,任务被切分成 4 个可独立执行的 subtask( A0、A1、B0、B1),在数据处理过程中,就会存在 shuffle(数据传输)的过程。例如,subtask A0 处理完的数据经过 keyBy 后发送到 subtask B0、B1 所在节点去处理。

流控-存在的问题

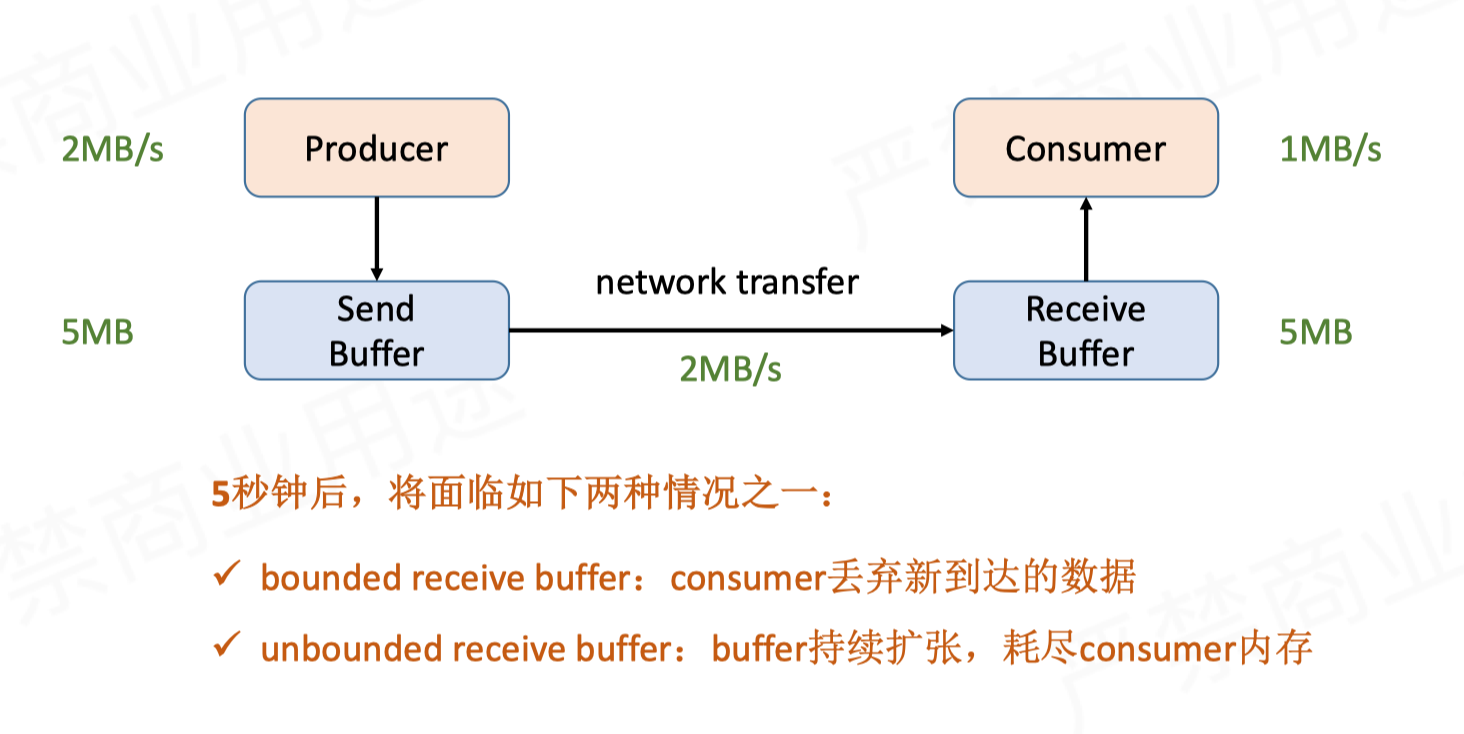

首先我们可以看下这张最精简的网络流控的图,Producer 的吞吐率是 2MB/s,Consumer 是 1MB/s,这个时候我们就会发现在网络通信的时候我们的 Producer 的速度是比 Consumer 要快的,有 1MB/s 的这样的速度差,假定我们两端都有一个 Buffer,Producer 端有一个发送用的 Send Buffer,Consumer 端有一个接收用的 Receive Buffer,在网络端的吞吐率是 2MB/s,过了 5s 后我们的 Receive Buffer 可能就撑不住了,这时候会面临两种情况:- 如果 Receive Buffer 是有界的,这时候新到达的数据就只能被丢弃掉了。

- 如果 Receive Buffer 是无界的,Receive Buffer 会持续的扩张,最终会导致 Consumer 的内存耗尽,OOM,程序挂掉。

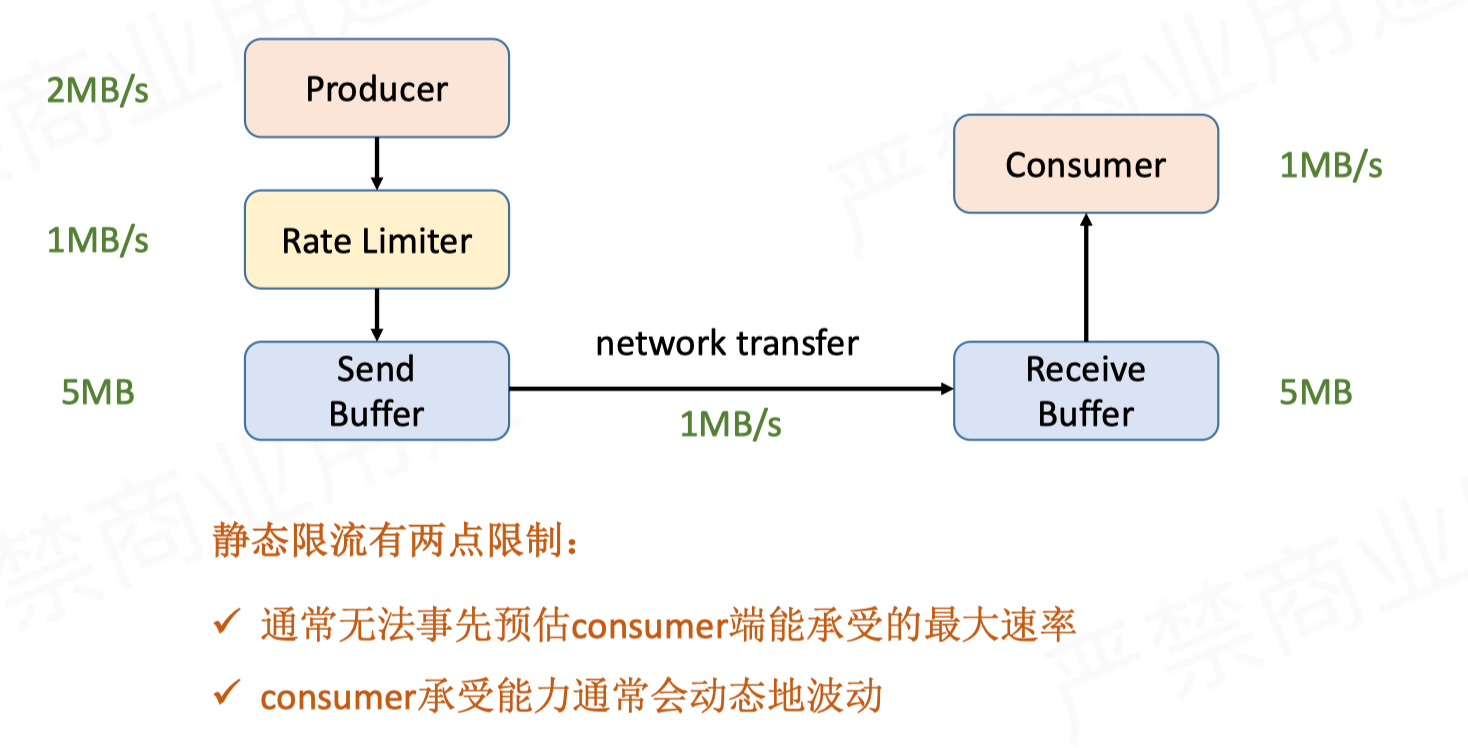

流控-静态限速

为了解决这个问题,我们就需要网络流控来解决上下游速度差的问题,传统的做法可以在 Producer 端实现一个类似 Rate Limiter 这样的静态限流,Producer 的发送速率是 2MB/s,但是经过限流这一层后,往 Send Buffer 去传数据的时候就会降到 1MB/s 了,这样的话 Producer 端的发送速率跟 Consumer 端的处理速率就可以匹配起来了,就不会导致上述问题。但是这个解决方案有两点限制:- 事先无法预估 Consumer 到底能承受多大的速率

- Consumer 的承受能力通常会动态地波动

流控-动态反馈

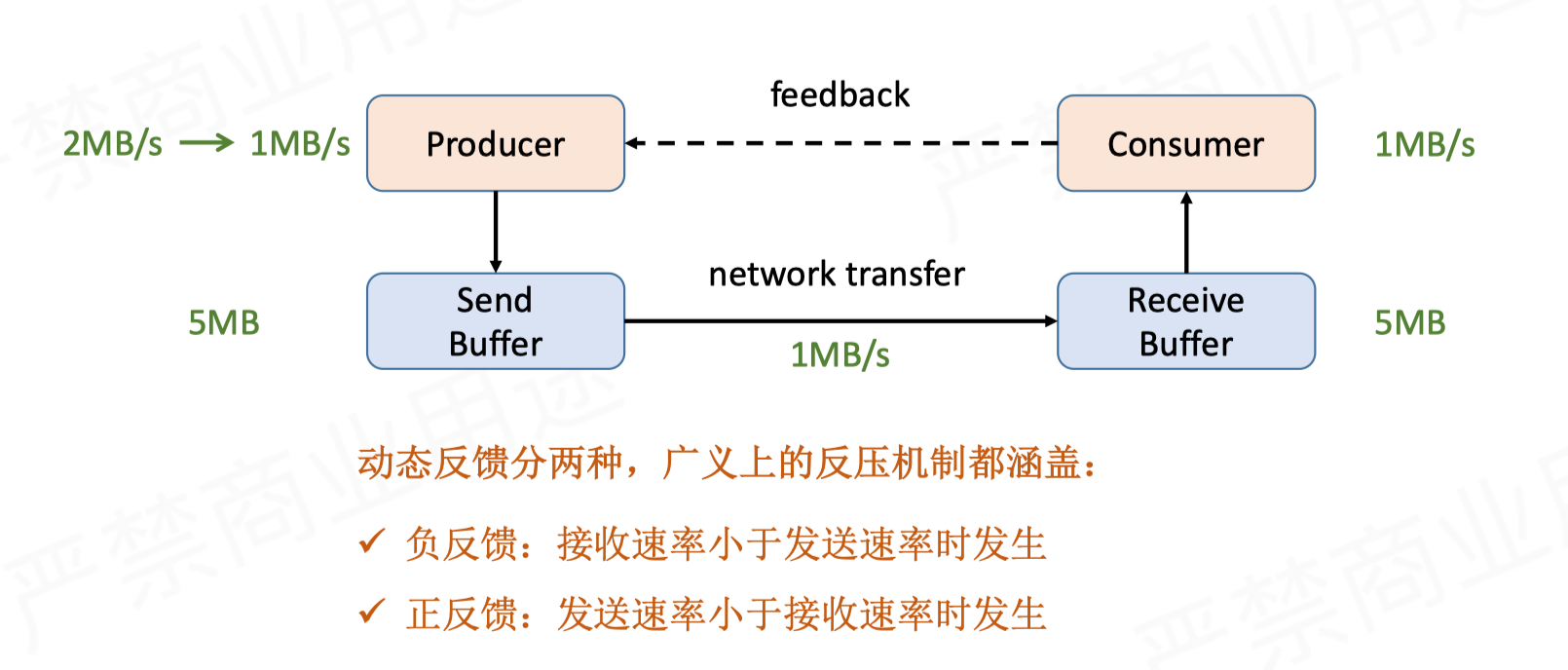

针对静态限速的问题我们就演进到了动态反馈(自动反压)的机制,我们需要 Consumer 能够及时的给 Producer 做一个 feedback,即告知 Producer 能够承受的速率是多少。动态反馈分为两种:- 负反馈:接受速率小于发送速率时发生,告知 Producer 降低发送速率

- 正反馈:发送速率小于接收速率时发生,告知 Producer 可以把发送速率提上来

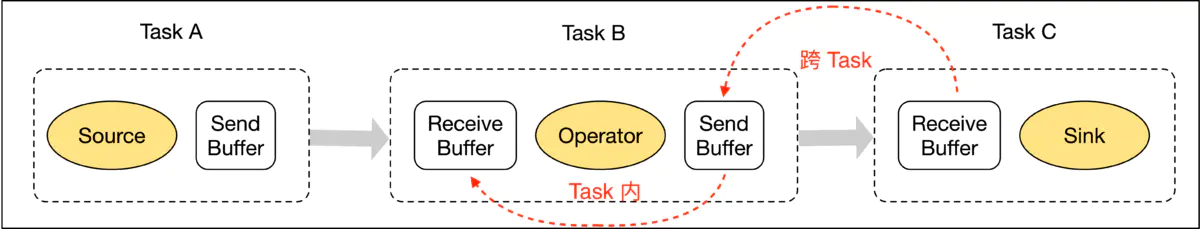

如下图所示,假如我们的 Job 分为 Task A、B、C,Task A 是 Source Task、Task B 处理数据、Task C 是 Sink Task。假如 Task C 由于各种原因吞吐量降低,会将负载信息反馈给 Task B,Task B 会降低向 Task C 发送数据的速率,此时如果 Task B 如果还是一直从 Task A 读取数据,那么按照同样的道理,数据会把 Task B 的 Send Buffer 和 Receive Buffer 撑爆,又会出现上面描述的问题。所以,当 Task B 的 Send Buffer 和 Receive Buffer 被用完后,Task B 会用同样的原理将负载信息反馈给 Task A,Task A 收到 Task B 的负载信息后,会降低给 Task B 发送数据的速率,以此类推。

如果下游 Task C 的负载能力提升后,会及时反馈给 Task B,于是 Task B 会提升往 Task C 发送数据的速率,Task B 又将负载提升的信息反馈给 Task A,Task A 就会提升从 Source 端读取数据的速率,从而提升整个系统的负载能力。

简单的 3 个 Task 图示

上面这个流程,就是 Flink 动态限流(反压机制)的简单描述。我们可以看到 Flink 的反压其实是从下游往上游传播的,一直往上传播到 Source Task 后,Source Task 最终会降低从 Source 端读取数据的速率。

Flink TCP-based 反压机制( before V1.5 版本)

Flink V1.5 之前版本为什么没有 feedback 机制

Flink V1.5 以前版本之所以没有 feedback 机制,是因为 TCP 天然具备 feedback 流控机制,Flink 基于它来实现反压。

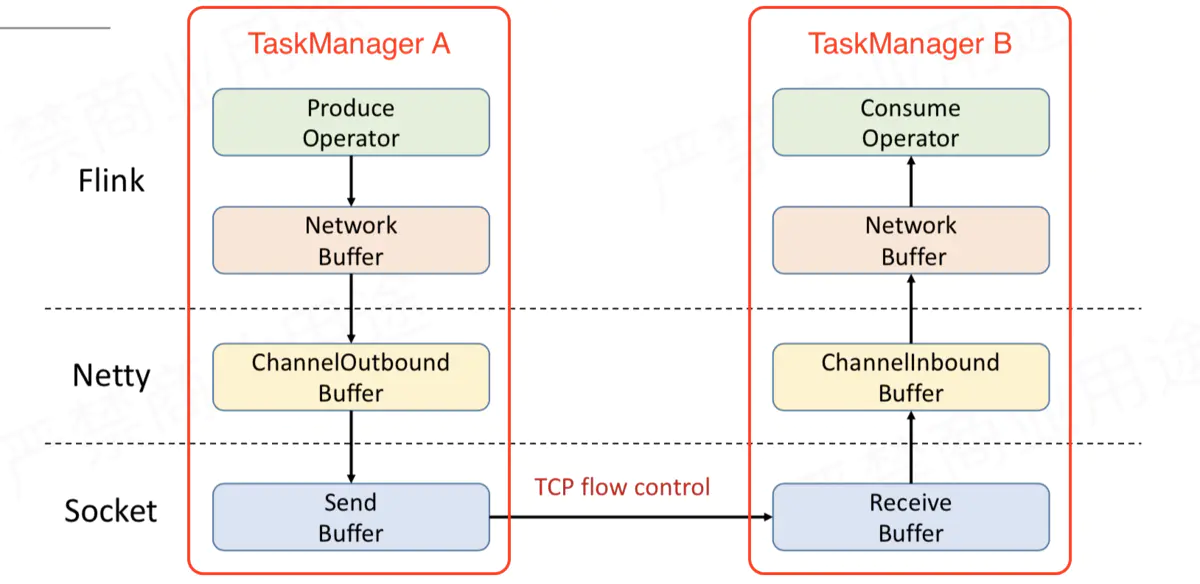

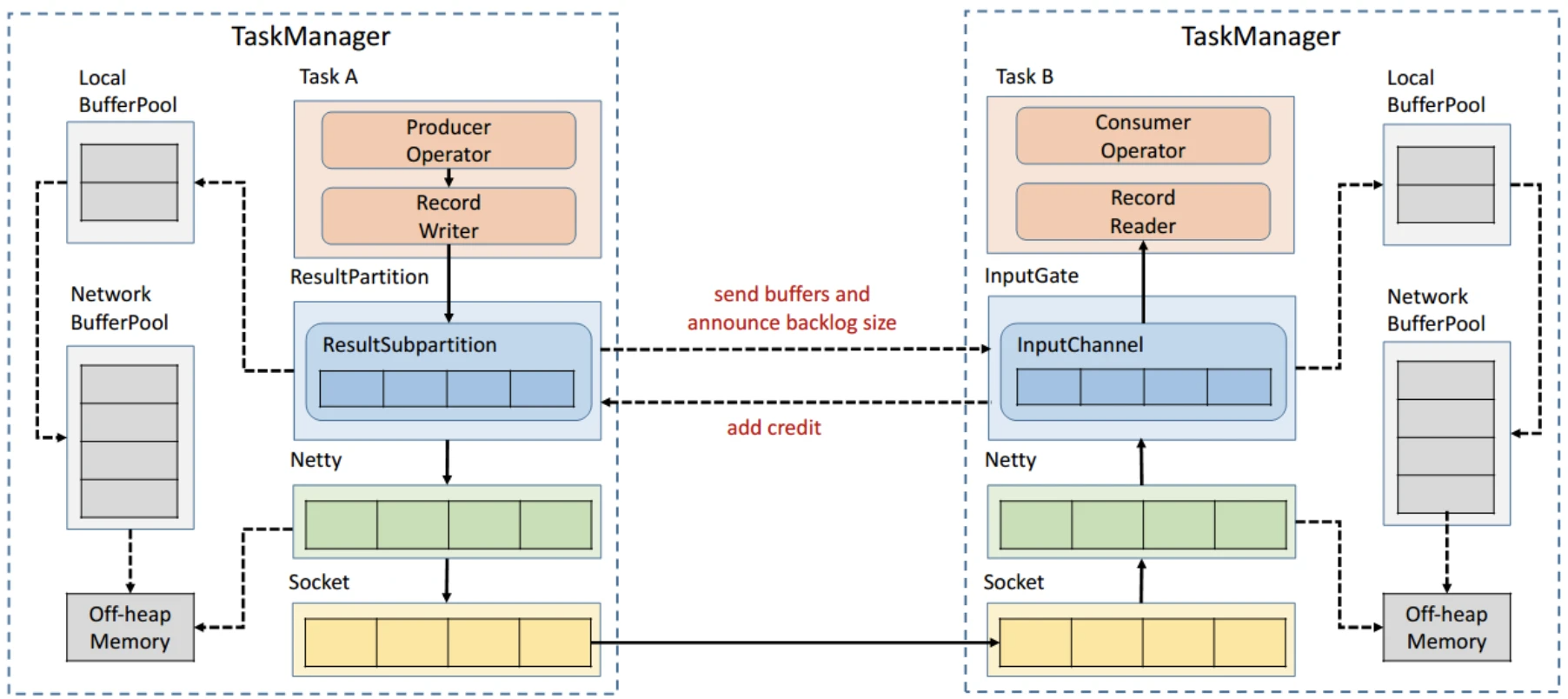

下图是 Flink 的 TaskManager 之间网络传输的数据流向:

Flink 网络传输的数据流向

图中,我们可以看到 TaskManager A 给 TaskManager B 发送数据,TaskManager A 做为 Producer,TaskManager B 做为 Consumer。Producer 端的 Operator 实例会产生数据,最后通过网络发送给 Consumer 端的 Operator 实例。

Producer 端 Operator 实例生产的数据首先缓存到 TaskManager 内部的 Network Buffer。Network 依赖 Netty 来做通信,Producer 端的 Netty 内部有 ChannelOutbound Buffer,Consumer 端的 Netty 内部有 ChannelInbound Buffer。Netty 最终还是要通过 Socket 发送网络请求,Socket 这一层也会有 Buffer,Producer 端有 Send Buffer,Consumer 端有 Receive Buffer。

总结一下,现在有两个 TaskManager A、B,TaskManager A 中 Producer Operator 处理完的数据由 TaskManager B 中 Consumer Operator 处理。那么 Producer Operator 处理完的数据是怎么到达 Consumer Operator 的?首先 Producer Operator 从自己的上游或者外部数据源读取到数据后,对一条条的数据进行处理,处理完的数据首先输出到 Producer Operator 对应的 Network Buffer 中。Buffer 写满或者超时后,就会触发将 Network Buffer 中的数据拷贝到 Producer 端 Netty 的 ChannelOutbound Buffer,之后又把数据拷贝到 Socket 的 Send Buffer 中,这里有一个从用户态拷贝到内核态的过程,最后通过 Socket 发送网络请求,把 Send Buffer 中的数据发送到 Consumer 端的 Receive Buffer。数据到达 Consumer 端后,再依次从 Socket 的 Receive Buffer 拷贝到 Netty 的 ChannelInbound Buffer,再拷贝到 Consumer Operator 的 Network Buffer,最后 Consumer Operator 就可以读到数据进行处理了。

这就是两个 TaskManager 之间的数据传输过程,我们可以看到发送方和接收方各有三层的 Buffer。

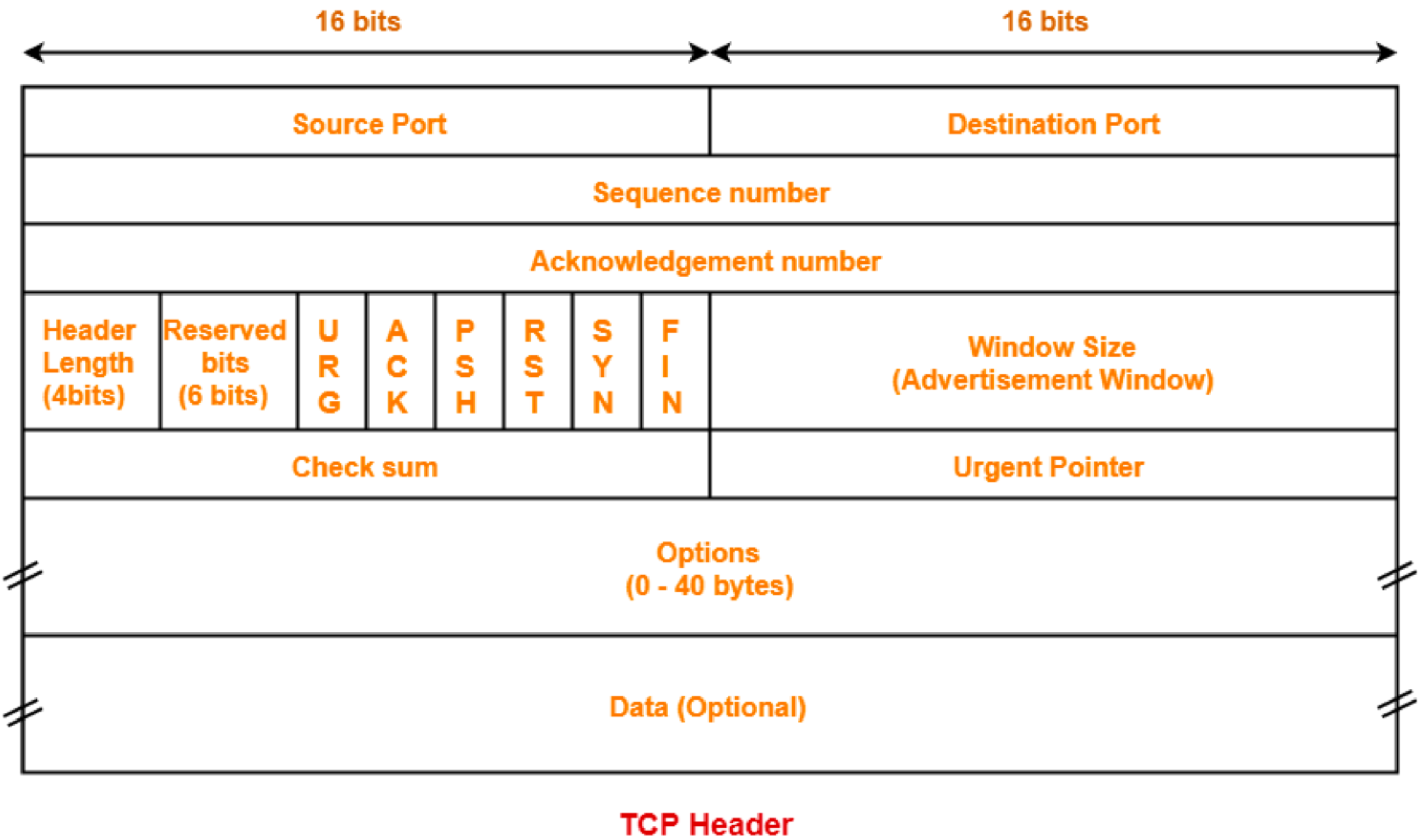

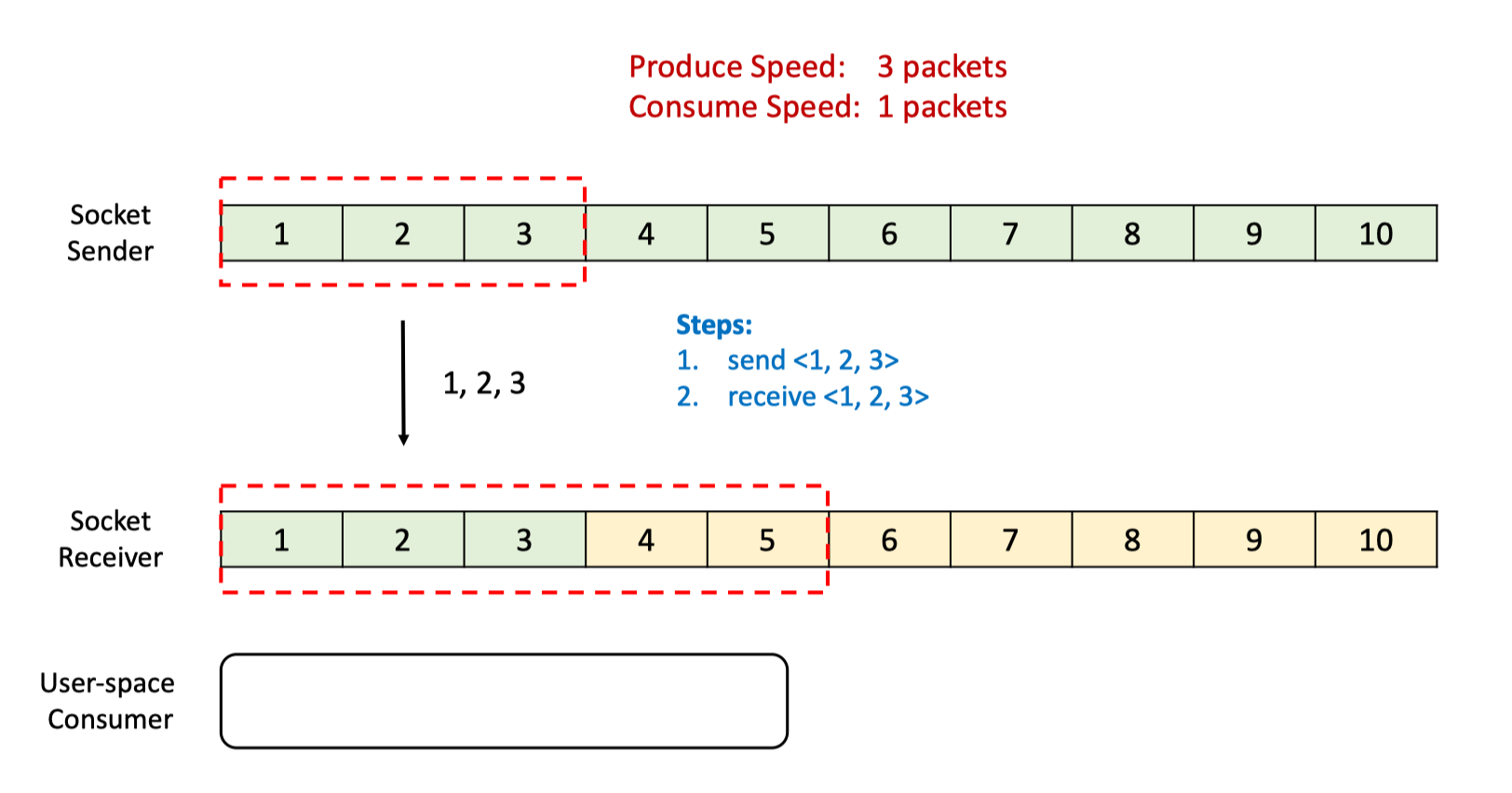

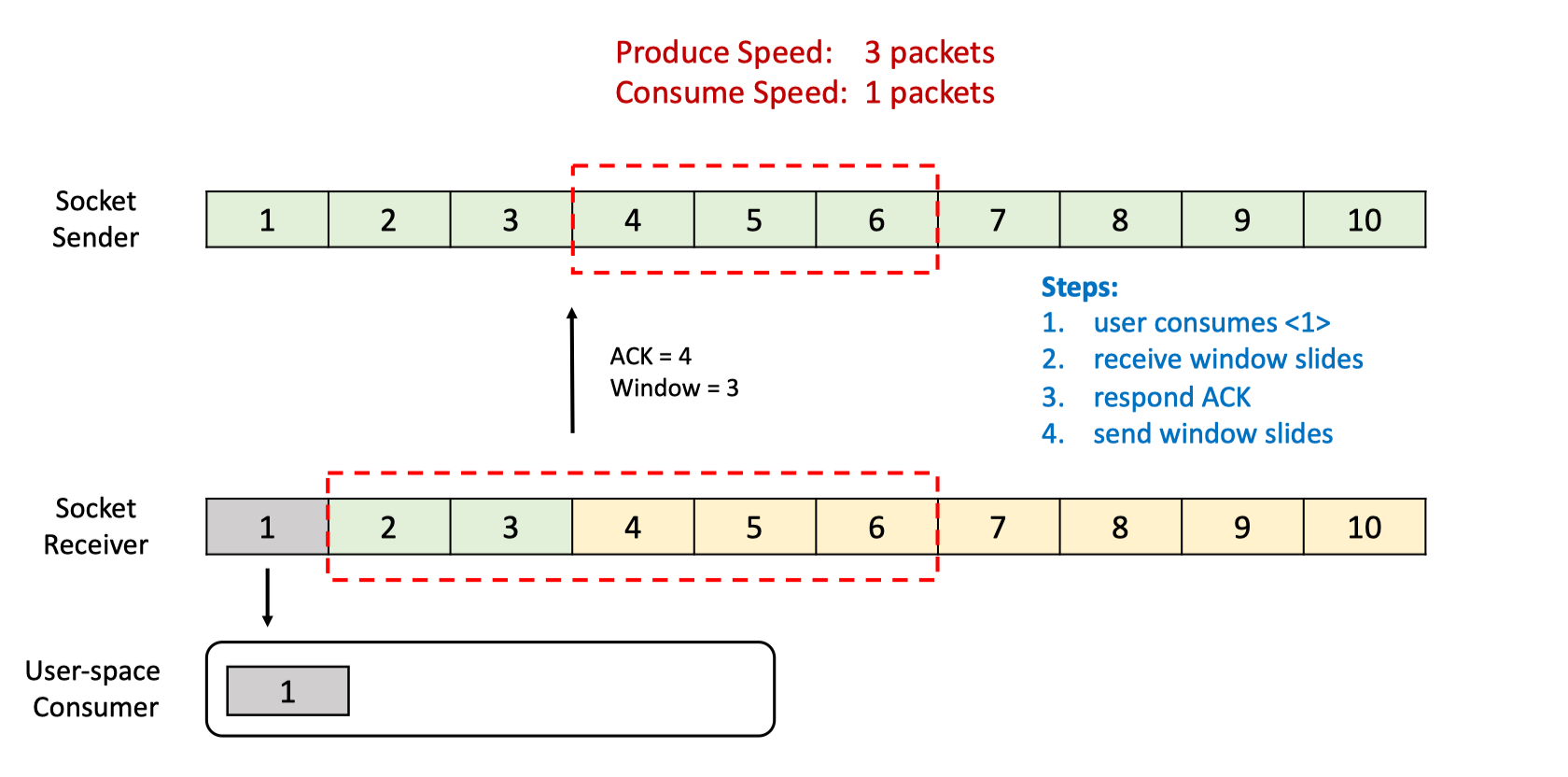

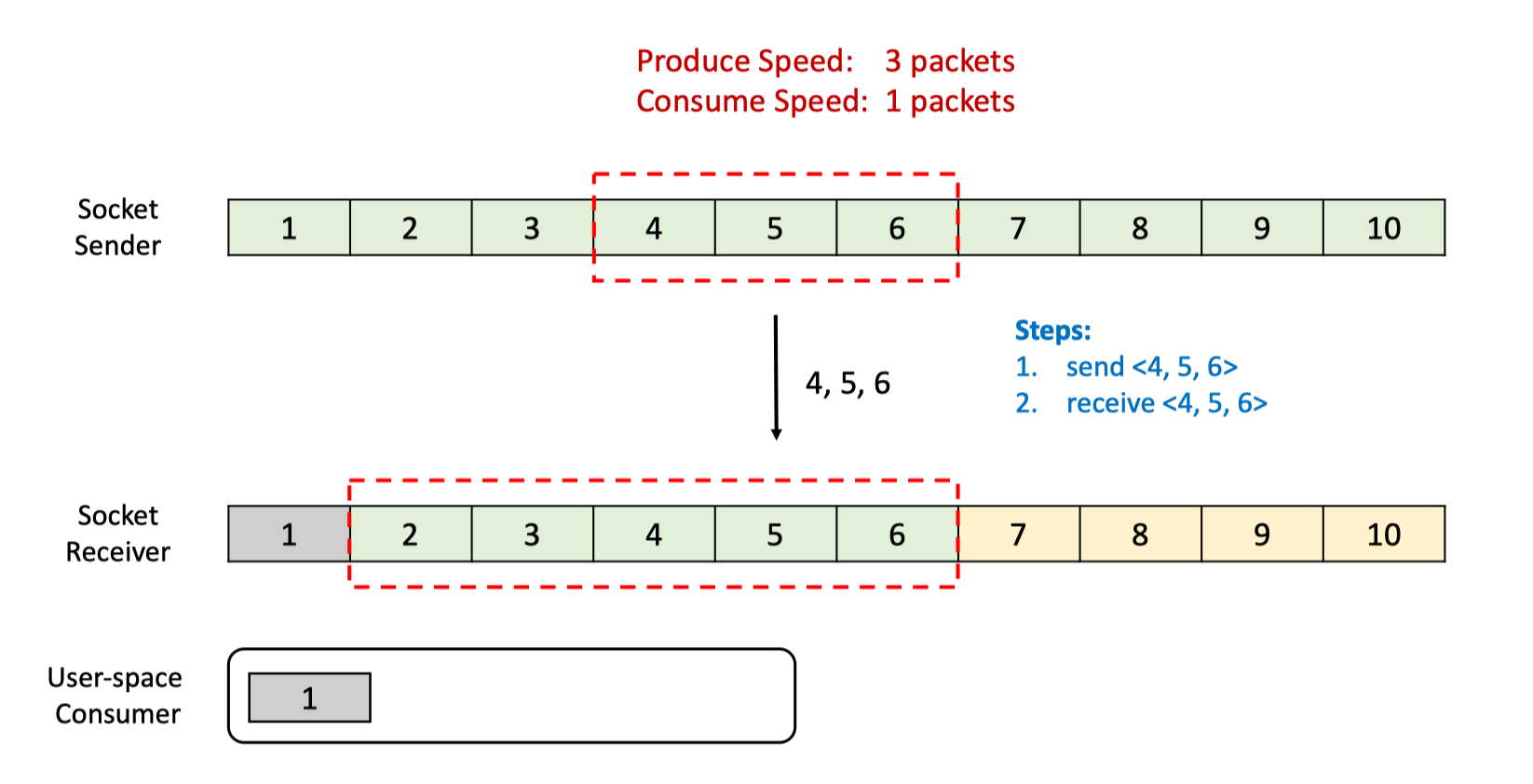

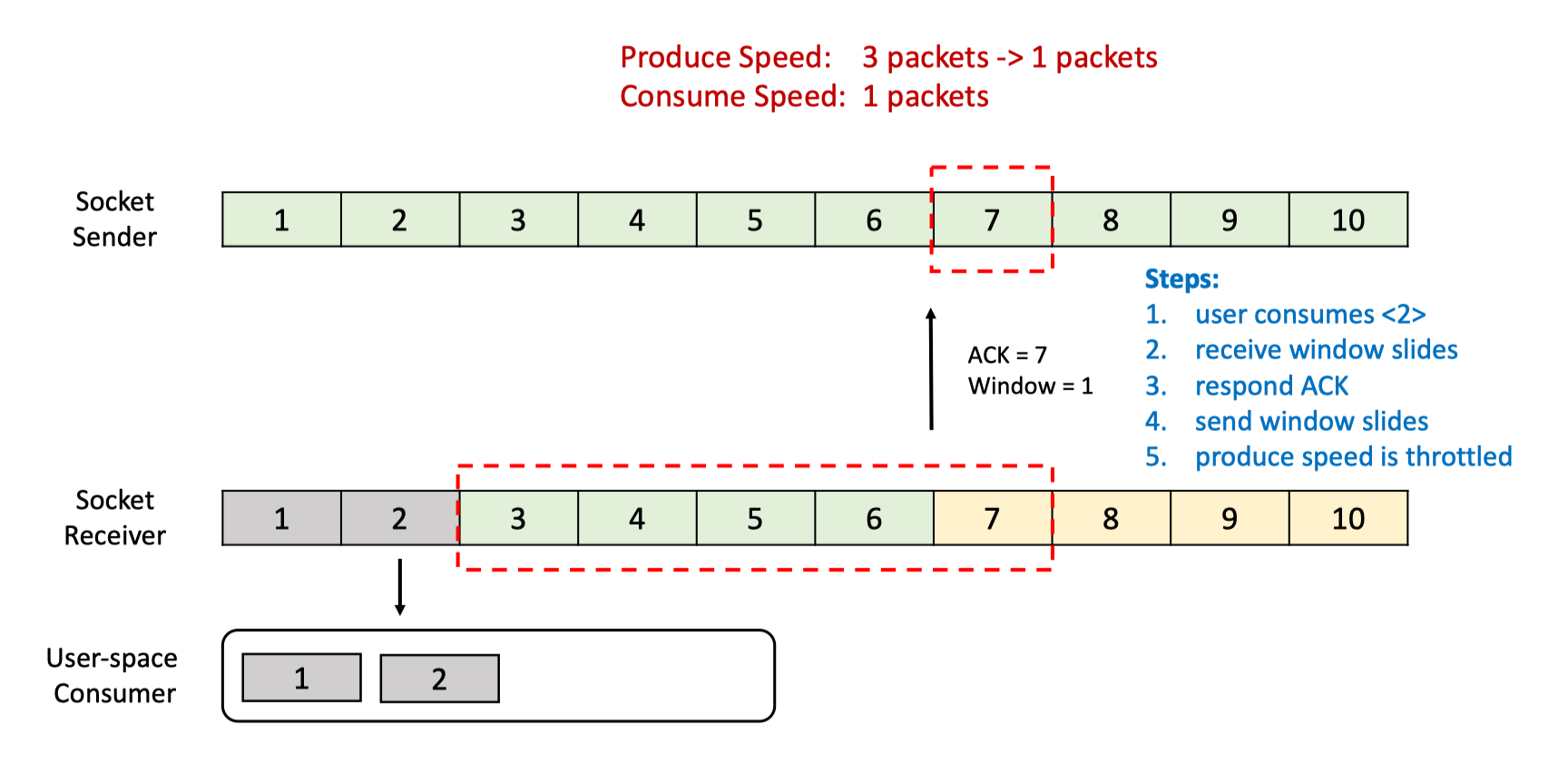

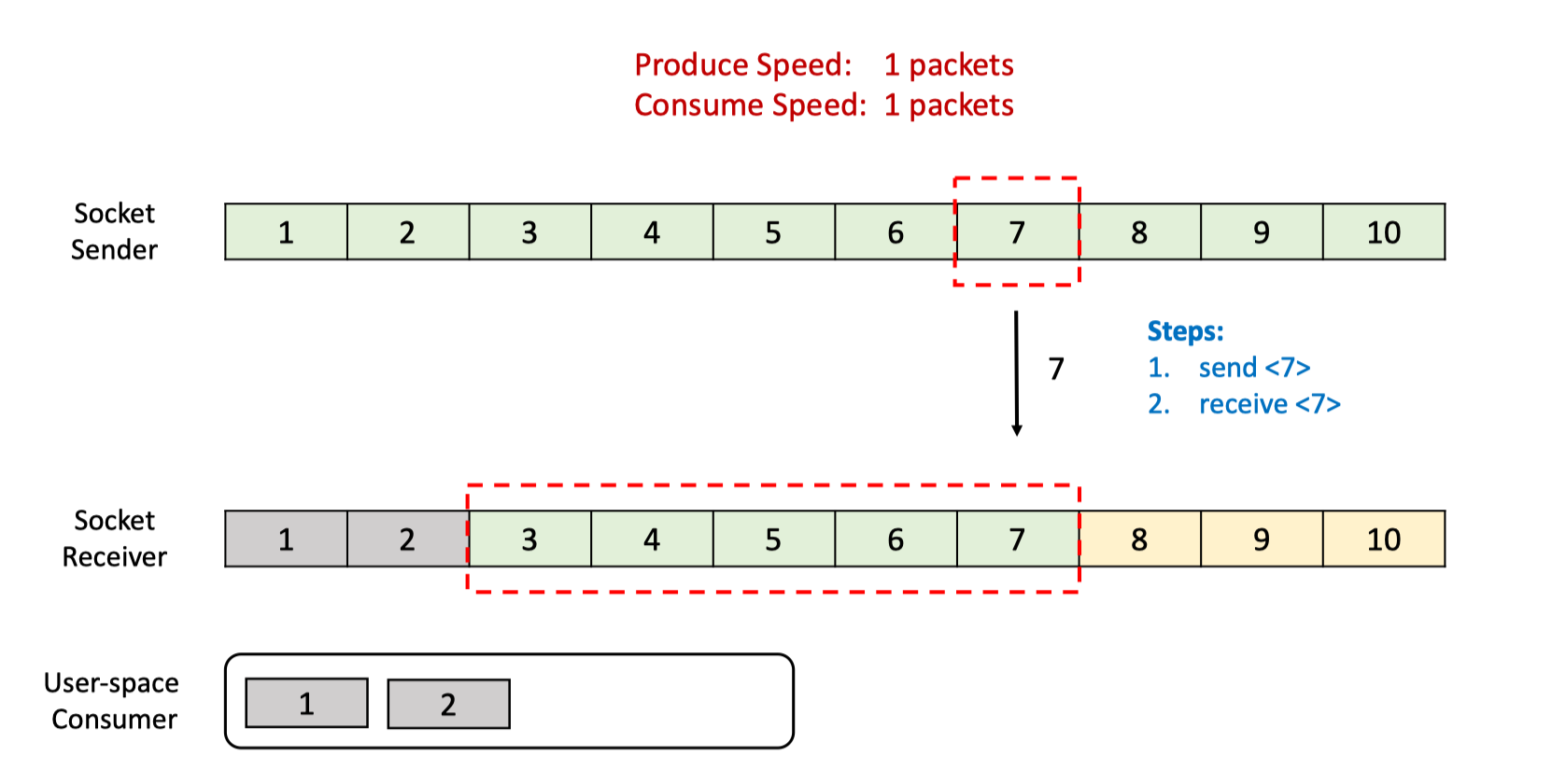

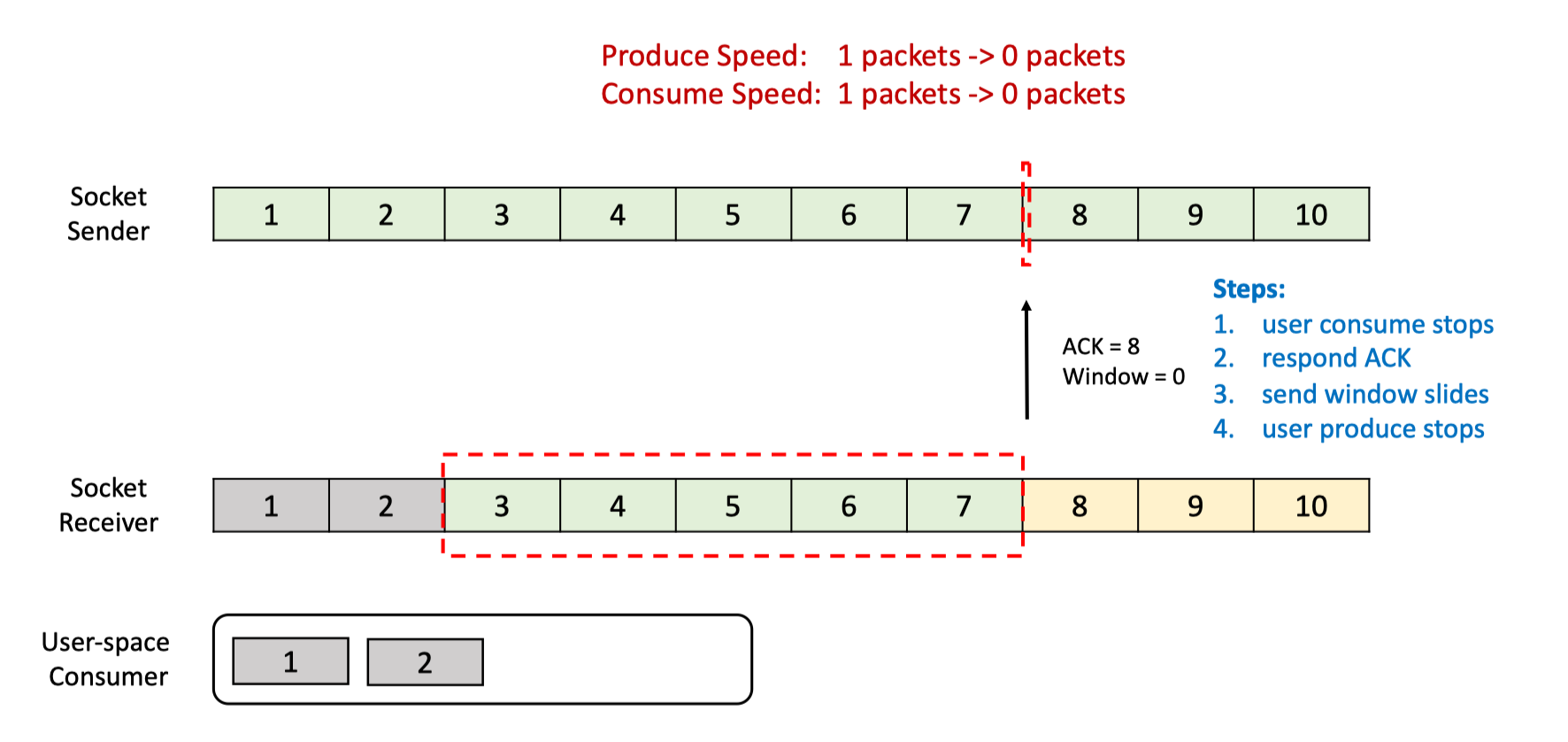

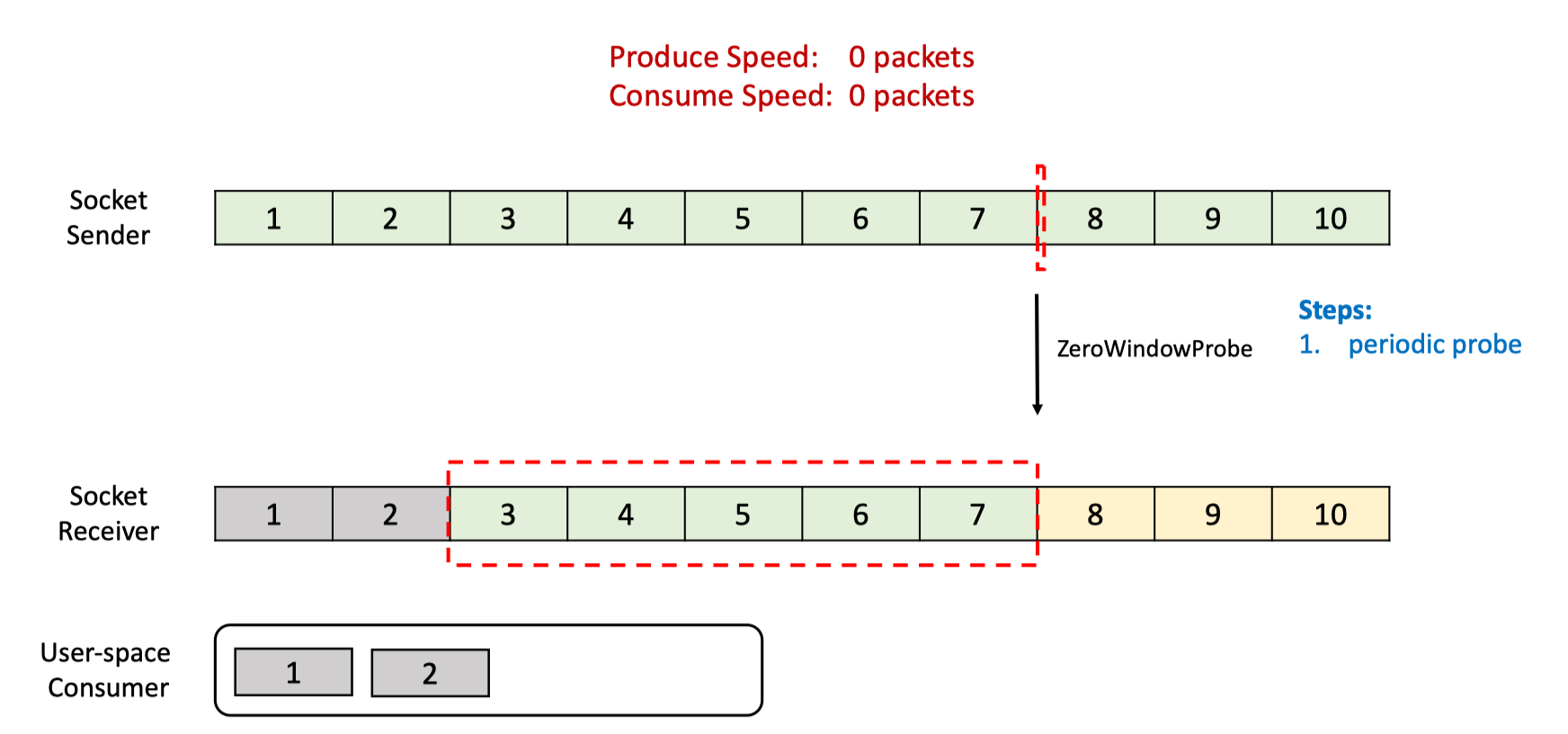

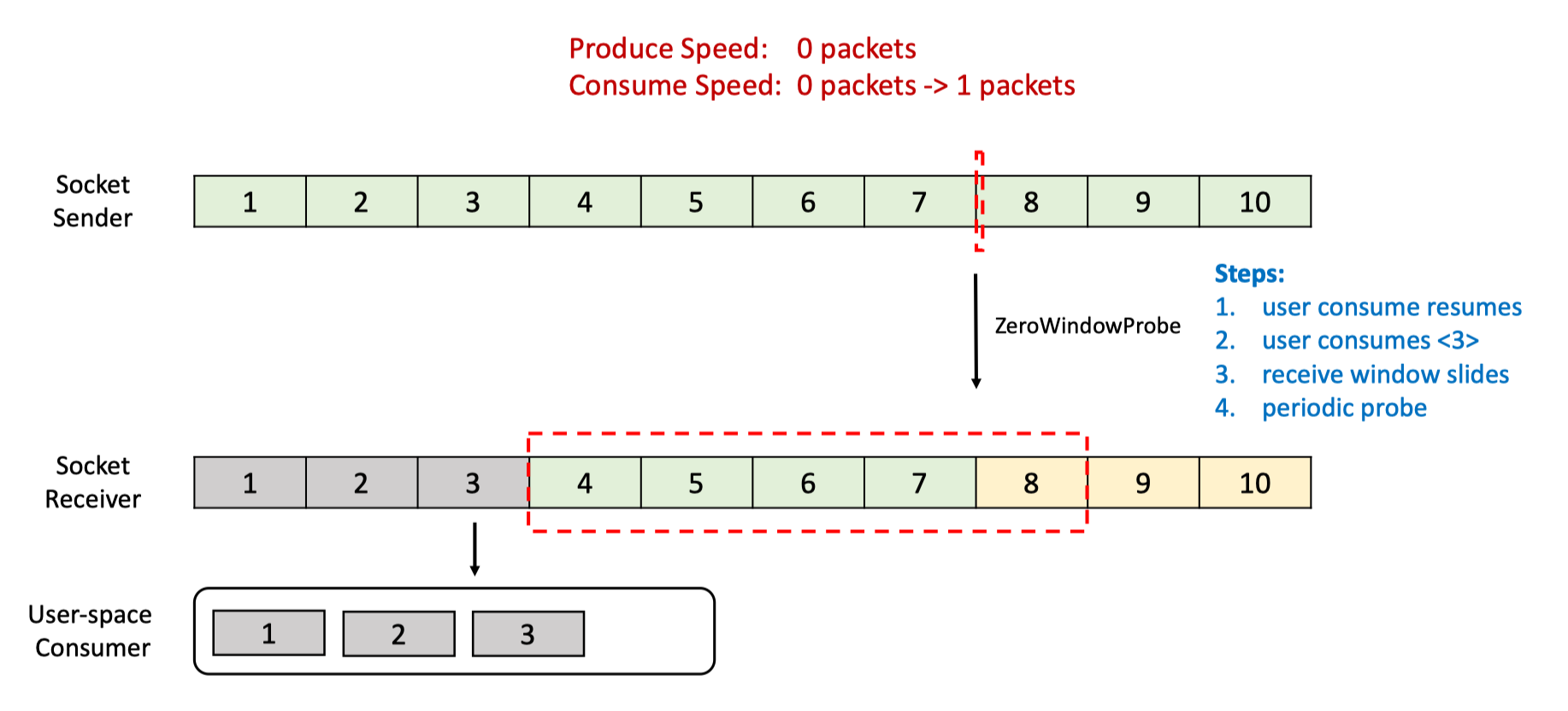

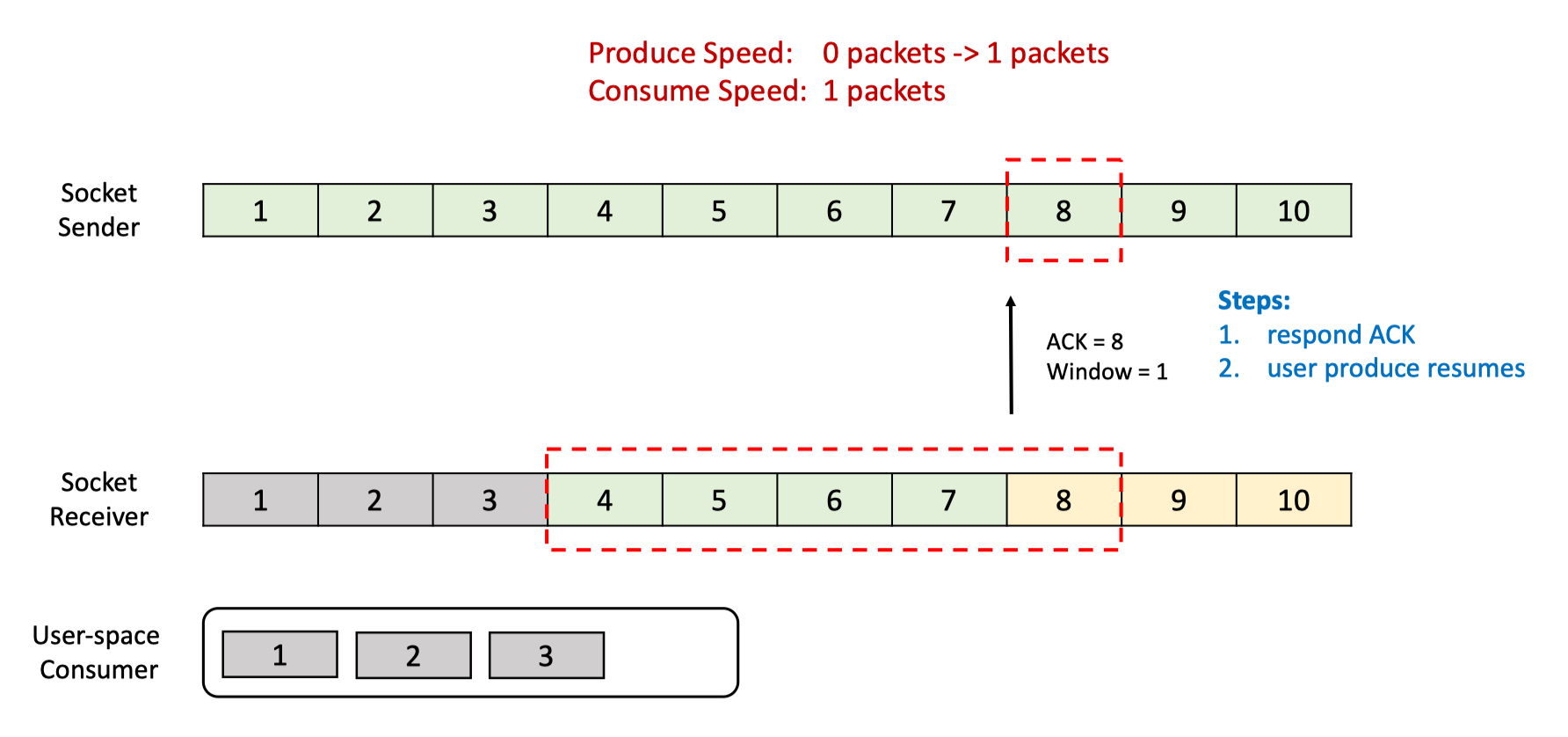

TCP 流控机制

TCP Packet

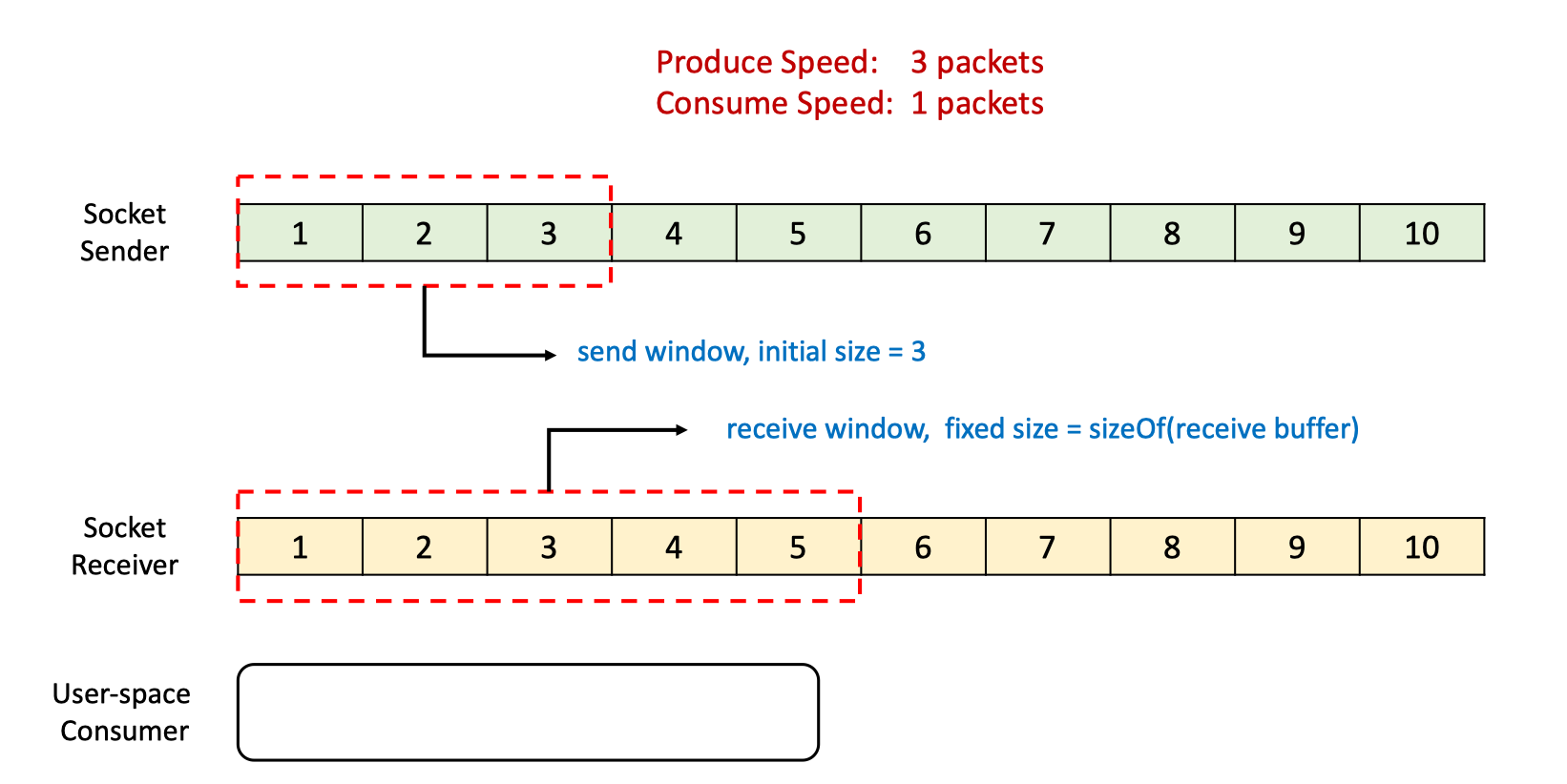

TCP流控: 滑动窗口

Job 提交执行流程

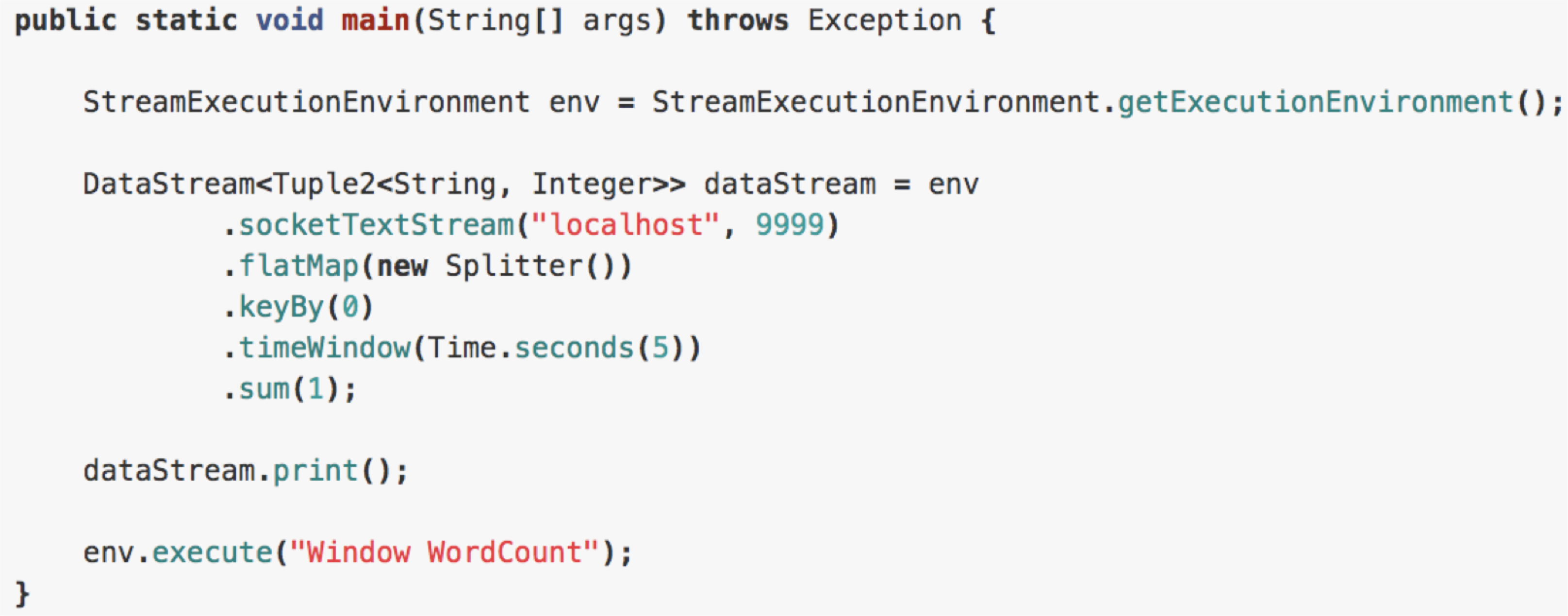

示例: WindowWordCount

编译阶段: 生成 JobGraph

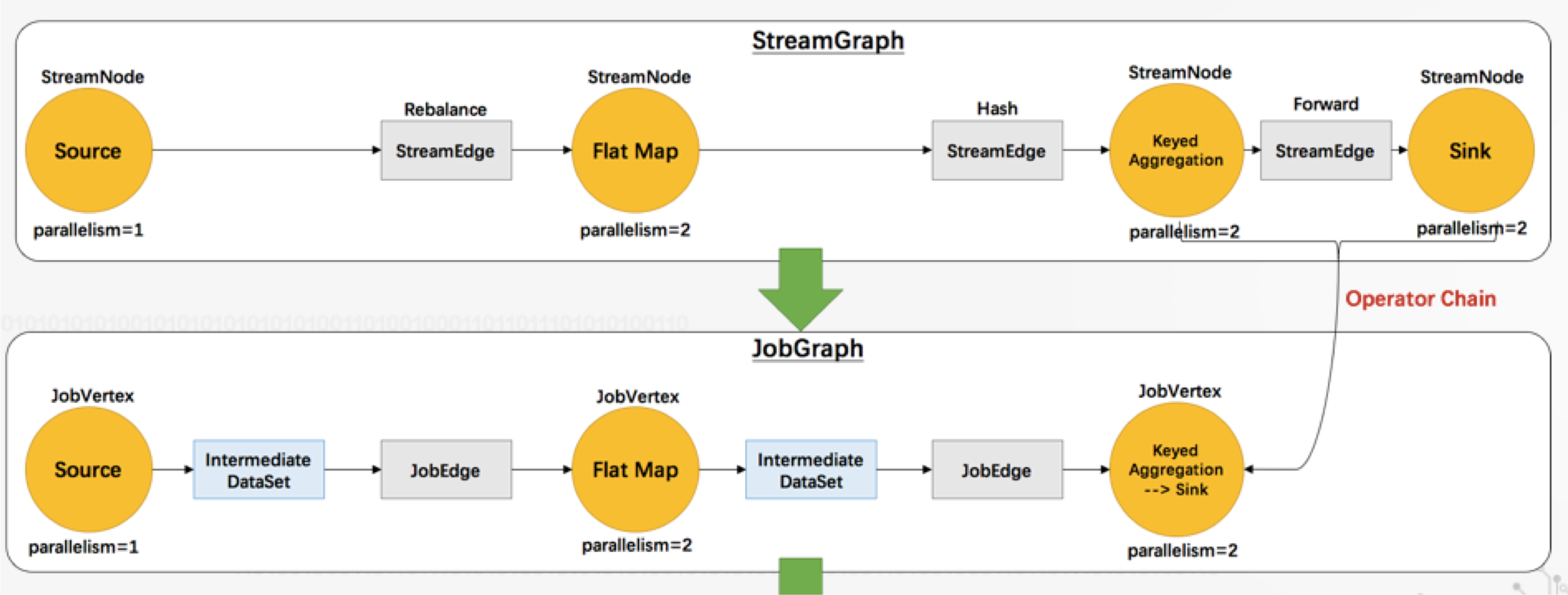

运行阶段: 调度 ExecutionGraph

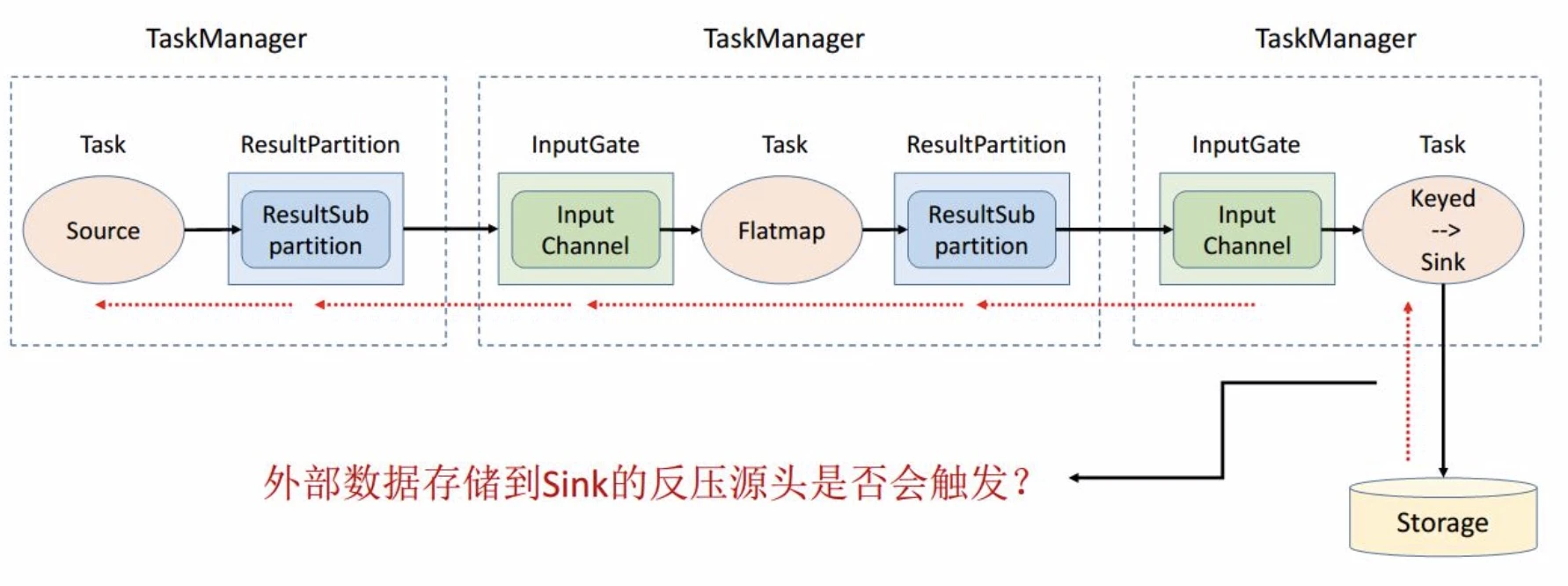

问题拆解: 反压传播两个阶段

- 跨 TaskManager,反压如何从 InputChannel 传播到 ResultSub

- TaskManager 内,反压如何从 ResultSub 传播到 InputChannel

下面将以简单的 3 个 Task 的反压进行说明

- 跨 TaskManager

- 当下游 Task C 的 Receive Buffer 满了,如何告诉上游 Task B 应该降低数据发送速率

- 当下游 Task C 的 Receive Buffer 空了,如何告诉上游 Task B 应该提升数据发送速率

- TaskManager 内

- 当 Task B 的 Send Buffer 满了,如何告诉 Task B 内部的 Receive Buffer 下游 Send Buffer 满了、下游处理性能不行了?因为要让 Task B 的 Receive Buffer 感受到压力,才能把下游的压力传递到 Task A

- 当 Task B 的 Send Buffer 空了,如何告诉 Task B 内部的 Receive Buffer 下游 Send Buffer 空了,下游处理性能很强,上游加快处理数据吧

跨 TaskManager 数据传输

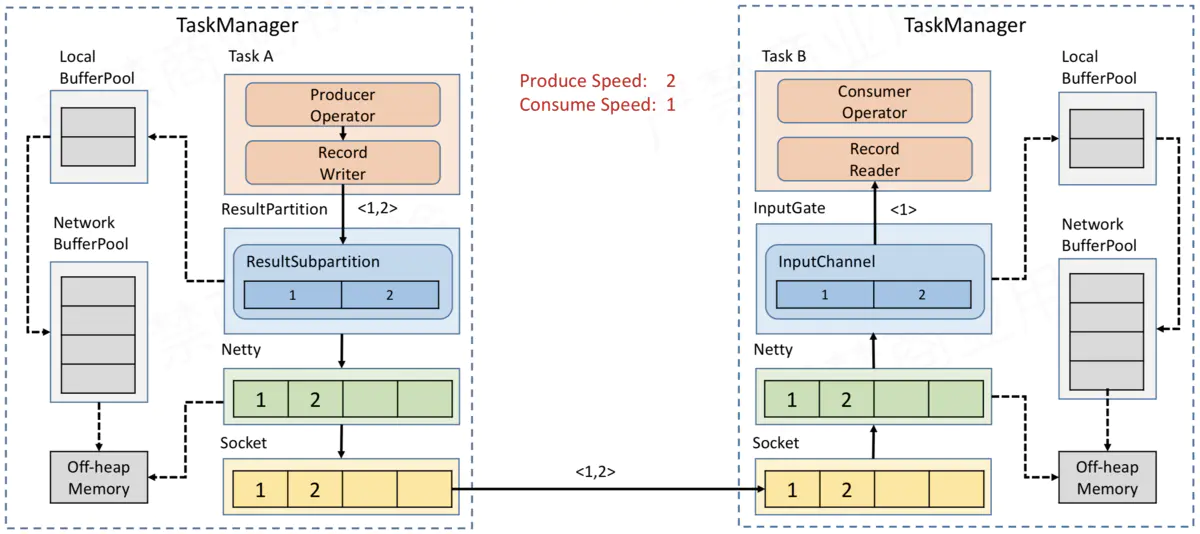

如下图所示,我们先介绍跨 TaskManager 网络传输使用的 buffer。

跨 TaskManager 数据传输

前面提到,发送数据需要 ResultPartition,在每个 ResultPartition 里面会有分区 ResultSubPartition,中间还会有一些关于内存管理的 Buffer。 对于一个 TaskManager 来说会有一个统一的<font style="color:rgb(48, 48, 48);">Network BufferPool</font> 被TaskManager 内所有的 Task 共享,在初始化时会从 <font style="color:rgb(48, 48, 48);">Off-heap Memory</font> 中申请内存,后续的内存管理由 Network BufferPool 进行管理,不需要依赖 <font style="color:rgb(48, 48, 48);">JVM GC</font> 的机制去释放。有了 Network BufferPool 之后可以为每一个 ResultSubPartition 创建 Local BufferPool 。

如上图左边的 TaskManager 的 Record Writer 写了 <1,2> 这个两个数据进来,因为 <font style="color:rgb(48, 48, 48);">ResultSubPartition</font> 初始化的时候为空,没有 Buffer 用来接收,就会向 <font style="color:rgb(48, 48, 48);">Local BufferPool</font> 申请 Buffer,这时 <font style="color:rgb(48, 48, 48);">Local BufferPool</font> 也没有足够的 Buffer 于是将请求转到 <font style="color:rgb(48, 48, 48);">Network BufferPool</font>,最终将申请到的 Buffer 按原链路返还给 <font style="color:rgb(48, 48, 48);">ResultSubPartition</font>,<1,2> 这个两个数据就可以被写入了。之后会将 <font style="color:rgb(48, 48, 48);">ResultSubPartition</font> 的 Buffer 拷贝到 Netty 的 Buffer 当中,最终拷贝到 Socket 的 Buffer 将消息发送出去。然后接收端按照类似的机制去处理将消息消费掉。接下来我们来模拟上下游处理速度不匹配的场景,发送端的速率为 2,接收端的速率为 1,看一下反压的过程是怎样的。

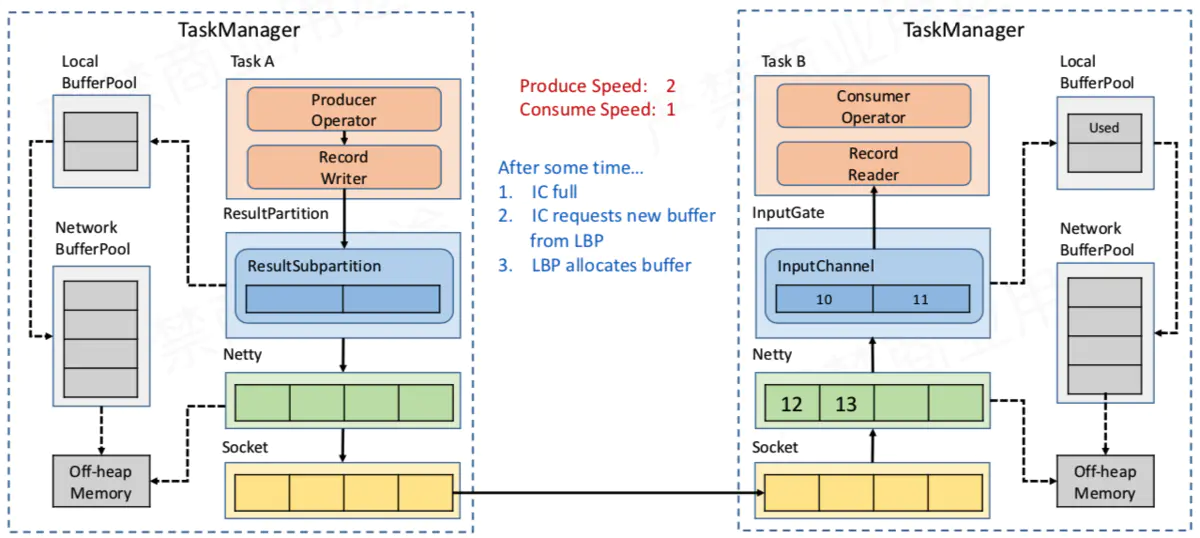

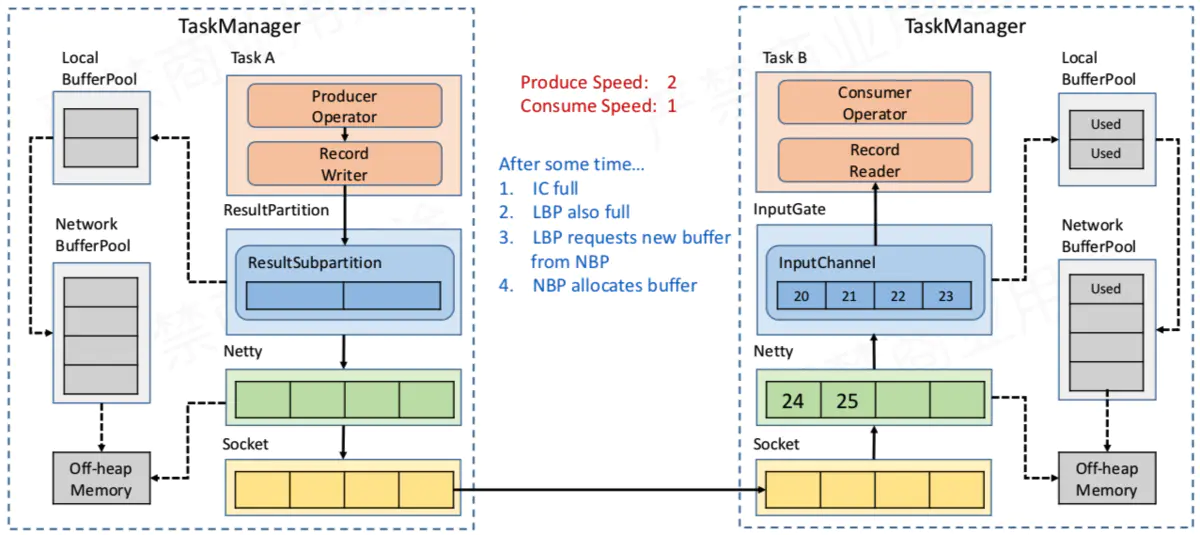

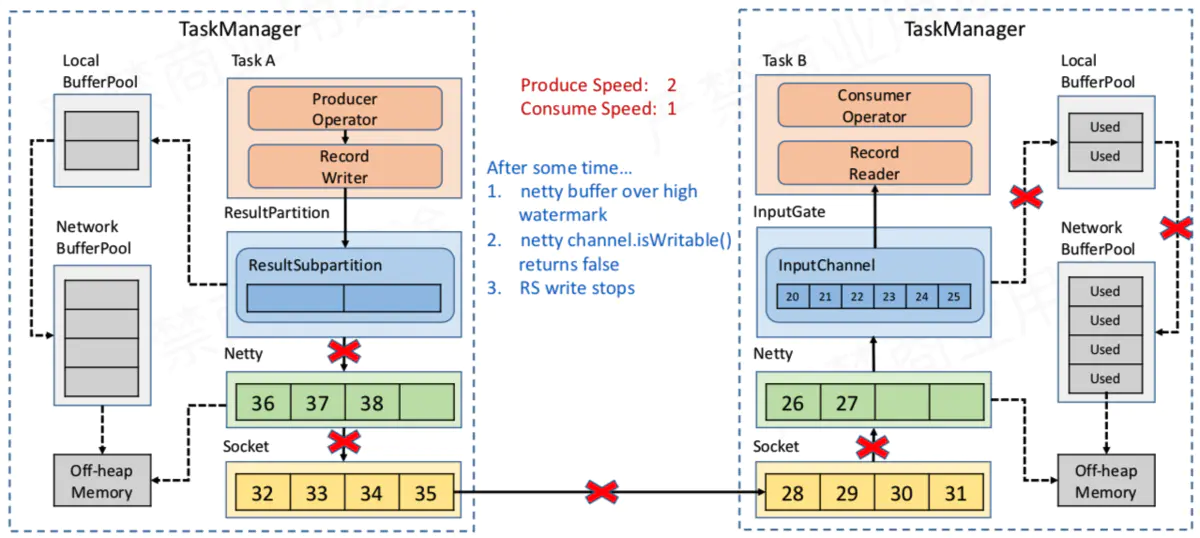

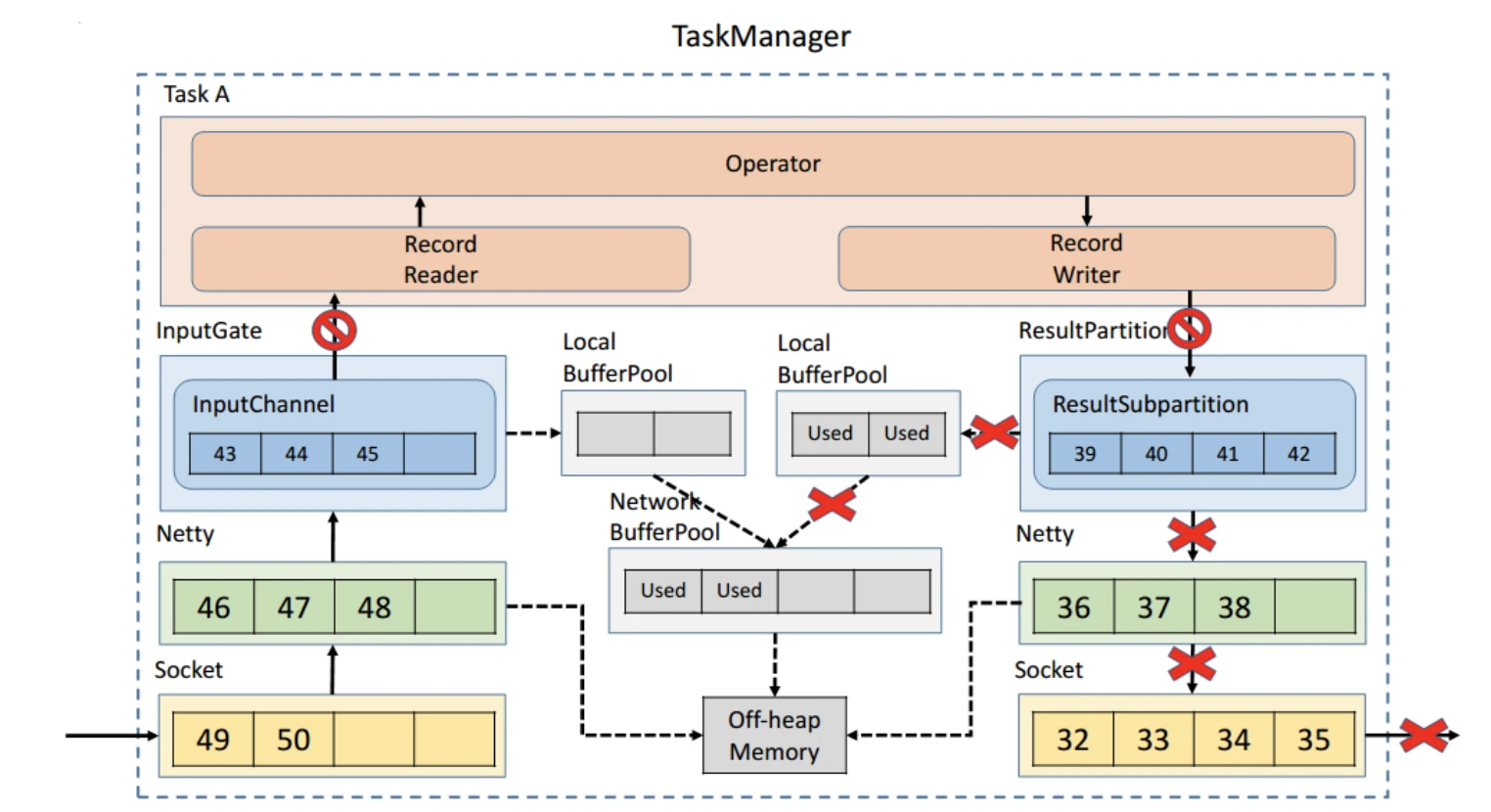

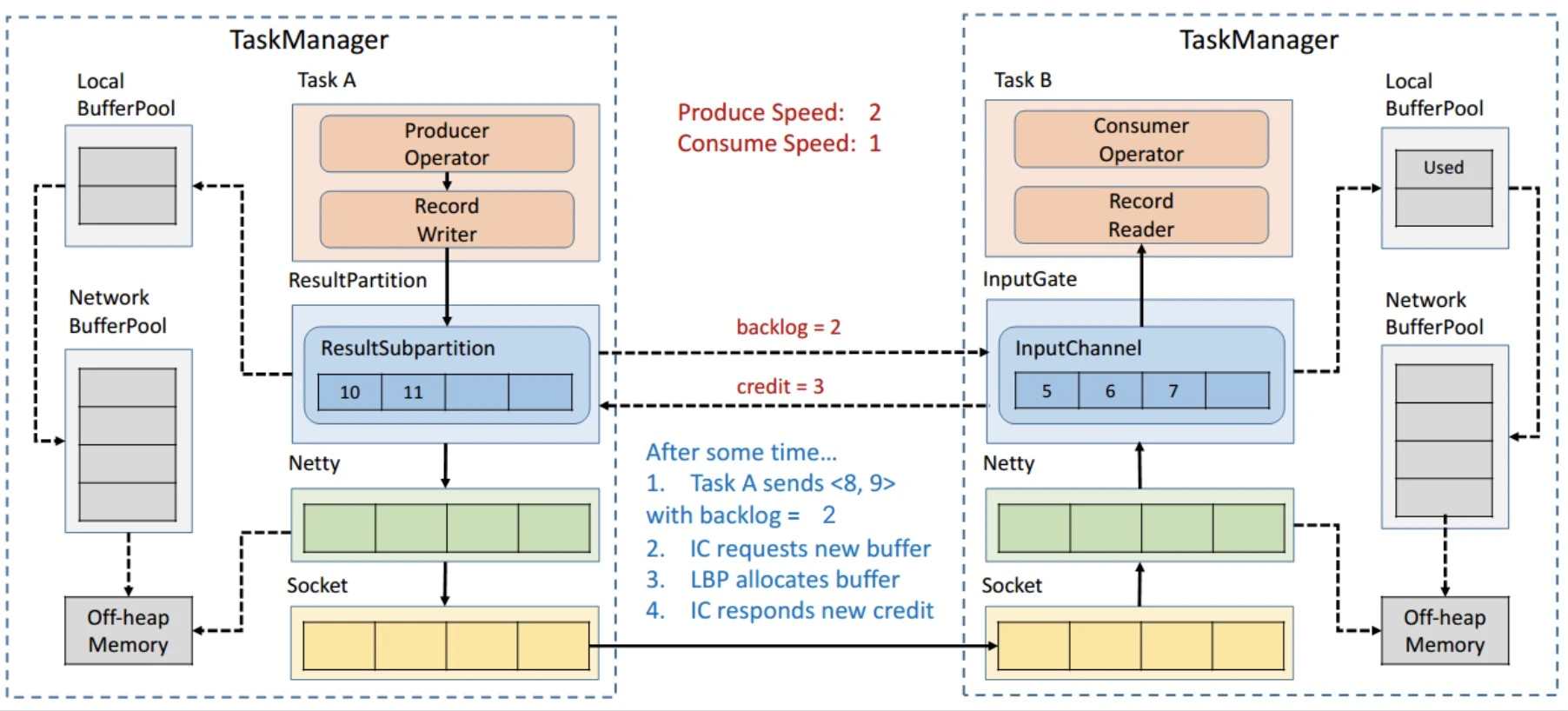

跨 TaskManager 反压过程

跨 TaskManager 数据反压

因为速度不匹配就会导致一段时间后<font style="color:rgb(48, 48, 48);">InputChannel</font> 的 Buffer 被用尽,于是他会向<font style="color:rgb(48, 48, 48);"> Local BufferPool</font> 申请新的 Buffer ,这时候可以看到 <font style="color:rgb(48, 48, 48);">Local BufferPool</font> 中的一个 Buffer 就会被标记为 Used。

跨 TaskManager 数据反压

发送端还在持续以不匹配的速度发送数据,然后就会导致<font style="color:rgb(48, 48, 48);">InputChannel</font> 向 <font style="color:rgb(48, 48, 48);">Local BufferPool</font> 申请 Buffer 的时候发现没有可用的 Buffer 了,这时候就只能向 <font style="color:rgb(48, 48, 48);">Network BufferPool</font> 去申请,当然每个 <font style="color:rgb(48, 48, 48);">Local BufferPool</font> 都有最大的可用的 Buffer,防止一个 <font style="color:rgb(48, 48, 48);">Local BufferPool</font> 把 <font style="color:rgb(48, 48, 48);">Network BufferPool</font> 耗尽。这时候看到 <font style="color:rgb(48, 48, 48);">Network BufferPool</font> 还是有可用的 Buffer 可以向其申请。

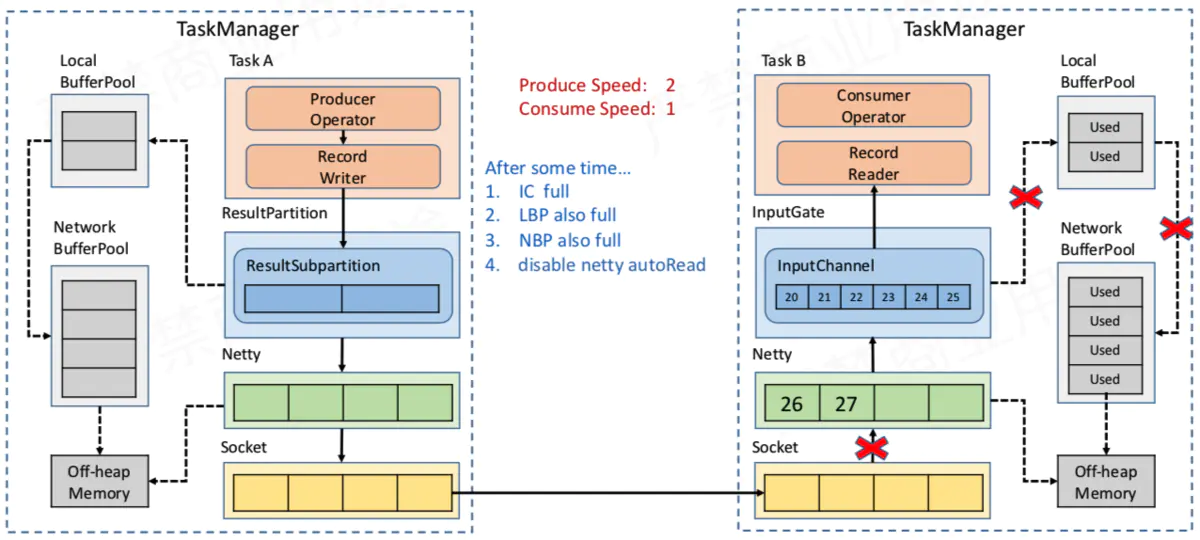

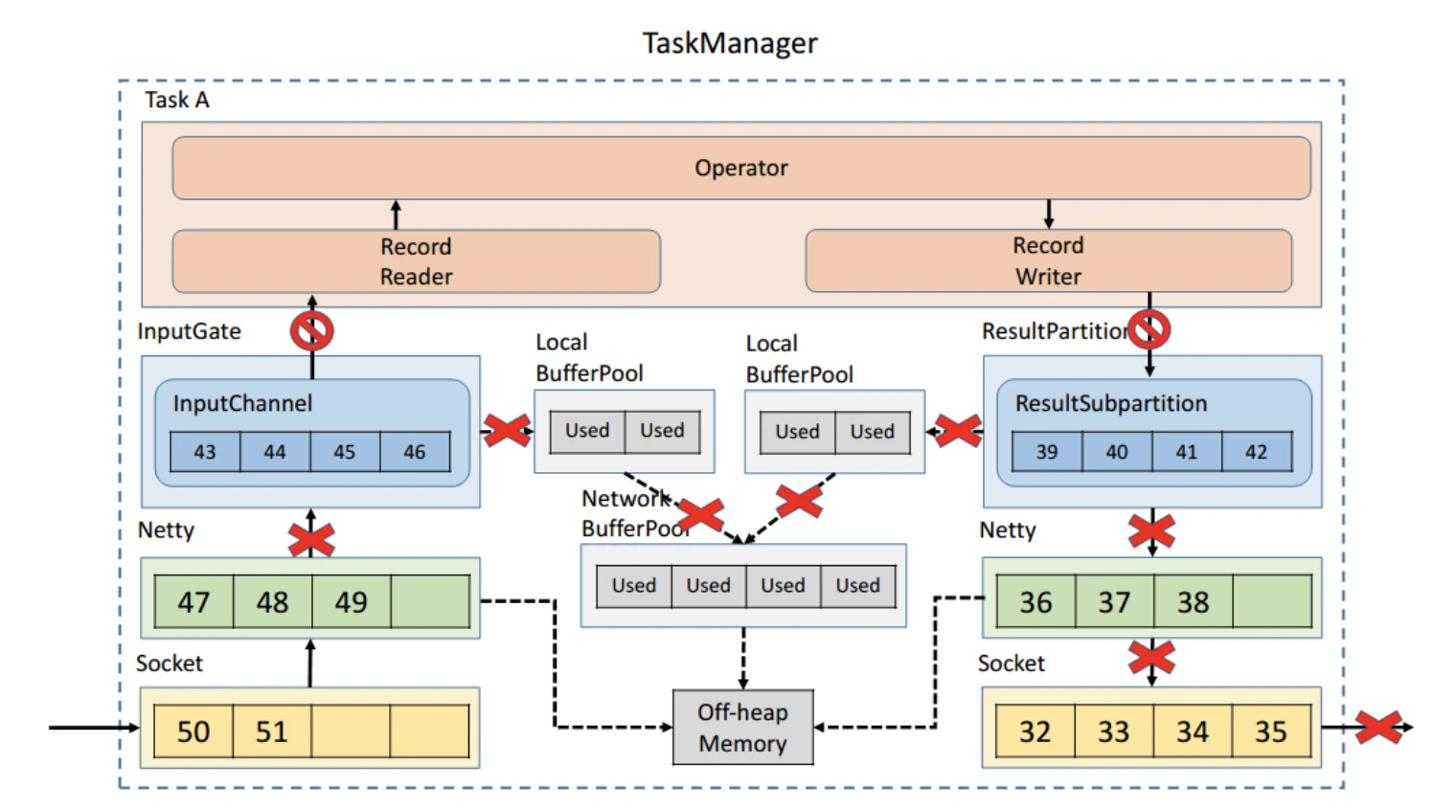

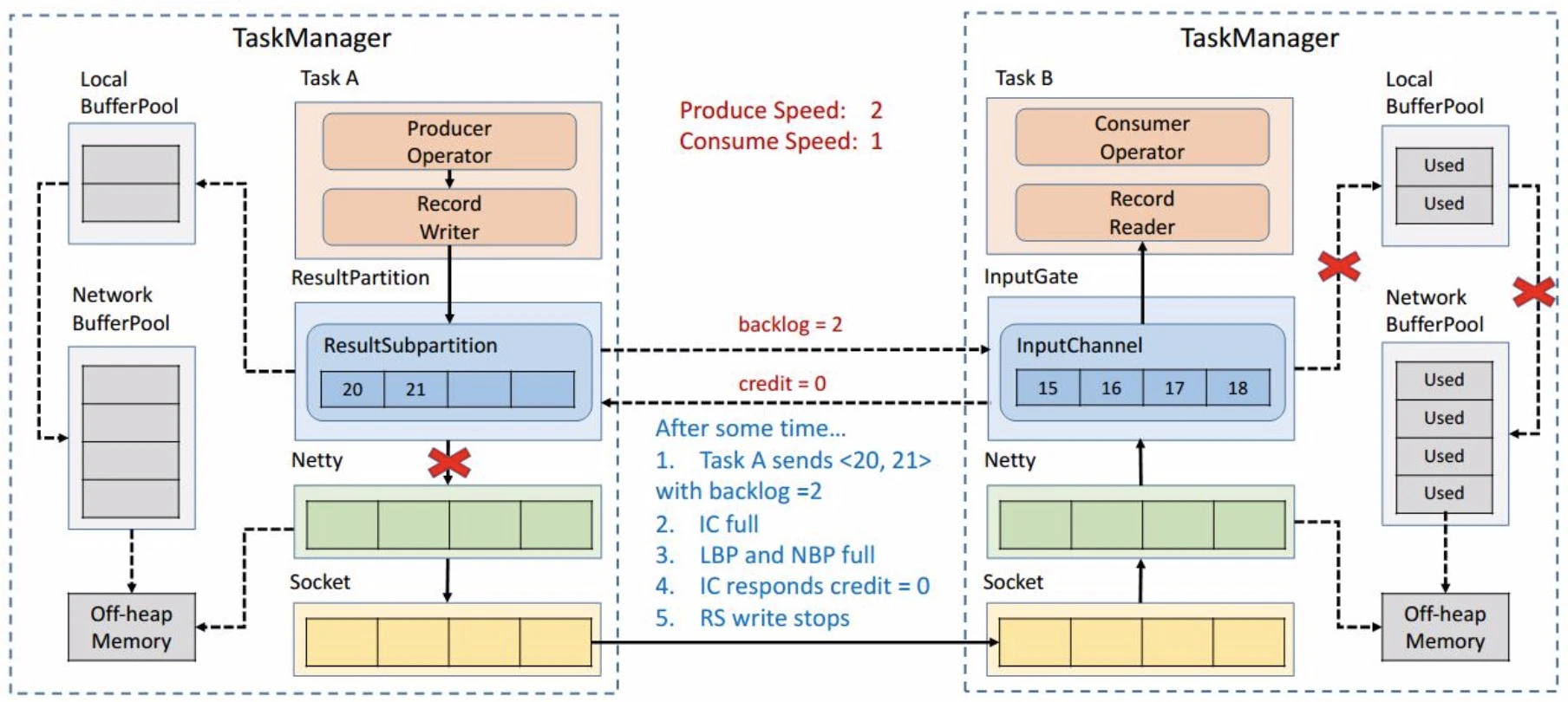

跨 TaskManager 数据反压

一段时间后,发现<font style="color:rgb(48, 48, 48);">Network BufferPool</font> 没有可用的 Buffer,或是 <font style="color:rgb(48, 48, 48);">Local BufferPool</font> 的最大可用 Buffer 到了上限无法向 <font style="color:rgb(48, 48, 48);">Network BufferPool</font> 申请,没有办法去读取新的数据,这时 Netty <font style="color:rgb(48, 48, 48);">AutoRead</font> 就会被禁掉,Netty 就不会从 Socket 的 Buffer 中读取数据了。

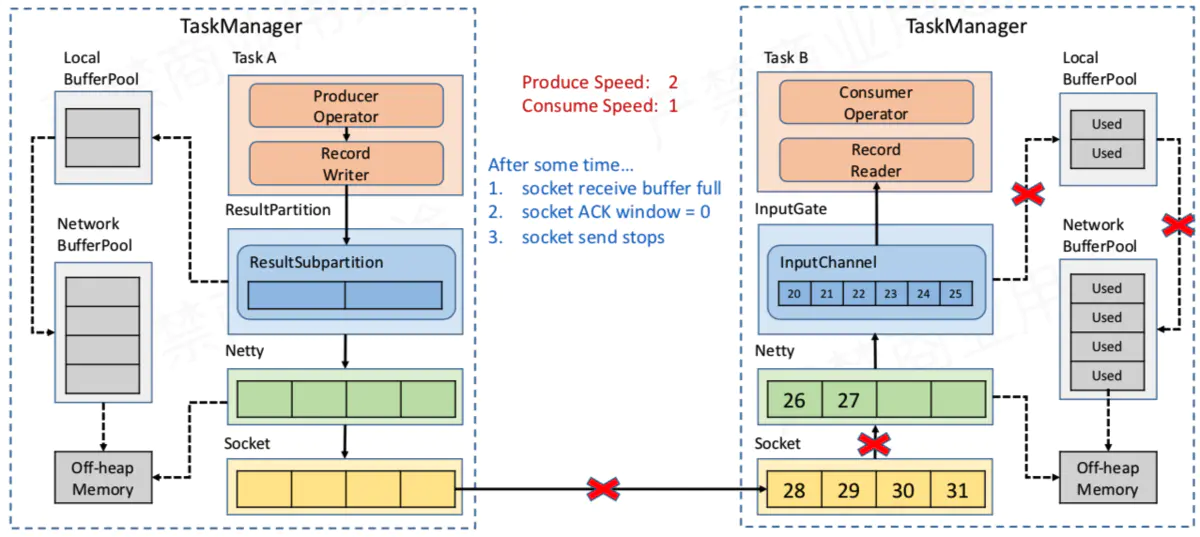

跨 TaskManager 数据反压

显然,由于 Netty 不从 Socket 的 Buffer 读数据了,再过不久 Socket 的 Buffer 也被用尽,这时就会将 Window = 0 发送给发送端(前文提到的 TCP 滑动窗口的机制)。这时发送端的 Socket 就会停止发送。

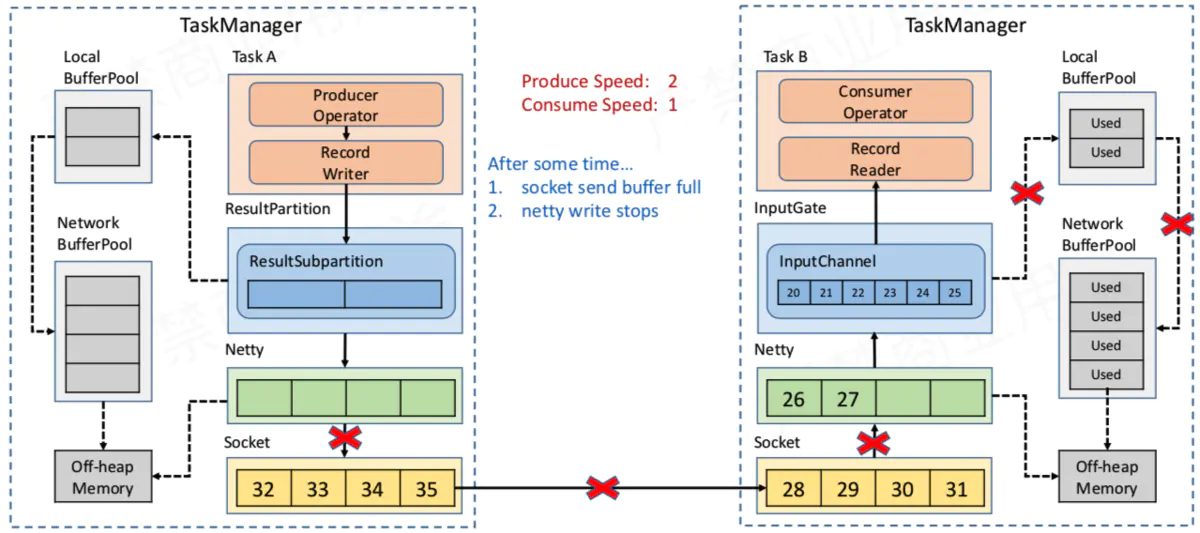

跨 TaskManager 数据反压

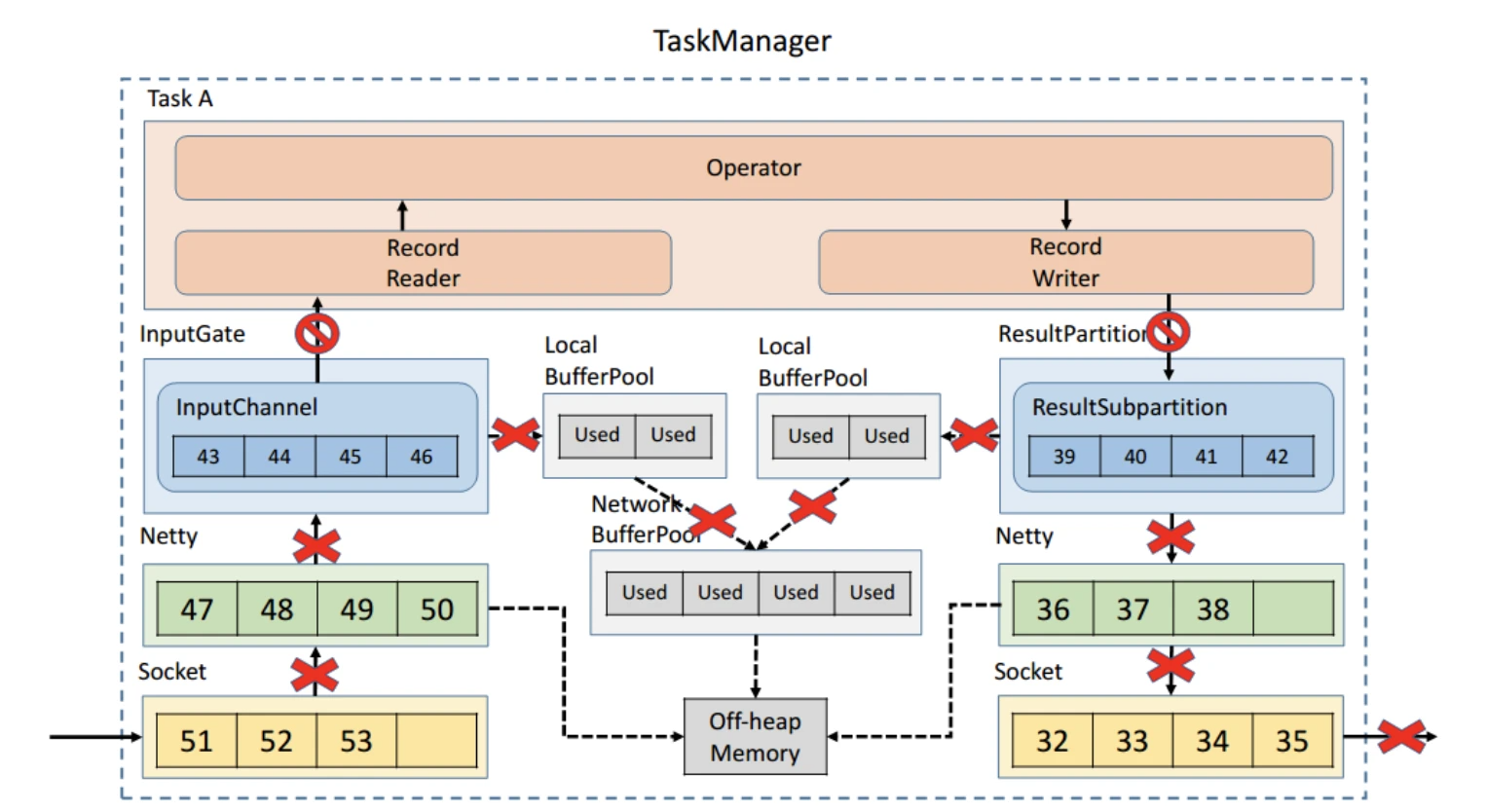

很快发送端的 Socket 的 Buffer 也被用尽,Netty 检测到 Socket 无法写了之后就会停止向 Socket 写数据。

跨 TaskManager 数据反压

Netty 停止写了之后,所有的数据就会阻塞在 Netty 的 Buffer 当中了,但是 Netty 的 Buffer 是无界的,可以通过 Netty 的水位机制中的 high watermark 控制他的上界。当超过了 high watermark,Netty 就会将其 channel 置为不可写,<font style="color:rgb(48, 48, 48);">ResultSubPartition</font> 在写之前都会检测 Netty 是否可写,发现不可写就会停止向 Netty 写数据。

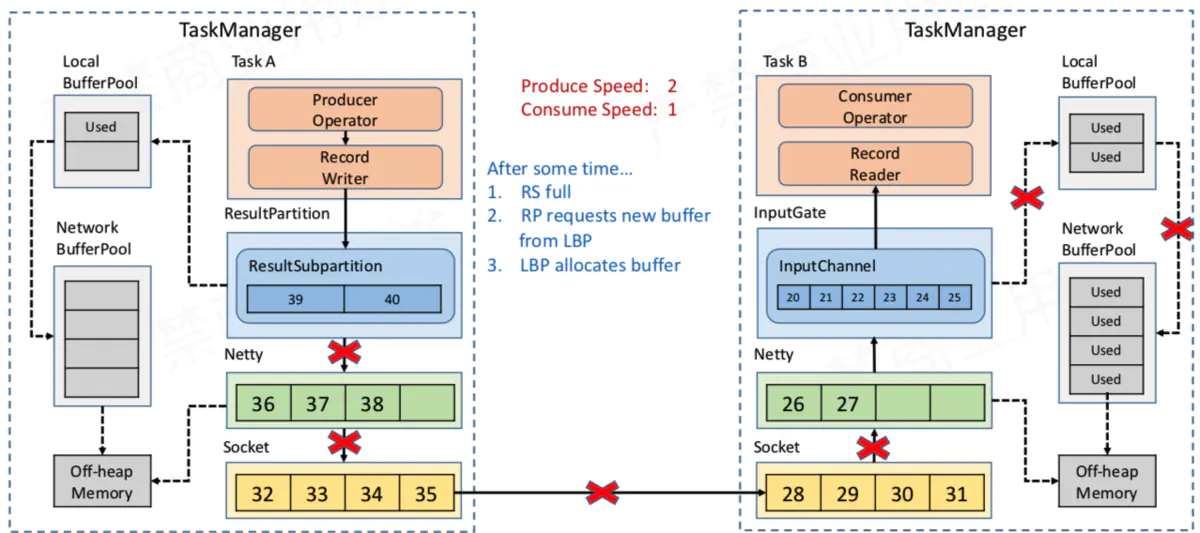

跨 TaskManager 数据反压

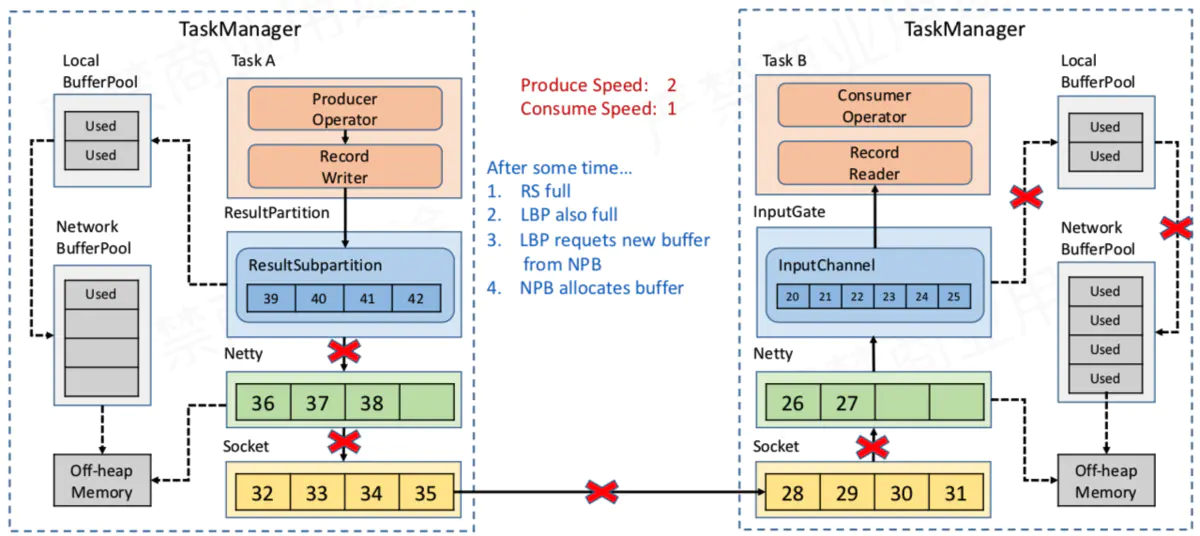

这时候所有的压力都来到了<font style="color:rgb(48, 48, 48);">ResultSubPartition</font>,和接收端一样他会不断的向 <font style="color:rgb(48, 48, 48);">Local BufferPool </font>和 <font style="color:rgb(48, 48, 48);">Network BufferPool</font> 申请内存。

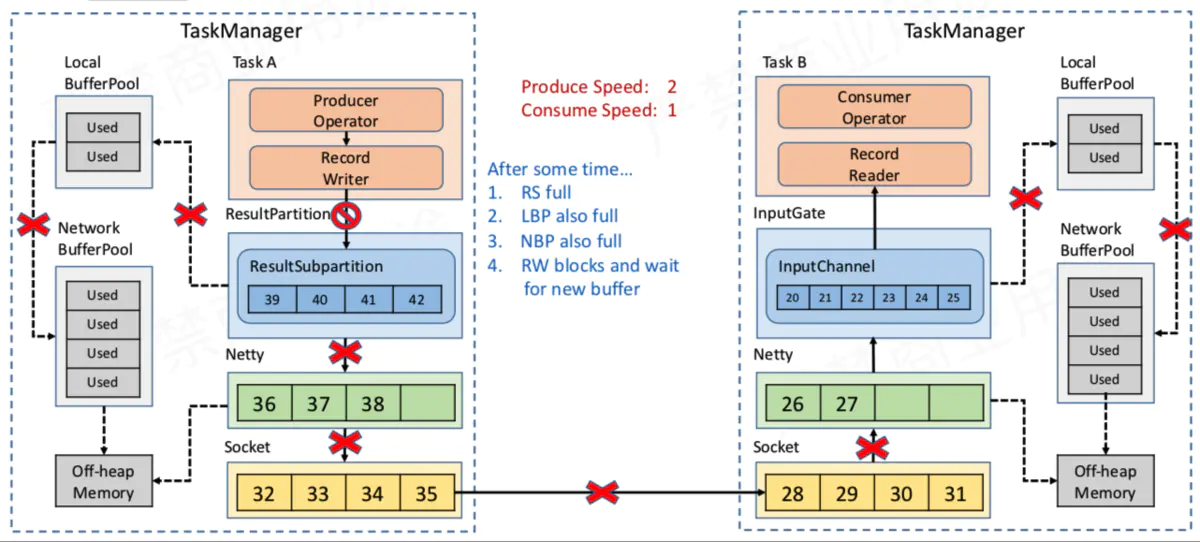

跨 TaskManager 数据反压

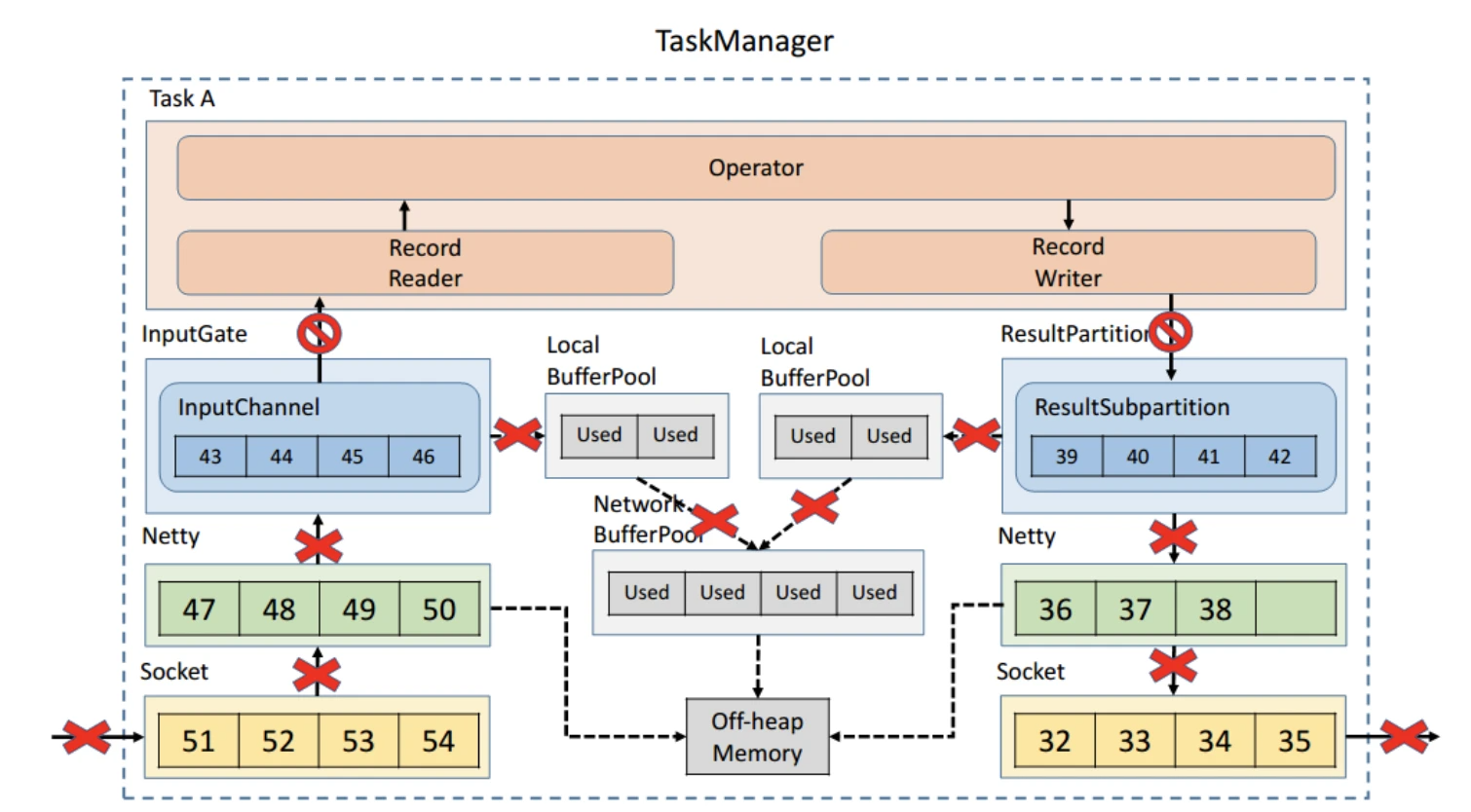

<font style="color:rgb(48, 48, 48);">Local BufferPool</font> 和 <font style="color:rgb(48, 48, 48);">Network BufferPool</font> 都用尽后整个 Operator 就会停止写数据,达到跨 TaskManager 的反压。

TaskManager 内反压过程

了解了跨 TaskManager 反压过程后再来看 TaskManager 内反压过程就更好理解了,下游的 TaskManager 反压导致本 TaskManager 的 ResultSubPartition 无法继续写入数据,于是 Record Writer 的写也被阻塞住了,因为 Operator 需要有输入才能有计算后的输出,输入跟输出都是在同一线程执行, Record Writer 阻塞了,Record Reader 也停止从 InputChannel 读数据,这时上游的 TaskManager 还在不断地发送数据,最终将这个 TaskManager 的 Buffer 耗尽。具体流程可以参考下图,这就是 TaskManager 内的反压过程。

Task 内数据反压

整个 Flink 的反压是从下游往上游传播的,一直传播到 Source Task,Source Task 有压力后,会降低从外部组件中读取数据的速率,例如:Source Task 会降低从 Kafka 中读取数据的速率,来降低整个 Flink Job 中缓存的数据,从而降低负载。

Flink TCP-based 反压机制( since V1.5 版本)

Flink V1.5 之前版本的反压策略存在的问题

- 在一个 TaskManager 中可能要执行多个 Task,如果多个 Task 的数据最终都要传输到下游的同一个 TaskManager 就会复用同一个 Socket 进行传输,这个时候如果单个 Task 产生反压,就会导致复用的 Socket 阻塞,其余的 Task 也无法使用传输,checkpoint barrier 也无法发出导致下游执行 checkpoint 的延迟增大。

- 依赖最底层的 TCP 去做流控,会导致反压传播路径太长,导致生效的延迟比较大。

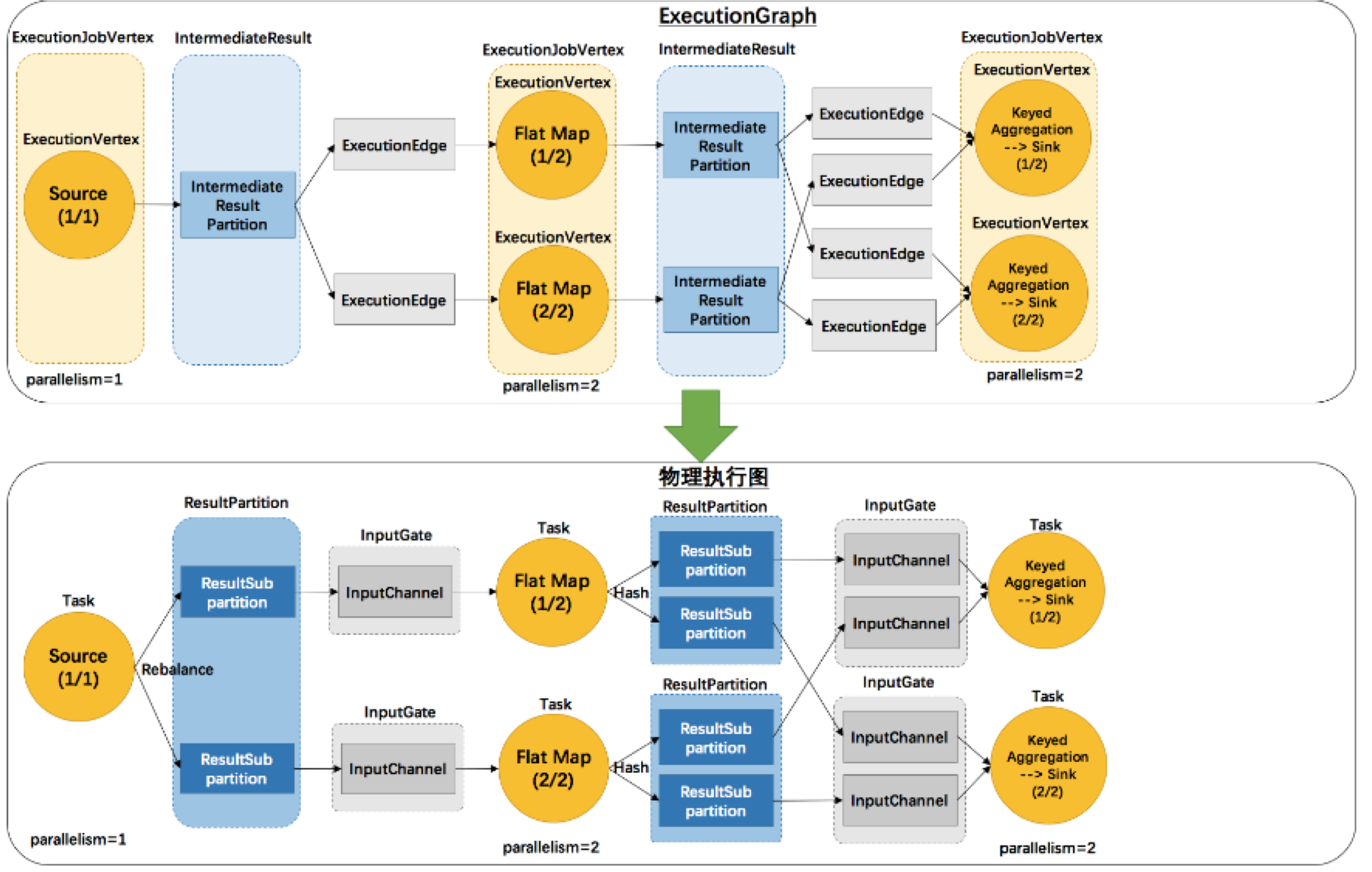

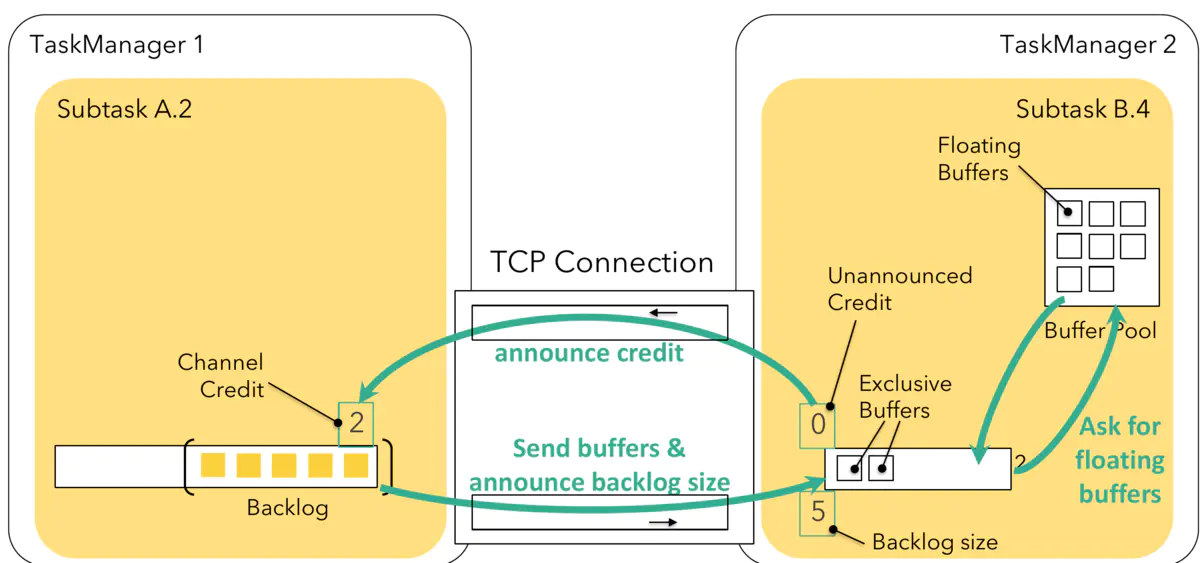

Credit 的反压策略实现原理

这个机制简单的理解起来就是在 Flink 层面实现类似 TCP 流控的反压机制来解决上述的弊端,Credit 可以类比为 TCP 的 Window 机制。如下图所示,反压机制作用于 Flink 的应用层,即在 ResultSubPartition 和 InputChannel 这一层引入了反压机制。每次上游 SubTask A.2 给下游 SubTask B.4 发送数据时,会把 Buffer 中的数据和上游 ResultSubPartition 堆积的数据量 Backlog size 发给下游,下游会接收上游发来的数据,并向上游反馈目前下游现在的 Credit 值,Credit 值表示目前下游可以接收上游的 Buffer 量,1 个Buffer 等价于 1 个 Credit 。

Credit 数据传输

例如,上游 SubTask A.2 发送完数据后,还有 5 个 Buffer 被积压,那么会把发送数据和 Backlog size = 5 一块发送给下游 SubTask B.4,下游接受到数据后,知道上游积压了 5 个Buffer,于是向 Buffer Pool 申请 Buffer,由于容量有限,下游 InputChannel 目前仅有 2 个 Buffer 空间,所以,SubTask B.4 会向上游 SubTask A.2 反馈 Channel Credit = 2。然后上游下一次最多只给下游发送 2 个 Buffer 的数据,这样每次上游发送的数据都是下游 InputChannel 的 Buffer 可以承受的数据量,所以通过这种反馈策略,保证了不会在公用的 Netty 和 TCP 这一层数据堆积而影响其他 SubTask 通信。ResultSubPartition 会把 buffer 和backlog size 同时发送给下游,下游向上游反馈 credit。

Credit-based 反压过程

总结与思考

总结

- 网络流控是为了在上下游速度不匹配的情况下,防止下游出现过载

- 网络流控有静态限速和动态反压两种手段

- Flink 1.5 之前是基于 TCP 流控 + bounded buffer 实现反压

- Flink 1.5 之后实现了自己托管的 credit - based 流控机制,在应用层模拟 TCP 的流控机制

思考

有了动态反压,静态限速是不是完全没有作用了?

参考文档