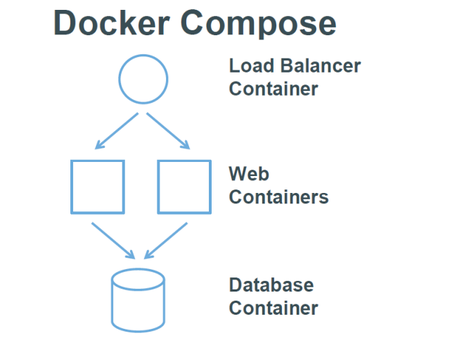

Compose是一个定义和管理多容器的工具,使用Python语言编写。使用Compose配置文件描述多个容器应用的架构,比如使用什么镜像、数据卷、网络、映射端口等;然后一条命令管理所有服务,比如启动、停止、重启

Compose 中有两个重要的概念:

- 服务 (service) :一个应用的容器,实际上可以包括若干运行相同镜像的容器实例。

- 项目 (project) :由一组关联的应用容器组成的一个完整业务单元,在 docker-compose.yml 文件中定义。

一个项目可以由多个服务(容器)关联而成,Compose 面向项目进行管理,通过子命令对项目中的一组容器进行便捷地生命周期管理。

项目地址

https://github.com/docker/compose

官方安装

https://docs.docker.com/compose/install/

sudo curl -L "https://github.com/docker/compose/releases/download/1.25.4/docker-compose-$(uname -s)-$(uname -m)" -o /usr/local/bin/docker-composechmod +x /usr/local/bin/docker-composesudo ln -s /usr/local/bin/docker-compose /usr/bin/docker-compose

yum -y install python-pip

pip install docker-compose

ln -s /usr/bin/docker-compose /usr/local/bin

建议手动安装:

wget https://github.com/docker/compose/releases/download/1.25.4/docker-compose-Linux-x86_64 -P /usr/local/bin/docker-compose

chmod +x /usr/local/bin/docker-compose

sudo ln -s /usr/local/bin/docker-compose /usr/bin/docker-compose

查看版本

docker-compose -v

docker-compose命令补全

#安装

yum install bash-completion

#下载docker-compose脚本

curl -L https://raw.githubusercontent.com/docker/compose/$(docker-compose version —short)/contrib/completion/bash/docker-compose > /etc/bash_completion.d/docker-compose

Docker Compose 常用命令

- ps:列出所有运行容器

docker-compose ps

- logs:查看服务日志输出

docker-compose logs

- port:打印绑定的公共端口,下面命令可以输出 eureka 服务 8761 端口所绑定的公共端口

docker-compose port eureka 8761

- build:构建或者重新构建服务

docker-compose build

- start:启动指定服务已存在的容器

docker-compose start eureka

- stop:停止已运行的服务的容器

docker-compose stop eureka

- rm:删除指定服务的容器

docker-compose rm eureka

- up:构建、启动容器

docker-compose up

- kill:通过发送 SIGKILL 信号来停止指定服务的容器

docker-compose kill eureka

- pull:下载服务镜像

- scale:设置指定服务运气容器的个数,以 service=num 形式指定

docker-compose scale user=3 movie=3

- run:在一个服务上执行一个命令

docker-compose run web bash

详细参数

https://www.jianshu.com/p/90bf0e231e5a

Compose和Docker兼容性:Compose 文件格式有3个版本,分别为1, 2.x 和 3.x目前主流的为 3.x 其支持 docker 1.13.0 及其以上的版本常用参数:version # 指定 compose 文件的版本services # 定义所有的 service 信息, services 下面的第一级别的 key 既是一个 service 的名称build # 指定包含构建上下文的路径, 或作为一个对象,该对象具有 context 和指定的 dockerfile 文件以及 args 参数值context # context: 指定 Dockerfile 文件所在的路径dockerfile # dockerfile: 指定 context 指定的目录下面的 Dockerfile 的名称(默认为 Dockerfile)args # args: Dockerfile 在 build 过程中需要的参数 (等同于 docker container build --build-arg 的作用)cache_from # v3.2中新增的参数, 指定缓存的镜像列表 (等同于 docker container build --cache_from 的作用)labels # v3.3中新增的参数, 设置镜像的元数据 (等同于 docker container build --labels 的作用)shm_size # v3.5中新增的参数, 设置容器 /dev/shm 分区的大小 (等同于 docker container build --shm-size 的作用)command # 覆盖容器启动后默认执行的命令, 支持 shell 格式和 [] 格式configs # 不知道怎么用cgroup_parent # 不知道怎么用container_name # 指定容器的名称 (等同于 docker run --name 的作用)credential_spec # 不知道怎么用deploy # v3 版本以上, 指定与部署和运行服务相关的配置, deploy 部分是 docker stack 使用的, docker stack 依赖 docker swarmendpoint_mode # v3.3 版本中新增的功能, 指定服务暴露的方式vip # Docker 为该服务分配了一个虚拟 IP(VIP), 作为客户端的访问服务的地址dnsrr # DNS轮询, Docker 为该服务设置 DNS 条目, 使得服务名称的 DNS 查询返回一个 IP 地址列表, 客户端直接访问其中的一个地址labels # 指定服务的标签,这些标签仅在服务上设置mode # 指定 deploy 的模式global # 每个集群节点都只有一个容器replicated # 用户可以指定集群中容器的数量(默认)placement # 不知道怎么用replicas # deploy 的 mode 为 replicated 时, 指定容器副本的数量resources # 资源限制limits # 设置容器的资源限制cpus: "0.5" # 设置该容器最多只能使用 50% 的 CPUmemory: 50M # 设置该容器最多只能使用 50M 的内存空间reservations # 设置为容器预留的系统资源(随时可用)cpus: "0.2" # 为该容器保留 20% 的 CPUmemory: 20M # 为该容器保留 20M 的内存空间restart_policy # 定义容器重启策略, 用于代替 restart 参数condition # 定义容器重启策略(接受三个参数)none # 不尝试重启on-failure # 只有当容器内部应用程序出现问题才会重启any # 无论如何都会尝试重启(默认)delay # 尝试重启的间隔时间(默认为 0s)max_attempts # 尝试重启次数(默认一直尝试重启)window # 检查重启是否成功之前的等待时间(即如果容器启动了, 隔多少秒之后去检测容器是否正常, 默认 0s)update_config # 用于配置滚动更新配置parallelism # 一次性更新的容器数量delay # 更新一组容器之间的间隔时间failure_action # 定义更新失败的策略continue # 继续更新rollback # 回滚更新pause # 暂停更新(默认)monitor # 每次更新后的持续时间以监视更新是否失败(单位: ns|us|ms|s|m|h) (默认为0)max_failure_ratio # 回滚期间容忍的失败率(默认值为0)order # v3.4 版本中新增的参数, 回滚期间的操作顺序stop-first #旧任务在启动新任务之前停止(默认)start-first #首先启动新任务, 并且正在运行的任务暂时重叠rollback_config # v3.7 版本中新增的参数, 用于定义在 update_config 更新失败的回滚策略parallelism # 一次回滚的容器数, 如果设置为0, 则所有容器同时回滚delay # 每个组回滚之间的时间间隔(默认为0)failure_action # 定义回滚失败的策略continue # 继续回滚pause # 暂停回滚monitor # 每次回滚任务后的持续时间以监视失败(单位: ns|us|ms|s|m|h) (默认为0)max_failure_ratio # 回滚期间容忍的失败率(默认值0)order # 回滚期间的操作顺序stop-first # 旧任务在启动新任务之前停止(默认)start-first # 首先启动新任务, 并且正在运行的任务暂时重叠注意:支持 docker-compose up 和 docker-compose run 但不支持 docker stack deploy 的子选项security_opt container_name devices tmpfs stop_signal links cgroup_parentnetwork_mode external_links restart build userns_mode sysctlsdevices # 指定设备映射列表 (等同于 docker run --device 的作用)depends_on # 定义容器启动顺序 (此选项解决了容器之间的依赖关系, 此选项在 v3 版本中 使用 swarm 部署时将忽略该选项)示例:docker-compose up 以依赖顺序启动服务,下面例子中 redis 和 db 服务在 web 启动前启动默认情况下使用 docker-compose up web 这样的方式启动 web 服务时,也会启动 redis 和 db 两个服务,因为在配置文件中定义了依赖关系version: '3'services:web:build: .depends_on:- db- redisredis:image: redisdb:image: postgresdns # 设置 DNS 地址(等同于 docker run --dns 的作用)dns_search # 设置 DNS 搜索域(等同于 docker run --dns-search 的作用)tmpfs # v2 版本以上, 挂载目录到容器中, 作为容器的临时文件系统(等同于 docker run --tmpfs 的作用, 在使用 swarm 部署时将忽略该选项)entrypoint # 覆盖容器的默认 entrypoint 指令 (等同于 docker run --entrypoint 的作用)env_file # 从指定文件中读取变量设置为容器中的环境变量, 可以是单个值或者一个文件列表, 如果多个文件中的变量重名则后面的变量覆盖前面的变量, environment 的值覆盖 env_file 的值文件格式:RACK_ENV=developmentenvironment # 设置环境变量, environment 的值可以覆盖 env_file 的值 (等同于 docker run --env 的作用)expose # 暴露端口, 但是不能和宿主机建立映射关系, 类似于 Dockerfile 的 EXPOSE 指令external_links # 连接不在 docker-compose.yml 中定义的容器或者不在 compose 管理的容器(docker run 启动的容器, 在 v3 版本中使用 swarm 部署时将忽略该选项)extra_hosts # 添加 host 记录到容器中的 /etc/hosts 中 (等同于 docker run --add-host 的作用)healthcheck # v2.1 以上版本, 定义容器健康状态检查, 类似于 Dockerfile 的 HEALTHCHECK 指令test # 检查容器检查状态的命令, 该选项必须是一个字符串或者列表, 第一项必须是 NONE, CMD 或 CMD-SHELL, 如果其是一个字符串则相当于 CMD-SHELL 加该字符串NONE # 禁用容器的健康状态检测CMD # test: ["CMD", "curl", "-f", "http://localhost"]CMD-SHELL # test: ["CMD-SHELL", "curl -f http://localhost || exit 1"] 或者 test: curl -f https://localhost || exit 1interval: 1m30s # 每次检查之间的间隔时间timeout: 10s # 运行命令的超时时间retries: 3 # 重试次数start_period: 40s # v3.4 以上新增的选项, 定义容器启动时间间隔disable: true # true 或 false, 表示是否禁用健康状态检测和 test: NONE 相同image # 指定 docker 镜像, 可以是远程仓库镜像、本地镜像init # v3.7 中新增的参数, true 或 false 表示是否在容器中运行一个 init, 它接收信号并传递给进程isolation # 隔离容器技术, 在 Linux 中仅支持 default 值labels # 使用 Docker 标签将元数据添加到容器, 与 Dockerfile 中的 LABELS 类似links # 链接到其它服务中的容器, 该选项是 docker 历史遗留的选项, 目前已被用户自定义网络名称空间取代, 最终有可能被废弃 (在使用 swarm 部署时将忽略该选项)logging # 设置容器日志服务driver # 指定日志记录驱动程序, 默认 json-file (等同于 docker run --log-driver 的作用)options # 指定日志的相关参数 (等同于 docker run --log-opt 的作用)max-size # 设置单个日志文件的大小, 当到达这个值后会进行日志滚动操作max-file # 日志文件保留的数量network_mode # 指定网络模式 (等同于 docker run --net 的作用, 在使用 swarm 部署时将忽略该选项)networks # 将容器加入指定网络 (等同于 docker network connect 的作用), networks 可以位于 compose 文件顶级键和 services 键的二级键aliases # 同一网络上的容器可以使用服务名称或别名连接到其中一个服务的容器ipv4_address # IP V4 格式ipv6_address # IP V6 格式示例:version: '3.7'services:test:image: nginx:1.14-alpinecontainer_name: mynginxcommand: ifconfignetworks:app_net: # 调用下面 networks 定义的 app_net 网络ipv4_address: 172.16.238.10networks:app_net:driver: bridgeipam:driver: defaultconfig:- subnet: 172.16.238.0/24pid: 'host' # 共享宿主机的 进程空间(PID)ports # 建立宿主机和容器之间的端口映射关系, ports 支持两种语法格式SHORT 语法格式示例:- "3000" # 暴露容器的 3000 端口, 宿主机的端口由 docker 随机映射一个没有被占用的端口- "3000-3005" # 暴露容器的 3000 到 3005 端口, 宿主机的端口由 docker 随机映射没有被占用的端口- "8000:8000" # 容器的 8000 端口和宿主机的 8000 端口建立映射关系- "9090-9091:8080-8081"- "127.0.0.1:8001:8001" # 指定映射宿主机的指定地址的- "127.0.0.1:5000-5010:5000-5010"- "6060:6060/udp" # 指定协议LONG 语法格式示例:(v3.2 新增的语法格式)ports:- target: 80 # 容器端口published: 8080 # 宿主机端口protocol: tcp # 协议类型mode: host # host 在每个节点上发布主机端口, ingress 对于群模式端口进行负载均衡secrets # 不知道怎么用security_opt # 为每个容器覆盖默认的标签 (在使用 swarm 部署时将忽略该选项)stop_grace_period # 指定在发送了 SIGTERM 信号之后, 容器等待多少秒之后退出(默认 10s)stop_signal # 指定停止容器发送的信号 (默认为 SIGTERM 相当于 kill PID; SIGKILL 相当于 kill -9 PID; 在使用 swarm 部署时将忽略该选项)sysctls # 设置容器中的内核参数 (在使用 swarm 部署时将忽略该选项)ulimits # 设置容器的 limituserns_mode # 如果Docker守护程序配置了用户名称空间, 则禁用此服务的用户名称空间 (在使用 swarm 部署时将忽略该选项)volumes # 定义容器和宿主机的卷映射关系, 其和 networks 一样可以位于 services 键的二级键和 compose 顶级键, 如果需要跨服务间使用则在顶级键定义, 在 services 中引用SHORT 语法格式示例:volumes:- /var/lib/mysql # 映射容器内的 /var/lib/mysql 到宿主机的一个随机目录中- /opt/data:/var/lib/mysql # 映射容器内的 /var/lib/mysql 到宿主机的 /opt/data- ./cache:/tmp/cache # 映射容器内的 /var/lib/mysql 到宿主机 compose 文件所在的位置- ~/configs:/etc/configs/:ro # 映射容器宿主机的目录到容器中去, 权限只读- datavolume:/var/lib/mysql # datavolume 为 volumes 顶级键定义的目录, 在此处直接调用LONG 语法格式示例:(v3.2 新增的语法格式)version: "3.2"services:web:image: nginx:alpineports:- "80:80"volumes:- type: volume # mount 的类型, 必须是 bind、volume 或 tmpfssource: mydata # 宿主机目录target: /data # 容器目录volume: # 配置额外的选项, 其 key 必须和 type 的值相同nocopy: true # volume 额外的选项, 在创建卷时禁用从容器复制数据- type: bind # volume 模式只指定容器路径即可, 宿主机路径随机生成; bind 需要指定容器和数据机的映射路径source: ./statictarget: /opt/app/staticread_only: true # 设置文件系统为只读文件系统volumes:mydata: # 定义在 volume, 可在所有服务中调用restart # 定义容器重启策略(在使用 swarm 部署时将忽略该选项, 在 swarm 使用 restart_policy 代替 restart)no # 禁止自动重启容器(默认)always # 无论如何容器都会重启on-failure # 当出现 on-failure 报错时, 容器重新启动其他选项:domainname, hostname, ipc, mac_address, privileged, read_only, shm_size, stdin_open, tty, user, working_dir上面这些选项都只接受单个值和 docker run 的对应参数类似对于值为时间的可接受的值:2.5s10s1m30s2h32m5h34m56s时间单位: us, ms, s, m, h对于值为大小的可接受的值:2b1024kb2048k300m1gb单位: b, k, m, g 或者 kb, mb, gbnetworks # 定义 networks 信息driver # 指定网络模式, 大多数情况下, 它 bridge 于单个主机和 overlay Swarm 上bridge # Docker 默认使用 bridge 连接单个主机上的网络overlay # overlay 驱动程序创建一个跨多个节点命名的网络host # 共享主机网络名称空间(等同于 docker run --net=host)none # 等同于 docker run --net=nonedriver_opts # v3.2以上版本, 传递给驱动程序的参数, 这些参数取决于驱动程序attachable # driver 为 overlay 时使用, 如果设置为 true 则除了服务之外,独立容器也可以附加到该网络; 如果独立容器连接到该网络,则它可以与其他 Docker 守护进程连接到的该网络的服务和独立容器进行通信ipam # 自定义 IPAM 配置. 这是一个具有多个属性的对象, 每个属性都是可选的driver # IPAM 驱动程序, bridge 或者 defaultconfig # 配置项subnet # CIDR格式的子网,表示该网络的网段external # 外部网络, 如果设置为 true 则 docker-compose up 不会尝试创建它, 如果它不存在则引发错误name # v3.5 以上版本, 为此网络设置名称文件格式示例:version: "3"services:redis:image: redis:alpineports:- "6379"networks:- frontenddeploy:replicas: 2update_config:parallelism: 2delay: 10srestart_policy:condition: on-failuredb:image: postgres:9.4volumes:- db-data:/var/lib/postgresql/datanetworks:- backenddeploy:placement:constraints: [node.role == manager]

编写docker-compose.yml

# compose版本version: "3.3"# 项目services:# 容器名称nginx:# 镜像名称image: redis:alpine# 暴露的端口号,和docker run的-p一致ports:- "80:80"# 表示如果服务启动不成功会一直尝试restart: always# 连接到applink:- app# 网络networks:- frontend# 应用app容器,类似在hosts加入 192.168.0.1 app ,通过访问app访问到nginxapp:# 应用镜像image: xxx/app# 可以配置依赖服务,表示需要先启动 depends_on 下面的服务后,再启动本服务depends_on:- nginx- mysql# 表示以这个命令来启动项目command: mvn clean spring-boot:run -Dspring-boot.run.profiles=docker# 网络配置networks:- frontend- backend# 挂载配置路径volumes:db-data:- "./nginx.conf.d/:/etc/nginx/conf.d"

案例

https://www.cnblogs.com/morang/p/docker-jenkins-use.html

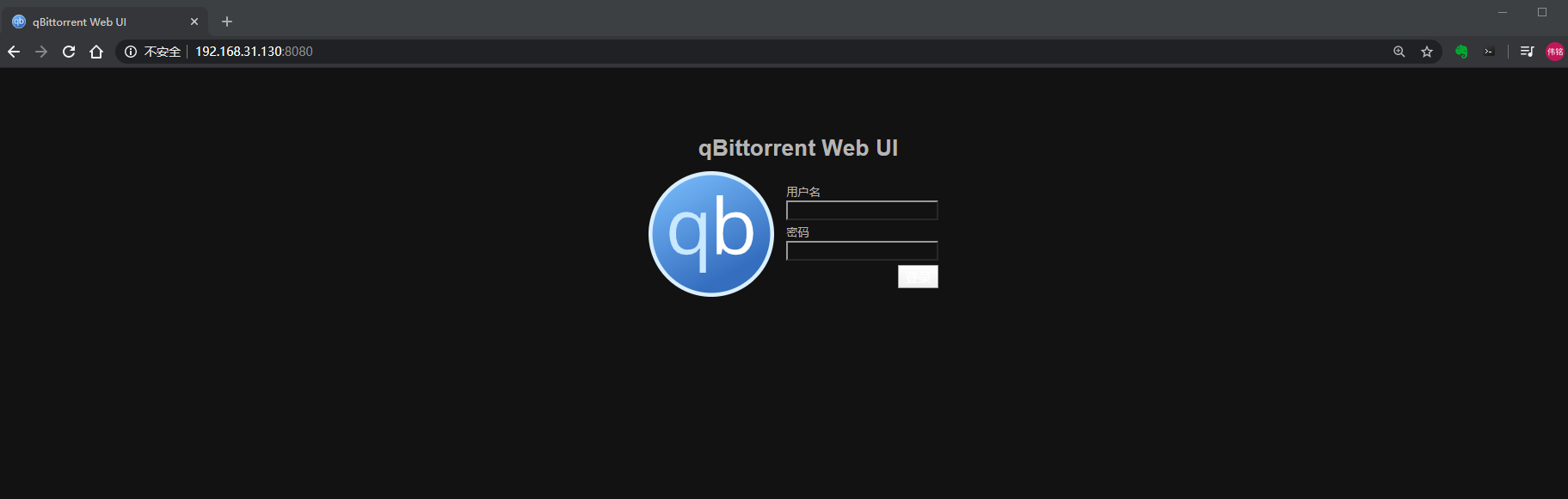

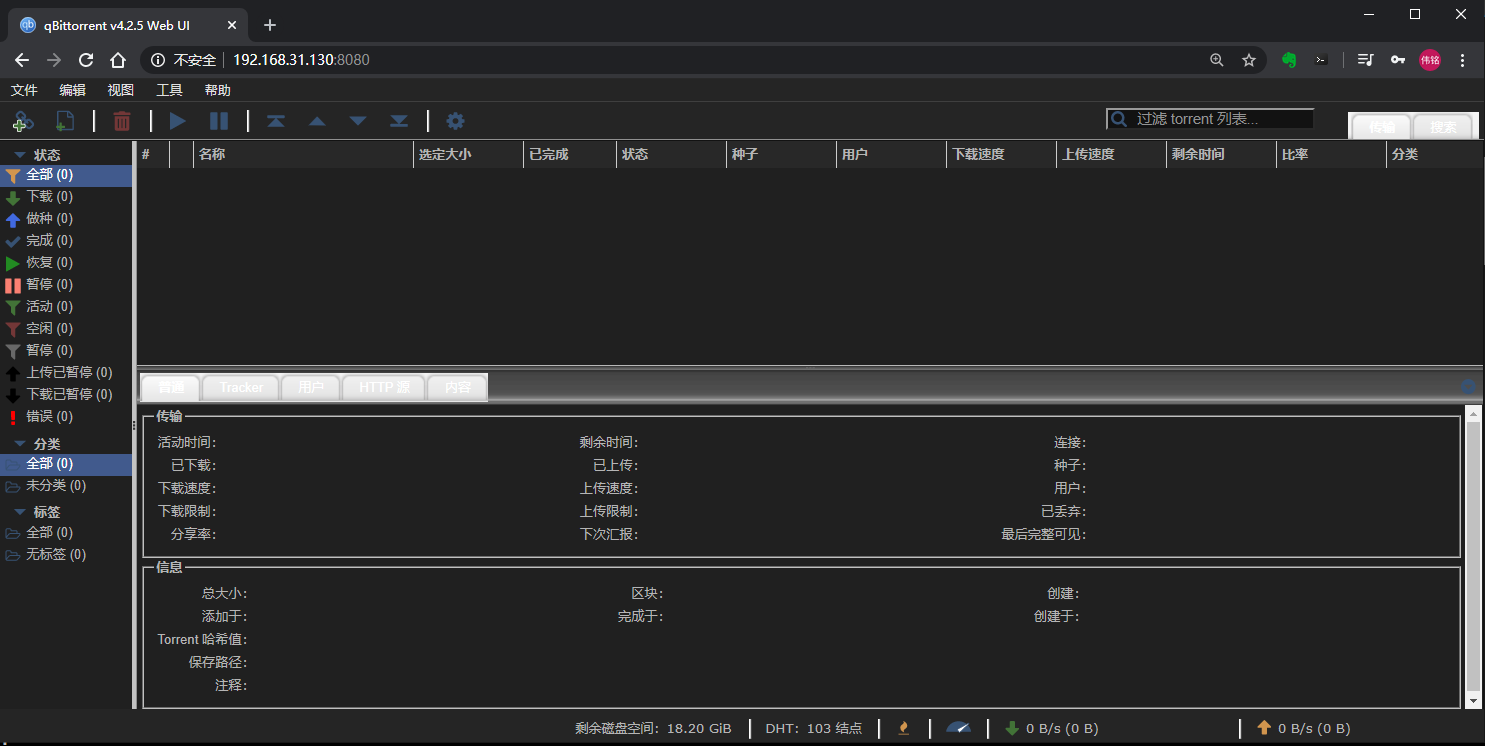

部署qbittorrent下载工具

version: "2.1"services:qbittorrent:image: linuxserver/qbittorrentcontainer_name: qbittorrentenvironment:- PUID=1000- PGID=1000- TZ=Europe/London- UMASK_SET=022- WEBUI_PORT=8080volumes:- /path/to/appdata/config:/config- /path/to/downloads:/downloadsports:- 6881:6881- 6881:6881/udp- 8080:8080restart: unless-stopped

[root@rmaster01 qbittorrent]# docker-compose up -dStarting qbittorrent ... done[root@rmaster01 qbittorrent]# docker-compose psName Command State Ports------------------------------------------------------------------------------------------------------qbittorrent /init Up 0.0.0.0:6881->6881/tcp, 0.0.0.0:6881->6881/udp, 0.0.0.0:8080->8080/tcp[root@rmaster01 qbittorrent]#

用户:admin

密码:adminadmin

项目

docker-compose 一键安装

修改配置文件 修改docker-compose.yml中的配置信息,主要修改volumes节点,将宿主机的两个目录映射到容器内。 environment节点,配置自己的环境变量。

一键完成所有环境搭建

[root@riyimei mindoc]# lltotal 4-rw-r--r-- 1 root root 598 Jun 7 15:53 docker-compose.yml[root@riyimei mindoc]# cat docker-compose.ymlMinDoc_New:image: registry.cn-hangzhou.aliyuncs.com/mindoc/mindoc:v2.0-beta.2privileged: falserestart: alwaysports:- 8181:8181volumes:- /var/www/mindoc/database:/mindoc/database- /var/www/mindoc/uploads:/mindoc/uploadsenvironment:- MINDOC_RUN_MODE=prod- MINDOC_DB_ADAPTER=sqlite3- MINDOC_DB_DATABASE=./database/mindoc.db- MINDOC_CACHE=true- MINDOC_CACHE_PROVIDER=file- MINDOC_ENABLE_EXPORT=false- MINDOC_BASE_URL=- MINDOC_CDN_IMG_URL=- MINDOC_CDN_CSS_URL=- MINDOC_CDN_JS_URL=dns:- 223.5.5.5- 223.6.6.6[root@riyimei mindoc]#

[root@riyimei mindoc]# docker-compose up -dPulling MinDoc_New (registry.cn-hangzhou.aliyuncs.com/mindoc/mindoc:v2.0-beta.2)...v2.0-beta.2: Pulling from mindoc/mindoc4fe2ade4980c: Pull completeee3bf88c6061: Pull completeedd5e2dfc789: Pull complete24fc4ec1dd71: Pull completeec4f68fd9612: Pull complete26b991074542: Pull complete948bcd2e45ec: Pull complete51f52fcbd9f9: Pull complete72ac77c2c335: Pull complete626ec74d4647: Pull completea07969c9d375: Pull completecaed215bf7b0: Pull complete53fe131203a5: Pull completeDigest: sha256:f5c62fc88a1373fa239d3b8ab92ad15d4ce56e49fab10948320630d0c5b66882Status: Downloaded newer image for registry.cn-hangzhou.aliyuncs.com/mindoc/mindoc:v2.0-beta.2Creating mindoc_MinDoc_New_1 ... done[root@riyimei mindoc]# docker-compose psName Command State Ports-----------------------------------------------------------------mindoc_MinDoc_New_1 ./start.sh Up 0.0.0.0:8181->8181/tcp[root@riyimei mindoc]#

docker-compose up -d

浏览器访问

整个部署完成了

常用命令参考

启动

docker-compose up -d

停止

docker-compose stop

重启

docker-compose restart

停止删除容器,释放所有资源

docker-compose down

删除并重新创建

docker-compose -f docker-compose.yml down && docker-compose up -d 更多 docker-compose 的使用相关的内容 请查看官网文档或百度