过拟合:在训练集上表现良好但是在测试集上表现的没有那么出色

出现过拟合的原因

1. 训练集的数量级和模型的复杂度不匹配。训练集的数量级要小于模型的复杂度;

2. 训练集和测试集特征分布不一致;

3. 样本里的噪音数据干扰过大,大到模型过分记住了噪音特征,反而忽略了真实的输入输出间的关系;

4. 权值学习迭代次数足够多(Overtraining),拟合了训练数据中的噪声和训练样例中没有代表性的特征。

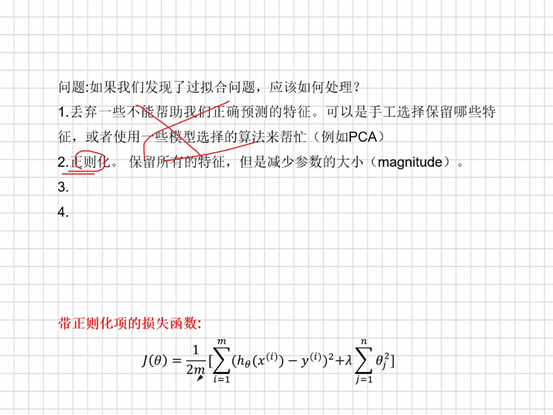

解决方法:

1. simpler model structure

调小模型复杂度,使其适合自己训练集的数量级(缩小宽度和减小深度)

2. data augmentation

训练集越多,过拟合的概率越小。在计算机视觉领域中,增广的方式是对图像旋转,缩放,剪切,添加噪声等。

3. regularization

参数太多,会导致我们的模型复杂度上升,容易过拟合,也就是我们的训练误差会很小。 正则化是指通过引入额外新信息来解决机器学习中过拟合问题的一种方法。这种额外信息通常的形式是模型复杂性带来的惩罚度。 正则化可以保持模型简单,另外,规则项的使用还可以约束我们的模型的特性。

4,添加正则项。L1正则更加容易产生稀疏解、L2正则倾向于让参数w趋向于0.

带正则化项的LR损失函数:

正则化项惩罚:

L1:消除:特征或减少θ,

L2.缩小权重:θ越大,权重越大.缩小权重

学习曲线:

方法:训练集大小为横轴,训练误差为纵轴