回归树

常用的决策树有 ID3、C4.5、CART 等,其中 CART 就可以用来做回归问题,CART 全称就是 Classification And Regression Tree(分类和回归树)

回归树(regression tree),顾名思义,就是用树模型做回归问题,每一片叶子都输出一个预测值。预测值一般是该片叶子所含训练集元素输出的均值,即 cm=ave(yi|xi∈leafm)cm=ave(yi|xi∈leafm)。

CART 在分类问题和回归问题中的相同和差异:

- 相同:

- 在分类问题和回归问题中,CART 都是一棵二叉树,除叶子节点外的所有节点都有且仅有两个子节点;

- 所有落在同一片叶子中的输入都有同样的输出。

- 差异:

- 在分类问题中,CART 使用基尼指数(Gini index)作为选择特征(feature)和划分(split)的依据;在回归问题中,CART 使用 mse(mean square error)或者 mae(mean absolute error)作为选择 feature 和 split 的 criteria。

- 在分类问题中,CART 的每一片叶子都代表的是一个 class;在回归问题中,CART 的每一片叶子表示的是一个预测值,取值是连续的。

原理

决策树最直观的理解其实就是,输入特征空间(R n R^nR__n),然后对特征空间做划分,每一个划分属于同一类或者对于一个输出的预测值。那么这个算法需要解决的问题是1. 如何决策边界(划分点)?2. 尽可能少的比较次数(决策树的形状)

连续型数据,

先找到第一个特征,遍历第一个特征所有点.找到最优的一个点

整体的误差平方和越小越好

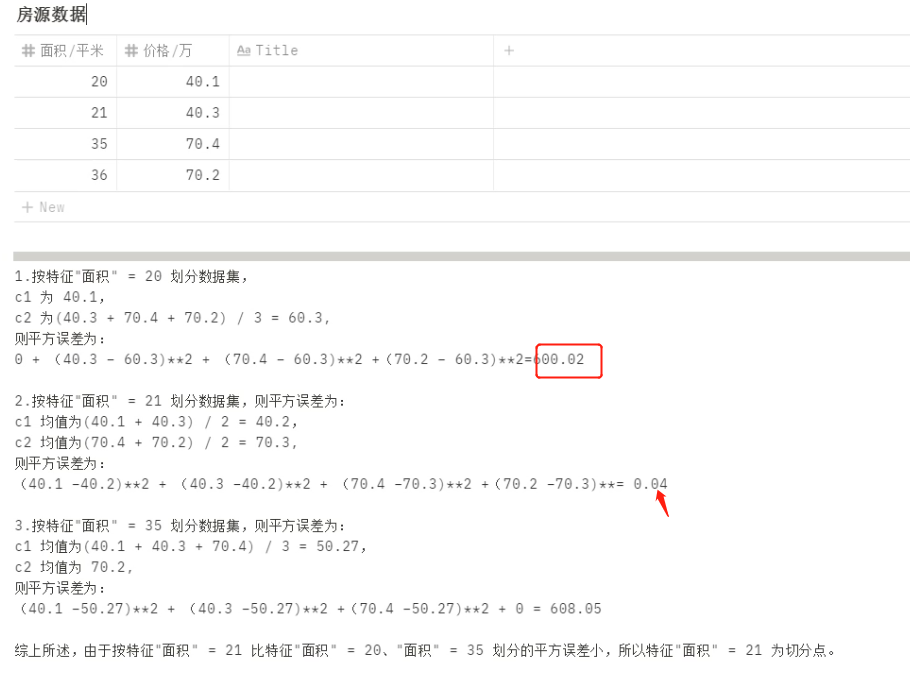

特征1最优切分点:

切分每个点,通过划分点划分C1,C2俩部分子集,计算误差和平方,越小越好.最小的误差和就是最好的划分点.

最优特征:

找最优切分点和最优特征, 特征1最优切分点,损失算出误差的平均值.把每个特征的最优点找到,在找特征里最优的特征

1.很多次误差平方和找最优特征和最优切分点:,

2.最终的预测值:叶子节点的平均值

3.在计算损失,很多次的误差平方和

回归误差:真实值减去预测均值