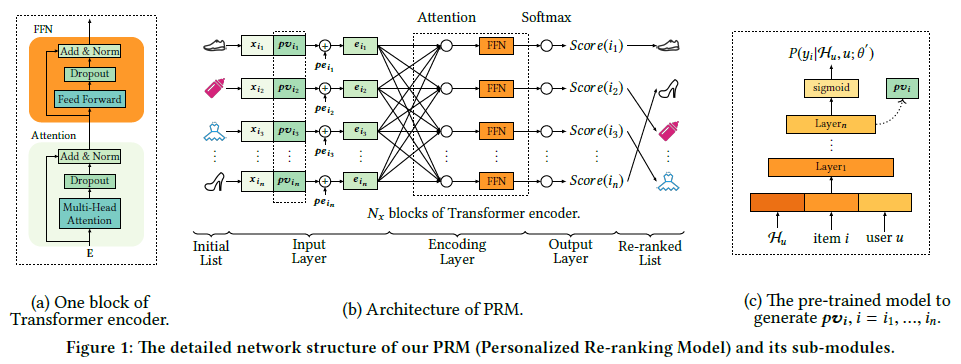

Motivation

- Sota方法都是RNN-based的.但是RNN-based方法对item列表中item之间的交互建模能力有效(距离限制、交互限制)

- Sota方法没有对不同用户的偏好和意图进行考虑,即在重排序过程没有显示地引入个性化信息。

Method

预训练模型

The pre-trained neural network is learned from the whole click-through logs of the platform.

Output Layer

one linear layer followed by a softmax layer作为输出层。

输出层的输出是点击概率。

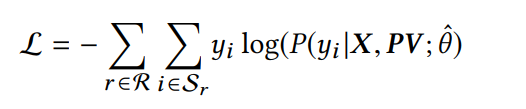

Loss

Offline Experiments

初始列表的最大长度为30。

评价指标:Precision、MAP

Yahoo Letor dataset

- 在由两个LTR模型(LambdaMART、SVMRank)生成的两个初始列表集上进行分析。

该数据及没有包含用户相关的信息,因此只用PRM-BASE模型用于比较。

发现

使用multi-head提升不明显,为了节约计算资源,使用one head即可。这是因为原始的列表中的物品都具有较高的同质性。

E-commerce dataset

对于该数据集,使用标准的Wide&Deep模型用于生成初始列表。

Online Experiments

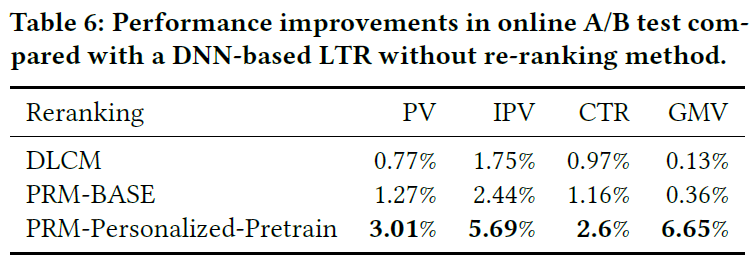

Metrics: PV(view about)、IPV(click about)、CTR(click about)、GMV(purchase-about)