Netty 在主从 Reactor 多线程模型上做了改进,有多个Reactor

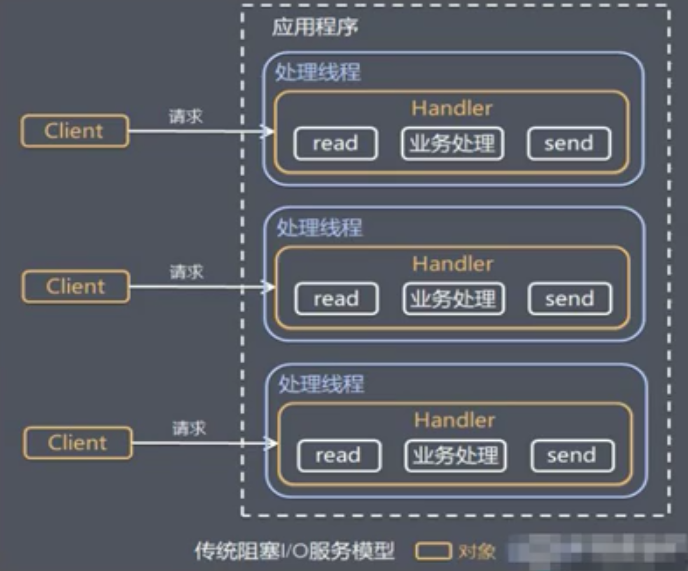

传统阻塞IO模型:

特点:

1、采用阻塞I0模式获取输入的数据

2、每个连接都需要独立的线程完成数据的输入,业务处理,数据返回

缺点:

1、当并发数很大,就会创建大量的线程,占用很大系统资源

2、连接创建后,如果当前线程暂时没有数据可读,该线程会阻塞在read操作,造成线程资源浪费

传统阻塞IO模型示意图

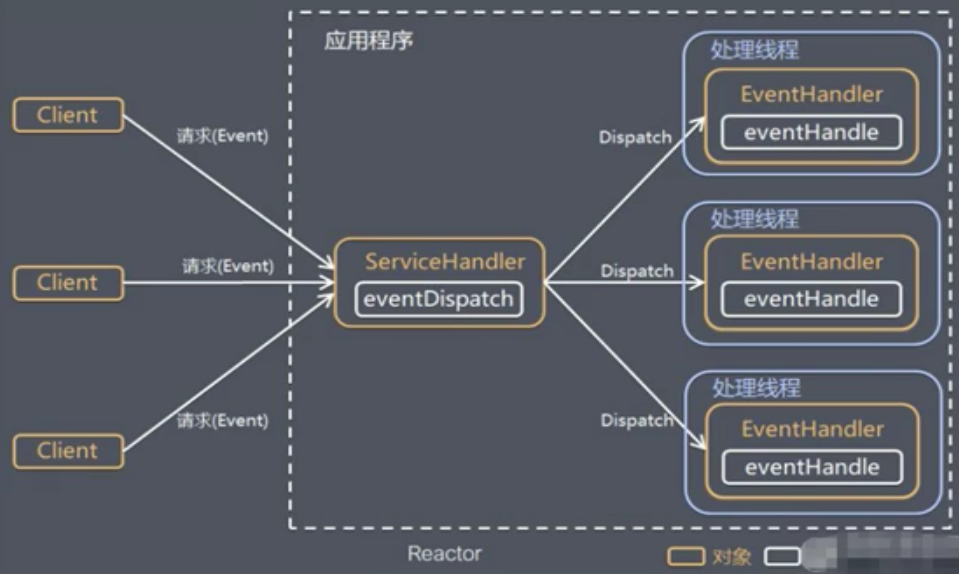

Reactor 模式:

设计思路:

1、基于I/O 复用模型:多个连接共用一个阻塞对象,应用程序只需要在一个阻塞对象等待,无需阻塞等待所有连接。当某个连接有新的数据可以处理时,操作系统通知应用程序,线程从阻塞状态返回,开始进行业务处理

2、基于线程池复用线程资源:不为每个连接创建线程,将连接完成后的业务处理任务分配给线程池进行处理,一个线程可以处理多个连接的业务

Reactor 大致设计思路

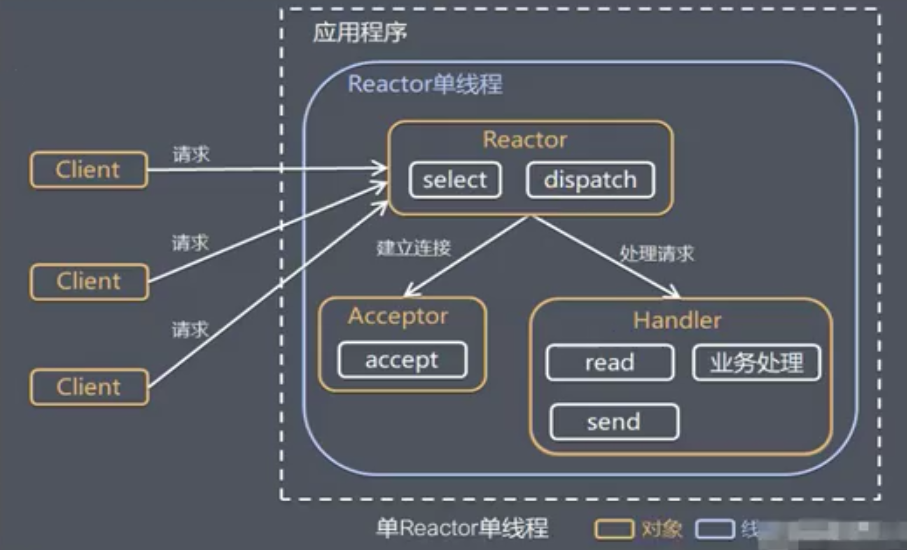

单Reactor单线程:

NIO章节中的聊天室案例即为该模式实现,在遇到高并发情况下会客户端出现阻塞现象

优点:

模型简单,没有多线程、进程通信、竞争的问题,全部都在一个线程中完成

缺点:

1、性能问题:Reactor只有一个线程,无法完全发挥多核CPU的性能,Handler 在处理某个连接上的业务时,整个进程无法处理其他连接事件,很容易导致性能瓶颈

2、可靠性问题:线程意外终止,或者进入死循环,会导致整个系统通信模块不可用,不能接收和处理外部消息,造成节点故障

使用场景:

客户端的数量有限,业务处理非常快速,比如Redis在业务处理的时间复杂度0(1)的情况

单Reactor单线程结构示意图

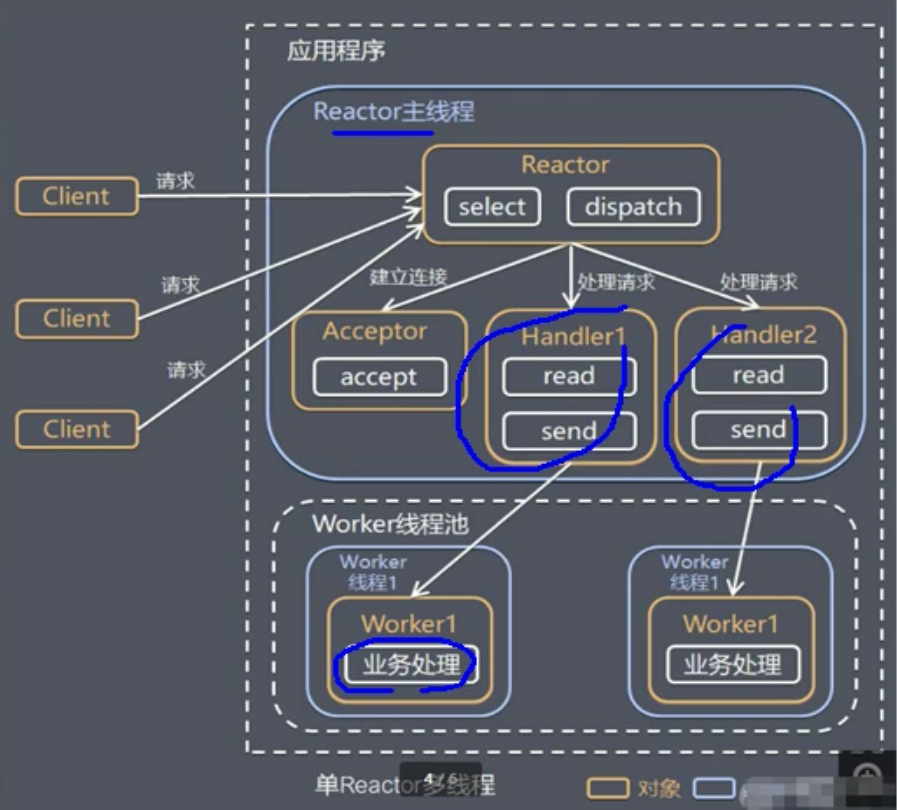

单Reactor多线程:

工作说明:

1、Reactor 对象通过select监控客户端请求事件,收到事件后,通过dispatch进行分发

2、如果建立连接请求,则右Acceptor通过accept处理连接请求,然后创建一个Handler对象处理完成连接后的各种事件

3、如果不是连接请求,则由reactor分发调用连接对应的handler来处理

4、handler只负责响应事件,不做具体的业务处理,通过read读取数据后,会分发给后面的worker线程池的某个线程处理业务

5、worker线程池会分配独立线程完成真正的业务,并将结果返回给handler

6、handler收到响应后,通过send将结果返回给client

单Reactor多线程结构示意图

优点:

缺点:

多线程数据共享和访问比较复杂,Reactor依旧是单线程处理所有事件监听与响应,高并发环境将出现性能瓶颈

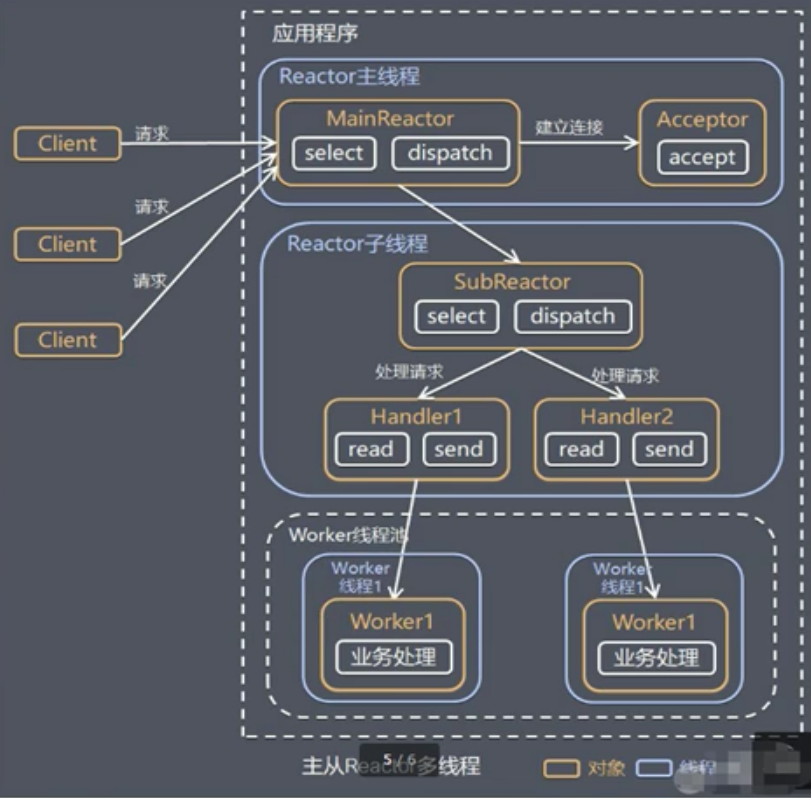

多Reactor多线程:

又称主从Reactor,Nginx主从Reactor多进程模型基于该模型

工作说明:

1、Reactor 主线程 MainReactor 对象通过 select 监听连接事件,收到事件后,通过 Acceptor 处理连接事件

2、当Acceptor处理连接事件后,MainReactor 将连接分配给 SubReactor(Reacto子线程)

3、Subreactor将连接加入到连接队列进行监听,并创建 handler 进行各种事件处理

4、当有 新事件发生时,Subreactor就会调用对应的 handler 处理

5、handler 通过 read 读取数据,分发给后面的 worker 线程池处理

6、worker 线程池分配独立的worker线程进行业务处理,并返回结果

7、handler 收到响应的结果后,再通过 send 将结果返回给 Client

8、Reactor 主线程可以对应多个 Reactor 子线程,即 MainRecator 可以关联多个 SubReactor,Reactor 主线程也可以存在多个(线程池管理)

多Reactor多线程结构示意图

优点:

1、父线程与子线程的数据交互简单职责明确,父线程只需要接收新连接,子线程完成后续的业务处理

2、父线程与子线程的数据交互简单,Reactor 主线程只需要把新连接传给子线程,子线程无需返回数据

缺点:

落地实现:

Netty主从多线程模型的支持,Nginx主从Reactor多进程模型,Memcached 主从多线程

总结:

单Reactor单线程:前台接待员和服务员是同一个人,全程为顾客服务

单Reactor多线程:1个前台接待员,多个服务员,接待员只负责接待

主从Reactor多线程:多个前台接待员,多个服务生

Netty Reactor 架构模型:

![$63])KBUWZTG~T$`O[U7PO2.png](https://cdn.nlark.com/yuque/0/2022/png/21405095/1643874620986-3d9566cb-8406-48b8-88c2-c41f0c308693.png#clientId=u11735d1a-5d72-4&crop=0&crop=0&crop=1&crop=1&from=paste&height=438&id=u4fab880b&margin=%5Bobject%20Object%5D&name=%2463%5D%29KBUWZTG~T%24%60O%5BU7PO2.png&originHeight=757&originWidth=948&originalType=binary&ratio=1&rotation=0&showTitle=false&size=297518&status=done&style=stroke&taskId=u8d3cf238-0094-46e7-baef-7dcba8f7310&title=&width=548)

工作原理:

- Netty 抽象出两组线程池 BossGroup 专门负责接收客户端的连接,WorkerGroup 专门门负责网络的读写

- BossGroup 和 WorkerGroup 类型都是 NioEventLoopGroup

- NioEventLoopGroup 相当于一个事件循环组,这个组中含有多个事件循环,每一个事件循环是NioEventLoop

- NioEventLoop 表示一个不断循环的执行处理任务的线程,每个 NioEventLoop 都有一个 selector, 用于监听绑定在其上的 socket 的网络通讯

- NioEventLoopGroup 可以有多个线程,即可以含有多个 NioEventLoop

- 每个 Boss NioEventLoop 循环执行的步骤:

- 轮询 accept 事件

- 处理 accept 事件,与 client 建立连接,生成 NioScocketChannel ,并将其注册到某个 worker NIOEventLoop上的 selector

- 处理任务队列的任务,即 runAllTasks

- 每个 Worker NIOEventLoop 循环执行的步骤

- 轮询read, write事件

- 处理 i/o 事件,即 read , write 事件,在对应 NioScocketChannel 处理

- 处理任务队列的任务,即 runAllTasks

- 每个 Worker NIOEventLoop 处理业务时,会使用 pipeline(管道),pipeline 中包含了 channel,即通过pipeline 可以获取到对应通道,管道中维护了很多的处理器

- 每个 NioChannel 只会绑定在唯一的 NioEventLoop 上

- 每个 NioChannel 都有一个自己的 ChannelPipeline