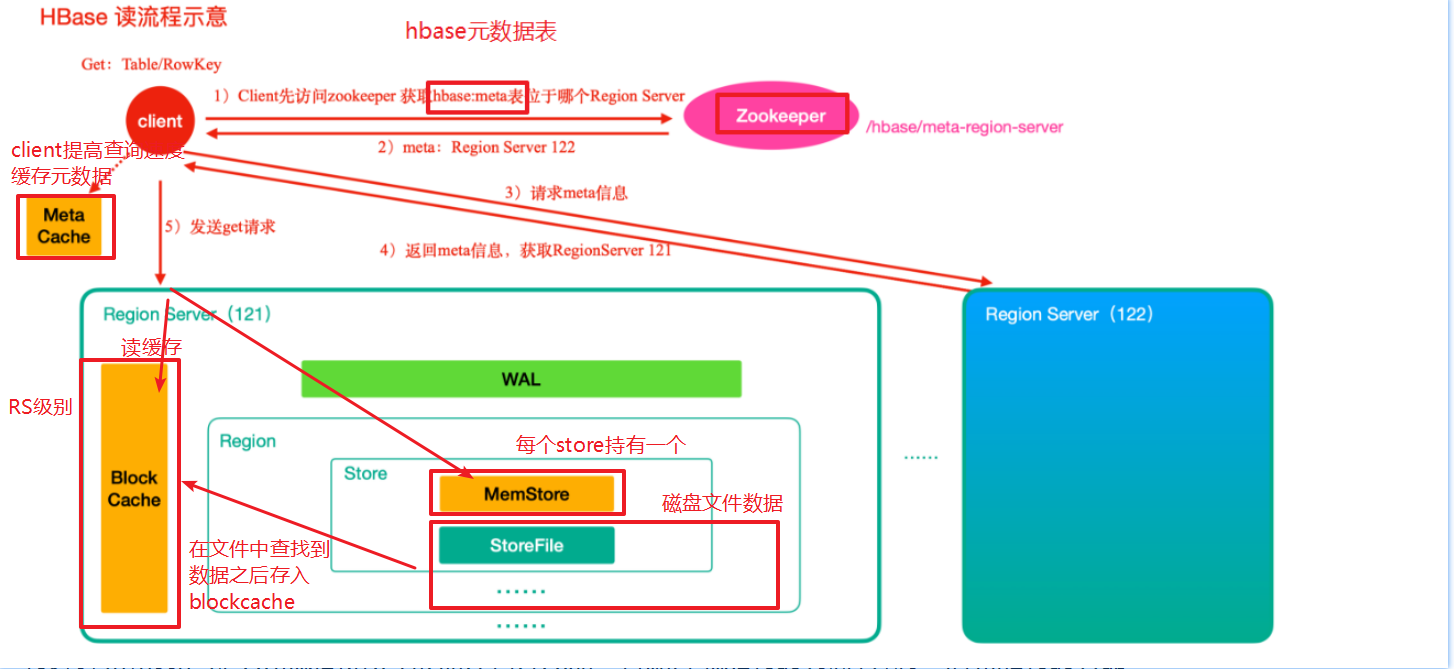

第 1 节 HBase读数据流程

HBase读操作

- ⾸先从zk找到meta表的region位置,然后读取meta表中的数据,meta表中存储了用户表的region信息

- 根据要查询的namespace、表名和rowkey信息。找到写入数据对应的region信息

- 找到这个region对应的regionServer,然后发送请求

- 查找对应的region

- 先从memstore查找数据,如果没有,再从BlockCache上读取

HBase上Regionserver的内存分为两个部分

- ⼀部分作为Memstore,主要用来写

- 另外⼀部分作为BlockCache,主要用于读数据

- 如果BlockCache中也没有找到,再到StoreFile上进行读取

从storeFile中读取到数据之后,不是直接把结果数据返回给客户端,⽽是把数据先写入到BlockCache中,⽬的是为了加快后续的查询,然后在返回结果给客户端。

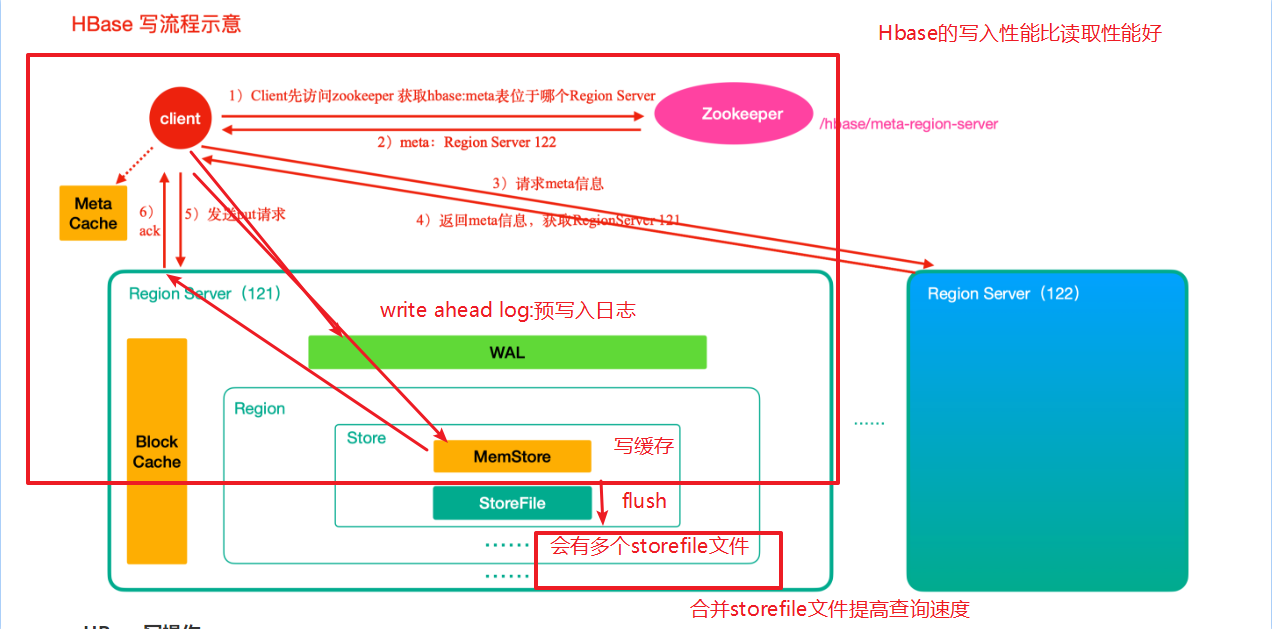

第 2 节 HBase写数据流程

HBase写操作

- 首先从zk找到meta表的region位置,然后读取meta表中的数据,meta表中存储了用户表的region信息

- 根据namespace、表名和rowkey信息。找到写入数据对应的region信息

- 找到这个region对应的regionServer,然后发送请求

- 把数据分别写到HLog(write ahead log)和memstore各⼀份

- memstore达到阈值后把数据刷到磁盘,生成storeFile文件

- 删除HLog中的历史数据

第 3 节 HBase的flush(刷写)及compact(合并)机制

Flush机制

(1)当memstore的⼤小超过这个值的时候,会flush到磁盘,默认为128M

<property><name>hbase.hregion.memstore.flush.size</name><value>134217728</value></property>

(2)当memstore中的数据时间超过1小时,会flush到磁盘

<property><name>hbase.regionserver.optionalcacheflushinterval</name><value>3600000</value></property>

(3)HregionServer的全局memstore的⼤小,超过该⼤小会触发flush到磁盘的操作,默认是堆⼤小的40%

<property><name>hbase.regionserver.global.memstore.size</name><value>0.4</value></property>

(4)⼿动flush

flush tableName

阻塞机制

以上介绍的是Store中memstore数据刷写磁盘的标准,但是Hbase中是周期性的检查是否满⾜以上标准,满⾜则进行刷写,但是如果在下次检查到来之前,数据疯狂入Memstore中,会出现什么问题呢?

会触发阻塞机制,此时⽆法写入数据到Memstore,数据⽆法写入Hbase集群。

- memstore中数据达到512MB

计算公式:hbase.hregion.memstore.flush.size*hbase.hregion.memstore.block.multiplier

hbase.hregion.memstore.flush.size刷写的阀值,默认是134217728,即128MB。

hbase.hregion.memstore.block.multiplier是⼀个倍数,默认是4。

- RegionServer全部memstore达到规定值

hbase.regionserver.global.memstore.size.lower.limit是0.95

hbase.regionserver.global.memstore.size是0.4,

堆内存总共是16G

触发刷写的阈值是:6.08GB()

触发阻塞的阈值是:6.4GB ()

Compact合并机制

- 在hbase中主要存在两种类型的compact合并

- minor compact小合并

- 在将Store中多个HFile(StoreFile)合并为一个HFile

- minor compact小合并

这个过程中,删除和更新的数据仅只是做了标记,并没有物理移除,这种合并的触发频率很高。

- minor compact⽂件选择标准由以下几个参数共同决定

<!--待合并⽂件数据必须大于等于下⾯这个值-->

<property>

<name>hbase.hstore.compaction.min</name>

<value>3</value>

</property>

<!--待合并文件数据必须⼩于等于下⾯这个值-->

<property>

<name>hbase.hstore.compaction.max</name>

<value>10</value>

</property>

<!--默认值为128m,表示文件⼤⼩小于该值的store file一定会加⼊到minor compaction的store file中 -->

<property>

<name>hbase.hstore.compaction.min.size</name>

<value>134217728</value>

</property>

<!--默认值为LONG.MAX_VALUE,表示⽂件⼤小大于该值的store file一定会被minor compaction排除-->

<property>

<name>hbase.hstore.compaction.max.size</name>

<value>9223372036854775807</value>

</property>

触发条件

- memstore flush

在进行memstore flush前后都会进⾏判断是否触发compact

- 定期检查线程

周期性检查是否需要进行compaction操作,由参数:hbase.server.thread.wakefrequency决定,默认值是10000 millseconds

- major compact⼤合并

- 合并Store中所有的HFile为一个HFile

这个过程有删除标记的数据会被真正移除,同时超过单元格maxVersion的版本记录也会被删除。合并频率比较低,默认7天执行⼀次,并且性能消耗非常大,建议⽣产关闭(设置为0),在应⽤空闲时间手动触发。⼀般可以是⼿动控制进行合并,防止出现在业务高峰期。

- major compaction触发时间条件

<!--默认值为7天进⾏一次⼤合并,-->

<property>

<name>hbase.hregion.majorcompaction</name>

<value>604800000</value>

</property>

- 手动触发

##使用major_compact命令

major_compact tableName

第 4 节 Region 拆分机制

Region中存储的是⼤量的rowkey数据 ,当Region中的数据条数过多的时候,直接影响查询效率.当Region过⼤的时候.HBase会拆分Region , 这也是Hbase的一个优点

4.1 拆分策略

HBase的Region Split策略⼀共有以下几种:

1)ConstantSizeRegionSplitPolicy

0.94版本前默认切分策略

当region⼤小⼤于某个阈值(hbase.hregion.max.filesize=10G)之后就会触发切分,⼀个region等分为2个region。

但是在生产线上这种切分策略却有相当大的弊端:

切分策略对于⼤表和⼩表没有明显的区分。阈值(hbase.hregion.max.filesize)设置较大对大表⽐较友好,

但是⼩表就有可能不会触发分裂,极端情况下可能就1个,这对业务来说并不是什么好事。

如果设置较⼩则对小表友好,但一个⼤表就会在整个集群产⽣大量的region,这对于集群的管理、资源使用、failover来说都不是⼀件好事。

2)IncreasingToUpperBoundRegionSplitPolicy

0.94版本~2.0版本默认切分策略

切分策略稍微有点复杂,总体看和ConstantSizeRegionSplitPolicy思路路相同,一个region⼤小⼤于设置阈值就会触发切分。

但是这个阈值并不像ConstantSizeRegionSplitPolicy是一个固定的值,⽽是会在一定条件下不断调整,调整则和region所属表在当前regionserver上的region个数有关系.

region split的计算公式是:

regioncount^3 * 128M * 2,当region达到该size的时候进行split

例如:

第⼀次split:1^3 * 256 = 256MB

第⼆次split:2^3 * 256 = 2048MB

第三次split:3^3 * 256 = 6912MB

第四次split:4^3 * 256 = 16384MB > 10GB,因此取较小的值10GB

后⾯每次split的size都是10GB了

3)SteppingSplitPolicy

2.0版本默认切分策略

这种切分策略的切分阈值又发⽣了变化,相⽐IncreasingToUpperBoundRegionSplitPolicy简单了一些,依然和待分裂region所属表在当前regionserver上的region个数有关系,

如果region个数等于1,切分阈值为flush size * 2,否则为MaxRegionFileSize。

这种切分策略对于⼤集群中的⼤表、⼩表会⽐IncreasingToUpperBoundRegionSplitPolicy更加友好,⼩表不会再产⽣大量的小region,而是适可⽽止。

4)KeyPrefixRegionSplitPolicy

根据rowKey的前缀对数据进⾏分组,这里是指定rowKey的前多少位作为前缀,⽐如rowKey都是16位的,指定前5位是前缀,那么前5位相同的rowKey在进行

region split的时候会分到相同的region中。

5)DelimitedKeyPrefixRegionSplitPolicy

保证相同前缀的数据在同⼀个region中,例如rowKey的格式为:userid_eventtype_eventid,指定的delimiter为 _ ,则split的的时候会确保userid相同的数据在同一个region中。

6)DisabledRegionSplitPolicy

不启用自动拆分, 需要指定⼿动拆分

4.2 RegionSplitPolicy的应⽤

Region拆分策略可以全局统一配置,也可以为单独的表指定拆分策略。

1)通过hbase-site.xml全局统⼀配置(对hbase所有表生效)

<property>

<name>hbase.regionserver.region.split.policy</name>

<value>org.apache.hadoop.hbase.regionserver.IncreasingToUpperBoundRegionSplitPolicy</value>

</property>

2)通过Java API为单独的表指定Region拆分策略

HTableDescriptor tableDesc = new HTableDescriptor("test1");

tableDesc.setValue(HTableDescriptor.SPLIT_POLICY, IncreasingToUpperBoundRegionSplitPolicy.class.getName());

tableDesc.addFamily(new HColumnDescriptor(Bytes.toBytes("cf1")));

admin.createTable(tableDesc);

3)通过HBase Shell为单个表指定Region拆分策略

hbase> create 'test2', {METADATA => {'SPLIT_POLICY' => 'org.apache.hadoop.hbase.regionserver.IncreasingToUpperBoundRegionSplitPolicy'}},{NAME => 'cf1'}

第 5 节 HBase表的预分区

5.1 为何要预分区?

当⼀个table刚被创建的时候,Hbase默认的分配一个region给table。也就是说这个时候,所有的读写请求都会访问到同⼀个regionServer的同一个region中,这个时候就达不到负载均衡的效果了,集群中的其他regionServer就可能会处于⽐较空闲的状态。解决这个问题可以⽤pre-splitting,在创建table的时候就配置好,生成多个region。

- 增加数据读写效率

- 负载均衡,防止数据倾斜

- ⽅便集群容灾调度region

每一个region维护着startRow与endRowKey,如果加入的数据符合某个region维护的rowKey范围,则该数据交给这个region维护

5.2 ⼿动指定预分区

create 'person','info1','info2',SPLITS => ['1000','2000','3000']

也可以把分区规则创建于⽂件中

vim split.txt

⽂件内容

aaa

bbb

ccc

ddd

执行

create 'student','info',SPLITS_FILE => '/root/hbase/split.txt'

第 6 节 Region 合并

6.1 Region合并说明

6.2 如何进行Region合并

通过Merge类冷合并Region

需要先关闭hbase集群

需求:需要把student表中的2个region数据进行合并

student,,1593244870695.10c2df60e567e73523a633f20866b4b5.

student,1000,1593244870695.0a4c3ff30a98f79ff6c1e4cc927b3d0d.

这⾥通过org.apache.hadoop.hbase.util.Merge类来实现,不需要进入hbase shell,直接执行(需要先关闭hbase集群):

hbase org.apache.hadoop.hbase.util.Merge student \

student,,1595256696737.fc3eff4765709e66a8524d3c3ab42d59. \

student,aaa,1595256696737.1d53d6c1ce0c1bed269b16b6514131d0.

通过online_merge热合并Region

不需要关闭hbase集群,在线进行合并

与冷合并不同的是,online_merge的传参是Region的hash值,⽽Region的hash值就是Region名称的最后那段在两个.之间的字符串部分。

需求:需要把lagou_s表中的2个region数据进行合并:

student,,1587392159085.9ca8689901008946793b8d5fa5898e06. \

student,aaa,1587392159085.601d5741608cedb677634f8f7257e000.

需要进入hbase shell:

merge_region 'c8bc666507d9e45523aebaffa88ffdd6','02a9dfdf6ff42ae9f0524a3d8f4c7777'

成功后观察界⾯