学习链接:https://www.bilibili.com/video/BV1Qp4y1n7EN?p=18&spm_id_from=pageDriver

安装VMware

安装CentOS

1. 创建虚拟机

1. 选自定义

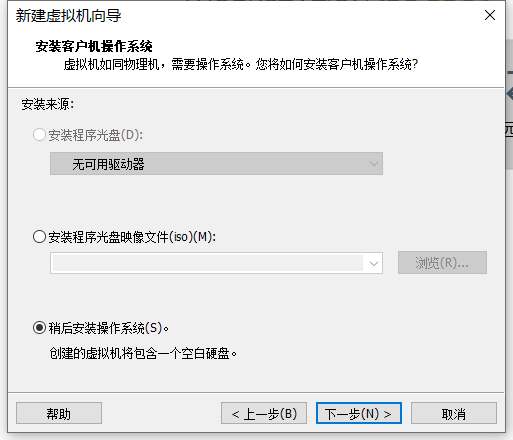

- 稍后安装操作系统

- 将安装Linux系统,CentOS 7 64位

- 更改虚拟机名称

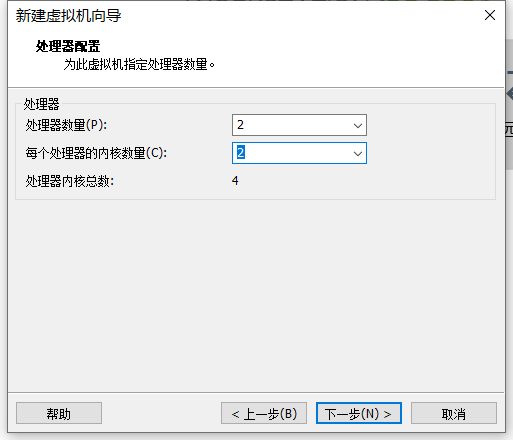

- 处理器数量和每个处理器的内核数量相乘不能超过物理机的cpu个数

- 配置虚拟内存

- 网络类型选择使用网络地址转换(NAT)

2. 安装系统前检查虚拟机的bios的虚拟化是不是打开的

3. 安装操作系统

- 选择cd/dvd的方式安装系统

- 开启虚拟机开始安装系统

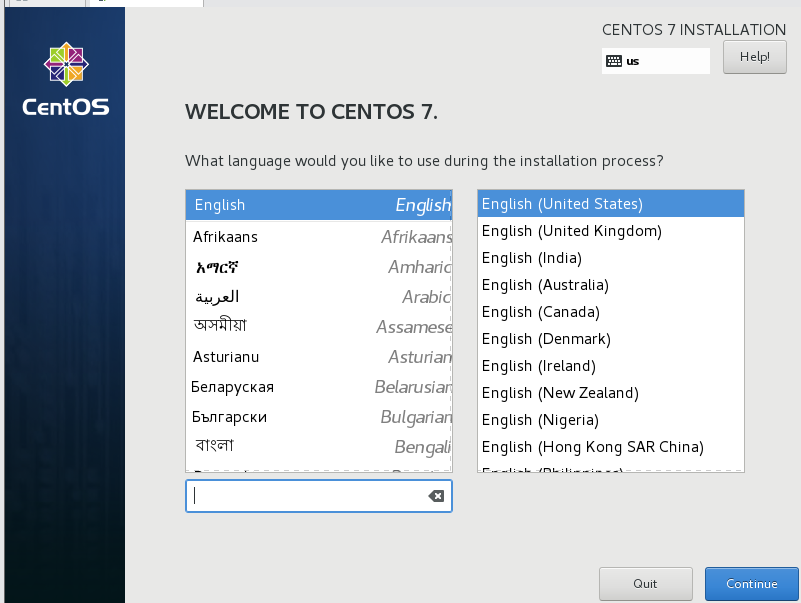

- 设置语言

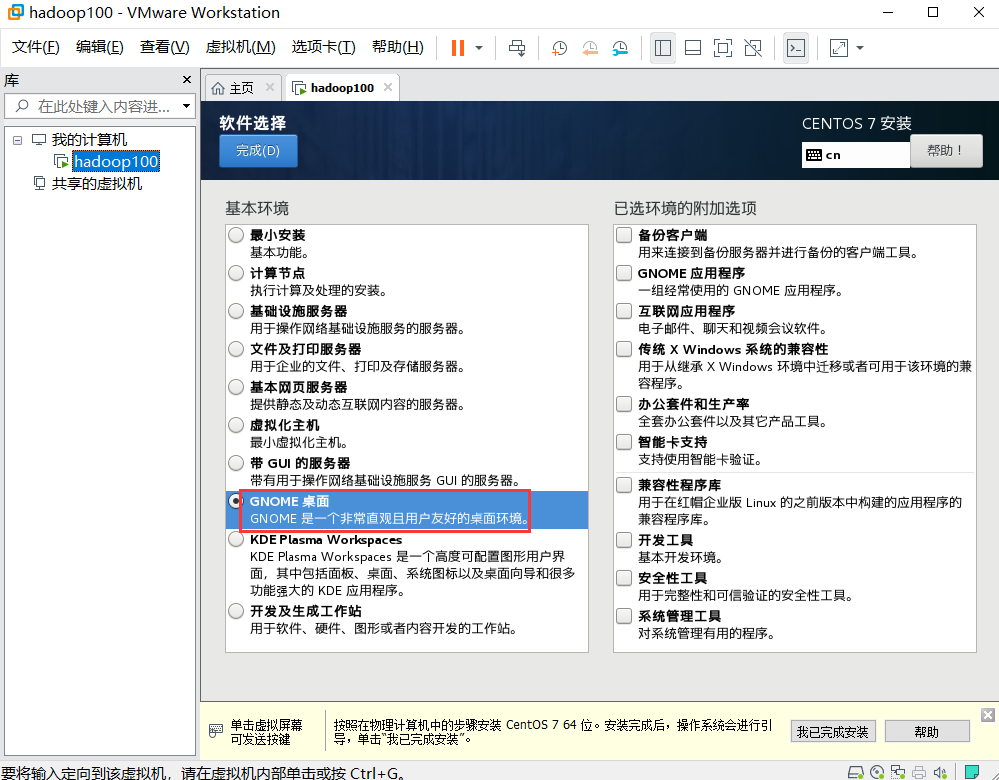

- 选择软件GNOME桌面

- 配置磁盘分区

- 添加boot区

- 添加swap交换分区

- 根目录分区

- 关闭kdump

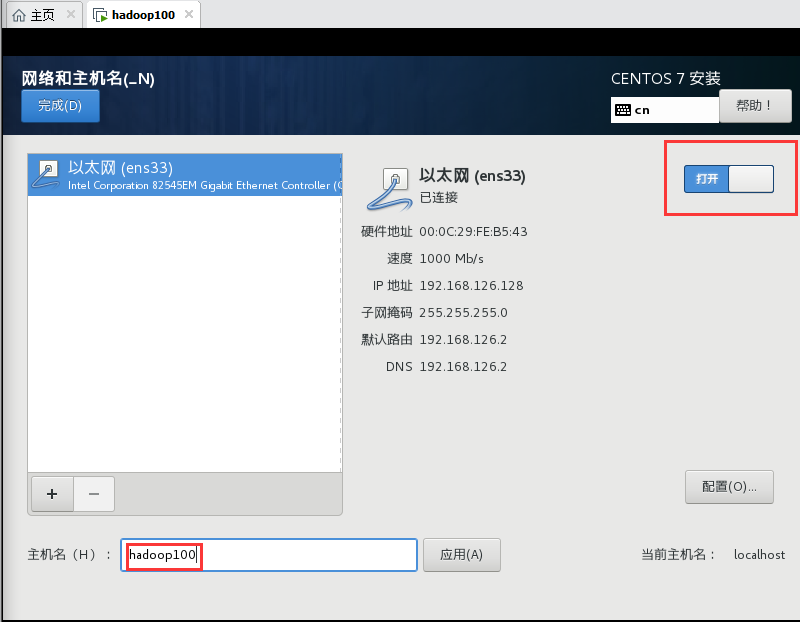

- 修改主机名,打开网络

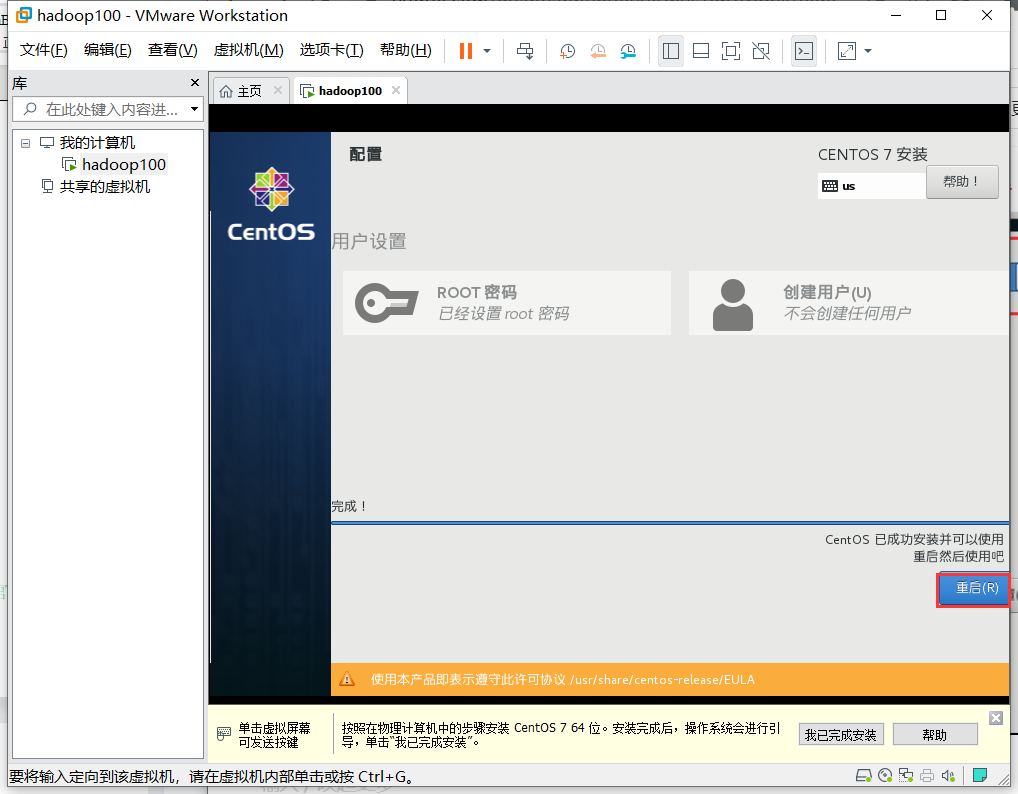

- 安装,设置账号密码,完成后重启虚拟机

4. 网络配置

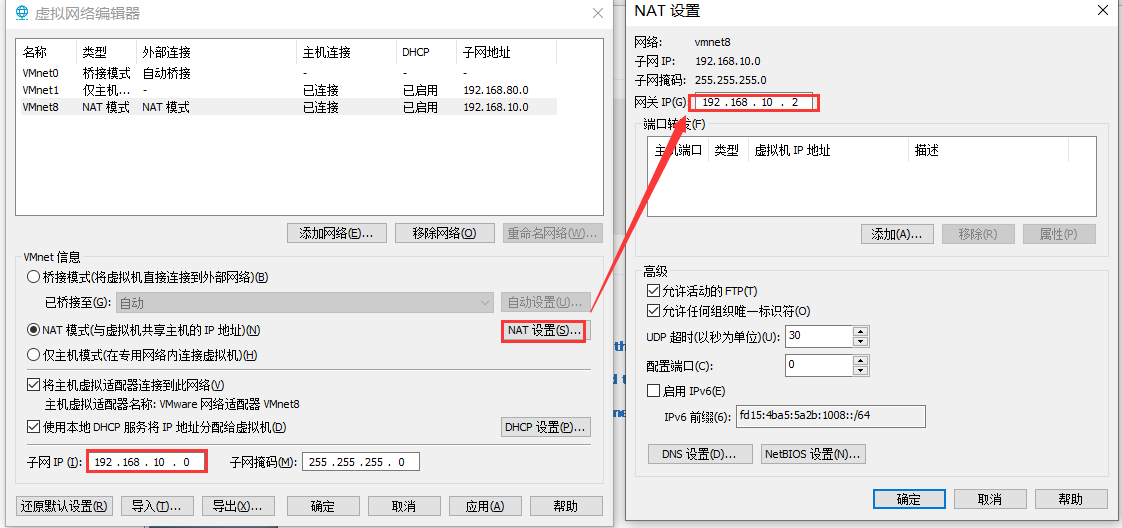

4.1 配置VMware的IP

- 编辑—>虚拟网络编辑器

4.2 Windows的网络配置

4.3 虚拟机网络IP修改地址配置

- 右键->打开终端->输入 su root 和密码,切换到root用户

- vim /etc/sysconfig/network-scripts/ifcfg-ens33 修改网络IP地址为静态IP地址

esc :wq退出

- vim /etc/hostname 修改主机名称

- 主机名称映射 vim /etc/hosts

添加:

192.168.10.100 hadoop100192.168.10.101 hadoop101192.168.10.102 hadoop102192.168.10.103 hadoop103192.168.10.104 hadoop104192.168.10.105 hadoop105192.168.10.106 hadoop106192.168.10.107 hadoop107192.168.10.108 hadoop108

- 重启 登录root账号

- 验证ip地址和对应主机名称 ifconfig

- 验证网络是否畅通 ping www.baidu.com

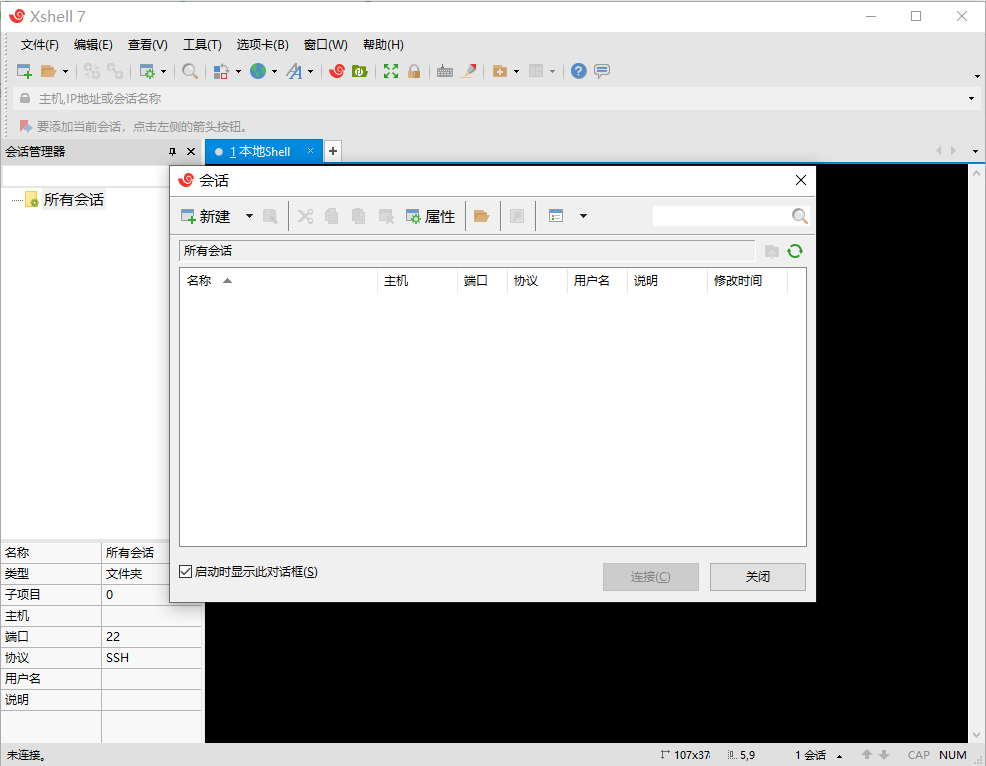

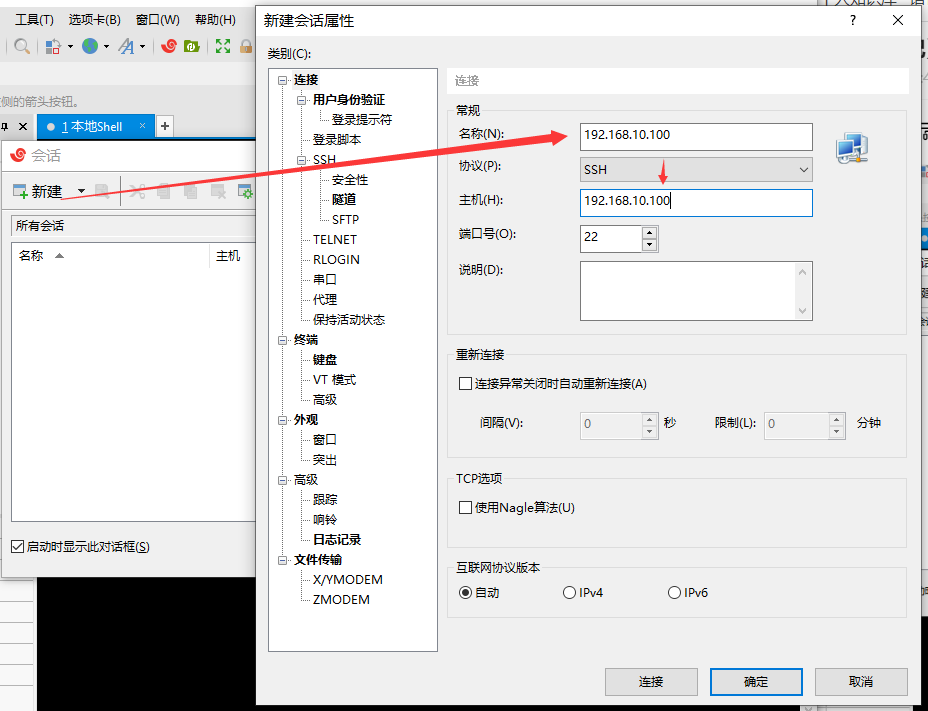

安装远程访问工具 Xshell

- 下载链接:https://xshell.en.softonic.com/ 安装

- 新建会话 设置名称和主机

- 设置用户名和密码

修改windows的主机映射文件(hosts文件)

- 进入C:\Windows\System32\drivers\etc路径

- 打开hosts文件并添加

192.168.10.100 hadoop100192.168.10.101 hadoop101192.168.10.102 hadoop102192.168.10.103 hadoop103192.168.10.104 hadoop104192.168.10.105 hadoop105192.168.10.106 hadoop106192.168.10.107 hadoop107192.168.10.108 hadoop108

-

安装Xftp 用于win和linux通信

hadoop100虚拟机配置——模板虚拟机

测试网络是否畅通

- 安装epel-release

Extra Packages for Enterprise Linux是为“红帽系”的操作系统提供额外的软件包,适用于RHEL、CentOS和Scientific Linux。相当于是一个软件仓库,大多数rpm包在官方 repository 中是找不到的)

yum install -y epel-release

关闭防火墙,关闭防火墙开机自启

systemctl stop firewalldsystemctl disable firewalld.service

给自己创的用户root权限

打开/etc/sudoers文件

vim /etc/sudoers

修改/etc/sudoers文件,在%wheel这行下面添加一行:

qtbhy ALL=(ALL) NOPASSWD:ALL

测试一下:

[root@hadoop100 ~]# cd /opt/[root@hadoop100 opt]# ll总用量 0drwxr-xr-x. 2 root root 6 9月 7 2017 rh[root@hadoop100 opt]# exitexit[qtbhy@hadoop100 ~]$ cd /opt/[qtbhy@hadoop100 opt]$ ll总用量 0drwxr-xr-x. 2 root root 6 9月 7 2017 rh[qtbhy@hadoop100 opt]$ rm -rf rh/rm: 无法删除"rh/": 权限不够[qtbhy@hadoop100 opt]$ sudo rm -rf rh/ 使用sudo删除[qtbhy@hadoop100 opt]$ ll总用量 0

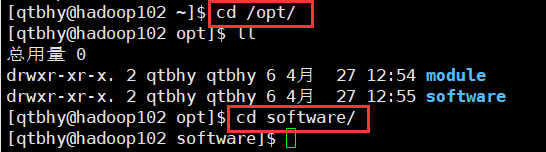

在/opt目录下创建文件夹,并修改所有者和所属组

[qtbhy@hadoop100 opt]$ sudo mkdir module 创建module文件夹[qtbhy@hadoop100 opt]$ ll总用量 0drwxr-xr-x. 2 root root 6 4月 27 12:54 module[qtbhy@hadoop100 opt]$ sudo mkdir software 创建software文件夹[qtbhy@hadoop100 opt]$ ll总用量 0drwxr-xr-x. 2 root root 6 4月 27 12:54 moduledrwxr-xr-x. 2 root root 6 4月 27 12:55 software[qtbhy@hadoop100 opt]$ sudo chown qtbhy:qtbhy module/ software/ 修改module、software的所有者和所属组[qtbhy@hadoop100 opt]$ ll总用量 0drwxr-xr-x. 2 qtbhy qtbhy 6 4月 27 12:54 moduledrwxr-xr-x. 2 qtbhy qtbhy 6 4月 27 12:55 software

卸载虚拟机自带的JDK

- 查看虚拟机中的java相关文件

- 卸载自带的jdk

[qtbhy@hadoop100 opt]$ su root密码:[root@hadoop100 opt]# rpm -qa | grep -i java |xargs -n1 rpm -e --nodeps

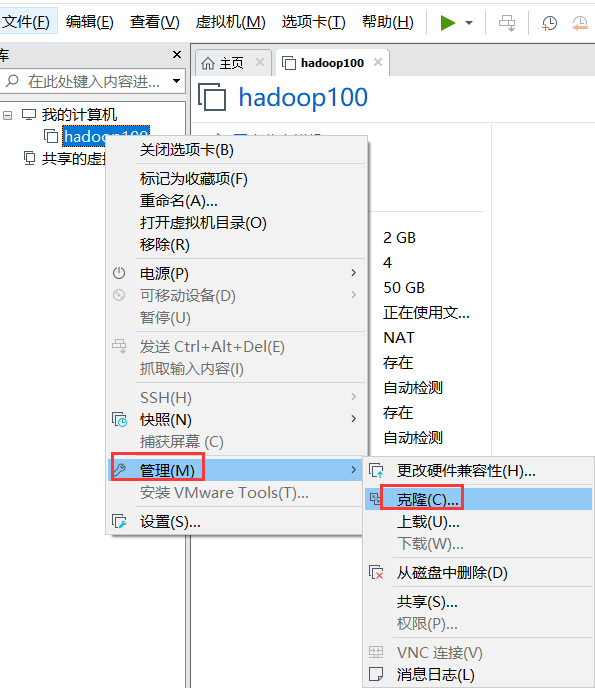

- 克隆 hadoop102 hadoop103 hadoop104

- 克隆

- 设置虚拟机名称

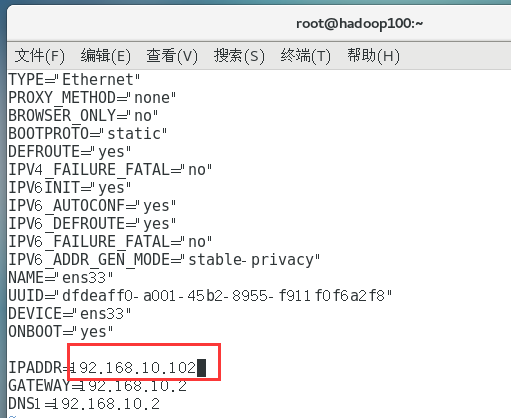

修改克隆的虚拟机IP 以hadoop102为例

- 开机,以root进入,右键打开终端

设置 ip

[root@hadoop100 ~]# vim /etc/sysconfig/network-scripts/ifcfg-ens33

设置主机名

[root@hadoop100 ~]# vim /etc/hostname

重启虚拟机

[root@hadoop100 ~]# reboot

查看是否修改

- ping外网 查看主机名

- XShell中点Xftp按钮

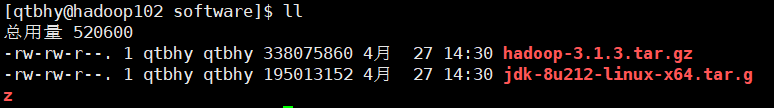

- 把jdk拖到hadoop102上 顺便把之后要用的Hadoop压缩包放到hadoop102上

- 此时,hadoop102就有了jdk

解压jdk压缩包到module目录下

tar -zxvf jdk-8u212-linux-x64.tar.gz -C /opt/module/

进入module目录

[qtbhy@hadoop102 software]$ cd ..[qtbhy@hadoop102 opt]$ cd ..[qtbhy@hadoop102 /]$ cd /opt/module/[qtbhy@hadoop102 module]$ ll总用量 0drwxr-xr-x. 7 qtbhy qtbhy 245 4月 2 2019 jdk1.8.0_212

进入jdk

[qtbhy@hadoop102 module]$ cd jdk1.8.0_212

配置环境变量

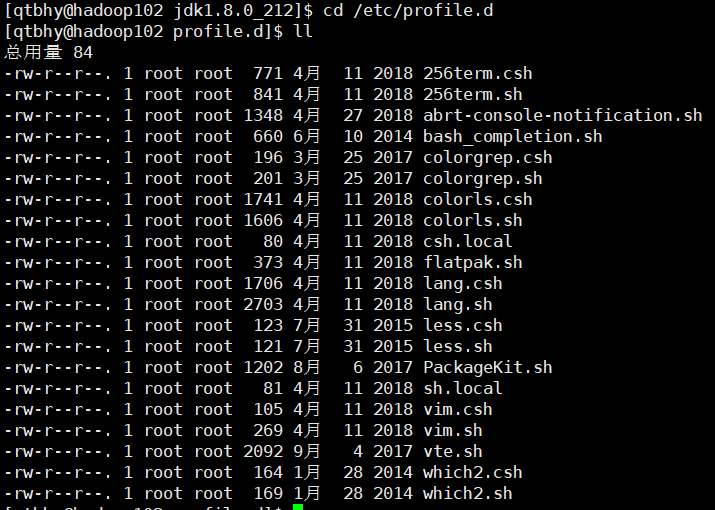

查看/etc/profile.d

[qtbhy@hadoop102 jdk1.8.0_212]$ cd /etc/profile.d

里面是.sh文件

创建my_env.sh文件

[qtbhy@hadoop102 profile.d]$ sudo vim my_env.sh

jdk路径:XShell双击hadoop102标签页标签,可以在新的窗口找路径

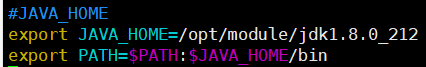

- 在文件中写入环境变量

- source一下/etc/profile文件,让新的环境变量PATH生效

[qtbhy@hadoop102 profile.d]$ source /etc/profile[qtbhy@hadoop102 profile.d]$ java

hadoop102安装Hadoop

解压hadoop-3.1.3.tar.gz到module目录下

[qtbhy@hadoop102 profile.d]$ cd /opt/software/[qtbhy@hadoop102 software]$ tar -zxvf hadoop-3.1.3.tar.gz -C /opt/module/

将Hadoop添加到环境变量

[qtbhy@hadoop102 hadoop-3.1.3]$ sudo vim /etc/profile.d/my_env.sh[qtbhy@hadoop102 hadoop-3.1.3]$ pwd/opt/module/hadoop-3.1.3

打开/etc/profile.d/my_env.sh文件

sudo vim /etc/profile.d/my_env.sh

在my_env.sh文件末尾添加如下内容

#HADOOP_HOMEexport HADOOP_HOME=/opt/module/hadoop-3.1.3export PATH=$PATH:$HADOOP_HOME/binexport PATH=$PATH:$HADOOP_HOME/sbin

让修改后的文件生效

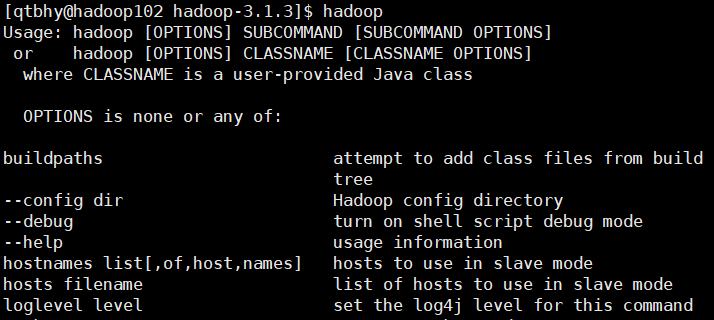

[qtbhy@hadoop102 hadoop-3.1.3]$ source /etc/profile

安装成功

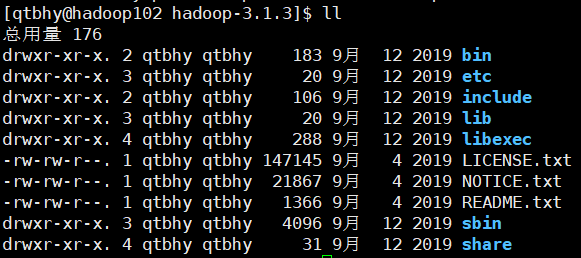

- Hadoop目录结构

- bin:存放对Hadoop相关服务(hdfs,yarn,mapred)进行操作的脚本

- etc:Hadoop的配置文件目录,存放Hadoop的配置文件

- lib:存放Hadoop的本地库(对数据进行压缩解压缩功能)

- sbin:存放启动或停止Hadoop相关服务的脚本

- share:存放Hadoop的依赖jar包、文档和官方案例