- HDFS&YARN

- 启动

linux121: start-dfs.sh

linux123: start-yarn.sh

#停止

linux121: stop-dfs.sh

linux123: stop-yarn.sh - HIVE启动:

- 启动 metastore 服务 linux121,123

nohup hive —service metastore & - 启动 metastore 服务 linux121,123

nohup hive —service metastore & - HUE启动:

- Impala的启动流程:

- linux121启动hdfs集群,#linux123启动yarn集群

- linux121,123启动hive元数据服务

- linux123启动如下⻆角⾊色

service impala-state-store start

service impala-catalog start

service impala-server start

#其余节点启动如下⻆角⾊色

service impala-server start - zookeeper启动:

- linux121启动:

sh /root/shells/zk.sh start

sh /root/shells/zk.sh stop

sh /root/shells/zk.sh status - MAVEN配置:

- HDFS-HA集群启动:

- YARN-HA集群启动:

- Hbase启动:

- Spark启动:

- Redis:

HDFS&YARN

启动

linux121: start-dfs.sh

linux123: start-yarn.sh

#停止

linux121: stop-dfs.sh

linux123: stop-yarn.sh

hdfs dfs访问的根目录是: /

历史日志服务器:

#启动

$HADOOP_HOME/sbin/mr-jobhistory-daemon.sh start historyserver

#停止

$HADOOP_HOME/sbin/mr-jobhistory-daemon.sh stop historyserver

#验证

http://linux121:19888/jobhistory

HIVE启动:

先启动dfs,yarn服务

启动 metastore 服务 linux121,123

nohup hive —service metastore &

然后:

linux123上启动hive

输入:hive即可进入命令行

启动 metastore 服务 linux121,123

nohup hive —service metastore &

HiveServer2

服务端接口,远程访问hive的查询并返回结果(beenline)

# 启动 hiveserver2 服务 linux123

nohup hiveserver2 &

# 验证

http://linux123:10002/

远程连接hive,不用启动hive默认命令行窗口,无法关闭

#启动 linux122 节点上的 beeline

输入:beenlien进入命令行

!connect jdbc:hive2://linux123:10000

username: hive

password:12345678

!connect jdbc:mysql://linux123:3306

HUE启动:

在hue的安装目录下linux122

/opt/lagou/servers/hue/build/env/bin/supervisor

浏览器访问:linux122:8000

hue:12345678

Impala的启动流程:

nohup hive —service metastore &

- 启动hiveserver2服务 linux123

nohup hive —service hiveserver2 &

- 启动impala

linux123启动如下⻆角⾊色

service impala-state-store start

service impala-catalog start

service impala-server start

#其余节点启动如下⻆角⾊色

service impala-server start

zookeeper启动:

linux121启动:

sh /root/shells/zk.sh start

sh /root/shells/zk.sh stop

sh /root/shells/zk.sh status

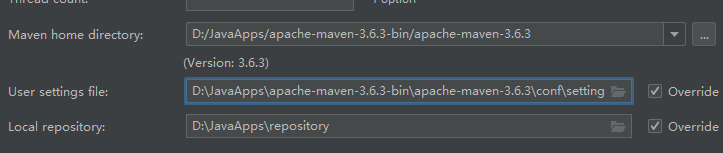

MAVEN配置:

HDFS-HA集群启动:

/opt/lagou/servers/ha/hadoop-2.9.2/sbin/start-dfs.sh

验证:

#active namenode:

linux121:50070

#standby namenode:

linux122:50070

YARN-HA集群启动:

启动linux123:

/opt/lagou/servers/ha/hadoop-2.9.2/sbin/start-yarn.sh

启动Linux122:

/opt/lagou/servers/ha/hadoop-2.9.2/sbin/yarn-daemon.sh start resourcemanager

验证:

linux123:8088

linux122:8088

Hbase启动:

前提条件:先启动hadoop(hdfs + yarn)和zk集群

#启动:

/opt/lagou/servers/hbase-1.3.1/bin/start-hbase.sh

#验证

linux121:16010

linux122:16010

Spark启动:

前题:启动HDFS,默认是集群模式,需要使用HDFS存储

linux121:

#启动:

$SPARK_HOME/sbin/start-all.sh

或者直接任意路径下(已经解决和hadoop的start-all-hadoop.sh文件冲突):

start-all.sh

#停止

$SPARK_HOME/sbin/stop-all.sh

#验证

http://linux121:8080/

日志服务器:

前提:启动HDFS,要写到HDFS上去。

$SPARK_HOME/sbin/start-history-server.sh

#验证

http://linux121:18080/

高可用HA:引进zookeeper实现(待定,学习阶段用不到)

Redis:

linux123主机:默认端口6379

进入到cd /opt/lagou/servers/redis/bin/

后台启动:

./redis-server redis.conf

关闭:

./redis-cli shutdown

redis-server :启动 redis 服务

redis-cli :进入 redis 命令客户端

redis-benchmark : 性能测试的工具

redis-check-aof : aof 文件进行检查的工具

redis-check-dump : rdb 文件进行检查的工具

redis-sentinel : 启动哨兵监控服务