一、简介

Stable Diffusion是一个基于深度学习的文本生成图像模型, 其本质是扩散模型(Diffusion模型)的变体。通过使用提示词(Prompt)来产生新的图像,描述要包含或省略的元素,以及重新绘制现有的图像,其中包含提示词中描述的新元素。

它的主要功能包含了文本生成图像和图像生成图像。在文生图中通过输入提示词,图像尺寸、种子等各项参数来生成对应的图片,而图生图通过提示词、现有的图片,在原始图像的基础上产生一个新的图像。

二、Stable Diffusion背景介绍

1. Stable Diffusion 是如何诞生的

下面,我再为大家介绍下 Stable Diffusion 的发展历程,有助于你更深层次的了解这款 AI 绘画工具。

如今提到 Stable Diffusion,就不得不提 Stability AI,这家独角兽公司在去年以十亿美元的估值一跃成为这过去半年中 AIGC 行业的黑马。但其实 Stable Diffusion 并不是由 Stability 独立研发,而是 Stability AI 和 CompVis、Runway 等团队合作开发的。

在去年上半年 AI 绘画还没开始被大家熟知的时候,来自慕尼黑大学的机器学习研究小组 CompVis 和纽约的 Runway 团队合作研发了一款高分辨率图像合成模型,该模型具有生成速度快、对计算资源和内存消耗需求小等优点,而这就是我们前面提到的 Latent Diffusion 模型。

大家都知道,训练模型需要高昂的计算成本和资源要求,Latent Diffusion 模型也不例外。而当时的 Stability 恰巧也在寻找 AI 领域发展的机会,于是便向手头拮据的研究团队递出了橄榄枝,提出愿意为其提供研发资源的支持。在确定合作意向后,Stability 才开始正式加入到后续 Stable Diffusion 模型的研发过程中。

随后到了 7 月底,训练后的新模型以 Stable Diffusion 的名号正式亮相,现在大家知道 Stable 这个词其实是源于其背后的赞助公司 Stability。相较于 Latent Diffusion 模型,改进后的 Stable Diffusion 采用了更多的数据来训练模型,用于训练的图像尺寸也更大,包括文本编码也采用了更好的 CLIP 编码器。在实际应用上来说,Stable Diffusion 生成模型会更加准确,且支持的图像分辨率也更高,比单一的 Latent Diffusion 模型更加强大。

在 Discord 上进行短期内测后,Stable Diffusion 于 8 月 22 日正式开源。后面的事情大家都知道了,就在推出的短短几天后,Stability 拿到了 1 亿美元的融资,让这家年轻企业直接获得了约 10 亿美元的估值,可谓是名利双收。

虽然 Stability AI 通过 Stable Diffusion 这款开源模型享誉世界,但它背后其实暗藏着让人诟病的商业行为。就在 6 月初,福布斯发布了一条关于 Stability 创始人夸大 Stable Diffusion 成就的新闻,其中罗列了窃取 Stable Diffusion 研究成果、学历造假、拖欠工资等 9 大罪证,如果对其感兴趣的朋友可以去看看原文:

福布斯报道原文:https://www.forbes.com/sites

2. 从开源到百花齐放

对于 Stability 的商业行为我们不做过多点评,但他们在开源这条路上确实践行的很好,正如他们官网首页所说:AI by the people, for the people—AI取之于民,用之于民。

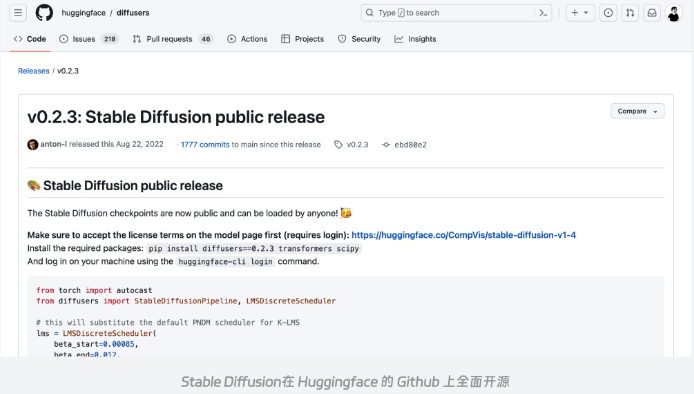

起初,Stable Diffusion 和 Midjourney 一样先是在 Discord 上进行了小范围的免费公测。随后在 22 年的 8 月 22 日,关于 Stable Diffusion 的代码、模型和权重参数库在 Huggingface 的 Github 上全面开源,至此所有人都可以在本地部署并免费运行 Stable Diffusion。

最早在 Github 上开源的代码地址:https://github.com/huggingface/diffusers/releases/tag/v0.2.3

有朋友可能对开源这个词比较陌生,这里简单介绍下:开源指的是开放源代码,即所有用户都可以自由学习、修改以及传播该软件的代码信息,并且不用支付任何费用。举个不太恰当的比喻,就像是一家餐厅把自己辛苦研究的秘制菜谱向全社会公布,任何人都可以拿去自由使用,不管是自己制作品尝,还是由此开一家新餐厅都可以。但这里有个问题,并不是每个人都是厨师,更不用说做这种需要繁琐环境部署和基础设施搭建的“秘制菜”。

开源后的 Stable Diffusion 文件,起初只是一串你我这样小白都看不懂的源代码,更不用说上手体验。但伴随着越来越多开发者的介入,Stable Diffusion 的上手门槛逐渐降低,开始走向群众视野,它的生态圈逐渐发展为商业和社区 2 个方向。

一方面,海量的中小研发团队发现了商机,将其封装为商业化的套壳应用来进行创收,有的是 APP 网站等程序,有的是内嵌在自家产品中的特效和滤镜。根据 Stable Diffusion 官网统计的数据,在 Stable Diffusion 2.0 发布一个月后,苹果应用商店排名前十的 App 中就有四款是基于 Stable Diffusion 开发的 AI 绘画应用。

这些应用在很大程度上都进行了简化和设计,即使是小白用户也可以快速上手,当然缺点就是基本都要付费才能使用,而且很难针对个人做到功能定制化。

另一方面,开源的 Stable Diffusion 社区受到了广泛民间开发者大力支持,众多为爱发电的程序员自告奋勇的为其制作方便操控的 GUI 图形化界面(Graphical User Interface)。其中流传最广也是被公认最为方便的,就是由越南超人 AUTOMATIC1111 (下文统一用 A41 代称)开发的 WebUI,而这正是前面提到的 Stable Diffusion WebUI,后面的教程内容都是基于该程序展开的。

它集成了大量代码层面的繁琐应用,将 Stable Diffusion 的各项绘图参数转化成可视化的选项数值和操控按钮。如今各类开源社区里 90%以上的拓展应用都是基于它而研发的。

当然,除了 WebUI 还有一些其他的 GUI 应用,比如 Comfy UI 和 Vlad Diffusion 等,不过它们的应用场景更为专业和小众,感兴趣的可以点击下面的 GitHub 链接了解,这里就不再赘述了。

Comfy UI 地址: https://github.com/comfyanonymous/ComfyUI

Vlad Diffusion 地址: https://github.com/pulipulichen/

四、Stable Diffusion 的特点

看到这里,你已经了解了 Stable Diffusion 的发展背景和生态环境,那它和其他 AI 绘画工具相比到底有哪些优势呢?

目前,市面上绝大多数商业级 AI 绘画应用都是采用开源的 Stable Diffusion 作为研发基础,当然也有一些其他被大众熟知的 AI 绘画工具,比如最受欢迎的 Midjourney 和 OpenAI 公司发布的 DALL·E2。但不可否认的是,开源后的 Stable Diffusion 在实际应用上相较其他 AI 绘画工具存在巨大优势:

1. 可拓展性强

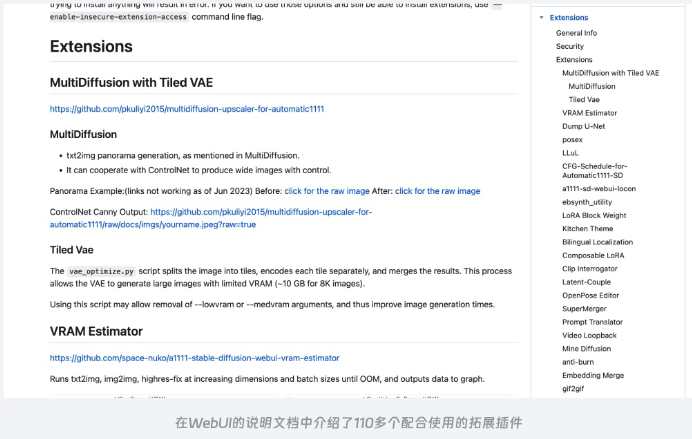

首先最关键的一点就是极其丰富的拓展性。得益于官方免费公开的论文和模型代码,任何人都可以使用它来进行学习和创作且不用支付任何费用。光是在 A41 WebUI 的说明文档中,目前就已经集成了 110 多个扩展插件的功能介绍。

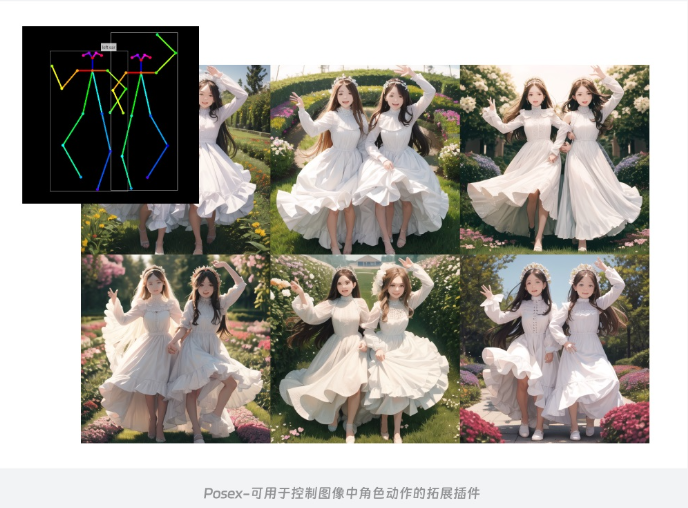

从局部重绘到人物姿势控制,从图像高清修复和到线稿提取,如今的 Stable Diffusion 社区中有大量不断迭代优化的图像调整插件以及免费分享的模型可以使用。而对于专业团队来说,即使社区里没有自己满意的,也可以通过自行训练来定制专属的绘图模型。

在 Midjourney 等其他商用绘画应用中,无法精准控图和图像分辨率低等问题都是其普遍痛点,但这些在 Stable Diffusion 中通过 ControlNet 和 UpScale 等插件都能完美解决。如果单从工业化应用角度考虑,如今的 Stable Diffusion 在 AI 绘画领域毫无疑问是首选工具。

2. 出图效率高

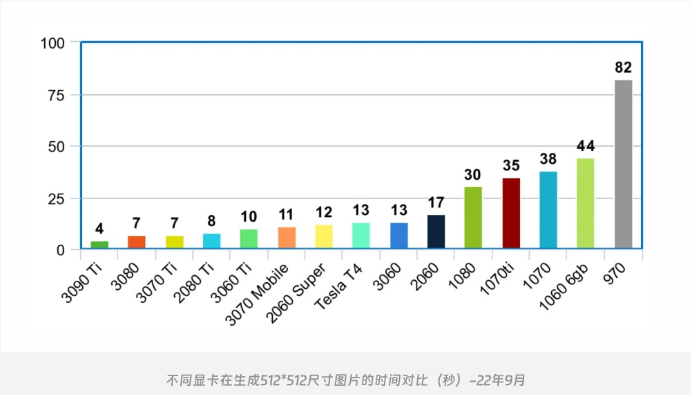

其次是其高效的出图模式。使用过 Midjourney 的朋友应该都有体验过排队等了几分钟才出一张图的情况,而要得到一张合适的目标图我们往往需要试验多次才能得到,这个试错成本就被进一步拉长。其主要原因还是由于商业级的 AI 应用都是通过访问云服务器进行操作,除了排队等候服务器响应外,网络延迟和资源过载都会导致绘图效率的降低。

而部署在本地的 Stable Diffusion 绘图效率完全由硬件设备决定,只要显卡算力跟得上,甚至能够实现 3s 一张的超高出图效率。

3. 数据安全保障

同样是因为部署在本地,Stable Diffusion 在数据安全性上是其他在线绘画工具无法比拟的。商业化的绘画应用为了运营和丰富数据,会主动将用户的绘图结果作为案例进行传播。但 Stable Diffusion 所有的绘图过程完全在本地进行,基本不用担心信息泄漏的情况。

总结来说,Stable Diffusion 是一款图像生产+调控的集合工具,通过调用各类模型和插件工具,可以实现更加精准的商业出图,加上数据安全性和可扩展性强等优点,Stable Diffusion 非常适合 AI 绘图进阶用户和专业团队使用。

而对于具备极客精神的 AI 绘画爱好者来说,使用 Stable Diffusion 过程中可以学到很多关于模型技术的知识,理解了 Stable Diffusion 等于就掌握了 AI 绘画的精髓,可以更好的向下兼容其他任意一款低门槛的绘画工具。

在下一章节中,我会讲到如何安装部署和使用Stable Diffusion。如果你有更多关于Stable Diffusion的例子,非常欢迎你加入我们,与我们共同优化这一课程。

如果你对Stable Diffusion感兴趣或者想深入的了解AI绘画,请加入我们的俱乐部!和1000+AIGC研究员一起探讨交流!学习分享!

:::warning AIGC研究社俱乐部周边🌈

工具站(资源导航工具):www.aigcyjs.com

帕克的博客(AI黑科技分享):blog.aigcyjs.com

:::