https://www.cnblogs.com/mantch/p/11433829.html

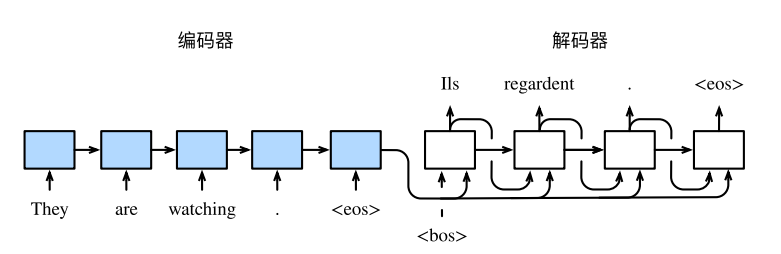

编码器和解码器分析

https://blog.csdn.net/qq_38890412/article/details/120664674?utm_medium=distribute.pc_relevant.none-task-blog-2~default~baidujs_title~default-0.pc_relevant_aa&spm=1001.2101.3001.4242.1&utm_relevant_index=3

decoder有训练过程和预测过程是不一样的

下面是预测过程!

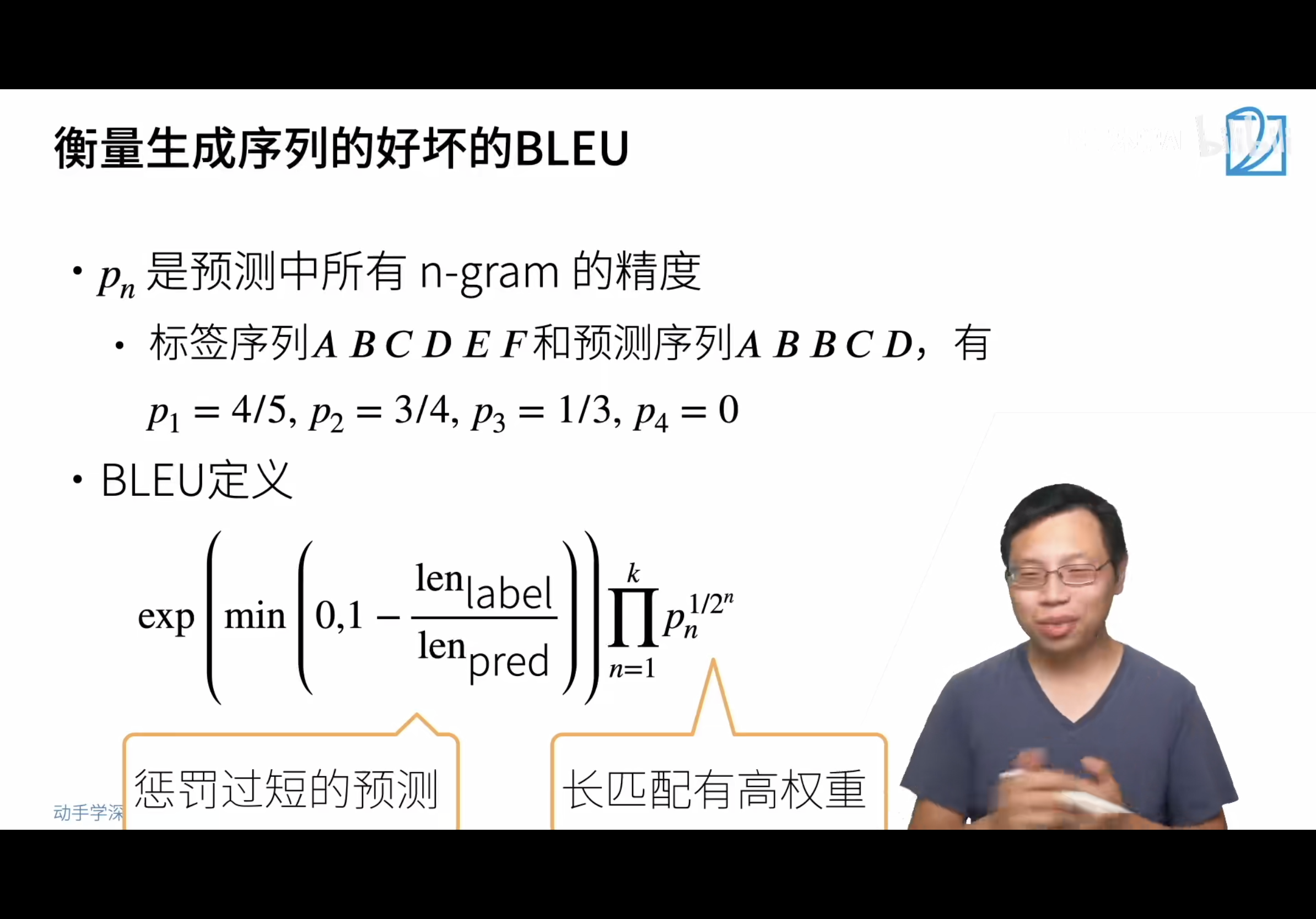

理论:

最早用来做机器翻译

BLEU越大精度越好,最大为一。

代码实现: