假设回归问题中,过拟合的模型如下:

我们可以看出,正是那些高次项导致了过拟合的产生,所以降低高次项的系数,我们就能降低过拟合程度。但是,我们不能直接修改模型中的参数大小,而通过修改代价函数中参数大小来实现“曲线救国”

正常回归问题的损失函数如下:

对损失函数做梯度下降算法,如下:

可见,每次迭代中,为了使迭代后的参数变更小,我们需要使

尽可能大,而学习率固定,所以我们只能想办法让导数项尽可能大。所以我们可以对损失/代价函数

做一波修改:

可见,我们给参数和

加上了系数,这可以称为【惩罚】,对修改后的代价函数,做梯度下降算法

对的更新如下:

对的更新如下:

可见,对于参数和

,因为有系数的存在,每次求导都会让其降低的更多更快,而且,不会影响其他参数项的下降,从而达到比较理想的效果。

假如我们有非常多的特征,我们并不知道其中哪些特征我们要惩罚,我们将对所有的特征进行惩罚,并且让代价函数最优化的软件来选择这些惩罚的程度。这样的结果是得到了一个较为简单的能防止过拟合问题的假设:

1.一般表示

如果我们有 总计n个参数(通常

不用惩罚),通常会对所有的参数进行惩罚,并设置系数

,这样的结果是得到了一个较为简单的能防止过拟合问题的假设函数:

其中被称为正则化参数Regularization Parameter

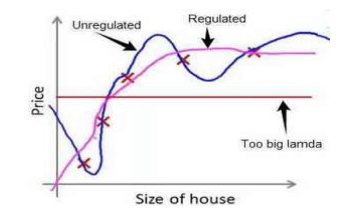

经过正则化处理后的模型与原模型对比图如下:

蓝色是处理前,过拟合的模型数据表现,粉红色的是经过正则化处理后的表现。

如果正则化系数过小,将会导致效果不好,模型的拟合度依旧很高;

如果正则化系数过大,则会将除了

以外的所有系数都惩罚殆尽,导致假设函数近似:

即变成图中的红线。