1. 什么是梯度下降

梯度下降是一个用来求函数最小值的算法,我们将使用梯度下降算法来求出代价函数的最小值。

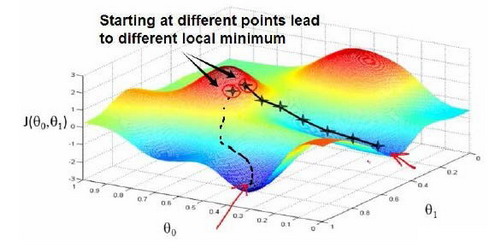

梯度下降背后的思想是:开始时我们随机选择一个参数的组合,计算代价函数,然后我们寻找下一个能让代价函数值下降最多的参数组合。我们持续这么做直到到到一个局部最小值(local minimum),因为我们并没有尝试完所有的参数组合,所以不能确定我们得到的局部最小值是否便是全局最小值(global minimum),选择不同的初始参数组合,可能会找到不同的局部最小值。

2. 梯度下降算法的定义

2.1 公式

批量梯度下降(batch gradient descent)算法的公式为: for( j = 0 and j = 1)

2.1.1 参数解释

1.公式中为什么是-,因为用于表示梯度下降,即逐渐降低,故用负号表示

2.公式中用的是 := 符号,此含义表示,等式中的参数需要同时更新

如此处有两个参数,正确的更新方式是:

第一步:

第二步:

其中第一步完成后才能进行第二步,且在每一步执行时,内部求temp1、temp2时也是并行的关系

其中是学习率(learning rate),它决定了我们沿着能让代价函数下降程度最大的方向向下迈出的步子有多大,在批量梯度下降中,我们每一次都同时让所有的参数减去学习速率乘以代价函数的导数。

在梯度下降算法中,要同时更新参数,下图的更新方式是不对的

至于为什么要同步更新,是因为在大量的研究过程中证明了同步更新的效果更好。所以提到梯度下降,就是指的同步更新参数。

2.2 学习率

批量梯度下降公式中, 为学习率(learning rate)它决定了我们沿着能让代价函数下降程度最大的方向向下迈出的步子有多大,在批量梯度下降中,我们每一次都同时让所有的参数减去学习速率乘以代价函数的导数

2.2.1 学习率过小

如果太小了,即我的学习速率太小,结果就是只能这样像小宝宝一样一点点地挪动,去努力接近最低点,这样就需要很多步才能到达最低点。所以,如果

太小的话可能会很慢,因为它会一点点挪动,它会需要很多步才能到达全局最低点。

2.2.2 学习率过大

如果太大,那么梯度下降法可能会越过最低点,甚至可能无法收敛,下一次迭代又移动了一大步,越过一次,又越过一次,一次次越过最低点,直到你发现实际上离最低点越来越远。所以,如果

太大,它会导致无法收敛,甚至发散。

2.3 直观表示

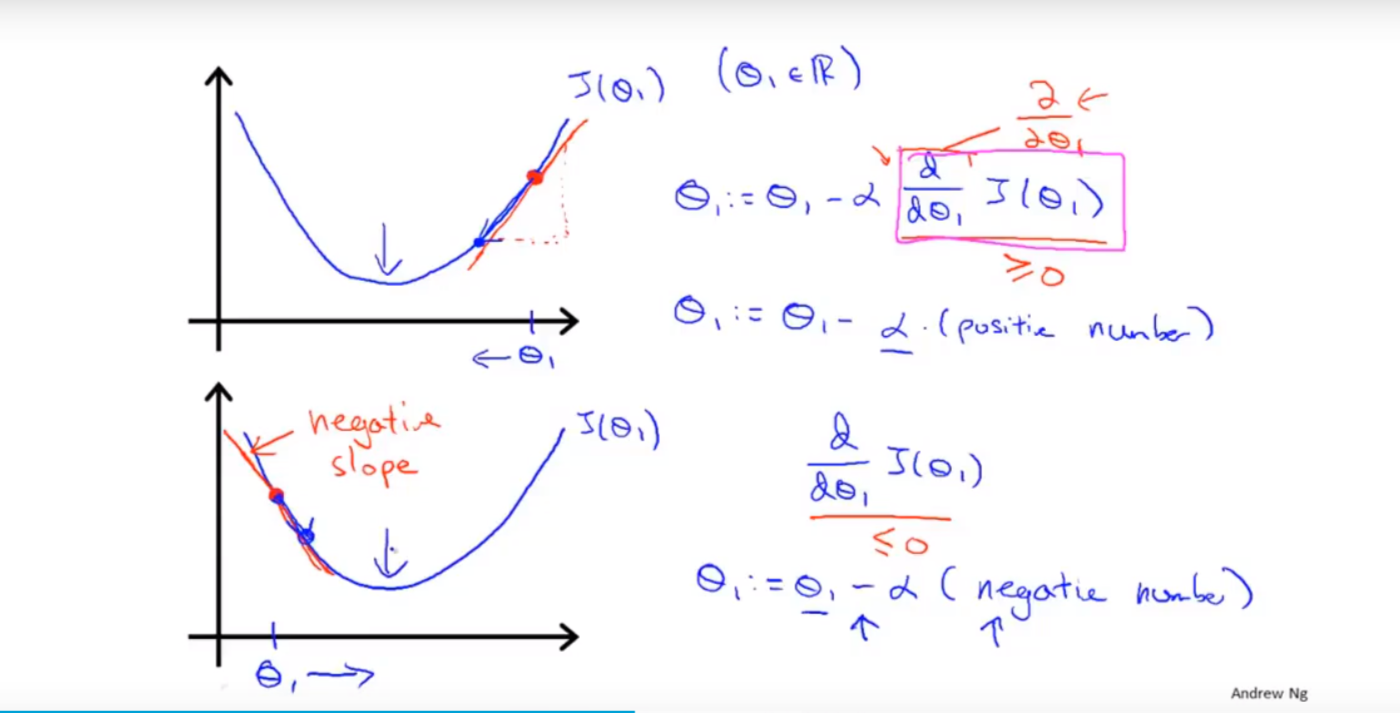

图上图所示,对 赋值,使得按梯度下降最快方向进行,一直迭代下去,最终得到局部最小值。其中

是学习率(learning rate),它决定了我们沿着能让代价函数下降程度最大的方向向下迈出的步子有多大。

如图,当位于最低点左侧时,导数为负数,通过梯度下降公式,

会迭代增大。

如图,当位于最低点右侧时,导数为正数,通过梯度下降公式,

会迭代减小。

如果学习速率太小,结果就是只能这样像小宝宝一样一点点地挪动,去努力接近最低点,这样就需要很多步才能到达最低点,所以如果太小的话,可能会很慢,因为它会一点点挪动,它会需要很多步才能到达全局最低点。

如果太大,那么梯度下降法可能会越过最低点,甚至可能无法收敛,下一次迭代又移动了一大步,越过一次,又越过一次,一次次越过最低点,直到你发现实际上离最低点越来越远,所以,如果太大,它会导致无法收敛,甚至发散。

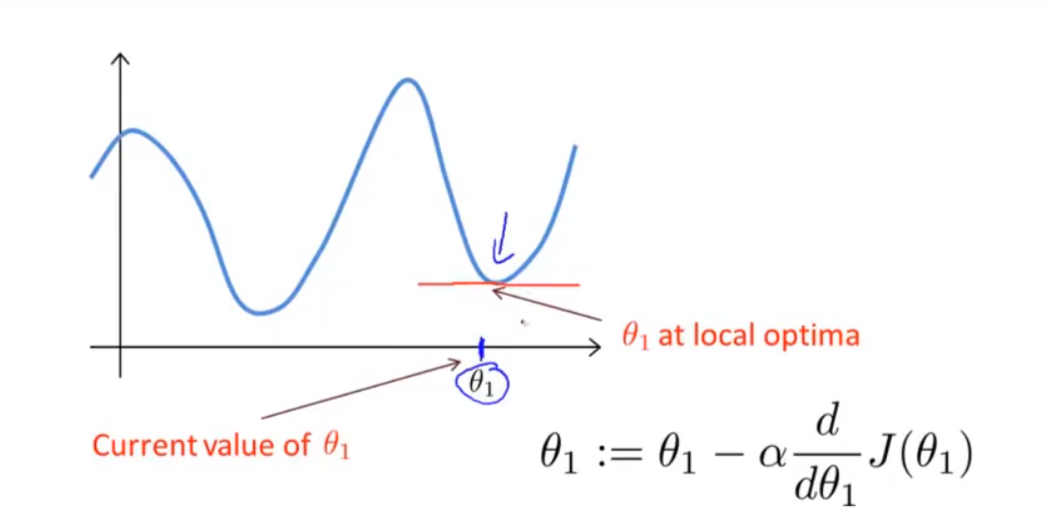

如上图所示,假设将 初始化在局部最低点,在这儿,它已经在一个局部的最优处或局部最低点。结果是局部最优点的导数将等于零,因为它是那条切线的斜率。这意味着你已经在局部最优点,它使得不再改变,也就是新的等于原来的

,因此,如果参数已经处于局部最低点,那么梯度下降法更新其实什么都没做,它不会改变参数的值。这也解释了为什么即使学习速率保持不变时,梯度下降也可以收敛到局部最低点。

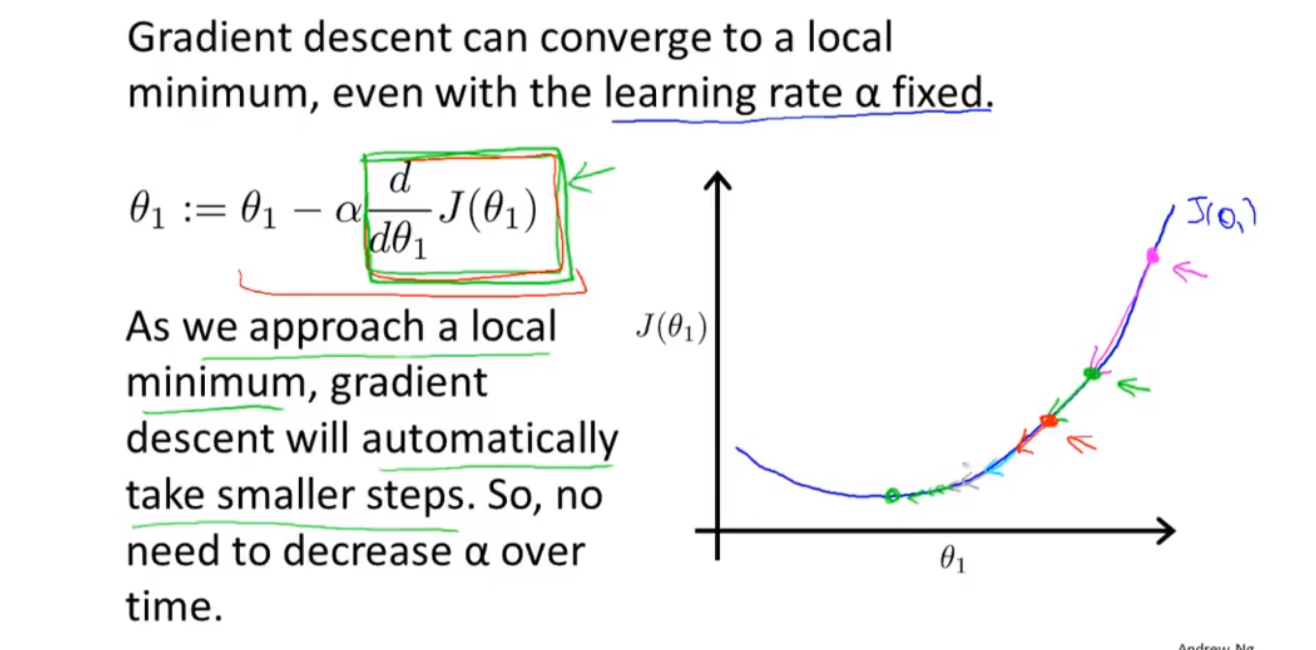

如上图所示,我想找到它的最小值,首先初始化梯度下降算法,在那个品红色的点初始化,如果我更新一步梯度下降,也许它会带我到这个点,因为这个点的导数是相当陡的。现在,在这个绿色的点,如果我再更新一步,你会发现我的导数,也即斜率,是没那么陡的。随着我接近最低点,我的导数越来越接近零,所以,梯度下降一步后,新的导数会变小一点点。然后我想再梯度下降一步,在这个绿点,我自然会用一个稍微跟刚才在那个品红点时比,再小一点的一步,到了新的红色点,更接近全局最低点了,因此这点的导数会比在绿点时更小。所以,我再进行一步梯度下降时,我的导数项是更小的,更新的幅度就会更小。所以随着梯度下降法的运行,你移动的幅度会自动变得越来越小,直到最终移动幅度非常小,你会发现,已经收敛到局部极小值。

因此在梯度下降法中,当接近局部最低点时,梯度下降法会自动采取更小的幅度,这是因为接近局部最低点时,很显然在局部最低时导数等于零,所以当接近局部最低时,导数值会自动变得越来越小,所以梯度下降将自动采取较小的幅度,这就是梯度下降的做法。

这就是梯度下降算法,你可以用它来最小化任何代价函数,不只是线性回归中的代价函数。