网络爬虫

第一天

1 课程计划

- 入门程序

- 网络爬虫介绍

- HttpClient抓取数据

- Jsoup解析数据

- 爬虫案例

2 网络爬虫

网络爬虫(Web crawler),是一种按照一定的规则,自动地抓取万维网信息的程序或者脚本

2.1 爬虫入门程序

2.1.1 环境准备

- JDK1.8

- IntelliJ IDEA

- IDEA自带的Maven

2.1.2 环境准备

创建Maven工程itcast-crawler-first并给pom.xml加入依赖

<!-- 日志 --><br /> <dependency><br /> <groupId>org.slf4j</groupId><br /> <artifactId>slf4j-log4j12</artifactId><br /> <version>1.7.25</version><br /> </dependency><br /></dependencies>

2.1.3 加入log4j.properties

log4j.rootLogger=DEBUG,A1log4j.logger.cn.itcast = DEBUG

log4j.appender.A1=org.apache.log4j.ConsoleAppenderlog4j.appender.A1.layout=org.apache.log4j.PatternLayoutlog4j.appender.A1.layout.ConversionPattern=%-d{yyyy-MM-dd HH:mm:ss,SSS} [%t] [%c]-[%p] %m%n

2.1.4 编写代码

编写最简单的爬虫,抓取传智播客首页:http://www.itcast.cn/

public static void main(String[] args) throws Exception {

CloseableHttpClient httpClient = HttpClients.createDefault();

HttpGet httpGet = new HttpGet("http://www.itcast.cn/");CloseableHttpResponse response = httpClient.execute(httpGet);if (response.getStatusLine().getStatusCode() == 200) {<br /> String content = EntityUtils._toString_(response.getEntity(), "UTF-8");<br /> System._out_.println(content);<br /> }<br />}

测试结果:可以获取到页面数据

3 网络爬虫

3.1 网络爬虫介绍

在大数据时代,信息的采集是一项重要的工作,而互联网中的数据是海量的,如果单纯靠人力进行信息采集,不仅低效繁琐,搜集的成本也会提高。如何自动高效地获取互联网中我们感兴趣的信息并为我们所用是一个重要的问题,而爬虫技术就是为了解决这些问题而生的。

网络爬虫(Web crawler)也叫做网络机器人,可以代替人们自动地在互联网中进行数据信息的采集与整理。它是一种按照一定的规则,自动地抓取万维网信息的程序或者脚本,可以自动采集所有其能够访问到的页面内容,以获取相关数据。

从功能上来讲,爬虫一般分为数据采集,处理,储存三个部分。爬虫从一个或若干初始网页的URL开始,获得初始网页上的URL,在抓取网页的过程中,不断从当前页面上抽取新的URL放入队列,直到满足系统的一定停止条件。

3.2 为什么学网络爬虫

我们初步认识了网络爬虫,但是为什么要学习网络爬虫呢?只有清晰地知道我们的学习目的,才能够更好地学习这一项知识。在此,总结了4种常见的学习爬虫的原因:

1. 可以实现搜索引擎

我们学会了爬虫编写之后,就可以利用爬虫自动地采集互联网中的信息,采集回来后进行相应的存储或处理,在需要检索某些信息的时候,只需在采集回来的信息中进行检索,即实现了私人的搜索引擎。

1. 大数据时代,可以让我们获取更多的数据源。

在进行大数据分析或者进行数据挖掘的时候,需要有数据源进行分析。我们可以从某些提供数据统计的网站获得,也可以从某些文献或内部资料中获得,但是这些获得数据的方式,有时很难满足我们对数据的需求,而手动从互联网中去寻找这些数据,则耗费的精力过大。此时就可以利用爬虫技术,自动地从互联网中获取我们感兴趣的数据内容,并将这些数据内容爬取回来,作为我们的数据源,再进行更深层次的数据分析,并获得更多有价值的信息。

1. 可以更好地进行搜索引擎优化(SEO)。

对于很多SEO从业者来说,为了更好的完成工作,那么就必须要对搜索引擎的工作原理非常清楚,同时也需要掌握搜索引擎爬虫的工作原理。

而学习爬虫,可以更深层次地理解搜索引擎爬虫的工作原理,这样在进行搜索引擎优化时,才能知己知彼,百战不殆。

1. 有利于就业。

从就业来说,爬虫工程师方向是不错的选择之一,因为目前爬虫工程师的需求越来越大,而能够胜任这方面岗位的人员较少,所以属于一个比较紧缺的职业方向,并且随着大数据时代和人工智能的来临,爬虫技术的应用将越来越广泛,在未来会拥有很好的发展空间。

4 HttpClient

网络爬虫就是用程序帮助我们访问网络上的资源,我们一直以来都是使用HTTP协议访问互联网的网页,网络爬虫需要编写程序,在这里使用同样的HTTP协议访问网页。

这里我们使用Java的HTTP协议客户端 HttpClient这个技术,来实现抓取网页数据。

4.1 GET请求

访问传智官网,请求url地址:

http://www.itcast.cn/

public static void main(String[] args) throws IOException {

//创建HttpClient对象

CloseableHttpClient httpClient = HttpClients.createDefault();

//创建HttpGet请求<br /> HttpGet httpGet = new HttpGet("http://www.itcast.cn/");CloseableHttpResponse response = null;<br /> try {<br /> //使用HttpClient发起请求<br /> response = httpClient.execute(httpGet);//判断响应状态码是否为200<br /> if (response.getStatusLine().getStatusCode() == 200) {<br /> //如果为200表示请求成功,获取返回数据<br /> String content = EntityUtils._toString_(response.getEntity(), "UTF-8");<br /> //打印数据长度<br /> System._out_.println(content);<br /> }} catch (Exception e) {<br /> e.printStackTrace();<br /> } finally {<br /> //释放连接<br /> if (response == null) {<br /> try {<br /> response.close();<br /> } catch (IOException e) {<br /> e.printStackTrace();<br /> }<br /> httpClient.close();<br /> }<br /> }<br />}

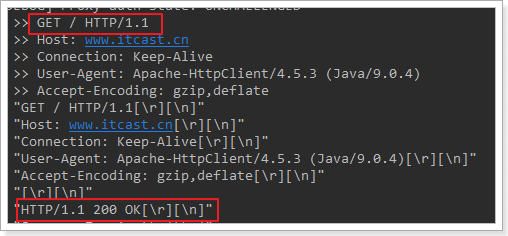

请求结果

4.2 带参数的GET请求

在传智中搜索学习视频,地址为:

http://yun.itheima.com/search?keys=Java

public static void main(String[] args) throws IOException {

//创建HttpClient对象

CloseableHttpClient httpClient = HttpClients.createDefault();

//创建HttpGet请求,带参数的地址[https://www.baidu.com/s?wd=HttpClient](https://www.baidu.com/s?wd=HttpClient)<br /> String uri = "http://yun.itheima.com/search?keys=Java";<br /> HttpGet httpGet = new HttpGet(uri);CloseableHttpResponse response = null;<br /> try {<br /> //使用HttpClient发起请求<br /> response = httpClient.execute(httpGet);//判断响应状态码是否为200<br /> if (response.getStatusLine().getStatusCode() == 200) {<br /> //如果为200表示请求成功,获取返回数据<br /> String content = EntityUtils._toString_(response.getEntity(), "UTF-8");<br /> //打印数据长度System._out_.println(content);<br /> }} catch (Exception e) {<br /> e.printStackTrace();<br /> } finally {<br /> //释放连接<br /> if (response == null) {<br /> try {<br /> response.close();<br /> } catch (IOException e) {<br /> e.printStackTrace();<br /> }<br /> httpClient.close();<br /> }<br /> }<br />}

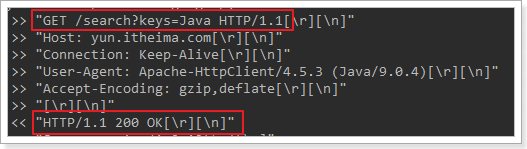

请求结果

4.3 POST请求

使用POST访问传智官网,请求url地址:

http://www.itcast.cn/

public static void main(String[] args) throws IOException {

//创建HttpClient对象

CloseableHttpClient httpClient = HttpClients.createDefault();

//创建HttpGet请求<br /> HttpPost httpPost = new HttpPost("http://www.itcast.cn/");CloseableHttpResponse response = null;<br /> try {<br /> //使用HttpClient发起请求<br /> response = httpClient.execute(httpPost);//判断响应状态码是否为200<br /> if (response.getStatusLine().getStatusCode() == 200) {<br /> //如果为200表示请求成功,获取返回数据<br /> String content = EntityUtils._toString_(response.getEntity(), "UTF-8");<br /> //打印数据长度<br /> System._out_.println(content);<br /> }} catch (Exception e) {<br /> e.printStackTrace();<br /> } finally {<br /> //释放连接<br /> if (response == null) {<br /> try {<br /> response.close();<br /> } catch (IOException e) {<br /> e.printStackTrace();<br /> }<br /> httpClient.close();<br /> }<br /> }<br />}

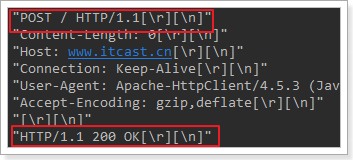

请求结果:

4.4 带参数的POST请求

在传智中搜索学习视频,使用POST请求,url地址为:

http://yun.itheima.com/search

url地址没有参数,参数keys=java放到表单中进行提交

public static void main(String[] args) throws IOException {

//创建HttpClient对象

CloseableHttpClient httpClient = HttpClients.createDefault();

//创建HttpGet请求<br /> HttpPost httpPost = new HttpPost("http://www.itcast.cn/");//声明存放参数的List集合<br /> List<NameValuePair> params = new ArrayList<NameValuePair>();<br /> params.add(new BasicNameValuePair("keys", "java"));//创建表单数据Entity<br /> UrlEncodedFormEntity formEntity = new UrlEncodedFormEntity(params, "UTF-8");//设置表单Entity到httpPost请求对象中<br /> httpPost.setEntity(formEntity);CloseableHttpResponse response = null;<br /> try {<br /> //使用HttpClient发起请求<br /> response = httpClient.execute(httpPost);//判断响应状态码是否为200<br /> if (response.getStatusLine().getStatusCode() == 200) {<br /> //如果为200表示请求成功,获取返回数据<br /> String content = EntityUtils._toString_(response.getEntity(), "UTF-8");<br /> //打印数据长度<br /> System._out_.println(content);<br /> }} catch (Exception e) {<br /> e.printStackTrace();<br /> } finally {<br /> //释放连接<br /> if (response == null) {<br /> try {<br /> response.close();<br /> } catch (IOException e) {<br /> e.printStackTrace();<br /> }<br /> httpClient.close();<br /> }<br /> }<br />}

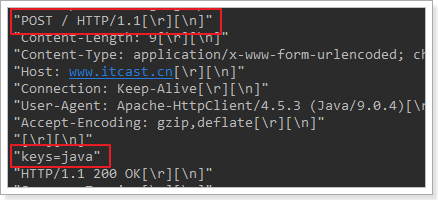

请求结果

4.5 连接池

如果每次请求都要创建HttpClient,会有频繁创建和销毁的问题,可以使用连接池来解决这个问题。

测试以下代码,并断点查看每次获取的HttpClient都是不一样的。

public static void main(String[] args) {

PoolingHttpClientConnectionManager cm = new PoolingHttpClientConnectionManager();

// 设置最大连接数<br /> cm.setMaxTotal(200);// 设置每个主机的并发数<br /> cm.setDefaultMaxPerRoute(20);_doGet_(cm);_doGet_(cm);<br />}<br />private static void doGet(PoolingHttpClientConnectionManager cm) {<br /> CloseableHttpClient httpClient = HttpClients._custom_().setConnectionManager(cm).build();HttpGet httpGet = new HttpGet("http://www.itcast.cn/");CloseableHttpResponse response = null;try {<br /> response = httpClient.execute(httpGet);// 判断状态码是否是200<br /> if (response.getStatusLine().getStatusCode() == 200) {<br /> // 解析数据<br /> String content = EntityUtils._toString_(response.getEntity(), "UTF-8");<br /> System._out_.println(content.length());<br /> }} catch (Exception e) {<br /> e.printStackTrace();<br /> } finally {<br /> //释放连接<br /> if (response == null) {<br /> try {<br /> response.close();<br /> } catch (IOException e) {<br /> e.printStackTrace();<br /> }<br /> //不能关闭HttpClient<br /> //httpClient.close();<br /> }<br /> }<br />}

4.6 请求参数

有时候因为网络,或者目标服务器的原因,请求需要更长的时间才能完成,我们需要自定义相关时间

public static void main(String[] args) throws IOException {

//创建HttpClient对象

CloseableHttpClient httpClient = HttpClients.createDefault();

//创建HttpGet请求<br /> HttpGet httpGet = new HttpGet("http://www.itcast.cn/");//设置请求参数<br /> RequestConfig requestConfig = RequestConfig._custom_() .setConnectTimeout(1000)//设置创建连接的最长时间<br /> .setConnectionRequestTimeout(500)//设置获取连接的最长时间<br /> .setSocketTimeout(10 * 1000)//设置数据传输的最长时间<br /> .build();<br /> httpGet.setConfig(requestConfig);CloseableHttpResponse response = null;<br /> try {<br /> //使用HttpClient发起请求<br /> response = httpClient.execute(httpGet);//判断响应状态码是否为200<br /> if (response.getStatusLine().getStatusCode() == 200) {<br /> //如果为200表示请求成功,获取返回数据<br /> String content = EntityUtils._toString_(response.getEntity(), "UTF-8");<br /> //打印数据长度<br /> System._out_.println(content);<br /> }} catch (Exception e) {<br /> e.printStackTrace();<br /> } finally {<br /> //释放连接<br /> if (response == null) {<br /> try {<br /> response.close();<br /> } catch (IOException e) {<br /> e.printStackTrace();<br /> }<br /> httpClient.close();<br /> }<br /> }<br />}

5 Jsoup

我们抓取到页面之后,还需要对页面进行解析。可以使用字符串处理工具解析页面,也可以使用正则表达式,但是这些方法都会带来很大的开发成本,所以我们需要使用一款专门解析html页面的技术。

5.1 jsoup介绍

jsoup 是一款Java 的HTML解析器,可直接解析某个URL地址、HTML文本内容。它提供了一套非常省力的API,可通过DOM,CSS以及类似于jQuery的操作方法来取出和操作数据。

jsoup的主要功能如下:

从一个URL,文件或字符串中解析HTML;

使用DOM或CSS选择器来查找、取出数据;

可操作HTML元素、属性、文本;

先加入Jsoup依赖:

5.2 jsoup解析

5.2.1 解析url

Jsoup可以直接输入url,它会发起请求并获取数据,封装为Document对象

@Testpublic void testJsoupUrl() throws Exception {

// 解析url地址

Document document = Jsoup.parse(new URL(“http://www.itcast.cn/“), 1000);

//获取title的内容<br /> Element title = document.getElementsByTag("title").first();<br /> System._out_.println(title.text());}

PS:虽然使用Jsoup可以替代HttpClient直接发起请求解析数据,但是往往不会这样用,因为实际的开发过程中,需要使用到多线程,连接池,代理等等方式,而jsoup对这些的支持并不是很好,所以我们一般把jsoup仅仅作为Html解析工具使用

5.2.2 解析字符串

先准备以下html文件

北京中心 |

|---|

Jsoup可以直接输入字符串,并封装为Document对象

@Testpublic void testJsoupString() throws Exception {

//读取文件获取

String html = FileUtils.readFileToString(new File(“D:\jsoup.html”), “UTF-8”);

// 解析字符串<br /> Document document = Jsoup._parse_(html);//获取title的内容<br /> Element title = document.getElementsByTag("title").first();<br /> System._out_.println(title.text());<br />}

5.2.3 解析文件

Jsoup可以直接解析文件,并封装为Document对象

@Testpublic void testJsoupHtml() throws Exception {

// 解析文件

Document document = Jsoup.parse(new File(“D:\jsoup.html”),”UTF-8”);

//获取title的内容<br /> Element title = document.getElementsByTag("title").first();<br /> System._out_.println(title.text());}

5.2.4 使用dom方式遍历文档

元素获取

- 根据id查询元素getElementById

- 根据标签获取元素getElementsByTag

- 根据class获取元素getElementsByClass

- 根据属性获取元素getElementsByAttribute

//1. 根据id查询元素getElementByIdElement element = document.getElementById(“city_bj”);

//2. 根据标签获取元素getElementsByTagelement = document.getElementsByTag(“title”).first();

//3. 根据class获取元素getElementsByClasselement = document.getElementsByClass(“s_name”).last();

//4. 根据属性获取元素getElementsByAttributeelement = document.getElementsByAttribute(“abc”).first();element = document.getElementsByAttributeValue(“class”, “city_con”).first();

元素中获取数据

- 从元素中获取id

- 从元素中获取className

- 从元素中获取属性的值attr

- 从元素中获取所有属性attributes

- 从元素中获取文本内容text

//获取元素Element element = document.getElementById(“test”);

//1. 从元素中获取idString str = element.id();

//2. 从元素中获取classNamestr = element.className();

//3. 从元素中获取属性的值attrstr = element.attr(“id”);

//4. 从元素中获取所有属性attributesstr = element.attributes().toString();

//5. 从元素中获取文本内容textstr = element.text();

5.2.5 使用选择器语法查找元素

jsoup elements对象支持类似于CSS (或jquery)的选择器语法,来实现非常强大和灵活的查找功能。这个select 方法在Document, Element,或Elements对象中都可以使用。且是上下文相关的,因此可实现指定元素的过滤,或者链式选择访问。

Select方法将返回一个Elements集合,并提供一组方法来抽取和处理结果。

5.2.6 Selector选择器概述

tagname: 通过标签查找元素,比如:span

#id: 通过ID查找元素,比如:# city_bj

.class: 通过class名称查找元素,比如:.class_a

[attribute]: 利用属性查找元素,比如:[abc]

[attr=value]: 利用属性值来查找元素,比如:[class=s_name]

//tagname: 通过标签查找元素,比如:spanElements span = document.select(“span”);

for (Element element : span) {

System.out.println(element.text());}

//#id: 通过ID查找元素,比如:#city_bjjString str = document.select(“#city_bj”).text();

//.class: 通过class名称查找元素,比如:.class_astr = document.select(“.class_a”).text();

//[attribute]: 利用属性查找元素,比如:[abc]str = document.select(“[abc]”).text();

//[attr=value]: 利用属性值来查找元素,比如:[class=s_name]str = document.select(“[class=s_name]”).text();

5.2.7 Selector选择器组合使用

el#id: 元素+ID,比如: h3#city_bj

el.class: 元素+class,比如: li.class_a

el[attr]: 元素+属性名,比如: span[abc]

任意组合: 比如:span[abc].s_name

ancestor child: 查找某个元素下子元素,比如:.city_con li 查找”city_con”下的所有li

parent > child: 查找某个父元素下的直接子元素,比如:

.city_con > ul > li 查找city_con第一级(直接子元素)的ul,再找所有ul下的第一级li

parent > *: 查找某个父元素下所有直接子元素

//el#id: 元素+ID,比如: h3#city_bjString str = document.select(“h3#city_bj”).text();

//el.class: 元素+class,比如: li.class_astr = document.select(“li.class_a”).text();

//el[attr]: 元素+属性名,比如: span[abc]str = document.select(“span[abc]”).text();

//任意组合,比如:span[abc].s_namestr = document.select(“span[abc].s_name”).text();

//ancestor child: 查找某个元素下子元素,比如:.city_con li 查找”city_con”下的所有listr = document.select(“.city_con li”).text();

//parent > child: 查找某个父元素下的直接子元素,

//比如:.city_con > ul > li 查找city_con第一级(直接子元素)的ul,再找所有ul下的第一级listr = document.select(“.city_con > ul > li”).text();

//parent > 查找某个父元素下所有直接子元素.city_con > str = document.select(“.city_con > *”).text();

6 爬虫案例

学习了HttpClient和Jsoup,就掌握了如何抓取数据和如何解析数据,接下来,我们做一个小练习,把京东的手机数据抓取下来。

主要目的是HttpClient和Jsoup的学习。

6.1 需求分析

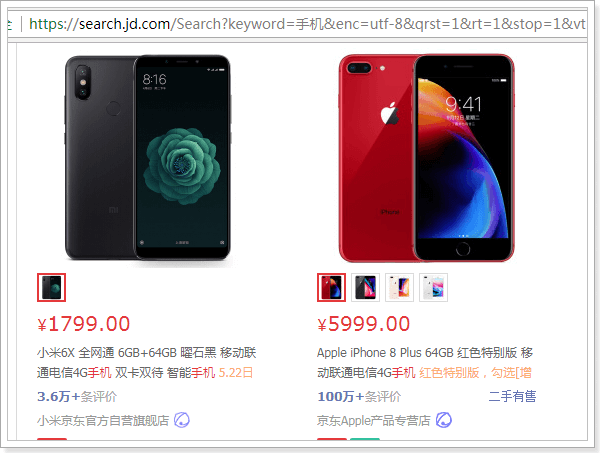

首先访问京东,搜索手机,分析页面,我们抓取以下商品数据:

商品图片、价格、标题、商品详情页

6.1.1 SPU和SKU

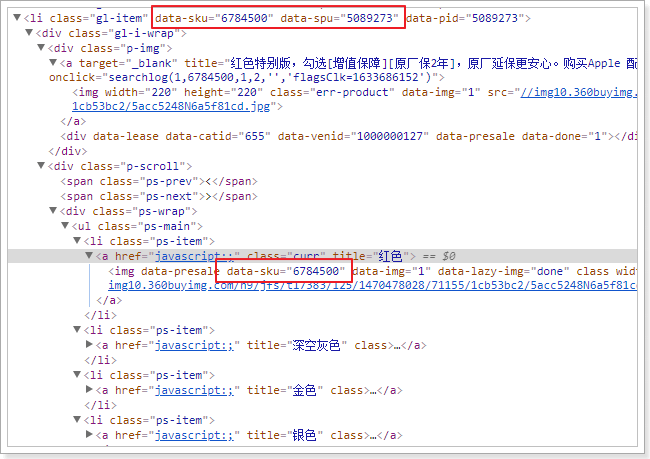

除了以上四个属性以外,我们发现上图中的苹果手机有四种产品,我们应该每一种都要抓取。那么这里就必须要了解spu和sku的概念

SPU = Standard Product Unit (标准产品单位)

SPU是商品信息聚合的最小单位,是一组可复用、易检索的标准化信息的集合,该集合描述了一个产品的特性。通俗点讲,属性值、特性相同的商品就可以称为一个SPU。

例如上图中的苹果手机就是SPU,包括红色、深灰色、金色、银色

SKU=stock keeping unit(库存量单位)

SKU即库存进出计量的单位, 可以是以件、盒、托盘等为单位。SKU是物理上不可分割的最小存货单元。在使用时要根据不同业态,不同管理模式来处理。在服装、鞋类商品中使用最多最普遍。

例如上图中的苹果手机有几个款式,红色苹果手机,就是一个sku

查看页面的源码也可以看出区别

6.2 开发准备

6.2.1 数据库表分析

根据需求分析,我们创建的表如下:

CREATE TABLE jd_item (

id bigint(10) NOT NULL AUTO_INCREMENT COMMENT ‘主键id’,

spu bigint(15) DEFAULT NULL COMMENT ‘商品集合id’,

sku bigint(15) DEFAULT NULL COMMENT ‘商品最小品类单元id’,

title varchar(100) DEFAULT NULL COMMENT ‘商品标题’,

price bigint(10) DEFAULT NULL COMMENT ‘商品价格’,

pic varchar(200) DEFAULT NULL COMMENT ‘商品图片’,

url varchar(200) DEFAULT NULL COMMENT ‘商品详情地址’,

created datetime DEFAULT NULL COMMENT ‘创建时间’,

updated datetime DEFAULT NULL COMMENT ‘更新时间’,

PRIMARY KEY (id),

KEY sku (sku) USING BTREE

) ENGINE=InnoDB AUTO_INCREMENT=1 DEFAULT CHARSET=utf8 COMMENT=’京东商品表’;

6.2.2 添加依赖

使用Spring Boot+Spring Data JPA和定时任务进行开发,

需要创建Maven工程并添加以下依赖

<?xml version=”1.0” encoding=”UTF-8”?>

xsi:schemaLocation=”http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd”>

<dependencies><br /> <!--SpringMVC--><br /> <dependency><br /> <groupId>org.springframework.boot</groupId><br /> <artifactId>spring-boot-starter-web</artifactId><br /> </dependency><!--SpringData Jpa--><br /> <dependency><br /> <groupId>org.springframework.boot</groupId><br /> <artifactId>spring-boot-starter-data-jpa</artifactId><br /> </dependency><!--MySQL连接包--><br /> <dependency><br /> <groupId>mysql</groupId><br /> <artifactId>mysql-connector-java</artifactId><br /> </dependency><!-- HttpClient --><br /> <dependency><br /> <groupId>org.apache.httpcomponents</groupId><br /> <artifactId>httpclient</artifactId><br /> </dependency><!--Jsoup--><br /> <dependency><br /> <groupId>org.jsoup</groupId><br /> <artifactId>jsoup</artifactId><br /> <version>1.10.3</version><br /> </dependency><!--工具包--><br /> <dependency><br /> <groupId>org.apache.commons</groupId><br /> <artifactId>commons-lang3</artifactId><br /> </dependency><br /> </dependencies><br /></project>

6.2.3 添加配置文件

加入application.properties配置文件

#DB Configuration:spring.datasource.driverClassName=com.mysql.jdbc.Driverspring.datasource.url=jdbc:mysql://127.0.0.1:3306/crawlerspring.datasource.username=rootspring.datasource.password=root

#JPA Configuration:spring.jpa.database=_MySQL_spring.jpa.show-sql=true

6.3 代码实现

6.3.1 编写pojo

根据数据库表,编写pojo

@Entity

@Table(name = “jditem”)public class Item {

//主键

@Id

@GeneratedValue(strategy = GenerationType._IDENTITY)

private Long id;

//标准产品单位(商品集合)

private Long spu;

//库存量单位(最小品类单元)

private Long sku;

//商品标题

private String title;

//商品价格

private Double price;

//商品图片

private String pic;

//商品详情地址

private String url;

//创建时间

private Date created;

//更新时间

private Date updated;

set/get

}

6.3.2 编写dao

public interface ItemDao extends JpaRepository

}

6.3.3 编写Service

ItemService接口

public interface ItemService {

//根据条件查询数据<br /> public List<Item> findAll(Item item);//保存数据<br /> public void save(Item item);}

ItemServiceImpl实现类

@Servicepublic class ItemServiceImpl implements ItemService {

@Autowired<br /> private ItemDao itemDao;@Override<br /> public List<Item> findAll(Item item) {<br /> Example example = Example._of_(item);<br /> List list = this.itemDao.findAll(example);<br /> return list;<br /> }@Override<br /> @Transactional<br /> public void save(Item item) {<br /> this.itemDao.save(item);<br /> }<br />}

6.3.4 编写引导类

@SpringBootApplication//设置开启定时任务@EnableSchedulingpublic class Application {

public static void main(String[] args) {<br /> SpringApplication._run_(Application.class, args);<br /> }<br />}

6.3.5 封装HttpClient

我们需要经常使用HttpClient,所以需要进行封装,方便使用

@Componentpublic class HttpUtils {

private PoolingHttpClientConnectionManager cm;public HttpUtils() {<br /> this.cm = new PoolingHttpClientConnectionManager();// 设置最大连接数<br /> cm.setMaxTotal(200);// 设置每个主机的并发数<br /> cm.setDefaultMaxPerRoute(20);<br /> }//获取内容<br /> public String getHtml(String url) {<br /> // 获取HttpClient对象<br /> CloseableHttpClient httpClient = HttpClients._custom_().setConnectionManager(cm).build();// 声明httpGet请求对象<br /> HttpGet httpGet = new HttpGet(url);<br /> // 设置请求参数RequestConfig<br /> httpGet.setConfig(this.getConfig());CloseableHttpResponse response = null;<br /> try {<br /> // 使用HttpClient发起请求,返回response<br /> response = httpClient.execute(httpGet);<br /> // 解析response返回数据<br /> if (response.getStatusLine().getStatusCode() == 200) {<br /> String html = "";// 如果response。getEntity获取的结果是空,在执行EntityUtils.toString会报错<br /> // 需要对Entity进行非空的判断<br /> if (response.getEntity() != null) {<br /> html = EntityUtils._toString_(response.getEntity(), "UTF-8");<br /> }return html;<br /> }} catch (Exception e) {<br /> e.printStackTrace();<br /> } finally {<br /> try {<br /> if (response != null) {<br /> // 关闭连接<br /> response.close();<br /> }<br /> // 不能关闭,现在使用的是连接管理器<br /> // httpClient.close();<br /> } catch (Exception e) {<br /> e.printStackTrace();<br /> }<br /> }return null;<br /> }//获取图片<br /> public String getImage(String url) {<br /> // 获取HttpClient对象<br /> CloseableHttpClient httpClient = HttpClients._custom_().setConnectionManager(cm).build();// 声明httpGet请求对象<br /> HttpGet httpGet = new HttpGet(url);<br /> // 设置请求参数RequestConfig<br /> httpGet.setConfig(this.getConfig());CloseableHttpResponse response = null;<br /> try {<br /> // 使用HttpClient发起请求,返回response<br /> response = httpClient.execute(httpGet);<br /> // 解析response下载图片<br /> if (response.getStatusLine().getStatusCode() == 200) {<br /> // 获取文件类型<br /> String extName = url.substring(url.lastIndexOf("."));<br /> // 使用uuid生成图片名<br /> String imageName = UUID._randomUUID_().toString() + extName;// 声明输出的文件<br /> OutputStream outstream = new FileOutputStream(new File("D:/images/" + imageName));<br /> // 使用响应体输出文件<br /> response.getEntity().writeTo(outstream);// 返回生成的图片名<br /> return imageName;<br /> }} catch (Exception e) {<br /> e.printStackTrace();<br /> } finally {<br /> try {<br /> if (response != null) {<br /> // 关闭连接<br /> response.close();<br /> }<br /> // 不能关闭,现在使用的是连接管理器<br /> // httpClient.close();<br /> } catch (Exception e) {<br /> e.printStackTrace();<br /> }<br /> }return null;<br /> }//获取请求参数对象<br /> private RequestConfig getConfig() {<br /> RequestConfig config = RequestConfig._custom_().setConnectTimeout(1000)// 设置创建连接的超时时间<br /> .setConnectionRequestTimeout(500) // 设置获取连接的超时时间<br /> .setSocketTimeout(10000) // 设置连接的超时时间<br /> .build();return config;<br /> }

}

6.3.6 实现数据抓取

使用定时任务,可以定时抓取最新的数据

@Componentpublic class ItemTask {

@Autowired<br /> private HttpUtils httpUtils;<br /> @Autowired<br /> private ItemService itemService;public static final ObjectMapper _MAPPER _= new ObjectMapper();//设置定时任务执行完成后,再间隔100秒执行一次<br /> @Scheduled(fixedDelay = 1000 * 100)<br /> public void process() throws Exception {<br /> //分析页面发现访问的地址,页码page从1开始,下一页oage加2<br /> String url = "https://search.jd.com/Search?keyword=%E6%89%8B%E6%9C%BA&enc=utf-8&qrst=1&rt=1&stop=1&vt=2&cid2=653&cid3=655&s=5760&click=0&page=";//遍历执行,获取所有的数据<br /> for (int i = 1; i < 10; i = i + 2) {<br /> //发起请求进行访问,获取页面数据,先访问第一页<br /> String html = this.httpUtils.getHtml(url + i);//解析页面数据,保存数据到数据库中<br /> this.parseHtml(html);}<br /> System._out_.println("执行完成");<br /> }//解析页面,并把数据保存到数据库中<br /> private void parseHtml(String html) throws Exception {<br /> //使用jsoup解析页面<br /> Document document = Jsoup._parse_(html);//获取商品数据<br /> Elements spus = document.select("div#J_goodsList > ul > li");//遍历商品spu数据<br /> for (Element spuEle : spus) {<br /> //获取商品spu<br /> Long spuId = Long._parseLong_(spuEle.attr("data-spu"));//获取商品sku数据<br /> Elements skus = spuEle.select("li.ps-item img");<br /> for (Element skuEle : skus) {<br /> //获取商品sku<br /> Long skuId = Long._parseLong_(skuEle.attr("data-sku"));//判断商品是否被抓取过,可以根据sku判断<br /> Item param = new Item();<br /> param.setSku(skuId);<br /> List<Item> list = this.itemService.findAll(param);<br /> //判断是否查询到结果<br /> if (list.size() > 0) {<br /> //如果有结果,表示商品已下载,进行下一次遍历<br /> continue;<br /> }//保存商品数据,声明商品对象<br /> Item item = new Item();//商品spu<br /> item.setSpu(spuId);<br /> //商品sku<br /> item.setSku(skuId);<br /> //商品url地址<br /> item.setUrl("https://item.jd.com/" + skuId + ".html");<br /> //创建时间<br /> item.setCreated(new Date());<br /> //修改时间<br /> item.setUpdated(item.getCreated());//获取商品标题<br /> String itemHtml = this.httpUtils.getHtml(item.getUrl());<br /> String title = Jsoup._parse_(itemHtml).select("div.sku-name").text();<br /> item.setTitle(title);//获取商品价格<br /> String priceUrl = "https://p.3.cn/prices/mgets?skuIds=J_"+skuId;<br /> String priceJson = this.httpUtils.getHtml(priceUrl);<br /> //解析json数据获取商品价格<br /> double price = _MAPPER_.readTree(priceJson).get(0).get("p").asDouble();<br /> item.setPrice(price);//获取图片地址<br /> String pic = "https:" + skuEle.attr("data-lazy-img").replace("/n9/","/n1/");<br /> System._out_.println(pic);<br /> //下载图片<br /> String picName = this.httpUtils.getImage(pic);<br /> item.setPic(picName);//保存商品数据<br /> this.itemService.save(item);<br /> }<br /> }<br /> }<br />}