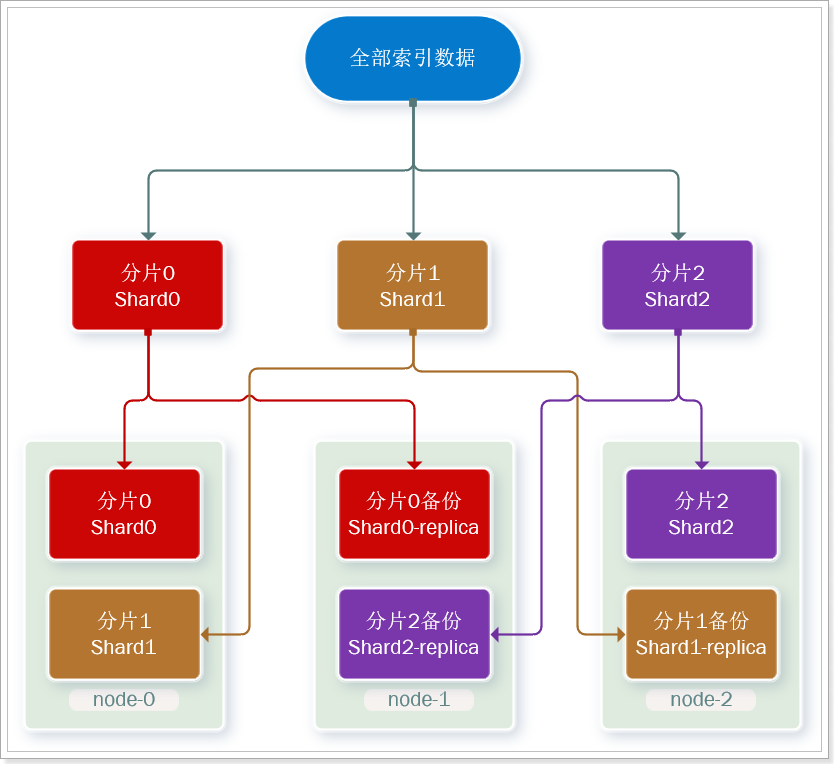

单机的 ElasticSearch 做数据存储,必然面临两个问题:海量数据存储问题、单点故障问题。

- 海量数据存储问题:将索引库从逻辑上拆分为 N 个分片(shard),存储到多个节点

- 单点故障问题:将分片数据在不同节点备份(replica)

ES 集群相关概念:

- 集群(cluster):一组拥有共同的 cluster name 的 节点。

- 节点(node) :集群中的一个 Elasticearch 实例

- 分片(shard):索引可以被拆分为不同的部分进行存储,称为分片。在集群环境下,一个索引的不同分片可以拆分到不同的节点中

解决问题:数据量太大,单点存储量有限的问题。

此处,我们把数据分成 3 片:shard0、shard1、shard2

- 主分片(Primary shard):相对于副本分片的定义。

- 副本分片(Replica shard)每个主分片可以有一个或者多个副本,数据和主分片一样。

数据备份可以保证高可用,但是每个分片备份一份,所需要的节点数量就会翻一倍,成本实在是太高了!

为了在高可用和成本间寻求平衡,我们可以这样做:

- 首先对数据分片,存储到不同节点

- 然后对每个分片进行备份,放到对方节点,完成互相备份

这样可以大大减少所需要的服务节点数量,如图,我们以 3 分片,每个分片备份一份为例:

现在,每个分片都有 1 个备份,存储在 3 个节点:

- node0:保存了分片 0 和 1

- node1:保存了分片 0 和 2

- node2:保存了分片 1 和 2

部署 ElasticSearch 集群

我们会在单机上利用 docker 容器运行多个 ElasticSearch 实例来模拟 ElasticSearch 集群。不过生产环境推荐大家每一台服务节点仅部署一个 ElasticSearch 的实例。

部署 ElasticSearch 集群可以直接使用 docker-compose 来完成,但这要求你的 Linux 虚拟机至少有 4G 的内存空间

创建 ElasticSearch 集群

首先编写一个 docker-compose 文件,内容如下:

version: '2.2'services:es01:image: elasticsearch:7.12.1container_name: es01environment:- node.name=es01- cluster.name=es-docker-cluster- discovery.seed_hosts=es02,es03- cluster.initial_master_nodes=es01,es02,es03- "ES_JAVA_OPTS=-Xms512m -Xmx512m"volumes:- data01:/usr/share/elasticsearch/dataports:- 9200:9200networks:- elastices02:image: elasticsearch:7.12.1container_name: es02environment:- node.name=es02- cluster.name=es-docker-cluster- discovery.seed_hosts=es01,es03- cluster.initial_master_nodes=es01,es02,es03- "ES_JAVA_OPTS=-Xms512m -Xmx512m"volumes:- data02:/usr/share/elasticsearch/dataports:- 9201:9200networks:- elastices03:image: elasticsearch:7.12.1container_name: es03environment:- node.name=es03- cluster.name=es-docker-cluster- discovery.seed_hosts=es01,es02- cluster.initial_master_nodes=es01,es02,es03- "ES_JAVA_OPTS=-Xms512m -Xmx512m"volumes:- data03:/usr/share/elasticsearch/datanetworks:- elasticports:- 9202:9200volumes:data01:driver: localdata02:driver: localdata03:driver: localnetworks:elastic:driver: bridge

ElasticSearch 运行需要修改一些 Linux 系统权限,修改 /etc/sysctl.conf 文件

vi /etc/sysctl.conf

添加下面的内容:

vm.max_map_count=262144

然后执行命令,让配置生效:

sysctl -p

通过 docker-compose 启动集群:

docker-compose up -d

集群状态监控

kibana 可以监控 ElasticSearch 集群,不过新版本需要依赖 ElasticSearch 的 x-pack 功能,配置比较复杂。

这里推荐使用 cerebro 来监控 ElasticSearch 集群状态,官方网址:https://github.com/lmenezes/cerebro

双击其中的 cerebro.bat 文件即可启动服务。访问 http://localhost:9000 即可进入管理界面:

输入你的 ElasticSearch 的任意节点的地址和端口,点击 connect 即可

创建索引库

利用 kibana 的 DevTools 创建索引库,在 DevTools 中输入指令:

PUT /test{"settings": {"number_of_shards": 3, // 分片数量"number_of_replicas": 1 // 副本数量},"mappings": {"properties": {// mapping映射定义 ...}}}

或利用 cerebro 创建索引库

查看分片效果,回到首页,即可查看索引库分片效果:

集群脑裂问题

集群职责划分

ElasticSearch 中集群节点有不同的职责划分:

| 节点类型 | 配置参数 | 默认值 | 节点职责 |

|---|---|---|---|

| master eligible | node.master | true | 备选主节点:主节点可以管理和记录集群状态、决定分片在哪个节点、处理创建和删除索引库的请求 |

| data | node.data | true | 数据节点:存储数据、搜索、聚合、CRUD |

| ingest | node.ingest | true | 数据存储之前的预处理 |

| coordinating | 上面 3 个参数都为 false 则为 coordinating 节点 | 无 | 路由请求到其它节点 合并其它节点处理的结果,返回给用户 |

默认情况下,集群中的任何一个节点都同时具备上述四种角色。

但是真实的集群一定要将集群职责分离:

- master 节点:对 CPU 要求高,但是内存要求低

- data 节点:对 CPU 和内存要求都高

- coordinating 节点:对网络带宽、CPU 要求高

职责分离可以让我们根据不同节点的需求分配不同的硬件去部署。而且避免业务之间的互相干扰。

一个典型的 ElasticSearch 集群职责划分如图:

脑裂问题

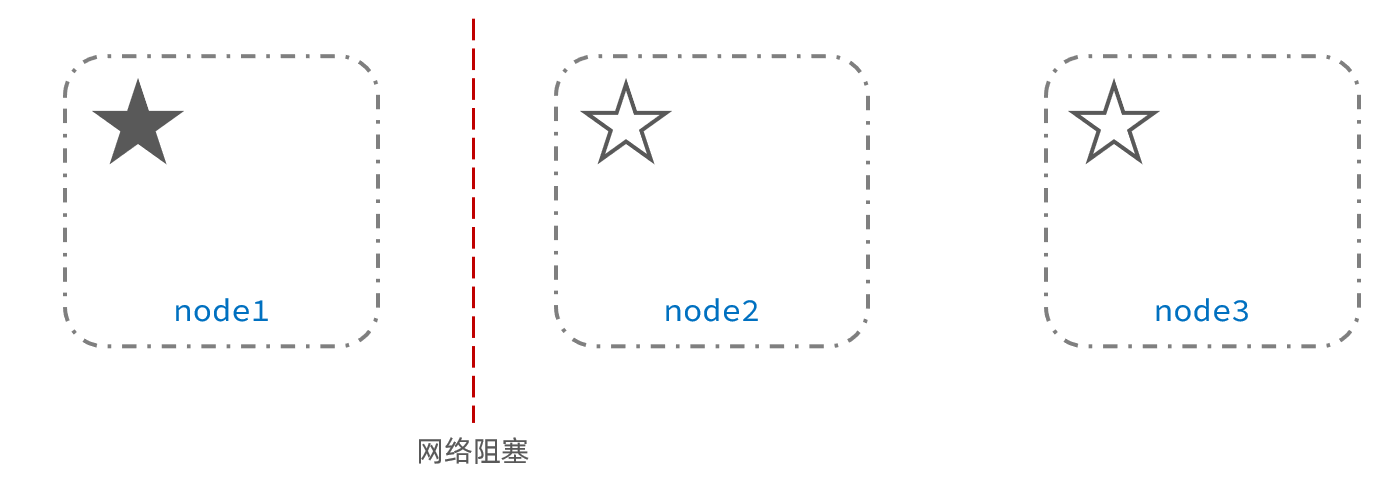

脑裂是因为集群中的节点失联导致的。

例如一个集群中,主节点与其它节点失联,

此时 node2 和 node3 认为 node1 宕机,就会重新选主:

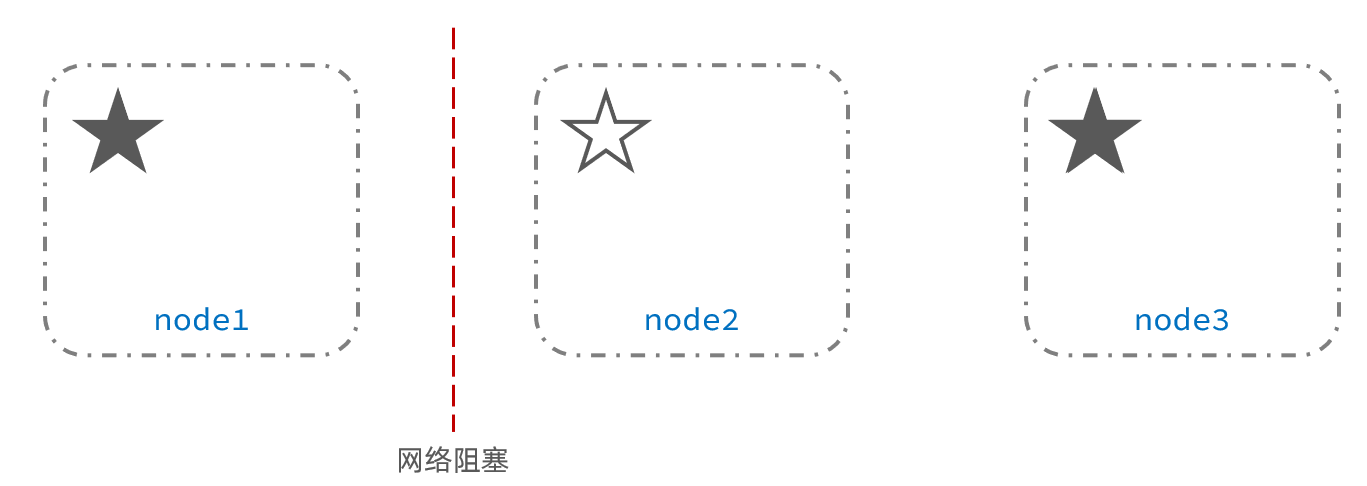

当 node3 当选后,集群继续对外提供服务,node2 和 node3 自成集群,node1 自成集群,两个集群数据不同步,出现数据差异。

当网络恢复后,因为集群中有两个 master 节点,集群状态的不一致,出现脑裂的情况:

解决脑裂的方案是,要求选票超过 ( eligible节点数量 + 1 )/ 2 才能当选为主,因此 eligible 节点数量最好是奇数。对应配置项是 discovery.zen.minimum_master_nodes,在 ElasticSearch 7.0 以后,已经成为默认配置,因此一般不会发生脑裂问题

例如:3 个节点形成的集群,选票必须超过 (3 + 1) / 2 ,也就是 2 票。node3 得到 node2 和 node3 的选票,当选为主。node1 只有自己 1 票,没有当选。集群中依然只有 1 个主节点,没有出现脑裂。

集群分布式存储

当新增文档时,应该保存到不同分片,保证数据均衡,那么 coordinating node 如何确定数据该存储到哪个分片呢?

分片存储测试

在一个节点中加入数据,后可以通过 explain 命令查询

POST /test/_search{"explain": true,"query": {"match_all": {}}}

发现数据在不同的节点中,形成分片存储

分片存储原理

ElasticSearch 会通过 hash 算法来计算文档应该存储到哪个分片:shard = hash(_routing) % number_of_shards

说明:

_routing默认是文档的id- 算法与分片数量有关,因此索引库一旦创建,分片数量不能修改!

新增文档的流程如下:

解读:

- 新增一个 id=1 的文档

- 对 id 做 hash 运算,假如得到的是 2,则应该存储到 P-2

- P-2 的主分片在 node3 节点,将数据路由到 node3

- 保存文档

- 同步给 P-2 的副本 R-2,在 node2 节点

- 返回结果给 coordinating-node 节点

集群分布式查询

ElasticSearch 的查询分成两个阶段:

- scatter phase:分散阶段,coordinating node 会把请求分发到每一个分片

- gather phase:聚集阶段,coordinating node 汇总 data node 的搜索结果,并处理为最终结果集返回给用户

集群故障转移

集群的 master 节点会监控集群中的节点状态,如果发现有节点宕机,会立即将宕机节点的分片数据迁移到其它节点,确保数据安全,这个叫做故障转移。

- 假如,node1 发生了故障

- 宕机后的第一件事,需要重新选主,例如选中了 node2,

- node2 成为主节点后,会检测集群监控状态,发现:shard-1、shard-0 没有副本节点。因此需要将 node1 上的数据迁移到 node2、node3

- 但 node1 恢复,此时 node1 不在是主节点,但数据会重新平衡