DataNode工作机制

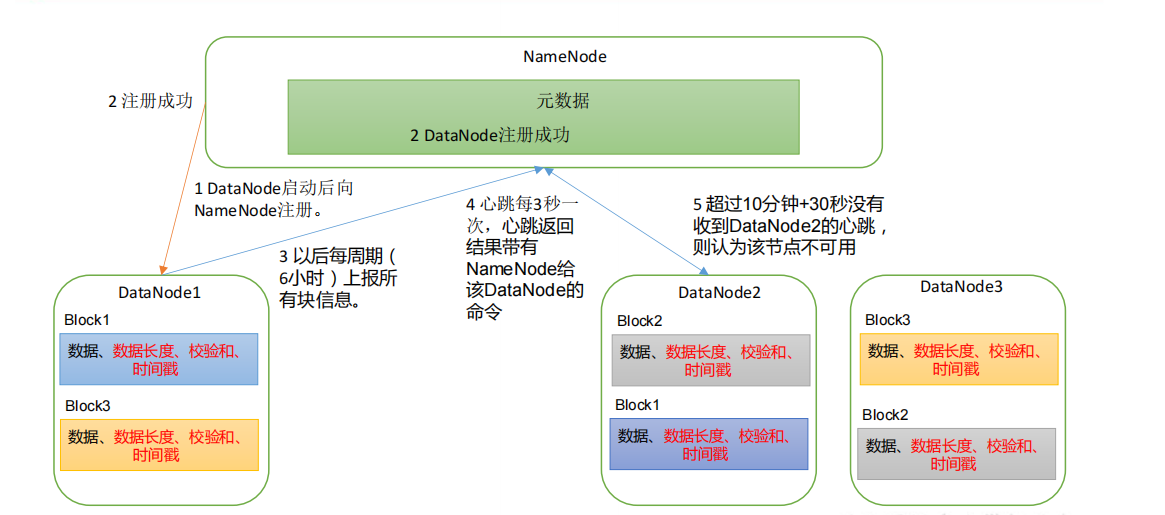

DataNode工作流程:

一个数据块在DataNode上以文件形式存储在磁盘上,包括两个文件:一个是数据本身,一个是元数据 xxxxx.meta(包括数据块的长度、块数据的校验和,以及时间戳)。

DataNode启动后向NameNode注册,通过后,周期性(默认6小时)的向NameNode上报所有的块信息。

心跳是每3秒一次,心跳返回结果带有NameNode给该DataNode的命令(如复制数据块到另一台机器,或删除某个数据块)。如果超过10分钟 + 30秒(超过10分钟,再给10次机会)还没有收到某个DataNode的心跳,就认为该节点不可用,认为该节点宕机了,不会再向该节点传输信息。

集群运行中,可以安全的加入或退出一些机器。

DN向NN汇报当前节点信息的时间间隔,默认6小时:

<property><name>dfs.blockreport.intervalMsec</name><value>21600000</value><describe>Determines block reporting interval in milliseconds</describe></property>

DN扫描自己节点块信息列表的时间(默认也是6小时):

<property><name>dfs.datanode.directoryscan.interval</name><value>21600s</value></property>

即:每隔6小时,DataNode扫描自己节点上的所有数据块信息,然后上报给NameNode。

数据完整性

DataNode保证数据完整性的做法:

- 当DataNode读取Block的时候,它会计算CheckSum

- 如果计算后的CheckSum,与Block创建时值不一样,说明Block已经损坏。

- Client读取其他DataNode上的Block

常见的校验算法有:crc(32)、md5(128)、sha1(160)。

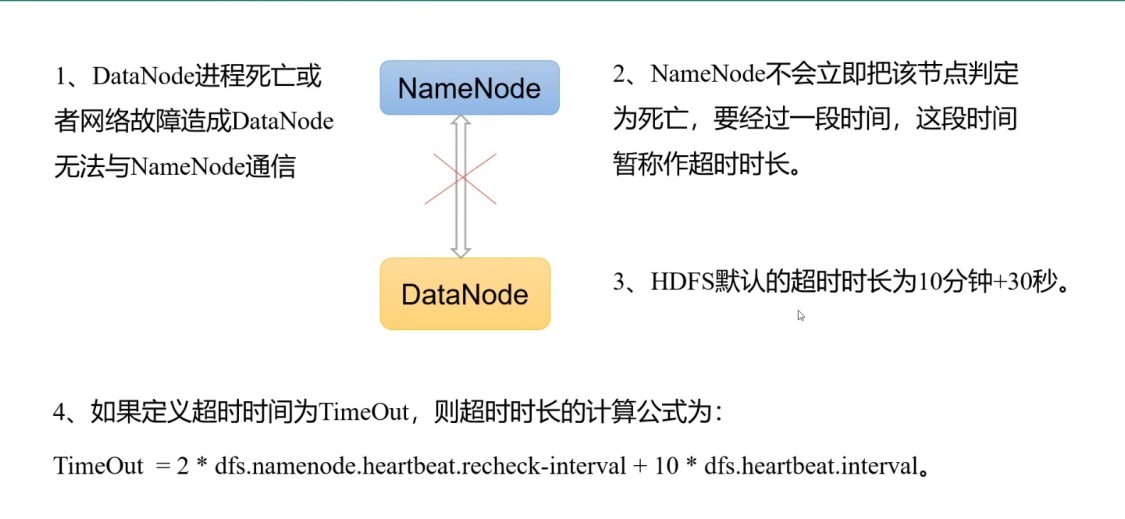

掉线时限设置

NameNode判断DataNode掉线:

其中dfs.namenode.heartbeat.recheck-interval(单位毫秒)和dfs.heartbeat.interval(单位秒)可以在hdfs-site.xml中进行配置。

<property><name>dfs.namenode.heartbeat.recheck-interval</name><value>300000</value><describe>默认为300秒,即5分钟</describe></property><property><name>dfs.heartbeat.interval</name><value>3</value><describe>心跳时间默认3秒</describe></property>

所以,如果是默认配置,最后真正判断的超时时间为 :2 5分钟 + 10 3秒 = 10分钟30秒

每个节点的上次心跳发送时间,可以在浏览器上查看:http://hadoop102:9870,进入Datanodes,即可看到每个节点的上次发送心跳时间Last contact