一、配置服务器

1.1、配置服务器之间免密登录

https://www.yuque.com/wells/big.data/ekxh6e

1.2、配置服务器host

在每台服务器上,进行如下操作:sudo vim /etc/hosts

增加内容如下:

10.0.2.4 node0110.0.2.5 node0210.0.2.6 node0310.0.2.7 node04

二、搭建zk集群

2.1 下载 & 解压安装包

cd /app/bi/tools/zkwget http://mirror.bit.edu.cn/apache/zookeeper/zookeeper-3.4.14/zookeeper-3.4.14.tar.gztar -zxvf zookeeper-3.4.14.tar.gz

2.2 修改配置文件

2.2.1 修改zoo.cfg配置文件

cd zookeeper-3.4.14/confcp zoo_sample.cfg zoo.cfgvim zoo.cfg

2.2.2 修改zoo.cfg

- 修改zoo.cfg中的dataDir:dataDir=/app/bi/tools/zk/dataDir

- 增加集群信息( 2888主从通信的端口、3888选举时候用的端口 )

server.1=node02:2888:3888server.2=node03:2888:3888server.3=node04:2888:3888

2.2.3 zk分发

scp -r /app/bi/tools/zk node03:`pwd`scp -r /app/bi/tools/zk node04:`pwd`

2.2.4 在zk集群各服务器

- 创建dataDir目录:mkdir /app/bi/tools/zk/dataDir/

- 将上面设置的服务器编号,分别写入对应的服务器上的myid文件中:

echo 1 > /app/bi/tools/zk/dataDir/myidecho 2 > /app/bi/tools/zk/dataDir/myidecho 3 > /app/bi/tools/zk/dataDir/myid

2.2.4 配置zk home

vim ~/.bash_profile

增加内容如下:

ZOOKEEPER_HOME=/app/bi/tools/zk/zookeeper-3.4.14PATH=$PATH:$ZOOKEEPER_HOME/bin:export PATH

2.3 运行ZK

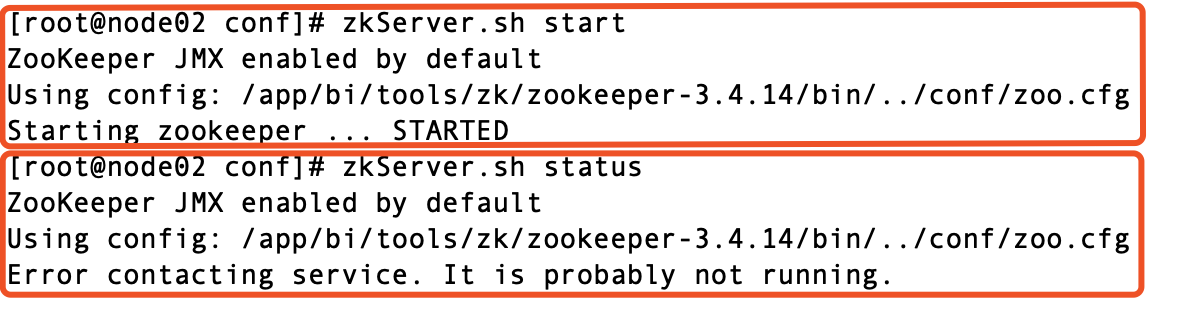

2.3.1 运行zk & 查看zk状态

zkServer.sh startzkServer.sh status

三、问题

问题1:zk启动不成功

描述:启动成功,但是查看状态不成功

解决:

原因一:相关目录未创建

zoo.cfg配置文件时,指定了log或者data的输出目录,但是却未创建,需要mkdir创建

mkdir -p /app/bi/tools/zk/logDirmkdir -p /app/bi/tools/zk/dataDir

原因二:myid未配置

dataDir目录下myid文件写错,不同的节点上面的myid里的数字不同,需要确认

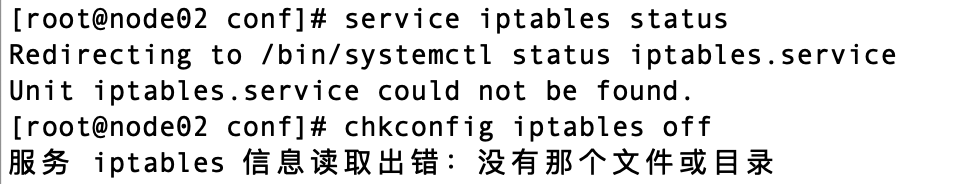

原因三:防火墙未关闭

防火墙是否关闭了( 这个是最大的可能 )

service iptables stop //关闭防火墙

service iptables status //查看状态

chkconfig iptables off //禁用防火墙

Ubuntu

查看防火墙状态:ufw status

关闭防火墙:ufw disable

Centos7.0

查看防火墙状态:firewall-cmd —state

关闭防火墙:systemctl stop firewalld.service

原因四:主机名写错

zoo.cfg配置该节点的主机名是否写错了。

是的话就先停止三个节点zookeeper服务,再逐一的修改节点上zoo.cfg配置文件,再逐一的启动。

原因五:端口被占用

端口被占用了,把2181端口改成别的就可以了。

netstat -an | grep 2181 #查看端口是否占用

原因六:已经有zk启动

利用ps命令查看,zk是否已经启动,启动了的就先杀掉进程,再重新启动即可

原因七:hosts配置错误

建立主机和ip之间映射关系的命令为 vim /etc/hosts

原因八:未启动集群中所有的zk

需要将三台服务器上的zk都启动后,再查看状态,启动一台就直接查看状态,会显示上面的错误,因为需要构成集群来启动

问题2:

描述:

解决:

centos从7开始默认用的是firewalld,这个是基于iptables的,虽然有iptables的核心,但是iptables的服务是没安装的。所以你只要停止firewalld服务即可:

sudo systemctl stop firewalld.service && sudo systemctl disable firewalld.service

如果你要改用iptables的话,需要安装iptables服务:

sudo yum install iptables-servicessudo systemctl enable iptables && sudo systemctl enable ip6tablessudo systemctl start iptables && sudo systemctl start ip6tables

再使用iptables关闭防火墙;

四、ZK参数说明

| 参数名 | 说明 |

|---|---|

| clientPort | 客户端连接server的端口,即对外服务端口,一般设置为2181吧。 |

| dataDir | 存储快照文件snapshot的目录。默认情况下,事务日志也会存储在这里。建议同时配置参数dataLogDir, 事务日志的写性能直接影响zk性能。 |

| tickTime | ZK中的一个时间单元。ZK中所有时间都是以这个时间单元为基础,进行整数倍配置的。例如,session的最小超时时间是2*tickTime。 |

| dataLogDir | 事务日志输出目录。尽量给事务日志的输出配置单独的磁盘或是挂载点,这将极大的提升ZK性能。 (No Java system property) |

| globalOutstandingLimit | 最大请求堆积数。默认是1000。ZK运行的时候, 尽管server已经没有空闲来处理更多的客户端请求了,但是还是允许客户端将请求提交到服务器上来,以提高吞吐性能。当然,为了防止Server内存溢出,这个请求堆积数还是需要限制下的。 (Java system property:zookeeper.globalOutstandingLimit. ) |

| preAllocSize | 预先开辟磁盘空间,用于后续写入事务日志。默认是64M,每个事务日志大小就是64M。如果ZK的快照频率较大的话,建议适当减小这个参数。(Java system property:zookeeper.preAllocSize ) |

| snapCount | 每进行snapCount次事务日志输出后,触发一次快照(snapshot), 此时,ZK会生成一个snapshot.文件,同时创建一个新的事务日志文件log.。默认是100000.(真正的代码实现中,会进行一定的随机数处理,以避免所有服务器在同一时间进行快照而影响性能)(Java system property:zookeeper.snapCount ) |

| traceFile | 用于记录所有请求的log,一般调试过程中可以使用,但是生产环境不建议使用,会严重影响性能。(Java system property:? requestTraceFile ) |

| maxClientCnxns | 单个客户端与单台服务器之间的连接数的限制,是ip级别的,默认是60,如果设置为0,那么表明不作任何限制。请注意这个限制的使用范围,仅仅是单台客户端机器与单台ZK服务器之间的连接数限制,不是针对指定客户端IP,也不是ZK集群的连接数限制,也不是单台ZK对所有客户端的连接数限制。指定客户端IP的限制策略,这里有一个patch,可以尝试一下:http://rdc.taobao.com/team/jm/archives/1334(No Java system property) |

| clientPortAddress | 对于多网卡的机器,可以为每个IP指定不同的监听端口。默认情况是所有IP都监听 clientPort 指定的端口。 New in 3.3.0 |

| minSessionTimeoutmaxSessionTimeoutSession | 超时时间限制,如果客户端设置的超时时间不在这个范围,那么会被强制设置为最大或最小时间。默认的Session超时时间是在2 tickTime ~ 20 tickTime 这个范围 New in 3.3.0 |

| fsync.warningthresholdms | 事务日志输出时,如果调用fsync方法超过指定的超时时间,那么会在日志中输出警告信息。默认是1000ms。(Java system property: fsync.warningthresholdms )New in 3.3.4 |

| autopurge.purgeInterval | 在上文中已经提到,3.4.0及之后版本,ZK提供了自动清理事务日志和快照文件的功能,这个参数指定了清理频率,单位是小时,需要配置一个1或更大的整数,默认是0,表示不开启自动清理功能。(No Java system property) New in 3.4.0 |

| autopurge.snapRetainCount | 这个参数和上面的参数搭配使用,这个参数指定了需要保留的文件数目。默认是保留3个。(No Java system property) New in 3.4.0 |

| electionAlg | 在之前的版本中, 这个参数配置是允许我们选择leader选举算法,但是由于在以后的版本中,只会留下一种“TCP-based version of fast leader election”算法,所以这个参数目前看来没有用了,这里也不详细展开说了。(No Java system property) |

| initLimitFollowe | r在启动过程中,会从Leader同步所有最新数据,然后确定自己能够对外服务的起始状态。Leader允许F在 initLimit 时间内完成这个工作。通常情况下,我们不用太在意这个参数的设置。如果ZK集群的数据量确实很大了,F在启动的时候,从Leader上同步数据的时间也会相应变长,因此在这种情况下,有必要适当调大这个参数了。(No Java system property) |

| syncLimit | 在运行过程中,Leader负责与ZK集群中所有机器进行通信,例如通过一些心跳检测机制,来检测机器的存活状态。如果L发出心跳包在syncLimit之后,还没有从F那里收到响应,那么就认为这个F已经不在线了。注意:不要把这个参数设置得过大,否则可能会掩盖一些问题。(No Java system property) |

| leaderServes | 默认情况下,Leader是会接受客户端连接,并提供正常的读写服务。但是,如果你想让Leader专注于集群中机器的协调,那么可以将这个参数设置为no,这样一来,会大大提高写操作的性能。(Java system property: zookeeper. leaderServes )。 |

| server.x=[hostname]:nnnnn[:nnnnn] | 这里的x是一个数字,与myid文件中的id是一致的。右边可以配置两个端口,第一个端口用于F和L之间的数据同步和其它通信,第二个端口用于Leader选举过程中投票通信。 (No Java system property) |

| group.x=nnnnn[:nnnnn]weight.x=nnnnn | 对机器分组和权重设置,可以 参见这里(No Java system property) |

| cnxTimeoutLeader | 选举过程中,打开一次连接的超时时间,默认是5s。(Java system property: zookeeper. cnxTimeout) |

| zookeeper.DigestAuthenticationProvider.superDigestZK | 权限设置相关,具体参见 《 使用super 身份对有权限的节点进行操作 》 和 《 ZooKeeper 权限控制 》 |

| skipACL | 对所有客户端请求都不作ACL检查。如果之前节点上设置有权限限制,一旦服务器上打开这个开头,那么也将失效。(Java system property: zookeeper.skipACL ) |

| forceSync | 这个参数确定了是否需要在事务日志提交的时候调用 FileChannel .force来保证数据完全同步到磁盘。(Java system property: zookeeper.forceSync ) |

| jute.maxbuffer | 每个节点最大数据量,是默认是1M。这个限制必须在server和client端都进行设置才会生效。(Java system property: jute.maxbuffer ) |

五、Zookeeper命令连接

zkCli.sh 连接;

再通过help查看命令;