线性模型利用输入特征的线性函数(linear function)进行预测

用于回归的线性模型

- 对于回归问题,线性模型预测的一般公式如下:

ŷ = w[0] x[0] + w[1] x[1] + … + w[p] x[p] + b

这里 x[0] 到 x[p] 表示单个数据点的特征(本例中特征个数为 p+1),w 和 b 是学习模型的参数,ŷ 是模型的预测结果。对于单一特征的数据集,公式如下:

ŷ = w[0] x[0] + b

- 这就是高中数学里的直线方程。这里 w[0] 是斜率,b 是 y 轴偏移。

- 对于有更多特征的数据集,w 包含沿每个特征坐标轴的斜率。

- 或者,你也可以将预测的响应值看作输入特征的加权求和,权重由 w 的元素给出(可以取负值)。

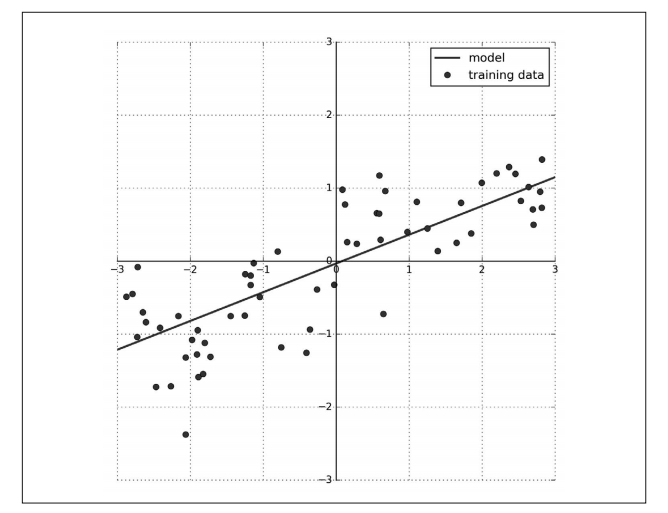

下列代码可以在一维 wave 数据集上学习参数 w[0] 和 b:

In:mglearn.plots.plot_linear_regression_wave()Out:w[0]: 0.393906 b: -0.031804

- 用于回归的线性模型可以表示为这样的回归模型:对单一特征的预测结果是一条直线,两个特征时是一个平面,或者在更高维度(即更多特征)时是一个超平面。

- 直线的预测能力非常受限,似乎数据的所有细节都丢失了。从某种意义上来说,这种说法是正确的。假设目标 y 是特征的线性组合,这是一个非常强的(也有点不现实的)假设。但观察一维数据得出的观点有些片面。对于有多个特征的数据集而言,线性模型可以非常强大。特别地,如果特征数量大于训练数据点的数量,任何目标 y 都可以(在训练集上)用线性函数完美拟合 。

有许多不同的线性回归模型。这些模型之间的区别在于如何从训练数据中学习参数 w 和b,以及如何控制模型复杂度。下面介绍最常见的线性回归模型:

线性回归(又名普通最小二乘法)

- 线性回归,或者普通最小二乘法(ordinary least squares,OLS),是回归问题最简单也最经典的线性方法。

- 线性回归寻找参数 w 和 b,使得对训练集的预测值与真实的回归目标值 y之间的均方误差最小。均方误差(mean squared error)是预测值与真实值之差的平方和除以样本数。

- 线性回归没有参数,这是一个优点,但也因此无法控制模型的复杂度。

In:from sklearn.linear_model import LinearRegressionX, y = mglearn.datasets.make_wave(n_samples=60)X_train, X_test, y_train, y_test = train_test_split(X, y, random_state=42)lr = LinearRegression().fit(X_train, y_train)

“斜率”参数(w,也叫作权重或系数)被保存在 coef 属性中,coef 属性是一个 NumPy 数组,每个元素对应一个输入特征。

偏移或截距(b)被保存在 intercept 属性中,intercept 属性是一个浮点数

In:print("lr.coef_: {}".format(lr.coef_))print("lr.intercept_: {}".format(lr.intercept_))Out:lr.coef_: [ 0.394] # w 由于 wave 数据集中只有一个输入特征,所以 lr.coef_ 中只有一个元素。lr.intercept_: -0.031804343026759746 # b

- 对于这个一维数据集来说,过拟合的风险很小,因为模型非常简单(或受限)。然而,对于更高维的数据集(即有大量特征的数据集),线性模型将变得更加强大,过拟合的可能性也会变大。

训练集和测试集之间的性能差异是过拟合的明显标志,标准线性回归最常用的替代方法之一就是岭回归(ridge regression)。

岭回归

岭回归也是一种用于回归的线性模型,因此它的预测公式与普通最小二乘法相同。

- 但在岭回归中,对系数(w)的选择不仅要在训练数据上得到好的预测结果,而且还要拟合附加约束。我们还希望系数尽量小。换句话说,w 的所有元素都应接近于 0。直观上来看,这意味着每个特征对输出的影响应尽可能小(即斜率很小),同时仍给出很好的预测结果。这种约束是所谓正则化(regularization)的一个例子。正则化是指对模型做显式约束,以避免过拟合。岭回归用到的这种被称为 L2 正则化。

- 岭回归在 linear_model.Ridge 中实现。

- Ridge 是一种约束更强的模型,所以更不容易过拟合。复杂度更小的模型意味着在训练集上的性能更差,但泛化性能更好。由于我们只对泛化性能感兴趣,所以应该选择 Ridge 模型而不是 LinearRegression 模型。

- Ridge 模型在模型的简单性(系数都接近于 0)与训练集性能之间做出权衡。简单性和训练集性能二者对于模型的重要程度可以由用户通过设置 alpha 参数来指定。在前面的例子中,我们用的是默认参数 alpha=1.0。但没有理由认为这会给出最佳权衡。alpha 的最佳设定值取决于用到的具体数据集。增大 alpha 会使得系数更加趋向于 0,从而降低训练集性能,但可能会提高泛化性能。

- 减小 alpha 可以让系数受到的限制更小。对于非常小的 alpha 值,系数几乎没有受到限制,可以得到一个与 LinearRegression 类似的模型。

- 我们还可以查看 alpha 取不同值时模型的 coef 属性,从而更加定性地理解 alpha 参数是如何改变模型的。更大的 alpha 表示约束更强的模型,所以我们预计大 alpha 对应的 coef元素比小 alpha 对应的 coef_ 元素要小。

理解 alpha 参数是如何改变模型的方法

查看 alpha 取不同值时模型的 coef_ 属性

更大的 alpha 表示约束更强的模型,所以我们预计大 alpha 对应的 coef

元素比小 alpha 对应的 coef 元素要小。这一点可以在图 2-12 中得到证实:

In:plt.plot(ridge.coef_, 's', label="Ridge alpha=1")plt.plot(ridge10.coef_, '^', label="Ridge alpha=10")plt.plot(ridge01.coef_, 'v', label="Ridge alpha=0.1")plt.plot(lr.coef_, 'o', label="LinearRegression")plt.xlabel("Coefficient index")plt.ylabel("Coefficient magnitude")plt.hlines(0, 0, len(lr.coef_))plt.ylim(-25, 25)plt.legend()

不同 alpha 值的岭回归与线性回归的系数比较 ,这里 x 轴对应 coef 的元素:x=0 对应第一个特征的系数,x=1 对应第二个特征的系数,以

此类推,一直到 x=100。_y 轴表示该系数的具体数值。这里需要记住的是,对于 alpha=10,系数大多在 -3 和 3 之间。对于 alpha=1 的 Ridge 模型,系数要稍大一点。对于 alpha=0.1,点的范围更大。对于没有做正则化的线性回归(即 alpha=0),点的范围很大,许多点都超

出了图像的范围。

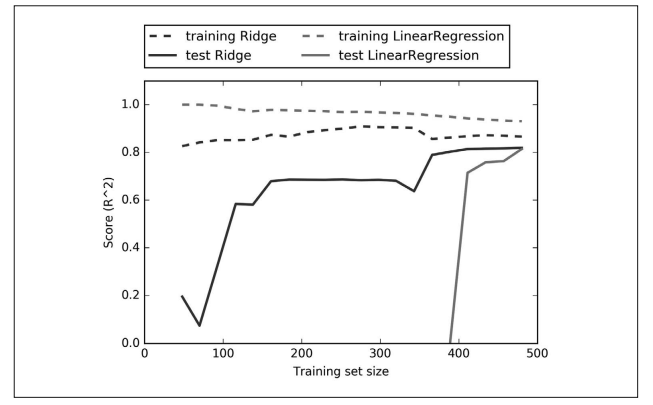

就是固定 alpha 值,但改变训练数据量

我们对波士顿房价数据集做二次抽样,并在数据量逐渐增加的子数据集上分别对 LinearRegression 和 Ridge(alpha=1) 两个模型进行评估(将模型性能作为数据集大小的函数进行绘图,这样的图像叫作学习曲线)

In:mglearn.plots.plot_ridge_n_samples()

我们可以看到,无论是岭回归还是线性回归,所有数据集大小对应的训练分数都要高于测试分数。由于岭回归是正则化的,因此它的训练分数要整体低于线性回归的训练分数。但岭回归的测试分数要更高,特别是对较小的子数据集。如果少于 400 个数据点,线性回归学不到任何内容。随着模型可用的数据越来越多,两个模型的性能都在提升,最终线性回归的性能追上了岭回归。这里要记住的是,如果有足够多的训练数据,正则化变得不那么重要,并且岭回归和线性回归将具有相同的性能(在这个例子中,二者相同恰好发生在整个数据集的情况下,这只是一个巧合)。图 2-13 中还有一个有趣之处,就是线性回归的训练性能在下降。如果添加更多数据,模型将更加难以过拟合或记住所有的数据。

lasso

除了 Ridge,还有一种正则化的线性回归是 Lasso。与岭回归相同,使用 lasso 也是约束系数使其接近于 0,但用到的方法不同,叫作 L1 正则化。L1 正则化的结果是,使用 lasso 时某些系数刚好为 0。这说明某些特征被模型完全忽略。这可以看作是一种自动化的特征选择。某些系数刚好为 0,这样模型更容易解释,也可以呈现模型最重要的特征。

In:from sklearn.linear_model import Lassolasso = Lasso().fit(X_train, y_train)print("Training set score: {:.2f}".format(lasso.score(X_train, y_train)))print("Test set score: {:.2f}".format(lasso.score(X_test, y_test)))print("Number of features used: {}".format(np.sum(lasso.coef_ != 0)))Out:Training set score: 0.29Test set score: 0.21Number of features used: 4

Lasso 在训练集与测试集上的表现都很差。这表示存在欠拟合,我们发现模型只用到了 105 个特征中的 4 个。与 Ridge 类似,Lasso 也有一个正则化参数 alpha,可以控 制系数趋向于 0 的强度。在上一个例子中,我们用的是默认值 alpha=1.0。为了降低欠拟合,我们尝试减小 alpha。这么做的同时,我们还需要增加 max_iter 的值(运行迭代的最大次数)

In:# 我们增大max_iter的值,否则模型会警告我们,说应该增大max_iterlasso001 = Lasso(alpha=0.01, max_iter=100000).fit(X_train, y_train)print("Training set score: {:.2f}".format(lasso001.score(X_train, y_train)))print("Test set score: {:.2f}".format(lasso001.score(X_test, y_test)))print("Number of features used: {}".format(np.sum(lasso001.coef_ != 0)))Out:Training set score: 0.90Test set score: 0.77Number of features used: 33

alpha 值变小,我们可以拟合一个更复杂的模型,在训练集和测试集上的表现也更好。模型性能比使用 Ridge 时略好一点,而且我们只用到了 105 个特征中的 33 个。这样模型可能更容易理解。但如果把 alpha 设得太小,那么就会消除正则化的效果,并出现过拟合,得到与LinearRegression 类似的结果。

在实践中,在两个模型中一般首选岭回归。但如果特征很多,你认为只有其中几个是重要的,那么选择 Lasso 可能更好。同样,如果你想要一个容易解释的模型,Lasso 可以给出更容易理解的模型,因为它只选择了一部分输入特征。scikit-learn 还提供了 ElasticNet类,结合了 Lasso 和 Ridge 的惩罚项。在实践中,这种结合的效果最好,不过代价是要调节两个参数:一个用于 L1 正则化,一个用于 L2 正则化。

用于分类的线性模型

线性模型也广泛应用于分类问题。我们首先来看二分类。这时可以利用下面的公式进行预测:

ŷ = w[0] x[0] + w[1] x[1] + …+ w[p] * x[p] + b > 0

这个公式看起来与线性回归的公式非常相似,但我们没有返回特征的加权求和,而是为预测设置了阈值(0)。如果函数值小于 0,我们就预测类别 -1;如果函数值大于 0,我们就预测类别 +1。对于所有用于分类的线性模型,这个预测规则都是通用的。同样,有很多种不同的方法来找出系数(w)和截距(b)。

对于用于回归的线性模型,输出 ŷ 是特征的线性函数,是直线、平面或超平面(对于更高维的数据集)。对于用于分类的线性模型,决策边界是输入的线性函数。换句话说,(二元)线性分类器是利用直线、平面或超平面来分开两个类别的分类器。本节我们将看到这方面的例子。

学习线性模型有很多种算法。这些算法的区别在于以下两点:

系数和截距的特定组合对训练数据拟合好坏的度量方法;

是否使用正则化,以及使用哪种正则化方法。

不同的算法使用不同的方法来度量“对训练集拟合好坏”。由于数学上的技术原因,不可能调节 w 和 b 使得算法产生的误分类数量最少。对于我们的目的,以及对于许多应用而言,上面第一点(称为损失函数)的选择并不重要。

最常见的两种线性分类算法是 Logistic 回归(logistic regression)和线性支持向量机(linear

support vector machine,线性 SVM),前者在 linear_model.LogisticRegression 中实现,后者在 svm.LinearSVC(SVC 代表支持向量分类器)中实现。虽然 LogisticRegression的名字中含有回归(regression),但它是一种分类算法,并不是回归算法,不应与LinearRegression 混淆。

我们可以将 LogisticRegression 和 LinearSVC 模型应用到 forge 数据集上,并将线性模型找到的决策边界可视化(图 2-15):