:::color1 CPU vs GPU:AI 训练、微调与运行,为什么需要GPU?

:::

在人工智能(AI)的浪潮中,GPU(图形处理单元)正以其独特的优势,成为AI大模型训练的中坚力量。本文将深入探讨 CPU 与 GPU 在 AI 训练、微调和运行中的作用,并解释为什么 GPU 在这些过程中扮演着至关重要的角色。

📌 人工智能与深度学习

在开始之前,我们要先了解一下,在人工智能领域,什么是“人工神经网络”以及“训练”。

这里请先移步到我另一篇文章的《人工智能与深度学习》章节 **👇**

📌 AI训练:数据驱动的智能

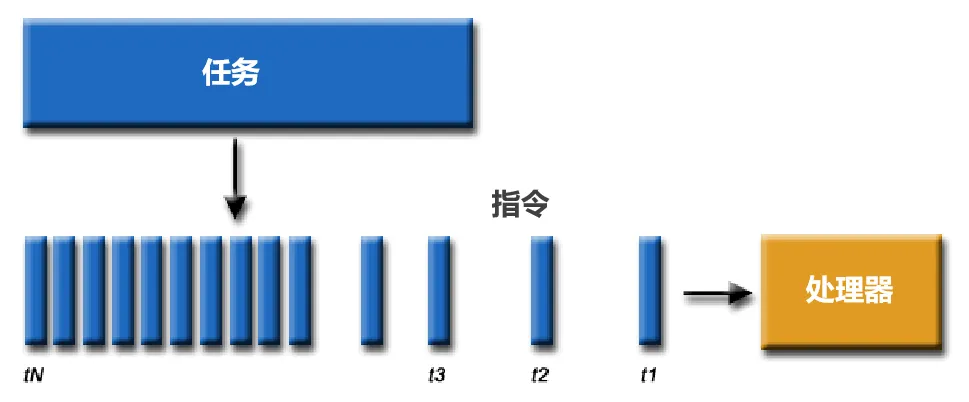

接🎯 大模型训练指南 教程所讲,AI 训练是一个数据驱动的过程,它依赖于大量的数据输入和复杂的计算。在这个过程中,AI模型通过学习数据中的模式和规律,逐步优化其参数,以提高预测或分类的准确性。这一过程需要执行大量的矩阵运算,而矩阵运算正是 GPU 的强项。

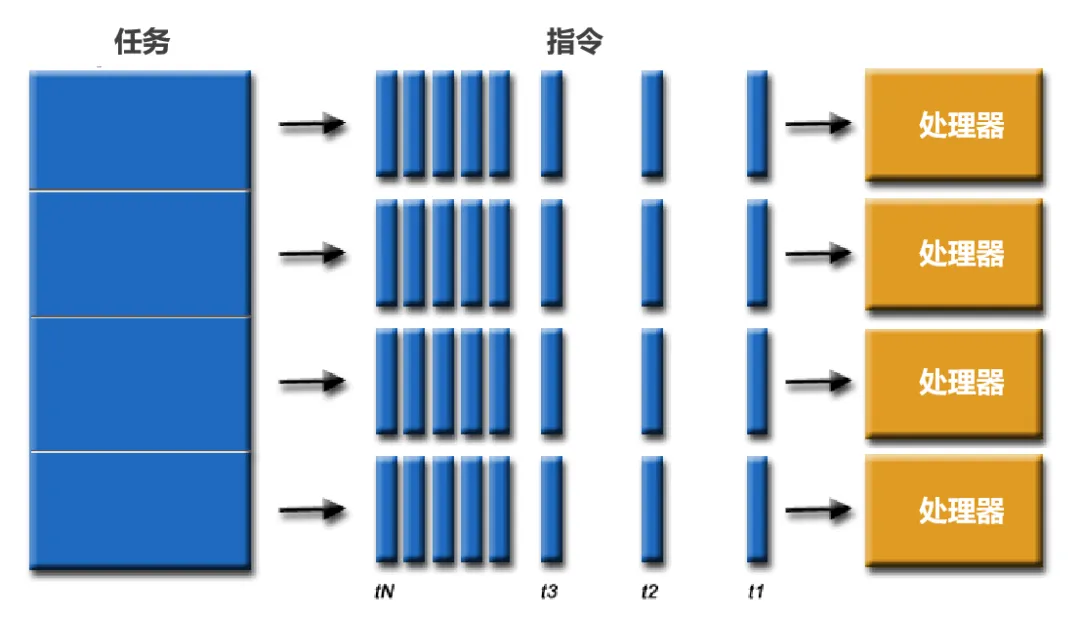

- CPU 的局限性:CPU(中央处理单元)是通用处理器,设计用于执行各种计算任务。尽管现代 CPU 拥有多核设计,能够处理一定程度的并行计算,但在面对 AI 训练所需的大规模并行计算时,CPU 的局限性便显现出来。CPU 的核心数量有限,且单个核心需要处理复杂的任务调度,这限制了其在 AI 训练中的性能。

- GPU 的并行优势:与 CPU 相比,GPU 拥有更多的核心,能够同时处理成千上万个线程。这种设计使得GPU在执行高度并行的矩阵运算时,展现出无与伦比的优势。GPU的这种特性,使其在AI训练中能够大幅提高计算速度,缩短训练时间。

:::color1 接下来,我分别分析一下 CPU 与 GPU

:::

📍 CPU,擅长控制的管家

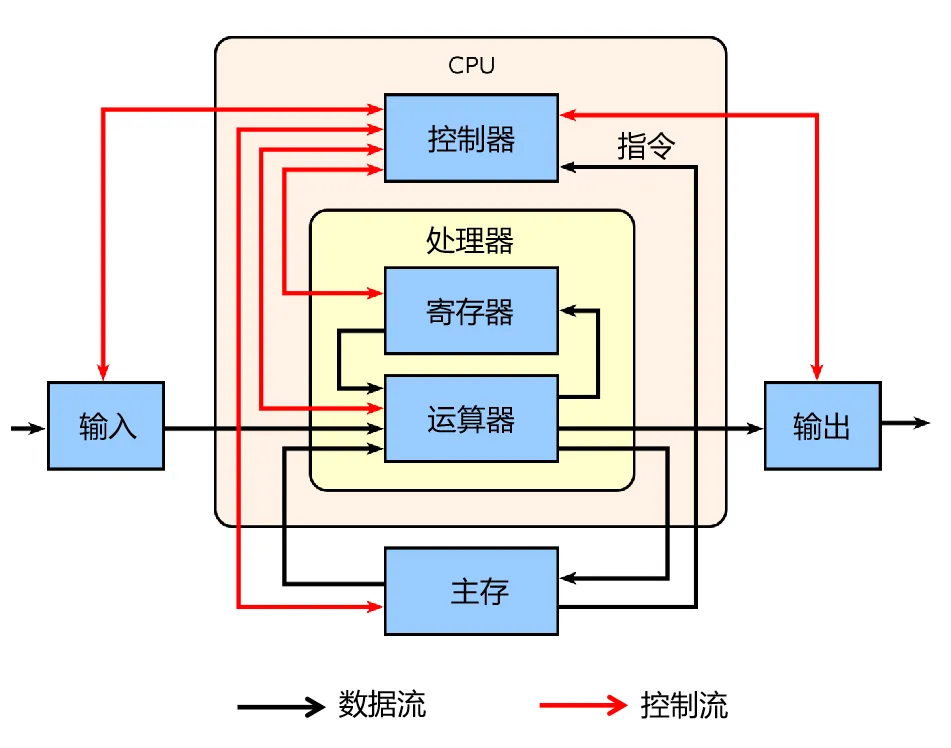

让我们来聊聊 CPU(Central Processing Unit),也就是中央处理单元,它是电脑的大脑,无可争议的指挥中心。CPU 的内部构造精巧,包含运算器(也就是逻辑运算单元,ALU)、控制器(CU),以及快速的寄存器和缓存,它们共同协作,处理着电脑的各种指令。

想象一下,当数据像快递包裹一样到达,CPU 的控制器就会把它们从存储器中取出,交给运算器进行处理。处理完毕后,结果再被送回存储器,等待下一次的调用。

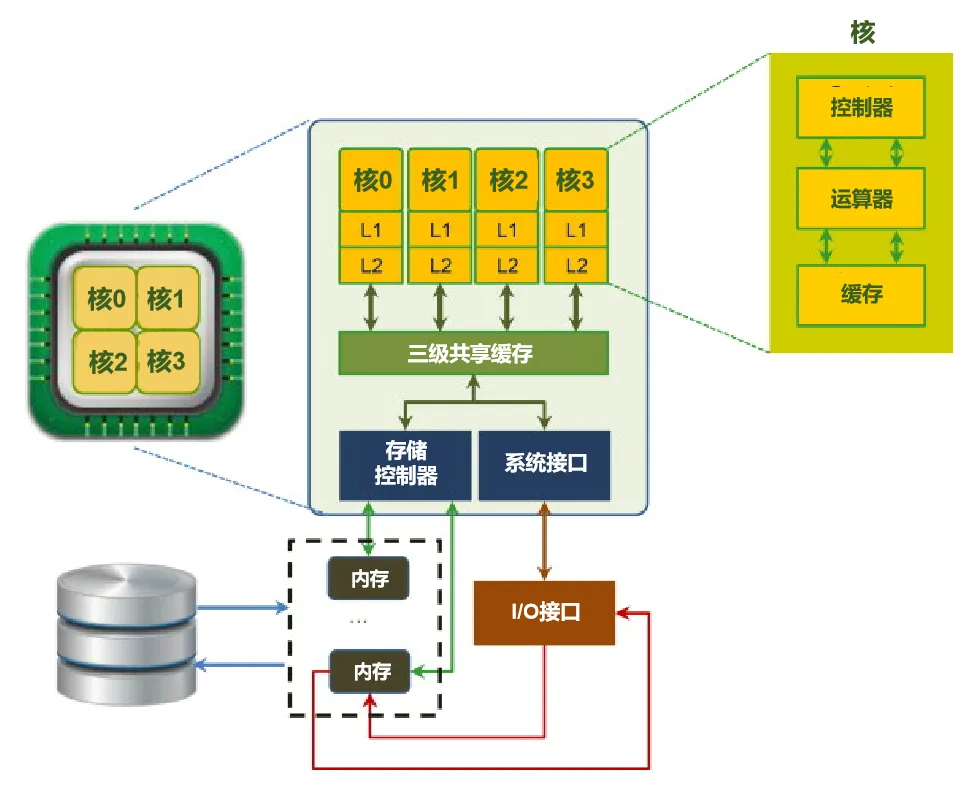

在单核 CPU 的时代,就像一位独挑大梁的管家,一次只能处理一个任务,其他任务只能排队等候。但随着技术的进步,我们进入了多核CPU的时代,这就像是有了多位管家同时工作,能够真正地并行处理多个任务。

智能手机的兴起,也曾引发了一场关于 CPU 核心数量的“核战”。厂商们竞相增加核心数,从双核到四核,再到八核,仿佛核心越多,手机就越强大。然而,随着时间的推移,人们逐渐认识到,单纯的核心数量并不是性能的唯一标准。

那么,为什么CPU不继续增加更多的核心呢?原因很简单,CPU就像一位多才多艺的管家,它需要处理各种复杂的任务,包括数据计算和人机交互。每增加一个核心,就需要更复杂的管理和调度,更大的缓存来存储任务状态,以减少任务切换时的延迟。

而且,核心数量的增加也会带来通讯压力和功耗问题。如果核心之间不能高效协作,或者任务分配不均,那么增加的核心反而可能成为性能的拖累。

📍 GPU,并行计算专家

✍️ GPU的起源

接下来,让我们把目光转向 GPU,也就是图形处理单元。GPU 的诞生,原本是为了减轻CPU的负担,加速三维图形的渲染,它通常是电脑显卡中的核心部件。

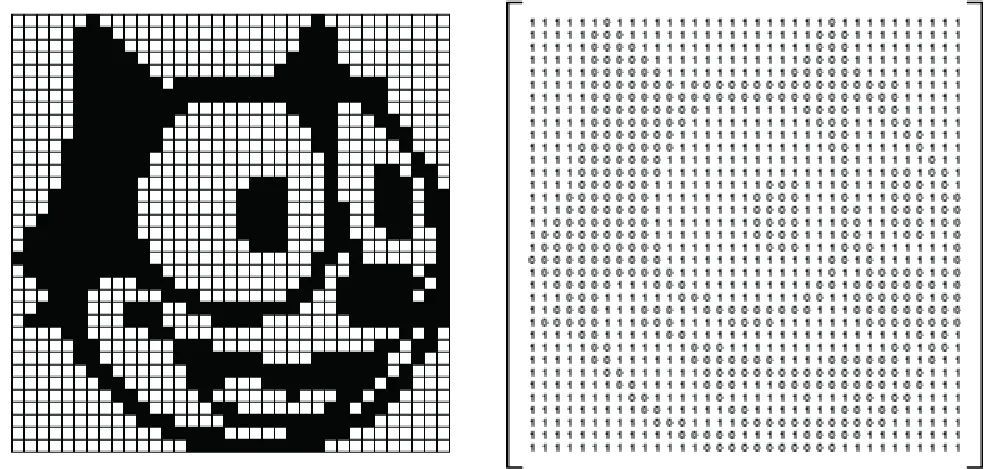

想象一下,一张绚丽的图片,其实是由无数个像素点组成的,这些像素点可以被转换成一个巨大的矩阵。GPU 的强项,就是对这种矩阵进行密集的并行计算,从而快速完成图像的处理。

✍️ GPU的崛起与架构优势

自1999年 Nvidia 推出其革命性的 GeForce256 以来,GPU 一词便开始流行起来。这款产品能够同时对每个像素点进行处理,执行图形转换、照明和三角剪裁等复杂的数学计算,极大地提升了图像渲染的速度。

那么,为什么 GPU 擅长如此密集并行计算呢?这主要得益于它与 CPU 截然不同的架构。

CPU 像是全能的瑞士军刀,核心数量虽少,但每个核心都拥有强大的运算能力和丰富的缓存,适合处理各种复杂的任务。而 GPU 则更像是一支庞大的蚂蚁军团,单个核心的运算能力并不突出,缓存也不大,但通过增加海量的核心数量,它能够集中力量,完成大量简单的并行计算任务。

✍️ GPU的多元化应用与AI革命

从图形渲染到智能计算的转变

随着时间的推移,GPU变得更加灵活和可编程,它的应用范围也不再局限于图像渲染。如今,GPU已经被广泛应用于高性能计算、深度学习等众多领域。

在人工智能的浪潮中,GPU凭借其强大的并行计算能力,从边缘角色一跃成为舞台的中心,成为了炙手可热的明星。GPU 的新名字,GPGPU,即通用 GPU,标志着它已经成为了 AI 训练的首选平台。

与传统的 CPU 训练相比,基于 GPU 的训练速度有了质的飞跃,使得 GPU 成为了训练大型、复杂神经网络系统的首选。同时,GPU 也非常适合执行推理操作,其并行特性能够充分发挥其强大的计算能力。

因此,由GPU提供的算力,也被称为“智算”,它正在开启人工智能的新纪元。

✍️ GPU 通识及硬件选型

关于 GPU 通识及硬件选型,建议大家移步看我另外一篇文章👇

学习更多关于 AI 大模型全栈知识👇

:::danger 🌈** AI大模型全栈通识课程**👇

:::

:::color1 🙋 个人介绍 **👉🏻**

:::

:::color5 🙋 AI 工具 **👉🏻**

:::

:::info 🙋 开源版知识库**👉🏻**

:::

:::warning 🙋 AI全栈通识课堂

:::

✅免责声明

素材来源于网络以及个人总结,仅供个人学习交流无商业用途,版本归原创者所有

如有侵权请及时与我联系(微信:AGI舰长-LHYYH0001)删除