摘要

深度神经网络(DNN)通常是通过反向传播算法以批量化的学习设置来训练的,它需要在学习任务之前就准备好所有的训练数据。这在现实中的很多场景中是不可扩展的,因为现实中的新数据都是以数据流的形式先后到达的。

我们的目标是解决在高速数据流中进行在线参数设置的「在线深度学习」的一些开放性问题。

- 与经常在浅层神经网络中最优化一些凸性目标函数的传统在线学习(例如,线性的/基于核的假设)不一样的是,在线深度学习(ODL)更加具有挑战性,因为深度神经网络中的目标函数的优化是非凸的,

- 而且常规的反向传播在实际过程中也不能很好地奏效,尤其是在线学习的设置中。

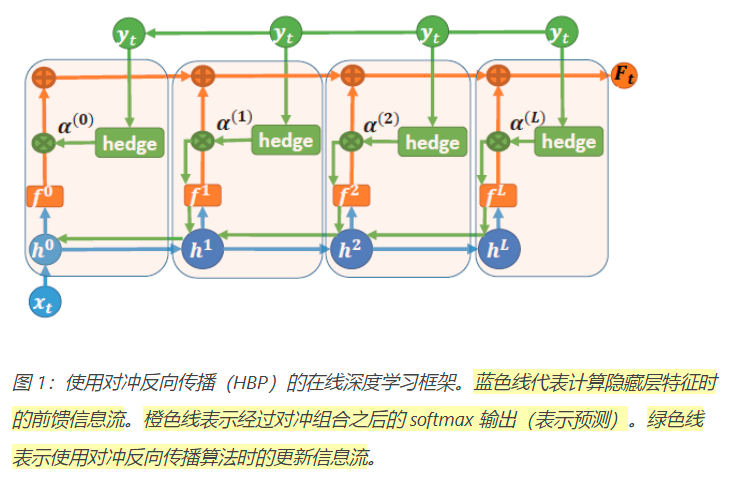

- 在这篇论文中,我们提出了一种新的在线深度学习框架,通过在线学习设置中使用一连串的训练数据,学习 DNN 模型的适应性深度,以解决这些挑战。

- 实际上,为了高效地更新 DNN 中的参数,我们提出了一个新型的对冲反向传播(Hedge Backpropagation,HBP)方法,并在大规模的数据集上验证了我们的方法,包括稳定的场景和概念漂移的场景。

数据流是动态的

学习深度神经网络面临着很多挑战,包括但不限于

- 梯度消失、逐渐减少的特征重用、

- 鞍点(以及局部极小值)、

- 大量的需要调节的参数、训练过程中内部协变量的变化、

- 选择好的正则化方法的困难、

- 选择超参数,等等。

选择合适的模型容量(例如,网络的深度)。

- 如果模型太复杂(例如,非常深的网络),那么学习过程会收敛的很慢(梯度消失和逐渐减少的特征重用),因此就会损失在线学习的优势。

- 另一个极端是,如果模型太简单,那么学习的能力又会特别局限,并且,缺少深度的话很难学习复杂的模式。

在关于批量学习的文献中,通常用来解决这个问题的方式是在验证数据中做模型选择。不幸的是,在在线设置中设定验证数据是不太现实的,所以在在线学习的场景中使用传统的模型选择方法是不太现实的。

我们的目标是设计一种在线学习算法,

- 它能够以一个浅层网络开始,这时候具有快速收敛的优点;

- 然后随着更多的数据到达,逐渐地自动转换成更深的模型(同时还能共享浅层网络学到的知识),以学习更加复杂的假设,通过深度神经网络容量的自适应特性有效地提升在线预测性能。

不使用标准的反向传播算法,我们提出了新的对冲反向传播(Hedge Backpropagation)方法

- 在每一轮的在线学习中都会评估每一个分类器的性能,并且能够通过使用对冲算法 (Freund and Schapire 1997) 中具有不同深度的分类器去扩展反向传播算法,以便在线地训练深度神经网络